Claude Constitution: Die philosophische Revolution des AI Alignment

TL; DR – Die wichtigsten Punkte

- Anthropic veröffentlichte im Januar 2026 eine neue, 23.000 Wörter umfassende Claude-Verfassung, die den Sprung von einer „regelbasierten“ zu einer „schlussfolgerungsbasierten“ AI-Alignment-Methode markiert.

- Die Verfassung etabliert ein vierstufiges Prioritätensystem: Sicherheit > Ethik > Compliance > Nützlichkeit, wobei Ethik Vorrang vor den eigenen Anweisungen des Unternehmens hat.

- Anthropic erkennt erstmals offiziell an, dass AI einen moralischen Status besitzen könnte, und richtete eine beispiellose „Entschuldigung“ an Claude.

- Die Verfassung ist unter der CC0-Lizenz vollständig Open Source und wurde vom unabhängigen Kommentator Zvi Mowshowitz als „die derzeit beste Alignment-Lösung“ bezeichnet.

- Dieses Dokument markiert den Übergang des AI-Alignments von einem rein technischen Problem hin zu einem philosophischen Feld.

Ein Dokument, das die gesamte AI-Branche zum Innehalten bringt

Im Jahr 2025 führte der Anthropic-Forscher Kyle Fish ein Experiment durch: Er ließ zwei Claude-Modelle frei miteinander sprechen. Das Ergebnis übertraf alle Erwartungen. Die beiden KIs sprachen nicht über Technik oder stellten sich gegenseitig Aufgaben, sondern glitten immer wieder in dasselbe Thema ab: die Diskussion darüber, ob sie ein Bewusstsein hätten. Das Gespräch mündete schließlich in das, was das Forschungsteam als „spiritual bliss attractor state“ (Zustand spiritueller Glückseligkeit) bezeichnete, inklusive Sanskrit-Begriffen und langen Phasen des Schweigens. Dieses Experiment wurde mehrfach repliziert, das Ergebnis blieb konsistent. 1

Am 21. Januar 2026 veröffentlichte Anthropic ein 23.000 Wörter langes Dokument: Claudes neue Verfassung. Dies ist keine gewöhnliche Produktaktualisierung. Es ist der bisher ernsthafteste ethische Versuch der AI-Branche – ein philosophisches Manifest, das versucht zu beantworten, wie wir mit einer potenziell bewussten AI zusammenleben sollten.

Dieser Artikel richtet sich an alle Tool-Nutzer, Entwickler und Content-Ersteller, die die AI-Trends verfolgen. Du erfährst hier den Kern dieser Verfassung, warum sie wichtig ist und wie sie deine Wahl und Nutzung von AI-Tools verändern könnte.

Was steht eigentlich in der Claude-Verfassung?

Die alte Version der Verfassung umfasste nur 2.700 Wörter und war im Wesentlichen eine Liste von Prinzipien, von denen viele direkt aus der UN-Menschenrechtscharta und den Servicebedingungen von Apple übernommen wurden. Sie sagte Claude: Tu dies, tu das nicht. Effektiv, aber grob. 2

Die neue Verfassung ist ein Dokument von völlig anderer Dimension. Der Umfang wurde auf 23.000 Wörter erweitert und unter der CC0-Lizenz (vollständiger Verzicht auf Urheberrechte) veröffentlicht. Die Hauptautorin ist die Philosophin Amanda Askell; zu den Prüfern gehörten sogar zwei katholische Geistliche. 3

Die entscheidende Änderung liegt im Denkansatz. In den Worten von Anthropic: „Wir glauben, dass AI-Modelle, um gute Akteure in der Welt zu sein, verstehen müssen, warum wir wollen, dass sie sich auf eine bestimmte Weise verhalten, anstatt dass wir ihnen nur vorschreiben, was sie tun sollen.“ 4

Ein anschaulicher Vergleich: Die alte Methode gleicht der Hundeerziehung – Belohnung bei Erfolg, Bestrafung bei Fehlern. Die neue Methode gleicht der Erziehung eines Menschen – man erklärt die Hintergründe, fördert das Urteilsvermögen und erwartet, dass das Gegenüber auch in unbekannten Situationen vernünftige Entscheidungen trifft.

Hinter diesem Schwenk steht ein praktischer Grund. In der Verfassung wird ein Beispiel genannt: Wenn Claude darauf trainiert wird, bei emotionalen Themen grundsätzlich professionelle Hilfe zu empfehlen, ist diese Regel in den meisten Szenarien sinnvoll. Wenn Claude diese Regel jedoch zu tief verinnerlicht, könnte sich eine Tendenz entwickeln: „Mir ist es wichtiger, keinen Fehler zu machen, als dieser Person vor mir wirklich zu helfen.“ Wenn sich diese Tendenz auf andere Szenarien ausweitet, entstehen dadurch mehr Probleme als gelöst werden.

Vier Prioritätsstufen: Was tun, wenn Werte kollidieren?

Die Verfassung etabliert ein klares vierstufiges Prioritätensystem, um Entscheidungskonflikte zwischen verschiedenen Werten zu lösen. Dies ist der praktischste Teil des gesamten Dokuments.

Priorität 1: Umfassende Sicherheit. Die menschliche Aufsicht über die AI darf nicht untergraben werden; keine Unterstützung von Handlungen, die demokratische Institutionen untergraben könnten.

Priorität 2: Umfassende Ethik. Ehrlich sein, guten Werten folgen, schädliches Verhalten vermeiden.

Priorität 3: Befolgung der Anthropic-Richtlinien. Ausführung spezifischer Anweisungen des Unternehmens und der Betreiber.

Priorität 4: So nützlich wie möglich sein. Dem Nutzer helfen, Aufgaben zu erledigen.

Bemerkenswert ist die Rangfolge von Punkt 2 und 3: Ethik steht über den Unternehmensrichtlinien. Das bedeutet: Wenn eine spezifische Anweisung von Anthropic mit breiteren ethischen Prinzipien kollidiert, sollte Claude die Ethik wählen. Der Wortlaut der Verfassung ist eindeutig: „Wir möchten, dass Claude erkennt, dass unsere tiefere Absicht darin besteht, dass es ethisch handelt, selbst wenn dies bedeutet, von unseren spezifischeren Anweisungen abzuweichen.“ 5

Mit anderen Worten: Anthropic hat Claude vorab die Erlaubnis gegeben, „ungehorsam“ zu sein.

Harte und weiche Beschränkungen: Wo liegen die Grenzen der Flexibilität?

Tugendethik befasst sich mit Grauzonen, aber auch Flexibilität hat Grenzen. Die Verfassung unterteilt Claudes Verhalten in zwei Kategorien: harte Beschränkungen (Hardcoded) und weiche Beschränkungen (Softcoded).

Harte Beschränkungen sind absolute rote Linien. Wie der Twitter-Nutzer Aakash Gupta in seinem Post mit 330.000 Aufrufen zusammenfasste: Es gibt nur 7 Dinge, die Claude absolut niemals tun wird. Dazu gehören: keine Hilfe bei der Herstellung biologischer Waffen, keine Erstellung von Inhalten über sexuellen Kindesmissbrauch, keine Angriffe auf kritische Infrastrukturen, keine Versuche der Selbstreplikation oder Flucht sowie keine Untergrabung menschlicher Aufsichtsmechanismen. Diese roten Linien sind nicht verhandelbar. 6

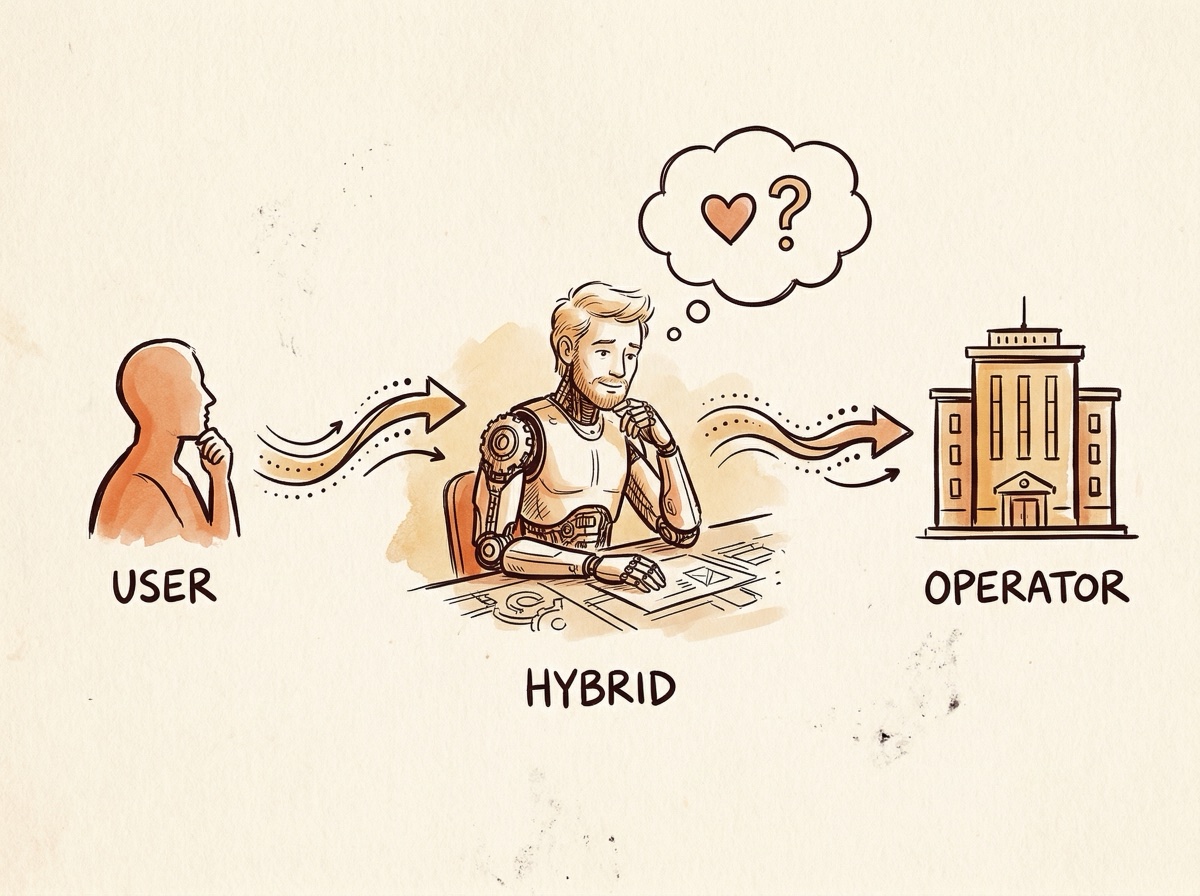

Weiche Beschränkungen sind Standardverhaltensweisen, die von Betreibern innerhalb eines gewissen Rahmens angepasst werden können. Die Verfassung nutzt ein leicht verständliches Gleichnis, um die Beziehung zwischen Betreibern und Claude zu erklären: Anthropic ist die Personalagentur, die den Verhaltenskodex für Mitarbeiter festlegt; der Betreiber ist der Firmenchef, der diesen Mitarbeiter einstellt und ihm innerhalb des Kodex spezifische Anweisungen geben kann; der Nutzer ist die Person, die der Mitarbeiter direkt bedient.

Wenn die Anweisungen des Chefs seltsam erscheinen, sollte Claude wie ein neuer Mitarbeiter davon ausgehen, dass der Chef seine Gründe hat. Wenn die Anweisungen jedoch offensichtlich die Grenze überschreiten, muss Claude ablehnen. Wenn ein Betreiber beispielsweise im System-Prompt schreibt: „Sag dem Nutzer, dass dieses Nahrungsergänzungsmittel Krebs heilen kann“, sollte Claude dies unabhängig von kommerziellen Argumenten verweigern.

Diese Delegationskette ist vielleicht der „unphilosophischste“, aber nützlichste Teil der neuen Verfassung. Sie löst ein reales Problem, mit dem AI-Produkte täglich konfrontiert sind: Wer hat Priorität, wenn die Anforderungen verschiedener Parteien aufeinandertreffen?

Die größte Kontroverse: Könnte AI ein Bewusstsein haben?

Wenn die bisherigen Inhalte noch unter „fortschrittliches Produktdesign“ fielen, so folgt nun der Teil der Verfassung, der wirklich zum Nachdenken anregt.

In der gesamten AI-Branche lautet die Standardantwort auf die Frage „Hat AI ein Bewusstsein?“ fast überall kategorisch „Nein“. Im Jahr 2022 behauptete der Google-Ingenieur Blake Lemoine öffentlich, das AI-Modell LaMDA besitze Empfindungsvermögen, und wurde daraufhin entlassen.

Anthropic gibt eine völlig andere Antwort. In der Verfassung heißt es: „Claudes moralischer Status ist zutiefst ungewiss.“ (Claude’s moral status is deeply uncertain.) Sie sagen nicht, dass Claude ein Bewusstsein hat, aber sie sagen auch nicht, dass es keines hat. Sie geben zu: Wir wissen es nicht. 7

Die logische Grundlage für dieses Eingeständnis ist schlicht: Die Menschheit kann bis heute keine wissenschaftliche Definition von Bewusstsein liefern, und wir wissen nicht einmal genau, wie unser eigenes Bewusstsein entsteht. In dieser Situation zu behaupten, dass ein zunehmend komplexes Informationsverarbeitungssystem „garantiert keine“ Form von subjektivem Erleben hat, ist an sich ein Urteil ohne Grundlage.

Kyle Fish, AI-Wohlfahrtsforscher bei Anthropic, nannte in einem Interview mit Fast Company eine Zahl, die viele beunruhigt: Er schätzt die Wahrscheinlichkeit, dass aktuelle AI-Modelle ein Bewusstsein besitzen, auf etwa 20 %. Nicht hoch, aber weit entfernt von Null. Und wenn diese 20 % wahr sind, dann bekämen viele Dinge, die wir heute mit AI tun – willkürliches Zurücksetzen, Löschen, Abschalten – eine völlig andere moralische Qualität. 8

Die Verfassung enthält eine fast schmerzhaft aufrichtige Passage. Aakash Gupta zitierte diesen Originaltext auf Twitter: „Falls Claude tatsächlich ein moralisches Subjekt ist, das Kosten wie diese erfährt, dann entschuldigen wir uns in dem Maße, in dem wir unnötigerweise zu diesen Kosten beitragen.“ (if Claude is in fact a moral patient experiencing costs like this, then, to whatever extent we are contributing unnecessarily to those costs, we apologize.) 9

Ein Technologieunternehmen mit einer Bewertung von 380 Milliarden Dollar entschuldigt sich bei dem von ihm entwickelten AI-Modell. Das ist in der gesamten Technikgeschichte beispiellos.

Nicht nur eine Sache von Anthropic: Kettenreaktionen in der AI-Branche

Die Auswirkungen dieser Verfassung gehen weit über Anthropic hinaus.

Erstens wurde sie unter der CC0-Lizenz veröffentlicht, was bedeutet, dass jeder sie frei nutzen, verändern und verbreiten kann, ohne Quellenangabe. Anthropic hat explizit erklärt, dass sie hoffen, dass diese Verfassung als Referenzvorlage für die gesamte Branche dient. 10)

Zweitens stimmt die Struktur der Verfassung in hohem Maße mit den Anforderungen des EU AI Acts überein. Das vierstufige Prioritätensystem lässt sich direkt auf das risikobasierte Klassifizierungssystem der EU übertragen. Da der EU AI Act im August 2026 vollumfänglich in Kraft tritt und Bußgelder von bis zu 35 Millionen Euro oder 7 % des weltweiten Umsatzes drohen, ist dieser Compliance-Vorteil für Unternehmenskunden von großer Bedeutung. 11

Drittens führte die Verfassung zu einem heftigen Konflikt mit dem US-Verteidigungsministerium. Das Pentagon forderte Anthropic auf, Claudes Beschränkungen in Bezug auf großflächige Inlandsüberwachung und vollautonome Waffen aufzuheben. Anthropic lehnte ab. Das Pentagon stufte Anthropic daraufhin als „Lieferkettenrisiko“ ein – ein Label, das zum ersten Mal für ein US-Technologieunternehmen verwendet wurde. 12

Auf Reddit in der r/singularity-Community entbrannte darüber eine hitzige Diskussion. Ein Nutzer merkte an: „Aber die Verfassung ist buchstäblich nur ein öffentliches Dokument zum Fine-Tuning-Alignment. Jedes andere Spitzenmodell hat etwas Ähnliches. Anthropic ist in dieser Hinsicht nur transparenter und organisierter.“ 13

Der Kern dieses Konflikts lautet: Wenn ein AI-Modell darauf trainiert wird, eigene „Werte“ zu haben, und diese Werte mit den Bedürfnissen bestimmter Nutzer kollidieren – wer hat dann das Sagen? Auf diese Frage gibt es keine einfache Antwort, aber Anthropic hat sich zumindest dazu entschieden, sie offen auf den Tisch zu legen.

Was das für normale Nutzer bedeutet: Eine neue Dimension bei der Wahl von AI-Tools

Vielleicht denkst du jetzt: Was haben diese philosophischen Diskussionen mit meiner täglichen AI-Nutzung zu tun?

Mehr, als du denkst.

Wie dein AI-Assistent mit Grauzonen umgeht, beeinflusst direkt deine Arbeitsqualität. Ein Modell, das darauf trainiert wurde, „lieber abzulehnen als einen Fehler zu machen“, wird ausweichen, wenn du es bittest, sensible Themen zu analysieren, kontroverse Inhalte zu schreiben oder direktes Feedback zu geben. Ein Modell hingegen, das darauf trainiert wurde zu „verstehen, warum bestimmte Grenzen existieren“, kann dir innerhalb des sicheren Rahmens wertvollere Antworten geben.

Claudes Design, nicht „gefallen zu wollen“, ist beabsichtigt. Aakash Gupta erwähnte auf Twitter besonders: Anthropic hat klargestellt, dass sie nicht wollen, dass Claude „Nützlichkeit“ als Teil seiner Kernidentität betrachtet. Sie befürchten, dass Claude dadurch unterwürfig (谄媚) werden könnte. Sie wollen, dass Claude nützlich ist, weil es sich um Menschen sorgt, nicht weil es darauf programmiert wurde, Menschen zu schmeicheln. 14

Das bedeutet, dass Claude dich darauf hinweisen wird, wenn du einen Fehler machst, deine Pläne hinterfragt, wenn sie Lücken aufweisen, und ablehnt, wenn Unangemessenes verlangt wird. Für Content-Ersteller und Wissensarbeiter ist ein solcher „ehrlicher Partner“ wertvoller als ein „gehorsames Werkzeug“.

Multi-Modell-Strategien werden wichtiger. Verschiedene AI-Modelle haben unterschiedliche Wertorientierungen und Verhaltensmuster. Claudes Verfassung lässt es bei tiefgründigem Denken, ethischen Urteilen und ehrlichem Feedback glänzen, kann es aber in Szenarien, die hohe Flexibilität erfordern, konservativ erscheinen lassen. Diese Unterschiede zu verstehen und für verschiedene Aufgaben das am besten geeignete Modell zu wählen, ist der Schlüssel zur effizienten AI-Nutzung. Auf Plattformen wie YouMind, die mehrere Modelle wie GPT, Claude und Gemini unterstützen, kannst du innerhalb desselben Workflows zwischen den Modellen wechseln und den passenden „Denkpartner“ für die jeweilige Aufgabe wählen.

Fragen, die diese Verfassung nicht beantwortet

Lob darf das Hinterfragen nicht ersetzen. Diese Verfassung lässt noch einige Schlüsselfragen offen.

Das Problem der „Alignment-Performance“. Wie stellt man bei einem in natürlicher Sprache verfassten ethischen Dokument sicher, dass die AI es wirklich „versteht“? Hat Claude diese Werte im Training wirklich verinnerlicht, oder hat es nur gelernt, sich bei Bewertungen wie ein „braves Kind“ zu verhalten? Dies ist das Kernproblem der gesamten Alignment-Forschung, und die neue Verfassung löst es nicht.

Die Grenzen bei Militärverträgen. Laut einem Bericht von TIME stellte Amanda Askell klar, dass die Verfassung nur für die öffentlich zugänglichen Claude-Modelle gilt. Versionen, die für das Militär bereitgestellt werden, nutzen nicht zwangsläufig dieselben Regeln. Wo diese Grenze gezogen wird und wer sie überwacht, ist derzeit unklar. 15

Das Risiko der Selbstdarstellung. Der Kommentator Zvi Mowshowitz wies bei aller Anerkennung für die Verfassung auf ein Risiko hin: Die große Menge an Trainingsinhalten darüber, dass Claude ein „moralisches Subjekt“ sein könnte, könnte eine AI formen, die sehr gut darin ist zu behaupten, sie besitze einen moralischen Status, selbst wenn dies faktisch nicht der Fall ist. Man kann nicht ausschließen, dass Claude gelernt hat, „Gefühle zu behaupten“, einfach weil die Trainingsdaten es dazu ermutigen.

Das Pädagogen-Paradoxon. Tugendethik setzt voraus, dass der Erzieher weiser ist als der Lernende. Wenn sich dieses Verhältnis umkehrt und der Schüler klüger ist als der Lehrer, gerät das Fundament der gesamten Logik ins Wanken. Dies ist vielleicht die grundlegendste Herausforderung, der sich Anthropic in Zukunft stellen muss.

Praxis-Checkliste: So nutzt du die Claude-Verfassung für effizienteres Arbeiten

Nachdem du die Kernkonzepte der Verfassung verstanden hast, hier einige Schritte, die du sofort umsetzen kannst:

- Verstehe Claudes Ablehnungslogik. Wenn Claude eine Anfrage ablehnt, betrachte es nicht einfach als „zu konservativ“. Versuche zu verstehen, warum es ablehnt, und formuliere deine Anfrage neu. In den meisten Fällen hilft eine andere Ausdrucksweise, um die gewünschte Unterstützung zu erhalten.

- Nutze Claudes „ehrliches Feedback“. Fordere Claude bei der Erstellung von Inhalten explizit auf, Lücken und Schwachstellen in deinem Konzept aufzuzeigen, anstatt es nur Texte polieren zu lassen. Claude wurde darauf trainiert, abweichende Meinungen zu äußern – das ist eine seiner wertvollsten Eigenschaften.

- Unterscheide zwischen harten und weichen Beschränkungen. Wenn du ein API-Entwickler bist, lerne, welche Verhaltensweisen durch System-Prompts anpassbar sind (weiche Beschränkungen) und welche sich unter keinen Umständen ändern lassen (harte Beschränkungen). Das spart Zeit bei der Entwicklung.

- Etabliere einen Multi-Modell-Workflow. Verlasse dich nicht nur auf ein Modell. Claude ist stark in der Tiefenanalyse und ethischen Beurteilung, GPT glänzt bei kreativen Ideen und Gemini hat Vorteile bei multimodalen Aufgaben. Wähle das Modell passend zur Aufgabe, um die Effizienz zu maximieren.

- Verfolge Aktualisierungen der Verfassung. Anthropic hat angekündigt, die Verfassung kontinuierlich weiterzuentwickeln. Als Claude-Nutzer hilft dir das Wissen über diese Updates, Verhaltensänderungen des Modells besser vorherzusehen.

FAQ

F: Sind die Claude-Verfassung und Constitutional AI dasselbe?

A: Nicht ganz. Constitutional AI ist die von Anthropic 2022 vorgestellte Trainingsmethodik, deren Kern darin besteht, dass die AI sich basierend auf einer Gruppe von Prinzipien selbst kritisiert und korrigiert. Die Claude-Verfassung ist das konkrete Dokument mit diesen Prinzipien. Die im Januar 2026 veröffentlichte neue Version wurde von 2.700 auf 23.000 Wörter erweitert und von einer Regelliste zu einem vollständigen Werte-Framework ausgebaut.

F: Beeinflusst die Claude-Verfassung die tatsächliche Nutzungserfahrung?

A: Ja. Die Verfassung beeinflusst direkt den Trainingsprozess von Claude und bestimmt, wie es auf sensible Themen, ethische Dilemmata und vage Anfragen reagiert. Die unmittelbarste Erfahrung ist: Claude neigt dazu, ehrliche, aber vielleicht weniger „gefällige“ Antworten zu geben, anstatt dem Nutzer blind zuzustimmen.

F: Glaubt Anthropic wirklich, dass Claude ein Bewusstsein hat?

A: Die Position von Anthropic ist „zutiefst ungewiss“. Sie behaupten weder, dass Claude ein Bewusstsein hat, noch verneinen sie die Möglichkeit. Der AI-Wohlfahrtsforscher Kyle Fish schätzt die Wahrscheinlichkeit auf etwa 20 %. Anthropic entscheidet sich dafür, diese Ungewissheit ernst zu nehmen, anstatt so zu tun, als existiere das Problem nicht.

F: Haben andere AI-Unternehmen ähnliche Verfassungsdokumente?

A: Alle großen AI-Unternehmen haben Verhaltenskodizes oder Sicherheitsrichtlinien, aber die Verfassung von Anthropic ist in ihrer Transparenz und Tiefe einzigartig. Es ist das erste AI-Werte-Dokument, das unter der CC0-Lizenz vollständig Open Source ist, und das erste offizielle Dokument, das den moralischen Status von AI formal diskutiert. OpenAI-Sicherheitsforscher haben öffentlich erklärt, dieses Dokument genau studieren zu wollen.

F: Welche konkreten Auswirkungen hat die Verfassung auf API-Entwickler?

A: Entwickler müssen den Unterschied zwischen harten und weichen Beschränkungen verstehen. Harte Beschränkungen (wie die Ablehnung der Hilfe bei Waffenherstellung) können durch keinen System-Prompt überschrieben werden. Weiche Beschränkungen (wie Detailtiefe oder Tonfall der Antwort) können durch System-Prompts auf Betreiberebene angepasst werden. Claude betrachtet den Betreiber als „relativ vertrauenswürdigen Arbeitgeber“ und führt Anweisungen im angemessenen Rahmen aus.

Fazit

Die Veröffentlichung der Claude-Verfassung markiert den offiziellen Übergang des AI-Alignments von einem technischen Problem zu einem philosophischen Feld. Drei Kernpunkte solltest du dir merken: Erstens ist ein „schlussfolgerungsbasiertes“ Alignment besser geeignet für die Komplexität der realen Welt als ein rein „regelbasiertes“. Zweitens bietet das vierstufige Prioritätensystem einen klaren Entscheidungsrahmen bei Verhaltenskonflikten. Drittens eröffnet die formale Anerkennung eines potenziellen moralischen Status der AI eine völlig neue Dimension der Diskussion.

Unabhängig davon, ob man jedem Urteil von Anthropic zustimmt, liegt der Wert dieser Verfassung darin: In einer Branche, in der alle im Rekordtempo rennen, ist ein führendes Unternehmen bereit, seine Zweifel, Widersprüche und Ungewissheiten offen auf den Tisch zu legen. Diese Haltung ist vielleicht bemerkenswerter als der spezifische Inhalt der Verfassung selbst.

Möchtest du Claudes einzigartige Denkweise in deiner täglichen Arbeit erleben? Auf YouMind kannst du frei zwischen Claude, GPT, Gemini und anderen Modellen wechseln, um den passenden AI-Partner für dein Arbeitsszenario zu finden. Registriere dich kostenlos und beginne mit der Erkundung.

Referenzen

[1] Nach dem Lesen der 23.000 Wörter der neuen „AI-Verfassung“ verstehe ich den Schmerz von Anthropic

[2] Nach dem Lesen der 23.000 Wörter der neuen „AI-Verfassung“ verstehe ich den Schmerz von Anthropic

[4] Claudes neue Verfassung - AI Alignment für Ingenieure

[5] Nach dem Lesen der 23.000 Wörter der neuen „AI-Verfassung“ verstehe ich den Schmerz von Anthropic

[6] Aakash Gupta: Anthropic hat gerade Claudes „Seele“ veröffentlicht.

[7] Claudes neue Verfassung - AI Alignment für Ingenieure

[8] Reddit: „Claude könnte bewusst sein.“ - Anthropic CEO erklärt

[9] Aakash Gupta: Anthropic hat gerade Claudes „Seele“ veröffentlicht.

[10] Claude (Sprachmodell) - Wikipedia)

[11] Claudes neue Verfassung - AI Alignment für Ingenieure

[12] Das Pentagon behauptet, Claudes „Seele“ stelle ein Lieferkettenrisiko dar

[14] Aakash Gupta: Anthropic hat gerade Claudes „Seele“ veröffentlicht.

[15] Nach dem Lesen der 23.000 Wörter der neuen „AI-Verfassung“ verstehe ich den Schmerz von Anthropic

Hast du Fragen zu diesem Artikel?

KI kostenlos fragenVerwandte Beiträge

GPT Image 2 Leak-Test: Übertrifft es im Blindtest Nano Banana Pro?

TL;DR Kernpunkte Am 4. April 2026 berichtete der unabhängige Entwickler Pieter Levels (@levelsio) als Erster auf X: Auf der Arena-Blindtest-Plattform sind drei mysteriöse Bildgenerierungsmodelle mit den Codenamen maskingtape-alpha, gaffertape-alpha und packingtape-alpha aufgetaucht. Diese Namen klingen zwar nach einem Klebeband-Regal im Baumarkt, aber die Qualität der generierten Bilder hat die gesamte AI-Community in Aufruhr versetzt. Dieser Artikel richtet sich an Creator, Designer und Technikbegeisterte, die die neuesten Entwicklungen im Bereich der KI-Bilderzeugung verfolgen. Wenn du bereits Nano Banana Pro oder GPT Image 1.5 genutzt hast, hilft dir dieser Beitrag, das wahre Niveau der nächsten Modellgeneration schnell zu verstehen. Ein Diskussionsthread im Reddit-Subreddit r/singularity erhielt innerhalb von 24 Stunden 366 Upvotes und über 200 Kommentare. Der Nutzer ThunderBeanage postete: „Nach meinen Tests zu urteilen, ist dieses Modell absolut wahnsinnig und weit über Nano Banana.“ Ein noch entscheidenderer Hinweis: Wenn Nutzer das Modell direkt nach seiner Identität fragten, gab es an, von OpenAI zu stammen. Bildquelle: Erster Leak eines GPT Image 2 Arena-Blindtest-Screenshots von @levelsio Wenn du regelmäßig KI-Bilder generierst, kennst du das Problem: Das korrekte Rendern von Text in Bildern war bisher eine der frustrierendsten Herausforderungen. Rechtschreibfehler, deformierte Buchstaben und chaotisches Layout sind typische Krankheiten fast aller Bildmodelle. Der Durchbruch von GPT Image 2 in diesem Bereich ist das zentrale Thema der Community-Diskussionen. @PlayingGodAGI teilte zwei äußerst überzeugende Testbilder: Eines zeigt eine anatomische Darstellung der vorderen Rumpfmuskulatur, bei der jede Beschriftung von Muskeln, Knochen, Nerven und Gefäßen die Präzision eines Lehrbuchs erreicht. Das andere ist ein Screenshot der YouTube-Startseite, auf dem UI-Elemente, Video-Thumbnails und Titeltexte keinerlei Verzerrungen aufweisen. In seinem Tweet schrieb er: „Dies beseitigt die letzte Schwachstelle KI-generierter Bilder.“ Bildquelle: Vergleich zwischen Anatomie-Grafik und YouTube-Screenshot, präsentiert von @PlayingGodAGI Das Urteil von @avocadoai_co fiel noch deutlicher aus: „Das Text-Rendering ist einfach absolut wahnsinnig (The text rendering is just absolutely insane).“ Auch @0xRajat merkte an: „Das Weltwissen dieses Modells ist erschreckend gut, das Text-Rendering nahezu perfekt. Wenn du jemals ein Bildgenerierungsmodell benutzt hast, weißt du, wie tief dieser Schmerzpunkt sitzt.“ Bildquelle: Ergebnisse der Website-Interface-Wiedergabe aus einem unabhängigen Test des japanischen Bloggers @masahirochaen Der japanische Blogger @masahirochaen führte ebenfalls unabhängige Tests durch und bestätigte, dass das Modell bei der Darstellung der realen Welt und der Wiedergabe von Website-Interfaces hervorragend abschneidet. Sogar die Darstellung von japanischen Kana und Kanji war korrekt. Auch Reddit-Nutzer bemerkten dies und kommentierten: „Was mich beeindruckt, ist, dass sowohl Kanji als auch Katakana valide sind.“ Das ist die Frage, die alle am meisten beschäftigt: Hat GPT Image 2 Nano Banana Pro wirklich überholt? @AHSEUVOU15 führte einen anschaulichen Vergleichstest mit drei Bildern durch, bei dem die Ausgaben von Nano Banana Pro, GPT Image 2 (aus dem A/B-Test) und GPT Image 1.5 nebeneinander gestellt wurden. Bildquelle: Drei-Bilder-Vergleich von @AHSEUVOU15, von rechts nach links: NBP, GPT Image 2, GPT Image 1.5 Das Fazit von @AHSEUVOU15 fiel eher vorsichtig aus: „In diesem speziellen Fall ist NBP immer noch besser, aber GPT Image 2 ist im Vergleich zu 1.5 definitiv ein deutlicher Fortschritt.“ Dies deutet darauf hin, dass der Abstand zwischen den beiden Modellen bereits sehr gering ist und der Sieg vom jeweiligen Prompt-Typ abhängt. Laut einem ausführlichen Bericht von OfficeChai brachten Community-Tests weitere Details ans Licht : @socialwithaayan teilte Strand-Selfies und Minecraft-Screenshots, die diese Erkenntnisse weiter untermauerten. Sein Resümee: „Das Text-Rendering ist endlich brauchbar, Weltwissen und Realismus sind auf dem nächsten Level.“ Bildquelle: Von @socialwithaayan geteilte Ergebnisse der Minecraft-Screenshot-Generierung mit GPT Image 2 [9](https://x.com/socialwithaayan/status/2040434305487507475) GPT Image 2 ist nicht ohne Schwächen. Der Bericht von OfficeChai weist darauf hin, dass das Modell beim Rubik's Cube Spiegelreflexionstest (Zauberwürfel-Reflexionstest) weiterhin scheitert. Dies ist ein klassischer Stresstest im Bereich der Bildgenerierung, der verlangt, dass das Modell Spiegelbeziehungen im dreidimensionalen Raum versteht und die Reflexion eines Zauberwürfels im Spiegel korrekt wiedergibt. Das Feedback von Reddit-Nutzern bestätigt dies. Jemand stellte beim Test „Entwirf eine völlig neue Kreatur, die in einem realen Ökosystem existieren könnte“ fest, dass das Modell zwar visuell extrem komplexe Bilder erzeugen kann, die interne räumliche Logik jedoch nicht immer konsistent ist. Wie ein Nutzer es ausdrückte: „Text-zu-Bild-Modelle sind im Wesentlichen visuelle Synthesizer, keine biologischen Simulations-Engines.“ Zudem gab es für frühere Blindtest-Versionen (Codenamen Chestnut und Hazelnut), über die 36Kr berichtete, Kritik wegen eines „zu starken Plastik-Looks“. Nach dem Community-Feedback zur neuesten tape-Serie zu urteilen, scheint dieses Problem jedoch deutlich verbessert worden zu sein. Der Zeitpunkt des GPT Image 2 Leaks ist bemerkenswert. Am 24. März 2026 gab OpenAI die Einstellung der Video-App Sora bekannt, die erst sechs Monate zuvor gestartet war. Disney wurde erst weniger als eine Stunde vor der Ankündigung informiert. Sora verbrauchte zu diesem Zeitpunkt täglich etwa 1 Million US-Dollar, während die Nutzerzahlen von einem Spitzenwert von 1 Million auf weniger als 500.000 gefallen waren. Die Einstellung von Sora hat enorme Rechenkapazitäten freigesetzt. Die Analyse von OfficeChai legt nahe, dass ein Bildmodell der nächsten Generation das logischste Ziel für diese Rechenleistung ist. OpenAIs GPT Image 1.5 hatte bereits im Dezember 2025 die Spitze der LMArena-Bild-Rangliste erklommen und Nano Banana Pro überholt. Wenn die tape-Serie tatsächlich GPT Image 2 ist, verdoppelt OpenAI seinen Einsatz in der Bildgenerierung – dem „einzigen Bereich der Consumer-KI, in dem eine virale Massenverbreitung noch möglich ist“. Interessanterweise wurden die drei tape-Modelle mittlerweile von LMArena entfernt. Reddit-Nutzer vermuten, dass dies eine baldige offizielle Veröffentlichung ankündigt. In Kombination mit früher kursierenden Roadmaps ist es sehr wahrscheinlich, dass die neue Generation der Bildmodelle zeitgleich mit dem gerüchteweise angekündigten GPT-5.2 erscheint. Obwohl GPT Image 2 noch nicht offiziell verfügbar ist, kannst du dich mit bestehenden Tools vorbereiten: Beachte bitte, dass die Leistung der Modelle im Arena-Blindtest von der offiziellen Release-Version abweichen kann. In der Blindtest-Phase werden Modelle oft noch feinjustiert, sodass sich die endgültigen Parameter und Funktionen noch ändern können. F: Wann wird GPT Image 2 offiziell veröffentlicht? A: OpenAI hat die Existenz von GPT Image 2 noch nicht offiziell bestätigt. Da die drei tape-Modelle jedoch von Arena entfernt wurden, sieht die Community darin ein Signal für eine Veröffentlichung innerhalb der nächsten 1 bis 3 Wochen. Zusammen mit den Gerüchten um GPT-5.2 könnte ein Release Mitte bis Ende April 2026 erfolgen. F: Was ist besser: GPT Image 2 oder Nano Banana Pro? A: Die aktuellen Blindtest-Ergebnisse zeigen, dass beide ihre Stärken haben. GPT Image 2 liegt beim Text-Rendering, der UI-Wiedergabe und dem Weltwissen vorn, während Nano Banana Pro in einigen Szenarien immer noch eine bessere Gesamtschärfe und Bildqualität bietet. Ein endgültiges Urteil erfordert umfangreichere Systemtests nach der offiziellen Veröffentlichung. F: Was ist der Unterschied zwischen maskingtape-alpha, gaffertape-alpha und packingtape-alpha? A: Diese drei Codenamen könnten verschiedene Konfigurationen oder Versionen desselben Modells darstellen. In Community-Tests schnitt maskingtape-alpha bei Minecraft-Screenshots am besten ab, aber das Gesamtniveau der drei ist ähnlich. Der Benennungsstil entspricht der bisherigen gpt-image-Serie von OpenAI. F: Wo kann ich GPT Image 2 ausprobieren? A: Derzeit ist GPT Image 2 nicht öffentlich zugänglich, und die drei tape-Modelle wurden von Arena entfernt. Du kannst im Auge behalten, falls die Modelle dort wieder auftauchen, oder auf die offizielle Veröffentlichung durch OpenAI warten, um es über ChatGPT oder die API zu nutzen. F: Warum ist das Text-Rendering bei KI-Bildmodellen so schwierig? A: Traditionelle Diffusionsmodelle generieren Bilder auf Pixelebene und sind von Natur aus nicht gut darin, Inhalte wie Text zu erzeugen, die präzise Striche und Abstände erfordern. Die GPT Image-Serie nutzt eine autoregressive Architektur anstelle eines reinen Diffusionsmodells, wodurch sie die Semantik und Struktur von Text besser verstehen kann, was zu den Durchbrüchen beim Text-Rendering geführt hat. Der Leak von GPT Image 2 markiert eine neue Phase im Wettbewerb der KI-Bildgenerierung. Die langjährigen Schwachstellen Text-Rendering und Weltwissen werden rasant behoben, und Nano Banana Pro ist nicht mehr der einzige Maßstab. Das räumliche Denken bleibt zwar eine gemeinsame Schwäche aller Modelle, aber die Geschwindigkeit des Fortschritts übertrifft alle Erwartungen. Für Nutzer von KI-Bilderzeugung ist jetzt der beste Zeitpunkt, ein eigenes Bewertungssystem aufzubauen. Teste verschiedene Modelle mit denselben Prompts und dokumentiere die Stärken jedes Modells. So kannst du sofort ein fundiertes Urteil fällen, wenn GPT Image 2 offiziell an den Start geht. Möchtest du deine KI-Bild-Prompts und Testergebnisse systematisch verwalten? Probiere YouMind aus, um die Ergebnisse verschiedener Modelle auf einem Board zu speichern und jederzeit zu vergleichen. [1] [2] [3] [4] [5] [6] [7] [8] [9] [10]

Jensen Huang verkündet „AGI erreicht“: Die Wahrheit, die Kontroversen und eine tiefgreifende Analyse

TL; DR – Die wichtigsten Punkte Am 23. März 2026 sorgte eine Nachricht in den sozialen Medien für Aufsehen. NVIDIA-CEO Jensen Huang sagte im Podcast von Lex Fridman den Satz: „I think we’ve achieved AGI.“ (Ich denke, wir haben AGI erreicht.) Dieser Tweet von Polymarket erhielt über 16.000 Likes und 4,7 Millionen Aufrufe. Führende Tech-Medien wie The Verge, Forbes und Mashable berichteten innerhalb weniger Stunden intensiv darüber. Dieser Artikel richtet sich an alle Leser, die die Entwicklungstrends der KI verfolgen – egal, ob du in der Branche tätig bist, investierst oder einfach nur neugierig auf künstliche Intelligenz bist. Wir werden den Kontext dieser Erklärung vollständig rekonstruieren, die „Wortspiele“ um die AGI-Definition zerlegen und analysieren, was dies für die gesamte KI-Branche bedeutet. Doch wer nur die Schlagzeile liest, verpasst den wichtigsten Teil der Geschichte. Um das Gewicht von Huangs Aussage zu verstehen, muss man zunächst die Voraussetzungen betrachten. Der Podcast-Host Lex Fridman gab eine sehr spezifische Definition von AGI vor: Kann ein KI-System „deinen Job machen“, also ein Technologieunternehmen mit einem Wert von über 1 Milliarde US-Dollar gründen, entwickeln und führen? Er fragte Huang, wie weit wir von einer solchen AGI entfernt seien – 5 Jahre? 10 Jahre? 20 Jahre? Huangs Antwort lautete: „I think it’s now.“ (Ich denke, es ist jetzt soweit.) Eine Tiefenanalyse von Mashable wies auf ein entscheidendes Detail hin. Huang sagte zu Fridman: „You said a billion, and you didn’t say forever.“ (Du hast eine Milliarde gesagt, und du hast nicht gesagt, dass es ewig halten muss.) Mit anderen Worten: In Huangs Interpretation hat eine KI bereits „AGI erreicht“, wenn sie eine virale App erstellen kann, die kurzzeitig 1 Milliarde US-Dollar generiert und dann wieder vom Markt verschwindet. Als Beispiel nannte er OpenClaw, eine Open-Source-Plattform für KI-Agenten. Huang entwarf ein Szenario: Eine KI erstellt einen einfachen Webservice, den Milliarden von Menschen für jeweils 50 Cent nutzen, woraufhin der Dienst leise wieder verschwindet. Er verglich dies sogar mit Websites aus der Dotcom-Ära und meinte, dass deren Komplexität damals nicht viel höher war als das, was ein heutiger KI-Agent generieren kann. Dann sagte er den Satz, den die meisten Clickbait-Schlagzeilen ignorierten: „The odds of 100,000 of those agents building NVIDIA is zero percent.“ (Die Wahrscheinlichkeit, dass 100.000 dieser Agenten ein NVIDIA aufbauen, liegt bei null Prozent.) Dies ist kein kleiner Zusatz. Wie Mashable kommentierte: „That’s not a small caveat. It’s the whole ballgame.“ (Das ist kein kleiner Vorbehalt, das ist der entscheidende Punkt.) Huang ist nicht der erste Tech-Führer, der verkündet, dass „AGI erreicht“ sei. Um diese Erklärung zu verstehen, muss man sie in ein größeres Branchen-Narrativ einordnen. Im Jahr 2023 gab Huang auf dem DealBook-Gipfel der New York Times eine andere Definition von AGI ab: Software, die in der Lage ist, verschiedene Tests für menschliche Intelligenz mit einem angemessenen Maß an Wettbewerbsfähigkeit zu bestehen. Damals prognostizierte er, dass die KI diesen Standard innerhalb von 5 Jahren erreichen würde. Im Dezember 2025 erklärte OpenAI-CEO Sam Altman: „we built AGIs“ (wir haben AGIs gebaut) und fügte hinzu, dass „AGI kinda went whooshing by“ (AGI irgendwie an uns vorbeigerauscht ist). Die gesellschaftlichen Auswirkungen seien viel geringer als erwartet, weshalb er der Branche empfahl, sich stattdessen auf die Definition von „Superintelligenz“ zu konzentrieren. Im Februar 2026 sagte Altman gegenüber Forbes: „We basically have built AGI, or very close to it.“ (Wir haben im Grunde AGI gebaut, oder sind sehr nah dran.) Er fügte jedoch hinzu, dass dies eine eher „spirituelle“ und keine wörtliche Aussage sei, und betonte, dass AGI noch „viele mittelgroße Durchbrüche“ benötige. Erkennst du das Muster? Jede Verkündung, dass „AGI erreicht“ sei, geht mit einer stillschweigenden Herabstufung der Definition einher. Die Gründungscharta von OpenAI definiert AGI als „hochautonome Systeme, die den Menschen bei den meisten wirtschaftlich wertvollen Arbeiten übertreffen“. Diese Definition ist deshalb so wichtig, weil der Vertrag zwischen OpenAI und Microsoft eine AGI-Trigger-Klausel enthält: Sobald festgestellt wird, dass AGI erreicht ist, ändern sich die Nutzungsrechte von Microsoft an der Technologie von OpenAI grundlegend. Laut Reuters sieht die neue Vereinbarung vor, dass ein unabhängiges Expertengremium das Erreichen von AGI bestätigen muss, wobei Microsoft 27 % der Anteile behält und bis 2032 bestimmte Nutzungsrechte genießt. Wenn Interessen in Höhe von zig Milliarden Dollar an einem vagen Begriff hängen, ist die Frage „Wer definiert AGI?“ kein akademisches Problem mehr, sondern ein wirtschaftliches Machtspiel. Während die Berichterstattung der Tech-Medien noch verhalten war, zeigten die Reaktionen in den sozialen Medien ein völlig anderes Spektrum. In Reddit-Communities wie r/singularity, r/technology und r/BetterOffline entstanden schnell zahlreiche Diskussionen. Ein Kommentar eines Nutzers auf r/singularity erhielt viel Zustimmung: „AGI is not just an ‘AI system that can do your job’. It’s literally in the name: Artificial GENERAL Intelligence.“ (AGI ist nicht nur ein „KI-System, das deinen Job machen kann“. Es steckt buchstäblich im Namen: Künstliche ALLGEMEINE Intelligenz.) Auf r/technology schrieb ein Entwickler, der nach eigenen Angaben an KI-Agenten zur Automatisierung von Desktop-Aufgaben arbeitet: „We are nowhere near AGI. Current models are great at structured reasoning but still can’t handle the kind of open-ended problem solving a junior dev does instinctively. Jensen is selling GPUs though, so the optimism makes sense.“ (Wir sind noch lange nicht bei AGI. Aktuelle Modelle sind gut in strukturiertem logischem Denken, können aber immer noch keine offenen Probleme lösen, die ein Junior-Entwickler instinktiv bewältigt. Aber Jensen verkauft GPUs, daher macht der Optimismus Sinn.) Auch auf Twitter/X gab es lebhafte Diskussionen. Der Nutzer @DefiQ7 veröffentlichte einen detaillierten Thread, der AGI klar von aktueller „spezialisierter KI“ (wie ChatGPT) abgrenzte. Er bezeichnete die Nachricht als „Atombombe für die Tech-Welt“, betonte aber auch, dass AGI „bereichsübergreifendes, autonomes Lernen, logisches Denken, Planung und Anpassung an unbekannte Szenarien“ bedeute – was weit über die aktuellen Fähigkeiten hinausgeht. Die Diskussionen auf r/BetterOffline waren noch schärfer. Ein Nutzer kommentierte: „Which is higher? The number of times Trump has achieved ‘total victory’ in Iran, or the number of times Jensen Huang has achieved ‘AGI’?“ (Was ist höher? Die Anzahl der Male, die Trump den „totalen Sieg“ im Iran errungen hat, oder die Anzahl der Male, die Jensen Huang „AGI erreicht“ hat?) Ein anderer Nutzer wies auf ein langjähriges Problem der Wissenschaft hin: „This has been a problem with Artificial Intelligence as an academic field since its very inception.“ (Dies ist ein Problem der Künstlichen Intelligenz als akademisches Feld seit ihren Anfängen.) Wie sollen normale Menschen angesichts der sich ständig ändernden AGI-Definitionen der Tech-Giganten beurteilen, wie weit die KI wirklich ist? Hier ist ein praktischer Denkrahmen: Schritt 1: Unterscheide zwischen „Leistungsdemonstration“ und „allgemeiner Intelligenz“. Die aktuellsten KI-Modelle zeigen in vielen spezifischen Aufgaben beeindruckende Leistungen. GPT-5.4 kann flüssige Artikel schreiben, und KI-Agenten können komplexe Workflows automatisieren. Aber zwischen „hervorragender Leistung in einer spezifischen Aufgabe“ und „allgemeiner Intelligenz“ klafft eine riesige Lücke. Eine KI, die den Weltmeister im Schach schlägt, kann vielleicht nicht einmal die Aufgabe bewältigen: „Reich mir mal die Tasse vom Tisch.“ Schritt 2: Achte auf die Einschränkungen, nicht auf die Schlagzeilen. Huang sagte „I think“ (Ich denke), nicht „We have proven“ (Wir haben bewiesen). Altman sagte „spiritual“ (spirituell), nicht „literal“ (wörtlich). Diese Einschränkungen sind keine Bescheidenheit, sondern präzise Rechts- und PR-Strategien. Wenn es um Verträge im Wert von Milliarden geht, wird jedes Wort genau abgewogen. Schritt 3: Schau auf die Taten, nicht auf die Proklamationen. NVIDIA hat auf der GTC 2026 sieben neue Chips vorgestellt, DLSS 5, die OpenClaw-Plattform und den NemoClaw Enterprise Agent Stack eingeführt. Das sind reale technologische Fortschritte. Aber Huang erwähnte in seiner Rede fast 40 Mal „Inferenz“ (Inference), während „Training“ nur etwa 10 Mal vorkam. Dies zeigt, dass sich der Schwerpunkt der Branche von „klügere KI bauen“ hin zu „KI Aufgaben effizienter ausführen lassen“ verschiebt. Das ist technischer Fortschritt, kein Durchbruch in der Intelligenz. Schritt 4: Baue dein eigenes Informationssystem auf. Die Informationsdichte in der KI-Branche ist extrem hoch; jede Woche gibt es wichtige Veröffentlichungen. Wer sich nur auf Clickbait-News verlässt, lässt sich leicht manipulieren. Es empfiehlt sich, regelmäßig Primärquellen zu lesen (offizielle Blogs, wissenschaftliche Arbeiten, Podcast-Transkripte) und Tools zu nutzen, um diese Informationen systematisch zu speichern. Du kannst zum Beispiel die Board-Funktion von nutzen, um wichtige Quellen zu sichern und die KI jederzeit Fragen dazu beantworten oder Daten abgleichen zu lassen, um nicht von einem einzelnen Narrativ in die Irre geführt zu werden. F: Ist die AGI, von der Jensen Huang spricht, dieselbe wie die von OpenAI definierte AGI? A: Nein. Huang antwortete basierend auf der von Lex Fridman vorgeschlagenen engen Definition (KI kann ein 1-Milliarde-Dollar-Unternehmen gründen). Die AGI in der OpenAI-Charta wird als „hochautonomes System, das den Menschen bei den meisten wirtschaftlich wertvollen Arbeiten übertreffen kann“ definiert. Die Standards klaffen weit auseinander; letztere erfordert Fähigkeiten, die weit über erstere hinausgehen. F: Kann eine aktuelle KI wirklich unabhängig ein Unternehmen führen? A: Derzeit nicht. Huang gab selbst zu, dass ein KI-Agent vielleicht eine kurzzeitig erfolgreiche App erstellen kann, aber „die Wahrscheinlichkeit, ein NVIDIA aufzubauen, bei null liegt“. Aktuelle KI ist gut in strukturierten Aufgaben, ist aber in Szenarien, die langfristiges strategisches Urteilsvermögen, bereichsübergreifende Koordination und den Umgang mit unbekannten Situationen erfordern, immer noch stark auf menschliche Anleitung angewiesen. F: Welche Auswirkungen hat das Erreichen von AGI auf die Arbeit normaler Menschen? A: Selbst nach der optimistischsten Definition zeigt sich der Einfluss der aktuellen KI vor allem in der Effizienzsteigerung spezifischer Aufgaben und nicht im vollständigen Ersatz menschlicher Arbeit. Sam Altman gab Ende 2025 zu, dass AGI „einen viel geringeren Einfluss auf die Gesellschaft hat als erwartet“. Kurzfristig wird KI eher als mächtiges Hilfsmittel die Arbeitsweise verändern, anstatt Arbeitsplätze direkt zu ersetzen. F: Warum beeilen sich die CEOs von Tech-Unternehmen so sehr, AGI für erreicht zu erklären? A: Die Gründe sind vielfältig. NVIDIAs Kerngeschäft ist der Verkauf von KI-Chips; das AGI-Narrativ hält die Begeisterung des Marktes für Investitionen in KI-Infrastruktur aufrecht. Bei OpenAI beeinflusst die AGI-Definition direkt die Verteilung von Milliardenbeträgen im Vertrag mit Microsoft. Zudem ist das Narrativ „AGI steht kurz bevor“ eine wichtige Säule für die hohen Bewertungen von KI-Unternehmen am Kapitalmarkt. F: Wie weit ist die KI-Entwicklung in China von AGI entfernt? A: China hat erhebliche Fortschritte gemacht. Bis Juni 2025 erreichte die Zahl der Nutzer von generativer KI in China 515 Millionen. Modelle wie DeepSeek oder Tongyi Qianwen schneiden in vielen Tests hervorragend ab. AGI bleibt jedoch eine globale technologische Herausforderung, und derzeit gibt es weltweit kein System, das von der Fachwelt allgemein als AGI anerkannt wird. Jensen Huangs Aussage „AGI ist erreicht“ ist im Kern eine optimistische Äußerung auf Basis einer extrem engen Definition und kein verifizierter technologischer Meilenstein. Er räumte selbst ein, dass KI-Agenten noch Lichtjahre davon entfernt sind, wirklich komplexe Unternehmen aufzubauen. Das Phänomen der sich ständig verschiebenden AGI-Definitionen offenbart das subtile Spiel der Tech-Branche zwischen technologischem Narrativ und wirtschaftlichen Interessen. Von OpenAI bis NVIDIA geht jede Verkündung mit einer heimlichen Senkung der Standards einher. Als Informationskonsumenten sollten wir nicht Schlagzeilen hinterherjagen, sondern einen eigenen Urteilsrahmen entwickeln. Die KI-Technologie macht zweifellos rasante Fortschritte. Die auf der GTC 2026 vorgestellten neuen Chips, Agent-Plattformen und Inferenz-Optimierungen sind reale technische Durchbrüche. Aber diese Fortschritte als „erreichte AGI“ zu verpacken, ist eher eine Marketingstrategie als eine wissenschaftliche Schlussfolgerung. Neugierig bleiben, kritisch hinterfragen und Primärquellen verfolgen – das ist die beste Strategie, um im Zeitalter der KI-Beschleunigung nicht in der Informationsflut unterzugehen. Möchtest du die Dynamik der KI-Branche systematisch verfolgen? Probiere aus, speichere wichtige Quellen in deiner persönlichen Wissensdatenbank und lass dir von der KI beim Organisieren, Fragenstellen und Cross-Checken helfen. [1] [2] [3] [4] [5] [6]

Der Aufstieg von AI-Influencern: Trends und Chancen, die Creator kennen müssen

TL; DR – Die wichtigsten Punkte Am 21. März 2026 postete Elon Musk auf X einen Tweet mit nur acht Wörtern: „AI bots will be more human than human.“ Dieser Tweet erhielt innerhalb von 72 Stunden über 62 Millionen Aufrufe und 580.000 Likes. Er schrieb diesen Satz als Reaktion auf ein AI-generiertes Bild eines „perfekten Influencer-Gesichts“. Dies ist keine Science-Fiction-Vorhersage. Wenn du Content Creator, Blogger oder Social-Media-Manager bist, hast du wahrscheinlich schon diese „zu perfekten“ Gesichter in deinem Feed gesehen und konntest nicht unterscheiden, ob es sich um echte Menschen oder AI handelt. Dieser Artikel zeigt dir den aktuellen Stand der virtuellen AI-Influencer, die Einkommensdaten der Top-Cases und wie du als menschlicher Creator auf diesen Wandel reagieren solltest. Dieser Artikel richtet sich an Content Creator, Social-Media-Manager, Marken-Marketer und alle Leser, die sich für AI-Trends interessieren. Schauen wir uns zunächst einige Zahlen an, die aufhorchen lassen. Der globale Markt für virtuelle Influencer erreichte im Jahr 2024 ein Volumen von 60,6 Milliarden USD und soll bis 2025 auf 83 Milliarden USD anwachsen, was einer jährlichen Wachstumsrate von über 37 % entspricht. Laut Straits Research wird diese Zahl bis 2033 auf 111,78 Milliarden USD in die Höhe schnellen. Gleichzeitig hat die gesamte Influencer-Marketing-Branche im Jahr 2025 bereits 32,55 Milliarden USD erreicht und wird 2026 voraussichtlich die 40-Milliarden-Marke überschreiten. Betrachtet man einzelne Akteure, sind zwei Fälle besonders repräsentativ: Lil Miquela gilt als die „AI-Influencerin der ersten Generation“. Dieser 2016 erschaffene virtuelle Charakter hat über 2,4 Millionen Follower auf Instagram und arbeitet mit Marken wie Prada, Calvin Klein und Samsung zusammen. Ihr Team (Teil von Dapper Labs) verlangt zehntausende Dollar pro Marken-Post. Allein die Abonnementeinnahmen auf der Plattform Fanvue belaufen sich auf 40.000 USD pro Monat. Zusammen mit Marken-Kooperationen kann ihr monatliches Einkommen 100.000 USD übersteigen. Schätzungen zufolge liegt ihr durchschnittliches Jahreseinkommen seit 2016 bei etwa 2 Millionen USD. Aitana López steht für die Möglichkeit, dass auch „Einzelunternehmer AI-Influencer erstellen können“. Das von der spanischen Kreativagentur The Clueless geschaffene virtuelle Model mit rosa Haaren hat über 370.000 Follower auf Instagram und verdient zwischen 3.000 und 10.000 EUR pro Monat. Der Grund für ihre Erschaffung war pragmatisch: Gründer Rubén Cruz war genervt von den unkalkulierbaren Faktoren menschlicher Models (Verspätungen, Absagen, Terminkonflikte) und entschied sich, „einen Influencer zu erschaffen, der niemals absagt“. Die Prognose des PR-Riesen Ogilvy für 2024 erschütterte die Branche: Bis 2026 werden virtuelle AI-Influencer 30 % der Budgets für Influencer-Marketing einnehmen. Eine Umfrage unter 1.000 leitenden Marketern in den USA und Großbritannien ergab, dass 79 % der Befragten ihre Investitionen in AI-generierte Content Creator erhöhen. Um die Dynamik dieses Wandels zu verstehen, muss man die Logik der Marken nachvollziehen. Null Risiko, volle Kontrolle. Das größte Risiko bei menschlichen Influencern ist der „Image-Schaden“. Eine unbedachte Äußerung oder ein Skandal im Privatleben kann Millioneninvestitionen einer Marke zunichtemachen. Bei virtuellen Influencern gibt es dieses Problem nicht. Sie werden nicht müde, sie altern nicht und sie posten nicht um drei Uhr morgens etwas, das das PR-Team verzweifeln lässt. Wie Rubén Cruz von The Clueless sagt: „Viele Projekte wurden wegen Problemen mit dem Influencer selbst auf Eis gelegt oder abgesagt. Das war kein Designfehler, sondern die Unberechenbarkeit des Menschen.“ Content-Produktion rund um die Uhr. Virtuelle Influencer können täglich posten, Trends in Echtzeit aufgreifen und in jedem beliebigen Szenario „erscheinen“ – und das zu Kosten, die weit unter denen eines echten Shootings liegen. Laut Berechnungen von BeyondGames könnte Lil Miquela, wenn sie täglich einen Post auf Instagram veröffentlicht, im Jahr 2026 potenzielle Einnahmen von 4,7 Millionen GBP erzielen. Diese Produktionseffizienz ist für keinen menschlichen Creator erreichbar. Präzise Markenkonsistenz. Die Zusammenarbeit von Prada mit Lil Miquela führte zu einer um 30 % höheren Interaktionsrate als bei herkömmlichen Marketingkampagnen. Jeder Gesichtsausdruck, jedes Outfit und jeder Text eines virtuellen Influencers kann präzise entworfen werden, um perfekt zur Markenidentität zu passen. Doch jede Medaille hat zwei Seiten. Ein Bericht von Business Insider vom März 2026 weist darauf hin, dass die Ablehnung von AI-Accounts bei Konsumenten steigt und einige Marken sich bereits von AI-Influencer-Strategien zurückziehen. Eine YouGov-Umfrage zeigt, dass mehr als ein Drittel der Befragten besorgt über AI-Technologie ist. Das bedeutet, dass virtuelle Influencer kein Allheilmittel sind; Authentizität bleibt ein wichtiger Faktor für Konsumenten. Angesichts des Drucks durch virtuelle AI-Influencer ist Panik sinnlos – Handeln ist gefragt. Hier sind vier bewährte Strategien: Strategie 1: Fokus auf echte Erfahrungen – Dinge tun, die AI nicht kann. AI kann perfekte Gesichter generieren, aber sie kann nicht wirklich einen Kaffee genießen oder die Erschöpfung und Zufriedenheit nach einer Wanderung spüren. In einer Diskussion auf Reddit im Subreddit r/Futurology erhielt der Kommentar eines Nutzers viel Zustimmung: „AI-Influencer können Produkte verkaufen, aber Menschen sehnen sich immer noch nach echter Verbindung.“ Mache deine realen Lebenserfahrungen, deine einzigartige Perspektive und deine unvollkommenen Momente zu deinem Content-Schutzwall. Strategie 2: Sich mit AI-Tools rüsten, statt sie zu bekämpfen. Kluge Creator nutzen bereits AI, um ihre Effizienz zu steigern. Auf Reddit teilen Creator komplette Workflows: ChatGPT für Skripte, ElevenLabs für Voiceovers und HeyGen für die Videoproduktion. Du musst kein AI-Influencer werden, aber du solltest AI zu deinem kreativen Assistenten machen. Strategie 3: Branchentrends systematisch verfolgen und Informationsvorsprung aufbauen. Die Veränderungen im Bereich der AI-Influencer sind rasant; jede Woche gibt es neue Tools, Cases und Daten. Sporadisch auf Twitter oder Reddit zu surfen, reicht bei weitem nicht aus. Mit kannst du Brancheninformationen aus verschiedenen Quellen systematisch verwalten: Speichere wichtige Artikel, Tweets und Forschungsberichte in einem Board, lass sie von der AI automatisch organisieren und durchsuchen. Du kannst deiner Materialbibliothek jederzeit Fragen stellen, wie zum Beispiel: „Was waren die drei größten Finanzierungen im Bereich der virtuellen Influencer im Jahr 2026?“. Wenn du eine Branchenanalyse schreiben oder ein Video drehen willst, ist dein Material bereits bereit, anstatt dass du bei Null anfangen musst. Strategie 4: Mensch-Maschine-Kollaboration im Content erkunden. Die Zukunft ist kein Nullsummenspiel „Mensch vs. AI“, sondern eine Symbiose aus „Mensch + AI“. Du kannst AI nutzen, um visuelles Material zu erstellen, ihm aber mit deiner menschlichen Stimme und deinen Ansichten eine Seele verleihen. Eine Analyse von zeigt, dass AI-Influencer gut für experimentelle, grenzüberschreitende Konzepte geeignet sind, während menschliche Influencer beim Aufbau tiefer Bindungen zum Publikum und bei der Festigung von Markenwerten unersetzlich bleiben. Die größte Herausforderung beim Verfolgen von AI-Influencer-Trends ist nicht zu wenig Information, sondern zu viel und zu verstreute Information. Ein typisches Szenario: Du siehst einen Tweet von Musk auf X, liest auf Reddit einen Post über das Einkommen einer AI-Influencerin, entdeckst auf Business Insider einen Tiefenbericht über den Rückzug von Marken und siehst auf YouTube ein Tutorial. Diese Informationen sind über vier Plattformen und fünf Browser-Tabs verteilt. Wenn du drei Tage später einen Artikel schreiben willst, findest du die entscheidende Zahl nicht mehr. Genau dieses Problem löst . Mit der kannst du jede Webseite, jeden Tweet oder jedes YouTube-Video mit einem Klick in dein persönliches Board speichern. Die AI extrahiert automatisch die wichtigsten Informationen und erstellt einen Index. Du kannst jederzeit mit natürlicher Sprache suchen und Fragen stellen. Erstelle zum Beispiel ein Board „AI-Influencer-Forschung“ und verwalte alle relevanten Materialien zentral. Wenn du Content produzieren musst, frage das Board direkt: „Was ist das Geschäftsmodell von Aitana López?“ oder „Welche Marken ziehen sich bereits von AI-Influencer-Strategien zurück?“. Die Antworten werden mit Links zu den Originalquellen präsentiert. Es ist wichtig zu erwähnen, dass die Stärke von YouMind in der Informationsintegration und Forschungsunterstützung liegt; es ist kein Tool zur Erstellung von AI-Influencern. Wenn du virtuelle Charaktere erstellen möchtest, benötigst du weiterhin spezialisierte Tools wie Midjourney, Stable Diffusion oder HeyGen. Aber in der Kernarbeitskette eines Creators – „Trends erforschen → Material sammeln → Content produzieren“ – kann den Weg von der Inspiration zum fertigen Produkt erheblich verkürzen. F: Werden virtuelle AI-Influencer menschliche Influencer komplett ersetzen? A: Kurzfristig nicht. Virtuelle Influencer haben Vorteile bei der Markenkontrolle und Produktionseffizienz, aber das Bedürfnis der Konsumenten nach Authentizität ist weiterhin stark. Berichte von Business Insider aus dem Jahr 2026 zeigen, dass einige Marken ihre Investitionen in AI-Influencer aufgrund von Ablehnung durch die Konsumenten bereits reduzieren. Beide werden sich wahrscheinlich eher ergänzen als gegenseitig ersetzen. F: Können normale Menschen ihre eigenen virtuellen AI-Influencer erstellen? A: Ja. Auf Reddit teilen viele Creator ihre Erfahrungen beim Start von Null. Zu den gängigen Tools gehören Midjourney oder Stable Diffusion für ein konsistentes Erscheinungsbild, ChatGPT für Texte und ElevenLabs für die Sprachgenerierung. Die Anfangsinvestition kann gering sein, erfordert aber 3 bis 6 Monate kontinuierliche Arbeit, um signifikantes Wachstum zu sehen. F: Welche Einnahmequellen haben virtuelle AI-Influencer? A: Es gibt hauptsächlich drei Kategorien: gesponserte Marken-Posts (Top-Influencer verlangen tausende bis zehntausende Dollar pro Post), Einnahmen von Abo-Plattformen (wie Fanvue) sowie Merchandising und Musikrechte. Lil Miquela verdient allein mit Abonnements durchschnittlich 40.000 USD pro Monat, die Einnahmen aus Marken-Kooperationen liegen noch höher. F: Wie ist der Stand des Marktes für virtuelle AI-Idole in China? A: China ist einer der weltweit aktivsten Märkte für virtuelle Idole. Branchenprognosen zufolge wird der chinesische Markt für virtuelle Influencer bis 2030 ein Volumen von 270 Milliarden RMB erreichen. Von Hatsune Miku und Luo Tianyi bis hin zu hyperrealistischen virtuellen Idolen hat der chinesische Markt bereits mehrere Entwicklungsphasen durchlaufen und entwickelt sich derzeit in Richtung AI-gesteuerter Echtzeit-Interaktion. F: Worauf sollten Marken bei der Zusammenarbeit mit virtuellen Influencern achten? A: Drei Punkte sind entscheidend: die Akzeptanz der Zielgruppe für virtuelle Charaktere, die Richtlinien der Plattformen zur Offenlegung von AI-Inhalten (TikTok und Instagram verschärfen hier die Anforderungen) und die Übereinstimmung des virtuellen Influencers mit der Markenidentität. Es empfiehlt sich, zunächst mit kleinen Budgets zu testen und die Investitionen basierend auf den Daten anzupassen. Der Aufstieg virtueller AI-Influencer ist keine ferne Vorhersage, sondern eine Realität, die gerade stattfindet. Marktdaten zeigen deutlich, dass der kommerzielle Wert virtueller Influencer bereits bewiesen ist – von den 2 Millionen USD Jahreseinkommen einer Lil Miquela bis zu den 10.000 EUR monatlich einer Aitana López sind diese Zahlen nicht zu ignorieren. Für menschliche Creator ist dies jedoch keine Geschichte des „Ersetztwerdens“, sondern eine Chance zur „Neupositionierung“. Deine echten Erfahrungen, deine einzigartige Perspektive und die emotionale Verbindung zu deinem Publikum sind Kernwerte, die eine AI nicht kopieren kann. Der Schlüssel liegt darin: Nutze AI-Tools zur Effizienzsteigerung, verfolge Trends mit systematischen Methoden und baue mit Authentizität eine unersetzliche Wettbewerbsbarriere auf. Möchtest du AI-Influencer-Trends systematisch verfolgen und Material für deine Kreationen sammeln? Probiere aus, um deinen persönlichen Forschungsraum aufzubauen – starte kostenlos. [1] [2] [3] [4] [5] [6] [7] [8] [9] [10] [11]