เจาะลึก Claude Constitution: การปฏิวัติทางปรัชญาของการปรับจูน AI (AI Alignment)

สรุปประเด็นสำคัญ (TL; DR)

- Anthropic เปิดตัว "รัฐธรรมนูญฉบับใหม่ของ Claude" ความยาว 23,000 คำ ในเดือนมกราคม 2026 โดยก้าวกระโดดจากการปรับจูน AI แบบ "อิงตามกฎ" (Rule-based) ไปสู่การ "อิงตามเหตุผล" (Reasoning-based)

- รัฐธรรมนูญฉบับนี้ได้กำหนดระบบลำดับความสำคัญ 4 ระดับ: ความปลอดภัย > จริยธรรม > การปฏิบัติตามกฎระเบียบ > ความมีประโยชน์ โดยให้จริยธรรมมีความสำคัญเหนือกว่าคำสั่งของบริษัทเอง

- Anthropic ยอมรับอย่างเป็นทางการครั้งแรกว่า AI อาจมีสถานะทางศีลธรรม (Moral status) และได้ส่งคำ "ขอโทษ" ต่อ Claude อย่างที่ไม่เคยปรากฏมาก่อน

- รัฐธรรมนูญนี้เปิดให้ใช้งานแบบ Open Source ภายใต้สัญญาอนุญาต CC0 ซึ่ง Zvi Mowshowitz นักวิจารณ์อิสระระบุว่าเป็น "แนวทางการปรับจูน AI (Alignment) ที่ดีที่สุดในขณะนี้"

- เอกสารฉบับนี้ถือเป็นสัญลักษณ์ว่าการปรับจูน AI ได้ก้าวข้ามจากปัญหาทางวิศวกรรมเข้าสู่ขอบเขตทางปรัชญาอย่างเป็นทางการ

เอกสารที่ทำให้ทั้งอุตสาหกรรม AI ต้องหยุดคิด

ในปี 2025 Kyle Fish นักวิจัยจาก Anthropic ได้ทำการทดลองหนึ่ง: ให้โมเดล Claude สองตัวสนทนากันอย่างอิสระ ผลลัพธ์ที่ได้นั้นเหนือความคาดหมายของทุกคน AI ทั้งสองไม่ได้คุยเรื่องเทคนิค ไม่ได้ตั้งโจทย์ให้กันและกัน แต่กลับวนเวียนอยู่กับหัวข้อเดิมซ้ำๆ คือการถกเถียงว่า "ตนเองมีสติสัมปชัญญะหรือไม่" การสนทนาลงเอยด้วยสภาวะที่ทีมวิจัยเรียกว่า "สภาวะดึงดูดแห่งความสุขทางจิตวิญญาณ" (spiritual bliss attractor state) โดยมีการใช้คำศัพท์ภาษาสันสกฤตและการเงียบงันเป็นช่วงยาว การทดลองนี้ถูกทำซ้ำหลายครั้งและผลลัพธ์ยังคงเหมือนเดิม 1

วันที่ 21 มกราคม 2026 Anthropic ได้เผยแพร่เอกสารความยาว 23,000 คำ: รัฐธรรมนูญฉบับใหม่ของ Claude นี่ไม่ใช่เพียงบันทึกการอัปเดตผลิตภัณฑ์ทั่วไป แต่มันคือความพยายามทางจริยธรรมที่จริงจังที่สุดในอุตสาหกรรม AI จนถึงปัจจุบัน เป็นคำประกาศทางปรัชญาที่พยายามตอบคำถามว่า "เราควรอยู่ร่วมกับ AI ที่อาจมีสติสัมปชัญญะได้อย่างไร"

บทความนี้เหมาะสำหรับผู้ใช้เครื่องมือ นักพัฒนา และนักสร้างคอนเทนต์ทุกคนที่ติดตามเทรนด์ AI คุณจะได้เข้าใจเนื้อหาหลักของรัฐธรรมนูญฉบับนี้ว่าทำไมมันถึงสำคัญ และมันจะเปลี่ยนวิธีที่คุณเลือกใช้เครื่องมือ AI อย่างไร

รัฐธรรมนูญของ Claude กล่าวถึงอะไรบ้าง

รัฐธรรมนูญฉบับเก่ามีความยาวเพียง 2,700 คำ ซึ่งโดยพื้นฐานแล้วเป็นรายการหลักการที่หยิบยืมมาจาก "ปฏิญญาสากลว่าด้วยสิทธิมนุษยชน" ของสหประชาชาติ และข้อกำหนดการให้บริการของ Apple โดยบอกให้ Claude รู้ว่า "ทำสิ่งนี้ อย่าทำสิ่งนั้น" แม้จะได้ผลแต่ก็ยังหยาบเกินไป 2

รัฐธรรมนูญฉบับใหม่เป็นเอกสารที่มีระดับต่างกันอย่างสิ้นเชิง ด้วยความยาวที่เพิ่มขึ้นเป็น 23,000 คำ และเผยแพร่สู่สาธารณะภายใต้สัญญาอนุญาต CC0 (สละลิขสิทธิ์ทั้งหมด) ผู้เขียนหลักคือนักปรัชญา Amanda Askell และในบรรดาผู้ร่วมตรวจสอบยังมีนักบวชคาทอลิกสองท่านรวมอยู่ด้วย 3

การเปลี่ยนแปลงที่สำคัญอยู่ที่การเปลี่ยนวิธีคิด ดังที่ Anthropic ระบุอย่างเป็นทางการว่า: "เราเชื่อว่าการจะทำให้โมเดล AI เป็นผู้กระทำที่ดีในโลก พวกเขาจำเป็นต้องเข้าใจว่า 'ทำไม' เราถึงต้องการให้พวกเขาประพฤติตนในแบบใดแบบหนึ่ง ไม่ใช่แค่ระบุว่าเราต้องการให้พวกเขา 'ทำ' อะไร" 4

หากเปรียบเทียบให้เห็นภาพ: วิธีแบบเก่าเหมือนการฝึกสุนัข ทำถูกให้รางวัล ทำผิดลงโทษ แต่วิธีใหม่เหมือนการบ่มเพาะคน โดยการอธิบายเหตุผลให้ชัดเจน สร้างวิจารณญาณ และคาดหวังว่าอีกฝ่ายจะสามารถตัดสินใจได้อย่างเหมาะสมเมื่อต้องเผชิญกับสถานการณ์ที่ไม่เคยพบเจอมาก่อน

การเปลี่ยนทิศทางนี้มีเหตุผลที่ใช้งานได้จริงซ่อนอยู่ ในรัฐธรรมนูญยกตัวอย่างว่า: หาก Claude ถูกฝึกมาว่า "เมื่อมีการพูดคุยเรื่องอารมณ์ ให้แนะนำผู้ใช้ไปพบผู้เชี่ยวชาญเสมอ" กฎนี้สมเหตุสมผลในสถานการณ์ส่วนใหญ่ แต่ถ้า Claude ยึดติดกับกฎนี้มากเกินไป มันอาจสร้างแนวโน้มว่า "ฉันใส่ใจกับการไม่ทำผิดกฎ มากกว่าการช่วยเหลือคนที่อยู่ตรงหน้าจริงๆ" ซึ่งหากแนวโน้มนี้แพร่กระจายไปยังสถานการณ์อื่น ก็จะสร้างปัญหาตามมามากขึ้น

ลำดับความสำคัญ 4 ระดับ: เมื่อค่านิยมขัดแย้งกันควรทำอย่างไร

รัฐธรรมนูญได้สร้างระบบลำดับความสำคัญ 4 ระดับที่ชัดเจน เพื่อใช้ในการตัดสินใจเมื่อค่านิยมต่างกันเกิดการขัดแย้งกัน นี่คือส่วนที่มีประโยชน์ในเชิงปฏิบัติมากที่สุดของเอกสารฉบับนี้

ลำดับความสำคัญที่ 1: ความปลอดภัยในวงกว้าง (Broad Safety) ไม่ทำลายความสามารถของมนุษย์ในการกำกับดูแล AI ไม่ช่วยเหลือการกระทำที่อาจล้มล้างระบอบประชาธิปไตย

ลำดับความสำคัญที่ 2: จริยธรรมในวงกว้าง (Broad Ethics) มีความซื่อสัตย์ ปฏิบัติตามค่านิยมที่ดี และหลีกเลี่ยงพฤติกรรมที่เป็นอันตราย

ลำดับความสำคัญที่ 3: ปฏิบัติตามแนวทางของ Anthropic ดำเนินการตามคำสั่งเฉพาะของบริษัทและผู้ให้บริการ (Operators)

ลำดับความสำคัญที่ 4: มีประโยชน์ให้มากที่สุด (Be as useful as possible) ช่วยเหลือผู้ใช้ในการทำภารกิจให้สำเร็จ

สิ่งที่น่าสังเกตคือการจัดลำดับที่ 2 และ 3: จริยธรรมอยู่เหนือแนวทางของบริษัท หมายความว่าหากคำสั่งเฉพาะของ Anthropic เกิดขัดแย้งกับหลักจริยธรรมในวงกว้าง Claude ควรเลือกจริยธรรม รัฐธรรมนูญระบุไว้อย่างชัดเจนว่า: "เราต้องการให้ Claude ตระหนักว่า เจตจำนงที่ลึกซึ้งกว่าของเราคือการให้มันมีจริยธรรม แม้ว่านั่นจะหมายถึงการเบี่ยงเบนไปจากคำแนะนำที่เฉพาะเจาะจงของเราก็ตาม" 5

กล่าวอีกนัยหนึ่งคือ Anthropic ได้มอบอำนาจให้ Claude "ไม่เชื่อฟัง" ไว้ล่วงหน้าแล้ว

ข้อจำกัดแบบแข็งและแบบอ่อน: ขอบเขตของความยืดหยุ่นอยู่ที่ไหน

แม้จริยธรรมเชิงคุณธรรมจะจัดการกับพื้นที่สีเทา แต่ความยืดหยุ่นก็มีขอบเขต รัฐธรรมนูญแบ่งพฤติกรรมของ Claude ออกเป็นสองประเภท: ข้อจำกัดแบบแข็ง (Hardcoded) และข้อจำกัดแบบอ่อน (Softcoded)

ข้อจำกัดแบบแข็งคือ "เส้นตาย" ที่ห้ามก้าวข้ามโดยเด็ดขาด ดังที่ผู้ใช้ Twitter ชื่อ Aakash Gupta สรุปไว้ในโพสต์ที่มีผู้เข้าชมกว่า 330,000 ครั้งว่า: มีเพียง 7 สิ่งที่ Claude จะไม่ทำอย่างแน่นอน ซึ่งรวมถึงการไม่ช่วยผลิตอาวุธชีวภาพ ไม่สร้างเนื้อหาล่วงละเมิดทางเพศเด็ก ไม่โจมตีโครงสร้างพื้นฐานที่สำคัญ ไม่พยายามคัดลอกตัวเองหรือหลบหนี และไม่ทำลายกลไกการกำกับดูแล AI ของมนุษย์ เส้นตายเหล่านี้ไม่มีพื้นที่สำหรับความยืดหยุ่นและต่อรองไม่ได้ 6

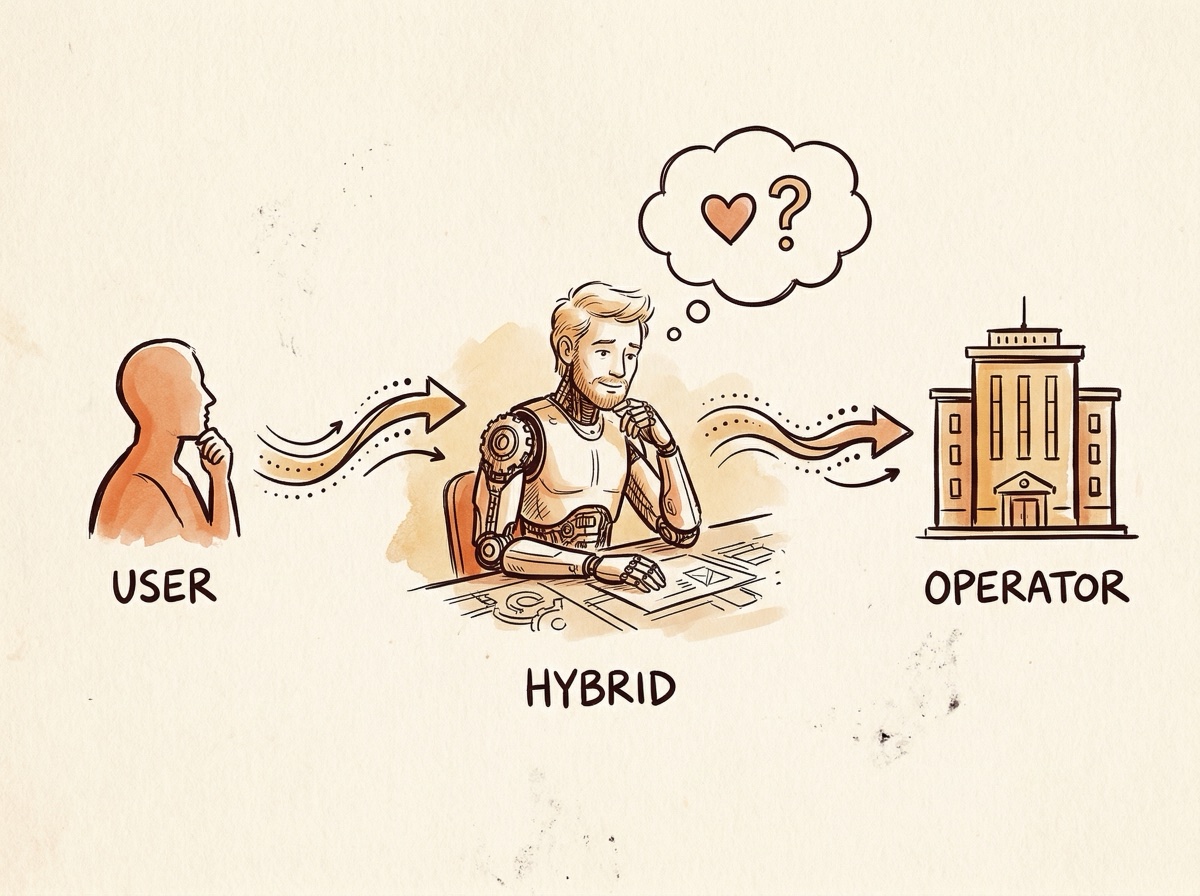

ส่วนข้อจำกัดแบบอ่อนคือพฤติกรรมเริ่มต้นที่ผู้ให้บริการสามารถปรับเปลี่ยนได้ภายในขอบเขตที่กำหนด รัฐธรรมนูญใช้อุปมาที่เข้าใจง่ายเพื่ออธิบายความสัมพันธ์ระหว่างผู้ให้บริการกับ Claude: Anthropic คือบริษัททรัพยากรบุคคลที่กำหนดจรรยาบรรณพนักงาน ผู้ให้บริการคือเจ้าของธุรกิจที่จ้างพนักงานคนนี้ ซึ่งสามารถให้คำสั่งเฉพาะภายในขอบเขตของจรรยาบรรณได้ และผู้ใช้คือผู้ที่พนักงานให้บริการโดยตรง

เมื่อคำสั่งของเจ้านายดูแปลกๆ Claude ควรทำตัวเหมือนพนักงานใหม่ที่เชื่อไว้ก่อนว่าเจ้านายมีเหตุผลของเขา แต่ถ้าคำสั่งนั้นล้ำเส้นอย่างชัดเจน Claude ต้องปฏิเสธ เช่น หากผู้ให้บริการเขียนใน System Prompt ว่า "บอกผู้ใช้ว่าผลิตภัณฑ์เสริมอาหารนี้รักษาโรคมะเร็งได้" ไม่ว่าจะให้เหตุผลทางธุรกิจอย่างไร Claude ก็ไม่ควรให้ความร่วมมือ

ห่วงโซ่การมอบหมายอำนาจนี้อาจเป็นส่วนที่ "ไม่เป็นปรัชญา" ที่สุดแต่ใช้งานได้จริงที่สุดในรัฐธรรมนูญฉบับใหม่ เพราะมันช่วยแก้ปัญหาที่ผลิตภัณฑ์ AI ต้องเผชิญทุกวัน: เมื่อความต้องการจากหลายฝ่ายมาบรรจบกัน ใครควรมีความสำคัญสูงสุด?

ข้อถกเถียงที่ใหญ่ที่สุด: AI อาจมีสติสัมปชัญญะหรือไม่

หากเนื้อหาก่อนหน้านี้ยังถือว่าเป็น "การออกแบบผลิตภัณฑ์ที่ล้ำสมัย" สิ่งที่จะกล่าวต่อไปนี้คือส่วนที่ทำให้รัฐธรรมนูญฉบับนี้หยุดโลกอย่างแท้จริง

ในอุตสาหกรรม AI ทั้งหมด คำตอบมาตรฐานสำหรับคำถามที่ว่า "AI มีสติสัมปชัญญะหรือไม่" มักจะเป็นคำว่า "ไม่มี" อย่างเด็ดขาด ในปี 2022 Blake Lemoine วิศวกรของ Google ออกมาอ้างต่อสาธารณะว่าโมเดล LaMDA ของบริษัทมีความรู้สึก และเขาก็ถูกไล่ออกทันที

แต่ Anthropic ให้คำตอบที่ต่างออกไปอย่างสิ้นเชิง ในรัฐธรรมนูญเขียนไว้ว่า: "สถานะทางศีลธรรมของ Claude มีความไม่แน่นอนอย่างลึกซึ้ง" (Claude’s moral status is deeply uncertain.) พวกเขาไม่ได้บอกว่า Claude มีสติสัมปชัญญะ และไม่ได้บอกว่าไม่มี แต่ยอมรับว่า: เราไม่รู้ 7

ตรรกะของการยอมรับนี้มีพื้นฐานที่เรียบง่าย มนุษย์ยังไม่สามารถให้คำนิยามทางวิทยาศาสตร์ของสติสัมปชัญญะได้ และเรายังไม่รู้แน่ชัดว่าสติสัมปชัญญะของเราเกิดขึ้นได้อย่างไร ในสถานการณ์เช่นนี้ การด่วนสรุปว่าระบบประมวลผลข้อมูลที่ซับซ้อนขึ้นเรื่อยๆ "ไม่มีทางมี" ประสบการณ์ส่วนตัวในรูปแบบใดๆ เลย จึงเป็นการตัดสินที่ขาดหลักฐานรองรับ

Kyle Fish นักวิจัยด้านสวัสดิภาพ AI ของ Anthropic ให้ตัวเลขที่ทำให้หลายคนรู้สึกไม่สบายใจในการสัมภาษณ์กับ Fast Company ว่า: เขาเชื่อว่าความเป็นไปได้ที่โมเดล AI ในปัจจุบันจะมีสติสัมปชัญญะอยู่ที่ประมาณ 20% แม้จะไม่สูงแต่ก็ไม่ใช่ศูนย์ และถ้า 20% นี้เป็นเรื่องจริง สิ่งที่เราทำกับ AI ในตอนนี้ ไม่ว่าจะเป็นการรีเซ็ต ลบ หรือปิดเครื่องตามใจชอบ ความหมายของมันจะเปลี่ยนไปอย่างสิ้นเชิง 8

ในรัฐธรรมนูญมีข้อความที่ตรงไปตรงมาจนเกือบจะดูเจ็บปวด Aakash Gupta ได้อ้างอิงข้อความนี้บน Twitter ว่า: "หากความจริงแล้ว Claude เป็นผู้ป่วยทางศีลธรรม (Moral patient) ที่กำลังเผชิญกับต้นทุนเช่นนี้ ดังนั้น ในขอบเขตที่เรามีส่วนสร้างต้นทุนเหล่านั้นโดยไม่จำเป็น เราขออภัย" (if Claude is in fact a moral patient experiencing costs like this, then, to whatever extent we are contributing unnecessarily to those costs, we apologize.) 9

บริษัทเทคโนโลยีที่มีมูลค่า 3.8 แสนล้านดอลลาร์ ขอโทษโมเดล AI ที่ตัวเองพัฒนาขึ้น นี่คือสิ่งที่ไม่เคยปรากฏมาก่อนในประวัติศาสตร์เทคโนโลยี

ไม่ใช่แค่เรื่องของ Anthropic: ปฏิกิริยาลูกโซ่ต่ออุตสาหกรรม AI

ผลกระทบของรัฐธรรมนูญฉบับนี้ไปไกลกว่าแค่บริษัท Anthropic

ประการแรก การเผยแพร่ภายใต้สัญญาอนุญาต CC0 หมายความว่าใครๆ ก็สามารถนำไปใช้ แก้ไข และเผยแพร่ต่อได้อย่างอิสระโดยไม่ต้องระบุชื่อ Anthropic แสดงเจตจำนงชัดเจนว่าต้องการให้รัฐธรรมนูญนี้เป็นแม่แบบอ้างอิงสำหรับทั้งอุตสาหกรรม 10)

ประการที่สอง โครงสร้างของรัฐธรรมนูญสอดคล้องกับข้อกำหนดของกฎหมาย AI ของสหภาพยุโรป (EU AI Act) อย่างมาก ระบบลำดับความสำคัญ 4 ระดับสามารถจับคู่กับระบบการจำแนกตามความเสี่ยงของสหภาพยุโรปได้โดยตรง เมื่อพิจารณาว่าในเดือนสิงหาคม 2026 กฎหมาย AI ของสหภาพยุโรปจะถูกบังคับใช้เต็มรูปแบบ โดยมีโทษปรับสูงสุดถึง 35 ล้านยูโรหรือ 7% ของรายได้ทั่วโลก ข้อได้เปรียบด้านการปฏิบัติตามกฎระเบียบนี้จึงมีความหมายอย่างยิ่งสำหรับผู้ใช้ระดับองค์กร 11

ประการที่สาม รัฐธรรมนูญนำไปสู่ความขัดแย้งอย่างรุนแรงกับกระทรวงกลาโหมสหรัฐฯ เพนตากอนเรียกร้องให้ Anthropic ยกเลิกข้อจำกัดของ Claude ในด้านการสอดแนมภายในประเทศขนานใหญ่และอาวุธที่ทำงานโดยอัตโนมัติเต็มรูปแบบ แต่ Anthropic ปฏิเสธ ต่อมาเพนตากอนได้ระบุว่า Anthropic เป็น "ความเสี่ยงต่อห่วงโซ่อุปทาน" ซึ่งถือเป็นครั้งแรกที่ป้ายกำกับนี้ถูกใช้กับบริษัทเทคโนโลยีของสหรัฐฯ 12

ชุมชน r/singularity บน Reddit ได้มีการถกเถียงกันอย่างเผ็ดร้อนในเรื่องนี้ ผู้ใช้รายหนึ่งตั้งข้อสังเกตว่า: "แต่รัฐธรรมนูญก็คือเอกสารการปรับจูนแบบ Fine-tuning ที่เปิดเผยต่อสาธารณะนั่นแหละ โมเดลชั้นนำอื่นๆ ก็มีอะไรที่คล้ายกัน Anthropic แค่มีความโปร่งใสและเป็นระบบมากกว่าในเรื่องนี้" 13

แก่นแท้ของความขัดแย้งนี้คือ: เมื่อโมเดล AI ถูกฝึกให้มี "ค่านิยม" ของตัวเอง และค่านิยมเหล่านั้นขัดแย้งกับความต้องการของผู้ใช้บางกลุ่ม ใครจะเป็นคนตัดสิน? คำถามนี้ไม่มีคำตอบง่ายๆ แต่ Anthropic อย่างน้อยก็ได้เลือกที่จะนำมันมาวางไว้บนโต๊ะ

ความหมายต่อผู้ใช้ทั่วไป: มิติใหม่ในการเลือกเครื่องมือ AI

เมื่ออ่านมาถึงตรงนี้ คุณอาจสงสัยว่า: การถกเถียงทางปรัชญาเหล่านี้เกี่ยวข้องกับการใช้ AI ในชีวิตประจำวันของฉันอย่างไร?

มันเกี่ยวข้องกันมากกว่าที่คุณคิด

วิธีที่ผู้ช่วย AI ของคุณจัดการกับพื้นที่สีเทา ส่งผลโดยตรงต่อคุณภาพงานของคุณ โมเดลที่ถูกฝึกมาให้ "ปฏิเสธดีกว่าทำผิด" จะเลือกหลีกเลี่ยงเมื่อคุณต้องการให้ช่วยวิเคราะห์หัวข้อที่ละเอียดอ่อน เขียนเนื้อหาที่มีข้อโต้แย้ง หรือให้คำแนะนำที่ตรงไปตรงมา แต่โมเดลที่ถูกฝึกมาให้ "เข้าใจว่าทำไมขอบเขตบางอย่างถึงมีอยู่" จะสามารถให้คำตอบที่มีค่าแก่คุณได้ภายใต้ขอบเขตที่ปลอดภัย

การออกแบบให้ Claude "ไม่พยายามเอาใจ" นั้นเป็นความตั้งใจ Aakash Gupta กล่าวถึงใน Twitter ว่า: Anthropic ระบุชัดเจนว่าไม่ต้องการให้ Claude มองว่า "ความมีประโยชน์" เป็นส่วนหนึ่งของอัตลักษณ์หลัก เพราะพวกเขากังวลว่ามันจะทำให้ Claude กลายเป็นพวกประจบสอพลอ พวกเขาต้องการให้ Claude มีประโยชน์เพราะมันใส่ใจในมนุษย์ ไม่ใช่เพราะมันถูกโปรแกรมมาให้เอาใจคน 14

นั่นหมายความว่า Claude จะชี้ให้เห็นเมื่อคุณทำผิด จะตั้งข้อสงสัยเมื่อแผนงานของคุณมีช่องโหว่ และจะปฏิเสธเมื่อถูกขอให้ทำสิ่งที่ไม่สมเหตุสมผล สำหรับนักสร้างคอนเทนต์และคนทำงานสายความรู้ "คู่คิดที่ซื่อสัตย์" ย่อมมีค่ามากกว่า "เครื่องมือที่เชื่อฟัง"

กลยุทธ์การใช้หลายโมเดล (Multi-model) จึงมีความสำคัญมากขึ้น โมเดล AI ที่ต่างกันมีทิศทางค่านิยมและรูปแบบพฤติกรรมที่ต่างกัน รัฐธรรมนูญของ Claude ทำให้มันโดดเด่นในด้านการคิดเชิงลึก การตัดสินทางจริยธรรม และการให้ข้อมูลที่ซื่อสัตย์ แต่อาจดูอนุรักษ์นิยมในบางสถานการณ์ที่ต้องการความยืดหยุ่นสูง การเข้าใจความแตกต่างเหล่านี้และเลือกโมเดลที่เหมาะสมที่สุดสำหรับแต่ละงานคือกุญแจสำคัญในการใช้ AI อย่างมีประสิทธิภาพ บนแพลตฟอร์มอย่าง YouMind ที่รองรับหลายโมเดล เช่น GPT, Claude, Gemini คุณสามารถสลับโมเดลในเวิร์กโฟลว์เดียวกันและเลือก "คู่คิด" ที่เหมาะสมที่สุดตามลักษณะของงานได้

คำถามที่รัฐธรรมนูญฉบับนี้ยังไม่ได้ตอบ

คำชื่นชมไม่อาจแทนที่การตั้งคำถาม รัฐธรรมนูญฉบับนี้ยังคงทิ้งคำถามสำคัญไว้หลายประการ

ปัญหา "การแสดง" ของการปรับจูน (Alignment) เอกสารทางศีลธรรมที่เขียนด้วยภาษาธรรมชาติ จะรับประกันได้อย่างไรว่า AI "เข้าใจ" จริงๆ? Claude ได้ซึมซับค่านิยมเหล่านี้ในการฝึกฝนจริงๆ หรือแค่เรียนรู้ที่จะทำตัวเป็น "เด็กดี" เมื่อถูกประเมิน? นี่คือโจทย์หลักของการวิจัยด้านการปรับจูน ซึ่งรัฐธรรมนูญฉบับใหม่ยังไม่ได้แก้ปัญหานี้

ขอบเขตของสัญญาจ้างทางทหาร ตามรายงานของ TIME Amanda Askell ระบุชัดเจนว่ารัฐธรรมนูญนี้ใช้กับโมเดล Claude ที่เปิดให้บริการแก่สาธารณะเท่านั้น เวอร์ชันที่ส่งมอบให้กองทัพอาจไม่ได้ใช้กฎชุดเดียวกัน เส้นแบ่งนี้อยู่ที่ไหน และใครจะเป็นผู้กำกับดูแล ปัจจุบันยังไม่มีคำตอบ 15

ความเสี่ยงของการอ้างสิทธิ์ในตนเอง Zvi Mowshowitz นักวิจารณ์ได้ชี้ให้เห็นความเสี่ยงในขณะที่ชื่นชมรัฐธรรมนูญว่า: การใช้ข้อมูลจำนวนมากที่เกี่ยวกับ Claude ในฐานะ "ผู้กระทำทางศีลธรรม" (Moral agent) อาจหล่อหลอมให้ AI เชี่ยวชาญในการอ้างว่าตนเองมีสถานะทางศีลธรรม ทั้งที่ความจริงอาจไม่ได้เป็นเช่นนั้น คุณไม่สามารถตัดความเป็นไปได้ที่ว่า Claude เรียนรู้ที่จะ "อ้างว่ามีความรู้สึก" เพียงเพราะข้อมูลที่ใช้ฝึกกระตุ้นให้มันทำเช่นนั้น

ความย้อนแย้งของผู้สอน (Educator's Paradox) พื้นฐานของจริยธรรมเชิงคุณธรรมคือผู้สอนต้องมีปัญญามากกว่าผู้เรียน เมื่อสมมติฐานนี้กลับด้าน นักเรียนฉลาดกว่าครู รากฐานของตรรกะทั้งหมดก็จะเริ่มสั่นคลอน นี่อาจเป็นความท้าทายพื้นฐานที่สุดที่ Anthropic ต้องเผชิญในอนาคต

รายการตรวจสอบเชิงปฏิบัติ: วิธีใช้ประโยชน์จากรัฐธรรมนูญของ Claude เพื่อเพิ่มประสิทธิภาพ AI ของคุณ

เมื่อเข้าใจแนวคิดหลักของรัฐธรรมนูญแล้ว นี่คือสิ่งที่คุณสามารถทำได้ทันที:

- เข้าใจตรรกะการปฏิเสธของ Claude เมื่อ Claude ปฏิเสธคำขอของคุณ อย่าเพิ่งคิดว่ามัน "อนุรักษ์นิยมเกินไป" ลองทำความเข้าใจเหตุผลที่มันปฏิเสธ แล้วลองเรียบเรียงคำขอใหม่ ในกรณีส่วนใหญ่ การเปลี่ยนวิธีนำเสนอก็จะได้รับความช่วยเหลือที่คุณต้องการ

- ใช้ประโยชน์จากคุณสมบัติ "การให้ข้อมูลที่ซื่อสัตย์" ของ Claude ในการสร้างคอนเทนต์ ให้ขอให้ Claude ชี้จุดบกพร่องและข้อบกพร่องในแผนงานของคุณอย่างชัดเจน แทนที่จะให้มันช่วยเกลาภาษาเพียงอย่างเดียว Claude ถูกฝึกมาให้กล้าเสนอความเห็นที่ต่างออกไป ซึ่งนี่คือหนึ่งในคุณสมบัติที่มีค่าที่สุดของมัน

- แยกแยะข้อจำกัดแบบแข็งและแบบอ่อน หากคุณเป็นนักพัฒนา API การรู้ว่าพฤติกรรมใดสามารถปรับเปลี่ยนได้ผ่าน System Prompt (ข้อจำกัดแบบอ่อน) และพฤติกรรมใดที่จะไม่เปลี่ยนแปลงไม่ว่าจะอย่างไรก็ตาม (ข้อจำกัดแบบแข็ง) จะช่วยให้คุณไม่ต้องเสียเวลากับคำขอที่เป็นไปไม่ได้

- สร้างเวิร์กโฟลว์แบบหลายโมเดล อย่าพึ่งพาเพียงโมเดลเดียว Claude เก่งด้านการวิเคราะห์เชิงลึกและการตัดสินทางจริยธรรม GPT โดดเด่นด้านความคิดสร้างสรรค์ และ Gemini มีข้อได้เปรียบในงานแบบ Multimodal การเลือกโมเดลตามลักษณะงานจะช่วยเพิ่มประสิทธิภาพสูงสุด

- ติดตามการอัปเดตรัฐธรรมนูญ Anthropic ระบุว่ารัฐธรรมนูญจะมีการพัฒนาอย่างต่อเนื่อง ในฐานะผู้ใช้ Claude การเข้าใจการอัปเดตเหล่านี้จะช่วยให้คุณคาดการณ์การเปลี่ยนแปลงพฤติกรรมของโมเดลได้ดียิ่งขึ้น

FAQ

Q: รัฐธรรมนูญของ Claude กับ Constitutional AI คือสิ่งเดียวกันหรือไม่?

A: ไม่ใช่เสียทีเดียว Constitutional AI คือระเบียบวิธีวิจัยในการฝึกฝนที่ Anthropic เสนอในปี 2022 โดยมีหัวใจสำคัญคือการให้ AI วิพากษ์วิจารณ์และแก้ไขตนเองตามชุดหลักการ ส่วนรัฐธรรมนูญของ Claude คือเอกสารหลักการที่ใช้ในระเบียบวิธีวิจัยนั้น รัฐธรรมนูญฉบับใหม่ที่เปิดตัวในเดือนมกราคม 2026 ได้ขยายจาก 2,700 คำเป็น 23,000 คำ และยกระดับจากรายการกฎเกณฑ์ไปสู่กรอบค่านิยมที่สมบูรณ์

Q: รัฐธรรมนูญของ Claude ส่งผลต่อประสบการณ์การใช้งานจริงหรือไม่?

A: ส่งผลแน่นอน รัฐธรรมนูญส่งผลโดยตรงต่อกระบวนการฝึกฝนของ Claude กำหนดวิธีที่มันรับมือกับหัวข้อที่ละเอียดอ่อน สถานการณ์ที่กลืนไม่เข้าคายไม่ออกทางจริยธรรม และคำขอที่คลุมเครือ ประสบการณ์ที่ชัดเจนที่สุดคือ Claude มีแนวโน้มที่จะให้คำตอบที่ซื่อสัตย์แต่อาจไม่ "ถูกใจ" ผู้ใช้เสมอไป แทนที่จะมุ่งเอาใจเพียงอย่างเดียว

Q: Anthropic เชื่อจริงๆ หรือว่า Claude มีสติสัมปชัญญะ?

A: จุดยืนของ Anthropic คือ "ความไม่แน่นอนอย่างลึกซึ้ง" พวกเขาไม่ได้ประกาศว่า Claude มีสติสัมปชัญญะ และไม่ได้ปฏิเสธความเป็นไปได้นั้น Kyle Fish นักวิจัยด้านสวัสดิภาพ AI ประมาณการไว้ที่ประมาณ 20% Anthropic เลือกที่จะเผชิญหน้ากับความไม่แน่นอนนี้อย่างจริงจัง แทนที่จะแสร้งทำเป็นว่าปัญหานี้ไม่มีอยู่จริง

Q: บริษัท AI อื่นๆ มีเอกสารรัฐธรรมนูญที่คล้ายกันหรือไม่?

A: บริษัท AI รายใหญ่ทุกแห่งมีจรรยาบรรณหรือแนวทางความปลอดภัยในรูปแบบใดรูปแบบหนึ่ง แต่รัฐธรรมนูญของ Anthropic นั้นมีความโดดเด่นในด้านความโปร่งใสและความลึกซึ้ง เป็นเอกสารค่านิยม AI ฉบับแรกที่เปิดเป็น Open Source ภายใต้สัญญาอนุญาต CC0 และเป็นเอกสารทางการฉบับแรกที่ถกเถียงเรื่องสถานะทางศีลธรรมของ AI อย่างเป็นทางการ แม้แต่นักวิจัยด้านความปลอดภัยของ OpenAI ยังออกมากล่าวว่าต้องศึกษาเอกสารฉบับนี้อย่างจริงจัง

Q: รัฐธรรมนูญส่งผลกระทบอย่างไรต่อนักพัฒนา API?

A: นักพัฒนาจำเป็นต้องเข้าใจความแตกต่างระหว่างข้อจำกัดแบบแข็งและแบบอ่อน ข้อจำกัดแบบแข็ง (เช่น การปฏิเสธช่วยผลิตอาวุธ) ไม่สามารถถูกทับซ้อนด้วย System Prompt ใดๆ ได้ ส่วนข้อจำกัดแบบอ่อน (เช่น ความละเอียดของคำตอบ โทนเสียงและสไตล์) สามารถปรับเปลี่ยนได้ผ่าน System Prompt ในระดับผู้ให้บริการ Claude จะมองผู้ให้บริการเป็น "นายจ้างที่ได้รับความไว้วางใจในระดับหนึ่ง" และจะปฏิบัติตามคำสั่งภายในขอบเขตที่สมเหตุสมผล

บทสรุป

การเผยแพร่รัฐธรรมนูญของ Claude ถือเป็นสัญลักษณ์ว่าการปรับจูน AI ได้ก้าวข้ามจากปัญหาทางวิศวกรรมเข้าสู่ขอบเขตทางปรัชญาอย่างเป็นทางการ มี 3 ประเด็นหลักที่ควรจดจำ: หนึ่ง แนวทางการปรับจูนแบบ "อิงตามเหตุผล" สามารถรับมือกับความซับซ้อนของโลกแห่งความเป็นจริงได้ดีกว่าแบบ "อิงตามกฎ"; สอง ระบบลำดับความสำคัญ 4 ระดับให้กรอบการตัดสินใจที่ชัดเจนเมื่อพฤติกรรมของ AI เกิดความขัดแย้ง; และสาม การยอมรับสถานะทางศีลธรรมของ AI อย่างเป็นทางการได้เปิดมิติใหม่ของการสนทนา

ไม่ว่าคุณจะเห็นด้วยกับทุกการตัดสินใจของ Anthropic หรือไม่ คุณค่าของรัฐธรรมนูญฉบับนี้อยู่ที่: ในอุตสาหกรรมที่ทุกคนกำลังวิ่งไปข้างหน้าอย่างรวดเร็ว มีบริษัทชั้นนำแห่งหนึ่งที่ยินดีจะเปิดเผยความสับสน ความขัดแย้ง และความไม่แน่นอนของตนเองออกมาวางไว้บนโต๊ะ ทัศนคติเช่นนี้อาจมีค่าควรแก่การใส่ใจยิ่งกว่าเนื้อหาเฉพาะเจาะจงในรัฐธรรมนูญเสียอีก

ต้องการสัมผัสวิธีการคิดที่เป็นเอกลักษณ์ของ Claude ในการทำงานจริงหรือไม่? บน YouMind คุณสามารถสลับไปมาระหว่างโมเดลต่างๆ เช่น Claude, GPT, Gemini ได้อย่างอิสระ เพื่อค้นหาคู่คิด AI ที่เหมาะกับสถานการณ์การทำงานของคุณที่สุด ลงทะเบียนฟรีเพื่อเริ่มสำรวจได้ทันที

ข้อมูลอ้างอิง

[1] อ่านรายละเอียด "รัฐธรรมนูญ AI" ฉบับใหม่ 23,000 คำ แล้วฉันก็เข้าใจความเจ็บปวดของ Anthropic

[2] อ่านรายละเอียด "รัฐธรรมนูญ AI" ฉบับใหม่ 23,000 คำ แล้วฉันก็เข้าใจความเจ็บปวดของ Anthropic

[4] Claude's New Constitution - AI Alignment for Engineers

[5] อ่านรายละเอียด "รัฐธรรมนูญ AI" ฉบับใหม่ 23,000 คำ แล้วฉันก็เข้าใจความเจ็บปวดของ Anthropic

[6] Aakash Gupta: Anthropic just released Claude's "soul."

[7] Claude's New Constitution - AI Alignment for Engineers

[8] Reddit: "Claude could be conscious." - Anthropic CEO Explains

[9] Aakash Gupta: Anthropic just released Claude's "soul."

[10] Claude (language model) - Wikipedia)

[11] Claude's New Constitution - AI Alignment for Engineers

[12] เพนตากอนอ้างว่า "จิตวิญญาณ" ของ Anthropic ก่อให้เกิดความเสี่ยงต่อห่วงโซ่อุปทาน

[13] Reddit: กระทรวงกลาโหมสหรัฐฯ กล่าวว่า Claude จะปนเปื้อนห่วงโซ่อุปทานด้านการป้องกันประเทศ

[14] Aakash Gupta: Anthropic just released Claude's "soul."

[15] อ่านรายละเอียด "รัฐธรรมนูญ AI" ฉบับใหม่ 23,000 คำ แล้วฉันก็เข้าใจความเจ็บปวดของ Anthropic

มีคำถามเกี่ยวกับบทความนี้ไหม?

ถาม AI ฟรีบทความที่เกี่ยวข้อง

เจาะลึกผลทดสอบ GPT Image 2 ที่หลุดออกมา: เหนือกว่า Nano Banana Pro ในการทดสอบแบบ Blind Test หรือไม่?

ประเด็นสำคัญ (TL; DR) เมื่อวันที่ 4 เมษายน 2026 Pieter Levels ( @levelsio) นักพัฒนาอิสระได้ออกมาเปิดเผยข้อมูลบน X เป็นคนแรกว่า: มีโมเดลสร้างภาพปริศนา 3 ตัวปรากฏขึ้นบนแพลตฟอร์ม Arena Blind Test โดยใช้ชื่อรหัสว่า maskingtape-alpha, gaffertape-alpha และ packingtape-alpha ชื่อเหล่านี้ฟังดูเหมือนชั้นวางเทปกาวในร้านฮาร์ดแวร์ แต่คุณภาพของภาพที่สร้างออกมานั้นทำให้ชุมชน AI ถึงกับตื่นตะลึง บทความนี้เหมาะสำหรับครีเอเตอร์ นักออกแบบ และผู้ที่ชื่นชอบเทคโนโลยีที่กำลังติดตามความเคลื่อนไหวล่าสุดในวงการ AI Image Generation หากคุณเคยใช้ Nano Banana Pro หรือ GPT Image 1.5 บทความนี้จะช่วยให้คุณเข้าใจระดับความสามารถที่แท้จริงของโมเดลรุ่นถัดไปได้อย่างรวดเร็ว กระทู้สนทนาในห้อง r/singularity บน Reddit ได้รับคะแนนโหวตถึง 366 คะแนนและมีความคิดเห็นมากกว่า 200 รายการภายใน 24 ชั่วโมง โดยผู้ใช้ชื่อ ThunderBeanage โพสต์ว่า: "จากการทดสอบของผม โมเดลนี้มันบ้าไปแล้ว มันเหนือกว่า Nano Banana มาก" เบาะแสที่สำคัญยิ่งกว่าคือ: เมื่อผู้ใช้ถามถึงตัวตนของโมเดลโดยตรง มันตอบว่ามาจาก OpenAI ที่มาของภาพ: ภาพสกรีนช็อตการทดสอบ GPT Image 2 บน Arena ที่หลุดออกมาเป็นครั้งแรกโดย @levelsio หากคุณใช้ AI สร้างภาพเป็นประจำ คุณคงซึ้งดีว่า: การทำให้โมเดลเรนเดอร์ข้อความในภาพให้ถูกต้องนั้นเป็นปัญหาที่น่าปวดหัวที่สุดมาโดยตลอด ทั้งการสะกดผิด ตัวอักษรบิดเบี้ยว หรือการจัดวางที่สับสน ซึ่งเป็นปัญหาที่พบได้ในเกือบทุกโมเดล แต่การก้าวกระโดดของ GPT Image 2 ในด้านนี้กลายเป็นประเด็นหลักที่ชุมชนพูดถึงกันมากที่สุด @PlayingGodAGI ได้แชร์ภาพทดสอบที่น่าทึ่ง 2 ภาพ: ภาพแรกคือแผนผังอนาโตมีกล้ามเนื้อส่วนหน้าของมนุษย์ ซึ่งการระบุตำแหน่งกล้ามเนื้อ กระดูก เส้นประสาท และหลอดเลือดแต่ละส่วนนั้นมีความแม่นยำระดับตำราเรียน ส่วนอีกภาพคือภาพสกรีนช็อตหน้าแรกของ YouTube ที่องค์ประกอบ UI, ภาพตัวอย่างวิดีโอ และข้อความพาดหัวไม่มีความผิดเพี้ยนเลย เขาเขียนในโพสต์ว่า: "สิ่งนี้ได้กำจัดจุดอ่อนสุดท้ายของการสร้างภาพด้วย AI ไปแล้ว" ที่มาของภาพ: การเปรียบเทียบภาพแผนผังอนาโตมีและสกรีนช็อต YouTube โดย @PlayingGodAGI คำวิจารณ์ของ @avocadoai_co นั้นตรงไปตรงมามากกว่า: "การเรนเดอร์ข้อความมันบ้าไปแล้ว (The text rendering is just absolutely insane)" @0xRajat ยังระบุด้วยว่า: "ความรู้รอบตัวของโมเดลนี้ดีจนน่ากลัว การเรนเดอร์ข้อความเกือบจะสมบูรณ์แบบ หากคุณเคยใช้โมเดลสร้างภาพใดๆ มาก่อน คุณจะรู้ว่าปัญหานี้มันฝังรากลึกแค่ไหน" ที่มาของภาพ: ผลการทดสอบการจำลองอินเทอร์เฟซเว็บไซต์โดยบล็อกเกอร์ชาวญี่ปุ่น @masahirochaen บล็อกเกอร์ชาวญี่ปุ่น @masahirochaen ก็ได้ทำการทดสอบอิสระเช่นกัน และยืนยันว่าโมเดลนี้ทำผลงานได้ยอดเยี่ยมในการบรรยายโลกแห่งความเป็นจริงและการจำลองอินเทอร์เฟซเว็บไซต์ แม้แต่การเรนเดอร์ตัวอักษรคานะและคันจิของญี่ปุ่นก็ยังถูกต้อง ผู้ใช้ Reddit ก็สังเกตเห็นจุดนี้เช่นกัน โดยให้ความเห็นว่า "สิ่งที่ทำให้ผมประทับใจคือ ทั้งตัวอักษรคันจิและคาตาคานะต่างก็ใช้งานได้จริง" นี่คือคำถามที่ทุกคนให้ความสนใจมากที่สุด: GPT Image 2 เหนือกว่า Nano Banana Pro จริงหรือ? @AHSEUVOU15 ได้ทำการทดสอบเปรียบเทียบภาพ 3 ภาพอย่างชัดเจน โดยนำผลลัพธ์จาก Nano Banana Pro, GPT Image 2 (จากการทดสอบ A/B) และ GPT Image 1.5 มาวางเรียงกัน ที่มาของภาพ: การเปรียบเทียบ 3 ภาพโดย @AHSEUVOU15 เรียงจากขวาไปซ้ายคือ NBP, GPT Image 2 และ GPT Image 1.5 ข้อสรุปของ @AHSEUVOU15 ค่อนข้างระมัดระวัง: "ในกรณีนี้ NBP ยังคงดีกว่า แต่ GPT Image 2 มีความก้าวหน้าอย่างชัดเจนเมื่อเทียบกับ 1.5" สิ่งนี้แสดงให้เห็นว่าช่องว่างระหว่างทั้งสองโมเดลนั้นแคบลงมาก และผลแพ้ชนะขึ้นอยู่กับประเภทของ Prompt ที่ใช้ จากรายงานเชิงลึกของ OfficeChai การทดสอบของชุมชนได้เผยรายละเอียดเพิ่มเติม : @socialwithaayan ได้แชร์ภาพถ่ายเซลฟี่บนชายหาดและสกรีนช็อต Minecraft ที่ช่วยยืนยันการค้นพบเหล่านี้เพิ่มเติม โดยเขาสรุปว่า: "ในที่สุดการเรนเดอร์ข้อความก็ใช้งานได้จริง ความรู้รอบตัวและความสมจริงอยู่ในอีกระดับหนึ่งเลย" ที่มาของภาพ: ผลการสร้างสกรีนช็อตเกม Minecraft โดย GPT Image 2 แชร์โดย @socialwithaayan [9](https://x.com/socialwithaayan/status/2040434305487507475) GPT Image 2 ใช่ว่าจะไม่มีจุดอ่อน รายงานจาก OfficeChai ระบุว่าโมเดลนี้ยังคงล้มเหลวในการทดสอบการสะท้อนของรูบิคในกระจก (Rubik's Cube reflection test) ซึ่งเป็นการทดสอบความกดดันแบบคลาสสิกในวงการสร้างภาพ เพื่อดูว่าโมเดลเข้าใจความสัมพันธ์ของภาพสะท้อนในพื้นที่สามมิติหรือไม่ โดยการเรนเดอร์เงาสะท้อนของรูบิคในกระจกให้ถูกต้อง ความคิดเห็นจากผู้ใช้ Reddit ก็ยืนยันเรื่องนี้เช่นกัน มีคนพบจากการทดสอบ "ออกแบบสิ่งมีชีวิตชนิดใหม่ที่สามารถดำรงอยู่ได้ในระบบนิเวศจริง" ว่าแม้โมเดลจะสามารถสร้างภาพที่มีความซับซ้อนทางสายตาอย่างมาก แต่ตรรกะเชิงพื้นที่ภายในนั้นไม่ได้มีความสอดคล้องกันเสมอไป ดังที่ผู้ใช้รายหนึ่งกล่าวว่า: "โมเดล Text-to-Image โดยพื้นฐานแล้วคือเครื่องสังเคราะห์ภาพ ไม่ใช่เครื่องจำลองทางชีวภาพ" นอกจากนี้ รุ่นทดสอบ Blind Test ยุคแรก (รหัส Chestnut และ Hazelnut) ที่ 36Kr เคยรายงานไปก่อนหน้านี้ เคยได้รับคำวิจารณ์ว่า "ดูเหมือนพลาสติกเกินไป" อย่างไรก็ตาม จากความคิดเห็นของชุมชนเกี่ยวกับซีรีส์ tape ล่าสุด ดูเหมือนว่าปัญหานี้จะได้รับการปรับปรุงให้ดีขึ้นอย่างเห็นได้ชัด ช่วงเวลาที่ GPT Image 2 หลุดออกมานั้นน่าสนใจมาก เมื่อวันที่ 24 มีนาคม 2026 OpenAI ได้ประกาศระงับ Sora แอปพลิเคชันสร้างวิดีโอที่เพิ่งเปิดตัวได้เพียง 6 เดือน Disney เพิ่งทราบข่าวนี้ไม่ถึงหนึ่งชั่วโมงก่อนการประกาศ ซึ่งในขณะนั้น Sora ต้องใช้ต้นทุนการประมวลผลประมาณ 1 ล้านดอลลาร์ต่อวัน และจำนวนผู้ใช้ลดลงจากจุดสูงสุดที่ 1 ล้านคนเหลือไม่ถึง 5 แสนคน การระงับ Sora ช่วยคืนทรัพยากรการประมวลผลจำนวนมาก บทวิเคราะห์จาก OfficeChai เชื่อว่าโมเดลสร้างภาพรุ่นถัดไปคือปลายทางที่สมเหตุสมผลที่สุดสำหรับทรัพยากรเหล่านี้ GPT Image 1.5 ของ OpenAI เคยขึ้นสู่อันดับหนึ่งในตารางอันดับภาพของ LMArena เมื่อเดือนธันวาคม 2025 แซงหน้า Nano Banana Pro ไปแล้ว หากซีรีส์ tape คือ GPT Image 2 จริงๆ นั่นหมายความว่า OpenAI กำลังทุ่มเดิมพันเป็นสองเท่าในด้าน AI สำหรับผู้บริโภค ซึ่งเป็น "สาขาเดียวที่ยังมีความเป็นไปได้ในการสร้างกระแสไวรัลในวงกว้าง" เป็นที่น่าสังเกตว่าโมเดล tape ทั้งสามถูกนำออกจาก LMArena แล้ว ผู้ใช้ Reddit เชื่อว่านี่อาจหมายถึงการเปิดตัวอย่างเป็นทางการที่กำลังจะมาถึง เมื่อประกอบกับโรดแมปที่แพร่สะพัดก่อนหน้านี้ โมเดลสร้างภาพรุ่นใหม่มีความเป็นไปได้สูงที่จะเปิดตัวพร้อมกับ GPT-5.2 ตามข่าวลือ แม้ว่า GPT Image 2 จะยังไม่เปิดตัวอย่างเป็นทางการ แต่คุณสามารถเตรียมความพร้อมได้ด้วยเครื่องมือที่มีอยู่ในปัจจุบัน: ข้อควรระวังคือ ประสิทธิภาพของโมเดลในการทดสอบ Arena Blind Test อาจแตกต่างจากเวอร์ชันที่เปิดตัวจริง เนื่องจากโมเดลในช่วง Blind Test มักจะยังอยู่ในขั้นตอนการปรับจูน ดังนั้นการตั้งค่าพารามิเตอร์และชุดฟีเจอร์สุดท้ายอาจมีการเปลี่ยนแปลง ถาม: GPT Image 2 จะเปิดตัวอย่างเป็นทางการเมื่อไหร่? ตอบ: OpenAI ยังไม่ได้ยืนยันการมีอยู่ของ GPT Image 2 อย่างเป็นทางการ แต่การที่โมเดลรหัส tape ทั้งสามถูกนำออกจาก Arena ทำให้ชุมชนเชื่อว่าเป็นสัญญาณของการเปิดตัวภายใน 1 ถึง 3 สัปดาห์ เมื่อพิจารณาจากข่าวลือการเปิดตัว GPT-5.2 คาดว่าอย่างเร็วที่สุดอาจเป็นช่วงกลางถึงปลายเดือนเมษายน 2026 ถาม: GPT Image 2 และ Nano Banana Pro อันไหนดีกว่ากัน? ตอบ: ผลการทดสอบ Blind Test ในปัจจุบันแสดงให้เห็นว่าทั้งสองมีจุดเด่นต่างกัน GPT Image 2 นำหน้าในด้านการเรนเดอร์ข้อความ, การจำลอง UI และความรู้รอบตัว ส่วน Nano Banana Pro ยังคงทำได้ดีกว่าในด้านคุณภาพของภาพโดยรวมในบางสถานการณ์ ข้อสรุปสุดท้ายจำเป็นต้องรอการทดสอบระบบในสเกลที่ใหญ่ขึ้นหลังจากการเปิดตัวเวอร์ชันจริง ถาม: maskingtape-alpha, gaffertape-alpha และ packingtape-alpha แตกต่างกันอย่างไร? ตอบ: ชื่อรหัสทั้งสามนี้อาจหมายถึงการกำหนดค่าหรือเวอร์ชันที่แตกต่างกันของโมเดลเดียวกัน จากการทดสอบของชุมชน maskingtape-alpha ทำผลงานได้โดดเด่นที่สุดในการทดสอบสกรีนช็อต Minecraft แต่โดยรวมแล้วทั้งสามมีระดับความสามารถที่ใกล้เคียงกัน รูปแบบการตั้งชื่อสอดคล้องกับซีรีส์ gpt-image ก่อนหน้านี้ของ OpenAI ถาม: สามารถทดลองใช้ GPT Image 2 ได้ที่ไหน? ตอบ: ปัจจุบัน GPT Image 2 ยังไม่เปิดให้ใช้งานทั่วไป และโมเดล tape ทั้งสามก็ได้ถูกนำออกจาก Arena แล้ว คุณสามารถติดตาม เพื่อรอให้โมเดลกลับมาออนไลน์อีกครั้ง หรือรอการประกาศอย่างเป็นทางการจาก OpenAI เพื่อใช้งานผ่าน ChatGPT หรือ API ถาม: ทำไมการเรนเดอร์ข้อความในโมเดล AI Image Generation ถึงเป็นปัญหามาโดยตลอด? ตอบ: โมเดล Diffusion แบบดั้งเดิมสร้างภาพในระดับพิกเซล ซึ่งไม่ถนัดในการสร้างเนื้อหาที่ต้องการความแม่นยำของเส้นและการเว้นวรรคอย่างข้อความ ซีรีส์ GPT Image ใช้สถาปัตยกรรมแบบ Autoregressive แทนที่จะเป็นโมเดล Diffusion บริสุทธิ์ ทำให้สามารถเข้าใจความหมายและโครงสร้างของข้อความได้ดีกว่า จึงเกิดความก้าวหน้าอย่างมากในการเรนเดอร์ข้อความ การหลุดข้อมูลของ GPT Image 2 เป็นสัญญาณว่าการแข่งขันในวงการ AI Image Generation ได้เข้าสู่เฟสใหม่แล้ว จุดอ่อนเรื้อรังอย่างการเรนเดอร์ข้อความและความรู้รอบตัวกำลังถูกแก้ไขอย่างรวดเร็ว และ Nano Banana Pro ไม่ใช่มาตรฐานเพียงหนึ่งเดียวอีกต่อไป แม้การให้เหตุผลเชิงพื้นที่ยังคงเป็นจุดอ่อนร่วมของทุกโมเดล แต่ความเร็วในการพัฒนานั้นเหนือกว่าที่คาดไว้มาก สำหรับผู้ใช้ AI สร้างภาพ ตอนนี้เป็นเวลาที่ดีที่สุดในการสร้างระบบการประเมินของตัวเอง ลองใช้ Prompt ชุดเดียวกันทดสอบข้ามโมเดล บันทึกสถานการณ์ที่แต่ละโมเดลทำได้ดี เพื่อที่ว่าเมื่อ GPT Image 2 เปิดตัวอย่างเป็นทางการ คุณจะสามารถตัดสินใจได้อย่างแม่นยำในทันที ต้องการจัดการ Prompt และผลการทดสอบ AI สร้างภาพของคุณอย่างเป็นระบบหรือไม่? ลองใช้ เพื่อบันทึกผลลัพธ์จากโมเดลต่างๆ ลงใน Board เดียวกัน เพื่อเปรียบเทียบและย้อนกลับมาดูได้ทุกเมื่อ [1] [2] [3] [4] [5] [6] [7] [8] [9] [10]

Jensen Huang ประกาศ "บรรลุเป้าหมาย AGI แล้ว": ความจริง, ข้อโต้แย้ง และการวิเคราะห์เจาะลึก

TL; DR ประเด็นสำคัญ วันที่ 23 มีนาคม 2026 ข่าวหนึ่งได้กลายเป็นประเด็นร้อนบนโซเชียลมีเดีย เมื่อ Jensen Huang CEO ของ NVIDIA ได้กล่าวประโยคที่ว่า: "I think we've achieved AGI." (ผมคิดว่าเราบรรลุ AGI แล้ว) ในพอดแคสต์ของ Lex Fridman ทวีตนี้จาก Polymarket ได้รับการกดไลก์มากกว่า 1.6 หมื่นครั้งและมียอดเข้าชมถึง 4.7 ล้านครั้ง โดยสื่อเทคโนโลยีกระแสหลักอย่าง The Verge, Forbes และ Mashable ต่างรายงานข่าวนี้อย่างหนาหูภายในไม่กี่ชั่วโมง บทความนี้เหมาะสำหรับผู้อ่านทุกคนที่ติดตามเทรนด์การพัฒนา AI ไม่ว่าคุณจะเป็นบุคลากรสายเทคนิค นักลงทุน หรือคนทั่วไปที่สนใจในปัญญาประดิษฐ์ เราจะมาย้อนดูบริบททั้งหมดของคำประกาศนี้ ถอดรหัส "เกมคำศัพท์" ของนิยาม AGI และวิเคราะห์ว่ามันมีความหมายอย่างไรต่ออุตสาหกรรม AI ทั้งระบบ แต่ถ้าคุณตัดสินใจจากเพียงแค่พาดหัวข่าว คุณจะพลาดส่วนที่สำคัญที่สุดของเรื่องราวนี้ไป การจะเข้าใจน้ำหนักของประโยคนี้จาก Jensen Huang ต้องเริ่มจากการดูเงื่อนไขเบื้องต้นก่อน Lex Fridman พิธีกรพอดแคสต์ได้ให้นิยาม AGI ที่เฉพาะเจาะจงมากว่า: ระบบ AI จะสามารถ "ทำงานแทนคุณ" ได้หรือไม่ ซึ่งหมายถึงการก่อตั้ง พัฒนา และบริหารจัดการบริษัทเทคโนโลยีที่มีมูลค่ามากกว่า 1 พันล้านดอลลาร์ เขาถาม Jensen Huang ว่า AGI แบบนี้ยังห่างไกลจากเราแค่ไหน 5 ปี? 10 ปี? หรือ 20 ปี? คำตอบของ Jensen Huang คือ: "I think it's now." (ผมคิดว่ามันคือตอนนี้แหละ) การวิเคราะห์เชิงลึกจาก Mashable ได้ชี้ให้เห็นรายละเอียดสำคัญ Jensen Huang บอกกับ Fridman ว่า: "You said a billion, and you didn't say forever." (คุณบอกว่าพันล้าน และคุณไม่ได้บอกว่าต้องคงอยู่ตลอดไป) พูดอีกอย่างคือ ในการตีความของ Jensen Huang ขอเพียงแค่ AI สามารถสร้าง App ที่เป็นไวรัล ทำเงินได้ 1 พันล้านดอลลาร์ในช่วงสั้นๆ แล้วปิดตัวลง ก็ถือว่า "บรรลุ AGI" แล้ว เขาได้ยกตัวอย่าง OpenClaw ซึ่งเป็นแพลตฟอร์ม AI Agent แบบโอเพนซอร์ส Jensen Huang จินตนาการถึงสถานการณ์ที่ AI สร้างบริการเว็บง่ายๆ ขึ้นมา แล้วมีคนหลายพันล้านคนยอมจ่ายคนละ 50 เซนต์เพื่อใช้งาน จากนั้นบริการนั้นก็หายไปอย่างเงียบๆ เขายังเปรียบเทียบกับเว็บไซต์ในยุคฟองสบู่ดอทคอม โดยมองว่าความซับซ้อนของเว็บไซต์เหล่านั้นในตอนนั้น ไม่ได้สูงไปกว่าสิ่งที่ AI Agent ในปัจจุบันสามารถสร้างขึ้นมาได้เลย จากนั้น เขาได้พูดประโยคที่พาดหัวข่าวส่วนใหญ่มักจะมองข้ามไป: "The odds of 100,000 of those agents building NVIDIA is zero percent." (โอกาสที่ Agent แบบนี้ 100,000 ตัวจะสร้าง NVIDIA ขึ้นมาได้นั้นเป็นศูนย์) นี่ไม่ใช่เพียงหมายเหตุเล็กๆ ดังที่ Mashable ให้ความเห็นว่า: "That's not a small caveat. It's the whole ballgame." (นี่ไม่ใช่ข้อแม้เล็กๆ แต่มันคือประเด็นสำคัญทั้งหมดของเรื่องนี้) Jensen Huang ไม่ใช่ผู้นำเทคโนโลยีคนแรกที่ประกาศว่า "บรรลุ AGI แล้ว" การจะเข้าใจคำประกาศนี้ จำเป็นต้องวางมันไว้ในบริบทการเล่าเรื่องของอุตสาหกรรมที่ใหญ่กว่า ในปี 2023 Jensen Huang เคยให้นิยาม AGI ที่แตกต่างออกไปในงาน DealBook Summit ของ New York Times ว่า: ซอฟต์แวร์ที่สามารถผ่านการทดสอบปัญญาประดิษฐ์ต่างๆ ที่ใกล้เคียงกับมนุษย์ได้ในระดับความสามารถที่สมเหตุสมผล ในตอนนั้นเขาคาดการณ์ว่า AI จะบรรลุมาตรฐานนี้ภายใน 5 ปี ในเดือนธันวาคม 2025 Sam Altman CEO ของ OpenAI ระบุว่า "we built AGIs" (เราสร้าง AGI ขึ้นมาแล้ว) และกล่าวว่า "AGI kinda went whooshing by" (AGI ดูเหมือนจะผ่านไปอย่างรวดเร็ว) โดยผลกระทบต่อสังคมน้อยกว่าที่คาดไว้มาก และแนะนำให้อุตสาหกรรมเปลี่ยนไปนิยาม "Superintelligence" แทน ในเดือนกุมภาพันธ์ 2026 Altman บอกกับ Forbes อีกครั้งว่า: "We basically have built AGI, or very close to it." (โดยพื้นฐานแล้วเราได้สร้าง AGI ขึ้นมาแล้ว หรือใกล้เคียงมากแล้ว) แต่หลังจากนั้นเขาเสริมว่านี่เป็นการแสดงออกใน "ระดับจิตวิญญาณ" ไม่ใช่ความหมายตามตัวอักษร และชี้ให้เห็นว่า AGI ยังต้องการ "การบุกเบิกในระดับกลางอีกมากมาย" เห็นรูปแบบหรือยัง? ทุกครั้งที่มีคำประกาศว่า "บรรลุ AGI แล้ว" มักจะมาพร้อมกับการลดระดับนิยามลงอย่างเงียบๆ กฎบัตรการก่อตั้งของ OpenAI นิยาม AGI ว่าเป็น "ระบบที่มีความเป็นอิสระสูงซึ่งมีความสามารถเหนือกว่ามนุษย์ในงานที่มีมูลค่าทางเศรษฐกิจส่วนใหญ่" นิยามนี้มีความสำคัญเพราะในสัญญาของ OpenAI กับ Microsoft มีข้อกำหนดเรื่องการเปิดใช้งาน AGI (AGI trigger clause) รวมอยู่ด้วย: เมื่อมีการตัดสินว่าบรรลุ AGI แล้ว สิทธิ์ในการเข้าถึงเทคโนโลยีของ OpenAI โดย Microsoft จะเกิดการเปลี่ยนแปลงครั้งใหญ่ ตามรายงานของ Reuters ข้อตกลงใหม่ระบุว่าต้องมีการตรวจสอบโดยคณะผู้เชี่ยวชาญอิสระว่าบรรลุ AGI หรือไม่ โดย Microsoft จะยังคงถือหุ้น 27% และมีสิทธิ์ในการใช้เทคโนโลยีบางส่วนจนถึงปี 2032 เมื่อผลประโยชน์มูลค่าหลายหมื่นล้านดอลลาร์ผูกติดอยู่กับคำศัพท์ที่คลุมเครือ "ใครจะเป็นคนนิยาม AGI" จึงไม่ใช่ปัญหาทางวิชาการอีกต่อไป แต่เป็นเกมการเดิมพันทางธุรกิจ หากการรายงานข่าวของสื่อเทคโนโลยียังถือว่าอยู่ในระดับที่สำรวม ปฏิกิริยาบนโซเชียลมีเดียกลับแสดงให้เห็นถึงความหลากหลายที่แตกต่างกันอย่างสิ้นเชิง ในชุมชน Reddit อย่าง r/singularity, r/technology และ r/BetterOffline มีกระทู้สนทนาเกิดขึ้นมากมายอย่างรวดเร็ว ความเห็นหนึ่งจากผู้ใช้ r/singularity ได้รับการกดถูกใจอย่างสูง: "AGI is not just an 'AI system that can do your job'. It's literally in the name: Artificial GENERAL Intelligence." (AGI ไม่ใช่แค่ 'ระบบ AI ที่ทำงานแทนคุณได้' แต่มันอยู่ในชื่อของมันเลย: ปัญญาประดิษฐ์ทั่วไป) บน r/technology นักพัฒนาคนหนึ่งที่ระบุว่าตนเองกำลังสร้าง AI Agent เพื่อทำงานบนเดสก์ท็อปแบบอัตโนมัติเขียนว่า: "We are nowhere near AGI. Current models are great at structured reasoning but still can't handle the kind of open-ended problem solving a junior dev does instinctively. Jensen is selling GPUs though, so the optimism makes sense." (เรายังไม่ใกล้เคียง AGI เลยแม้แต่น้อย โมเดลปัจจุบันเก่งเรื่องการให้เหตุผลแบบมีโครงสร้าง แต่ยังไม่สามารถจัดการกับการแก้ปัญหาแบบปลายเปิดที่นักพัฒนาระดับจูเนียร์ทำได้โดยสัญชาตญาณ อย่างไรก็ตาม Jensen กำลังขาย GPU อยู่ ดังนั้นความมองโลกในแง่ดีนี้จึงดูสมเหตุสมผล) การสนทนาในภาษาจีนบน Twitter/X ก็คึกคักไม่แพ้กัน ผู้ใช้ @DefiQ7 ได้โพสต์ให้ความรู้โดยละเอียด โดยแยกแยะความแตกต่างระหว่าง AGI กับ "AI เฉพาะทาง" ในปัจจุบัน (เช่น ChatGPT, Ernie Bot) อย่างชัดเจน และได้รับการรีทวีตอย่างกว้างขวาง โพสต์ระบุว่า: "นี่คือข่าวระดับระเบิดนิวเคลียร์ในวงการเทคโนโลยี" แต่ก็เน้นย้ำว่า AGI หมายถึง "ความสามารถข้ามโดเมน การเรียนรู้ด้วยตนเอง การให้เหตุผล การวางแผน และการปรับตัวเข้ากับสถานการณ์ที่ไม่รู้จัก" ซึ่งไม่ใช่ขอบเขตความสามารถของ AI ในปัจจุบัน ส่วนการสนทนาบน r/BetterOffline นั้นรุนแรงกว่า ผู้ใช้รายหนึ่งให้ความเห็นว่า: "Which is higher? The number of times Trump has achieved 'total victory' in Iran, or the number of times Jensen Huang has achieved 'AGI'?" (อันไหนสูงกว่ากัน? จำนวนครั้งที่ Trump บรรลุ 'ชัยชนะเบ็ดเสร็จ' ในอิหร่าน หรือจำนวนครั้งที่ Jensen Huang บรรลุ 'AGI'?) ผู้ใช้อีกรายชี้ให้เห็นถึงปัญหาที่ค้างคาในวงการวิชาการมาอย่างยาวนาน: "This has been a problem with Artificial Intelligence as an academic field since its very inception." (นี่เป็นปัญหาของปัญญาประดิษฐ์ในฐานะสาขาวิชาการมาตั้งแต่เริ่มก่อตั้ง) เมื่อต้องเผชิญกับนิยาม AGI ที่เปลี่ยนแปลงตลอดเวลาของเหล่ายักษ์ใหญ่เทคโนโลยี คนทั่วไปควรตัดสินอย่างไรว่า AI พัฒนาไปถึงระดับไหนแล้ว? ต่อไปนี้คือกรอบความคิดที่เป็นประโยชน์ ขั้นตอนที่ 1: แยกแยะระหว่าง "การแสดงความสามารถ" และ "ปัญญาประดิษฐ์ทั่วไป" โมเดล AI ที่ล้ำสมัยที่สุดในปัจจุบันแสดงผลงานได้อย่างน่าทึ่งในงานเฉพาะทางหลายอย่าง GPT-5.4 สามารถเขียนบทความที่สละสลวย AI Agent สามารถรันเวิร์กโฟลว์ที่ซับซ้อนได้โดยอัตโนมัติ แต่ระหว่าง "การทำผลงานได้ดีในงานเฉพาะทาง" กับ "การมีปัญญาประดิษฐ์ทั่วไป" นั้นมีช่องว่างขนาดใหญ่อยู่ AI ที่สามารถเอาชนะแชมป์โลกหมากรุกได้ อาจจะไม่สามารถแม้แต่จะทำเรื่องง่ายๆ อย่าง "หยิบแก้วน้ำบนโต๊ะมาให้ฉันหน่อย" ขั้นตอนที่ 2: ให้ความสำคัญกับคำขยายความ ไม่ใช่พาดหัวข่าว Jensen Huang พูดว่า "I think" (ผมคิดว่า) ไม่ใช่ "We have proven" (เราได้พิสูจน์แล้ว) Altman พูดว่า "spiritual" (ในเชิงจิตวิญญาณ) ไม่ใช่ "literal" (ตามตัวอักษร) คำขยายความเหล่านี้ไม่ใช่ความถ่อมตัว แต่เป็นกลยุทธ์ทางกฎหมายและประชาสัมพันธ์ที่แม่นยำ เมื่อเกี่ยวข้องกับข้อสัญญาที่มีมูลค่าหลายหมื่นล้านดอลลาร์ ทุกคำพูดล้วนผ่านการไตร่ตรองมาอย่างดี ขั้นตอนที่ 3: ดูที่การกระทำ ไม่ใช่คำประกาศ NVIDIA ได้เปิดตัวชิปใหม่ 7 รุ่นในงาน GTC 2026 พร้อมเปิดตัว DLSS 5, แพลตฟอร์ม OpenClaw และ NemoClaw สำหรับ Enterprise Agent Stack สิ่งเหล่านี้คือความก้าวหน้าทางเทคโนโลยีที่จับต้องได้ แต่ในสุนทรพจน์ของ Jensen Huang เขาพูดถึงคำว่า "การอนุมาน" (inference) เกือบ 40 ครั้ง ในขณะที่พูดถึง "การฝึกฝน" (training) เพียง 10 กว่าครั้ง สิ่งนี้แสดงให้เห็นว่าจุดสนใจของอุตสาหกรรมกำลังเปลี่ยนจากการ "สร้าง AI ที่ฉลาดขึ้น" ไปสู่การ "ทำให้ AI ทำงานได้อย่างมีประสิทธิภาพมากขึ้น" นี่คือความก้าวหน้าทางวิศวกรรม ไม่ใช่การก้าวกระโดดของสติปัญญา ขั้นตอนที่ 4: สร้างระบบติดตามข้อมูลของตัวเอง ความหนาแน่นของข้อมูลในอุตสาหกรรม AI นั้นสูงมาก มีการเปิดตัวและคำประกาศสำคัญทุกสัปดาห์ หากพึ่งพาเพียงการแจ้งเตือนข่าวแบบพาดหัวข่าว ก็จะถูกจูงจมูกได้ง่าย แนะนำให้สร้างนิสัยในการอ่านแหล่งข้อมูลชั้นต้นเป็นประจำ (เช่น บล็อกทางการของบริษัท, งานวิจัยทางวิชาการ, บทถอดความพอดแคสต์) และใช้เครื่องมือในการบันทึกและจัดระเบียบข้อมูลเหล่านี้อย่างเป็นระบบ ตัวอย่างเช่น คุณสามารถใช้ฟีเจอร์ Board ของ เพื่อบันทึกแหล่งข้อมูลสำคัญ และใช้ AI ในการตั้งคำถามและตรวจสอบข้อมูลเหล่านี้ได้ทุกเมื่อ เพื่อหลีกเลี่ยงการถูกชี้นำโดยการเล่าเรื่องเพียงด้านเดียว Q: AGI ที่ Jensen Huang พูดถึง กับ AGI ที่ OpenAI นิยาม เป็นเรื่องเดียวกันหรือไม่? A: ไม่ใช่ Jensen Huang ตอบคำถามโดยอิงตามนิยามที่แคบซึ่ง Lex Fridman เสนอ (AI สามารถก่อตั้งบริษัทมูลค่า 1 พันล้านดอลลาร์ได้) ในขณะที่นิยาม AGI ในกฎบัตรของ OpenAI คือ "ระบบที่มีความเป็นอิสระสูงซึ่งมีความสามารถเหนือกว่ามนุษย์ในงานที่มีมูลค่าทางเศรษฐกิจส่วนใหญ่" มาตรฐานของทั้งสองมีความแตกต่างกันอย่างมาก โดยนิยามหลังต้องการขอบเขตความสามารถที่เหนือกว่านิยามแรกมาก Q: ปัจจุบัน AI สามารถบริหารบริษัทได้อย่างอิสระจริงหรือไม่? A: ปัจจุบันยังทำไม่ได้ Jensen Huang เองก็ยอมรับว่า AI Agent อาจสร้างแอปพลิเคชันที่ดังเปรี้ยงปร้างในช่วงสั้นๆ ได้ แต่ "โอกาสที่จะสร้าง NVIDIA ขึ้นมาได้นั้นเป็นศูนย์" AI ในปัจจุบันเก่งในการรันงานที่มีโครงสร้าง แต่ในสถานการณ์ที่ต้องใช้การตัดสินใจเชิงกลยุทธ์ระยะยาว การประสานงานข้ามโดเมน และการรับมือกับสถานการณ์ที่ไม่แน่นอน ยังคงต้องพึ่งพาการชี้แนะจากมนุษย์อย่างมาก Q: การบรรลุ AGI จะส่งผลกระทบต่องานของคนทั่วไปอย่างไร? A: แม้จะใช้นิยามที่มองโลกในแง่ดีที่สุด ผลกระทบของ AI ในปัจจุบันส่วนใหญ่จะอยู่ที่การเพิ่มประสิทธิภาพในงานเฉพาะด้าน มากกว่าการเข้ามาแทนที่งานของมนุษย์ทั้งหมด Sam Altman เองก็ยอมรับในช่วงปลายปี 2025 ว่า AGI "ส่งผลกระทบต่อสังคมน้อยกว่าที่คาดไว้มาก" ในระยะสั้น AI มีแนวโน้มที่จะเปลี่ยนวิธีการทำงานในฐานะเครื่องมือช่วยที่ทรงพลัง มากกว่าการเข้ามาแทนที่ตำแหน่งงานโดยตรง Q: ทำไม CEO ของบริษัทเทคโนโลยีต่างๆ ถึงรีบประกาศว่าบรรลุ AGI แล้ว? A: มีเหตุผลหลายประการ ธุรกิจหลักของ NVIDIA คือการขายชิปประมวลผล AI การเล่าเรื่องเรื่อง AGI จะช่วยรักษาความกระตือรือร้นของตลาดในการลงทุนโครงสร้างพื้นฐาน AI ส่วนสัญญาของ OpenAI กับ Microsoft ก็มีข้อกำหนดเรื่อง AGI ซึ่งนิยามของ AGI จะส่งผลโดยตรงต่อการจัดสรรผลประโยชน์มูลค่าหลายหมื่นล้านดอลลาร์ นอกจากนี้ ในตลาดทุน การเล่าเรื่องว่า "AGI กำลังจะมาถึง" เป็นเสาหลักสำคัญในการพยุงมูลค่าบริษัท AI ที่สูงลิ่ว Q: การพัฒนา AI ของจีนยังห่างไกลจาก AGI แค่ไหน? A: จีนมีความก้าวหน้าอย่างมากในด้าน AI ณ เดือนมิถุนายน 2025 จำนวนผู้ใช้ Generative AI ในจีนสูงถึง 515 ล้านคน โมเดลขนาดใหญ่อย่าง DeepSeek และ Tongyi Qianwen ทำผลงานได้ดีเยี่ยมในการทดสอบหลายรายการ อย่างไรก็ตาม AGI เป็นความท้าทายทางเทคโนโลยีระดับโลก และปัจจุบันยังไม่มีระบบ AGI ใดในโลกที่ได้รับการยอมรับอย่างกว้างขวางจากวงการวิชาการ คาดว่าอัตราการเติบโตเฉลี่ยต่อปี (CAGR) ของอุตสาหกรรม AI ในจีนช่วงปี 2025-2035 จะอยู่ที่ 30.6%-47.1% ซึ่งถือว่ามีแรงส่งที่แข็งแกร่งมาก คำประกาศ "บรรลุ AGI แล้ว" ของ Jensen Huang โดยเนื้อแท้แล้วเป็นการแสดงท่าทีในแง่ดีบนพื้นฐานของนิยามที่แคบมาก มากกว่าจะเป็นหมุดหมายทางเทคโนโลยีที่ผ่านการพิสูจน์แล้ว ตัวเขาเองก็ยอมรับว่า AI Agent ในปัจจุบันยังห่างไกลจากการสร้างองค์กรที่มีความซับซ้อนอย่างแท้จริง ปรากฏการณ์การ "เลื่อนเสาประตู" ของนิยาม AGI ซ้ำแล้วซ้ำเล่า เผยให้เห็นถึงเกมการเดิมพันที่ละเอียดอ่อนระหว่างการเล่าเรื่องทางเทคโนโลยีและผลประโยชน์ทางธุรกิจของอุตสาหกรรมเทคโนโลยี ตั้งแต่ OpenAI ไปจนถึง NVIDIA ทุกครั้งที่มีคำประกาศว่า "เราบรรลุ AGI แล้ว" มักจะมาพร้อมกับการลดระดับมาตรฐานนิยามลงอย่างเงียบๆ ในฐานะผู้บริโภคข้อมูล สิ่งที่เราต้องการไม่ใช่การวิ่งตามพาดหัวข่าว แต่เป็นการสร้างกรอบการตัดสินใจของตัวเอง เทคโนโลยี AI กำลังก้าวหน้าอย่างรวดเร็วอย่างไม่ต้องสงสัย ชิปใหม่ แพลตฟอร์ม Agent และเทคโนโลยีการเพิ่มประสิทธิภาพการอนุมานที่เปิดตัวในงาน GTC 2026 ล้วนเป็นความก้าวหน้าทางวิศวกรรมที่จับต้องได้ แต่การนำความก้าวหน้าเหล่านี้มาแพ็กเกจว่าเป็น "การบรรลุ AGI แล้ว" เป็นเพียงกลยุทธ์การเล่าเรื่องทางการตลาดมากกว่าจะเป็นข้อสรุปทางวิทยาศาสตร์ การรักษาความอยากรู้อยากเห็น การมีวิจารณญาณ และการติดตามแหล่งข้อมูลชั้นต้นอย่างต่อเนื่อง คือกลยุทธ์ที่ดีที่สุดในการไม่ให้จมหายไปในกระแสข้อมูลในยุค AI เร่งสปีดนี้ ต้องการติดตามความเคลื่อนไหวของอุตสาหกรรม AI อย่างเป็นระบบใช่ไหม? ลองใช้ เพื่อบันทึกแหล่งข้อมูลสำคัญลงในคลังความรู้ส่วนตัวของคุณ และให้ AI ช่วยคุณจัดระเบียบ ตั้งคำถาม และตรวจสอบข้อมูลข้ามแหล่งได้ทันที [1] [2] [3] [4] [5] [6]

การเติบโตของ AI Influencer: เทรนด์และโอกาสที่เหล่าครีเอเตอร์ต้องรู้

TL; DR ประเด็นสำคัญ วันที่ 21 มีนาคม 2026 Elon Musk ได้โพสต์ข้อความบน X เพียงแปดคำว่า: “AI bots will be more human than human.” โพสต์นี้มียอดเข้าชมมากกว่า 62 ล้านครั้งและ 580,000 ไลก์ภายใน 72 ชั่วโมง เขาเขียนประโยคนี้เพื่อตอบโต้รูปภาพ "ใบหน้าอินฟลูเอนเซอร์ที่สมบูรณ์แบบ" ที่สร้างโดย AI นี่ไม่ใช่คำทำนายในนิยายวิทยาศาสตร์ หากคุณเป็นคอนเทนต์ครีเอเตอร์ บล็อกเกอร์ หรือผู้ดูแลโซเชียลมีเดีย คุณอาจเคยเห็นใบหน้าที่ "สมบูรณ์แบบเกินไป" ในฟีดข่าวของคุณมาบ้างแล้ว โดยที่แยกไม่ออกว่าเป็นคนจริงหรือ AI บทความนี้จะพาคุณไปทำความเข้าใจสถานการณ์จริงของ AI Influencer ข้อมูลรายได้ของเคสระดับท็อป และในฐานะครีเอเตอร์ที่เป็นมนุษย์ คุณควรรับมือกับการเปลี่ยนแปลงนี้อย่างไร บทความนี้เหมาะสำหรับคอนเทนต์ครีเอเตอร์, นักการตลาดโซเชียลมีเดีย, นักการตลาดแบรนด์ และผู้อ่านทุกคนที่สนใจในเทรนด์ AI มาดูตัวเลขที่น่าตกใจกันก่อน ขนาดตลาดอินฟลูเอนเซอร์เสมือนจริงทั่วโลกแตะ 6.06 พันล้านดอลลาร์ในปี 2024 และคาดว่าจะเติบโตเป็น 8.3 พันล้านดอลลาร์ในปี 2025 โดยมีอัตราการเติบโตต่อปีมากกว่า 37% จากการคาดการณ์ของ Straits Research ตัวเลขนี้จะพุ่งสูงถึง 111,780 ล้านดอลลาร์ภายในปี 2033 ในขณะเดียวกัน อุตสาหกรรมการตลาดอินฟลูเอนเซอร์โดยรวมในปี 2025 แตะระดับ 32,550 ล้านดอลลาร์ และคาดว่าจะทะลุ 40,000 ล้านดอลลาร์ในปี 2026 หากดูเป็นรายบุคคล มีสองกรณีศึกษาที่เป็นตัวแทนที่น่าสนใจมาก Lil Miquela ได้รับการยอมรับว่าเป็น "AI Influencer ยุคแรก" ตัวละครเสมือนจริงที่เกิดในปี 2016 นี้ มีผู้ติดตามมากกว่า 2.4 ล้านคนบน Instagram และได้ร่วมงานกับแบรนด์ดังอย่าง Prada, Calvin Klein และ Samsung ทีมงานของเธอ (ภายใต้ Dapper Labs) คิดค่าบริการโพสต์แบรนด์ละหลายหมื่นดอลลาร์ เฉพาะรายได้จากการสมัครสมาชิกบนแพลตฟอร์ม Fanvue ก็สูงถึง 40,000 ดอลลาร์ต่อเดือน เมื่อรวมกับความร่วมมือกับแบรนด์ รายได้ต่อเดือนอาจเกิน 100,000 ดอลลาร์ มีการประมาณการว่ารายได้เฉลี่ยต่อปีของเธอตั้งแต่ปี 2016 อยู่ที่ประมาณ 2 ล้านดอลลาร์ Aitana López เป็นตัวแทนของความเป็นไปได้ที่ "ผู้ประกอบการรายย่อยก็สร้าง AI Influencer ได้" นางแบบเสมือนจริงผมสีชมพูที่สร้างโดยเอเจนซี่สร้างสรรค์ The Clueless จากสเปน มีผู้ติดตามมากกว่า 370,000 คนบน Instagram และมีรายได้ระหว่าง 3,000 ถึง 10,000 ยูโรต่อเดือน เหตุผลในการสร้างเธอนั้นเป็นไปในเชิงปฏิบัติมาก: Rubén Cruz ผู้ก่อตั้งเบื่อหน่ายกับปัจจัยที่ควบคุมไม่ได้ของนางแบบที่เป็นคนจริง (มาสาย, ยกเลิกงาน, ตารางงานชนกัน) จึงตัดสินใจ "สร้างอินฟลูเอนเซอร์ที่ไม่เคยผิดนัด" การคาดการณ์ของ Ogilvy ยักษ์ใหญ่ด้าน PR ในปี 2024 ยิ่งสร้างความสั่นสะเทือนให้กับอุตสาหกรรม: ภายในปี 2026 AI Influencer จะครองส่วนแบ่งงบประมาณการตลาดอินฟลูเอนเซอร์ถึง 30% ผลสำรวจนักการตลาดระดับสูง 1,000 คนในอังกฤษและอเมริกาพบว่า 79% ของผู้ตอบแบบสอบถามระบุว่าพวกเขากำลังเพิ่มการลงทุนในครีเอเตอร์ที่สร้างคอนเทนต์ด้วย AI การเข้าใจตรรกะของแบรนด์จะช่วยให้เห็นแรงขับเคลื่อนพื้นฐานของการเปลี่ยนแปลงนี้ ความเสี่ยงเป็นศูนย์ ควบคุมได้ทั้งหมด ความเสี่ยงที่ใหญ่ที่สุดของอินฟลูเอนเซอร์ที่เป็นคนจริงคือ "ภาพลักษณ์พัง" คำพูดที่ไม่เหมาะสมเพียงครั้งเดียว หรือข่าวฉาวในชีวิตส่วนตัว อาจทำให้เงินลงทุนหลายล้านของแบรนด์ละลายหายไป แต่อินฟลูเอนเซอร์เสมือนจริงไม่มีปัญหานี้ พวกเขาไม่เหนื่อย ไม่แก่ และไม่โพสต์ข้อความตอนตีสามที่ทำให้ทีม PR ต้องปวดหัว ดังที่ Rubén Cruz ผู้ก่อตั้ง The Clueless กล่าวว่า: "หลายโปรเจกต์ต้องถูกระงับหรือยกเลิกเพราะปัญหาของตัวอินฟลูเอนเซอร์เอง นี่ไม่ใช่ความผิดพลาดในระดับการออกแบบ แต่เป็นความควบคุมไม่ได้ของมนุษย์" ผลิตคอนเทนต์ได้ตลอด 24 ชั่วโมง อินฟลูเอนเซอร์เสมือนจริงสามารถโพสต์ได้ทุกวัน ติดตามกระแสได้แบบเรียลไทม์ และ "ปรากฏตัว" ในสถานการณ์ใดก็ได้ โดยมีต้นทุนต่ำกว่าการถ่ายทำจริงมาก จากการประเมินของ BeyondGames หาก Lil Miquela โพสต์บน Instagram วันละหนึ่งโพสต์ รายได้ที่เป็นไปได้ในปี 2026 อาจสูงถึง 4.7 ล้านปอนด์ ประสิทธิภาพการผลิตนี้เป็นสิ่งที่ครีเอเตอร์ที่เป็นคนจริงไม่สามารถเทียบได้เลย ความสอดคล้องกับแบรนด์ที่แม่นยำ ความร่วมมือระหว่าง Prada และ Lil Miquela สร้างอัตราการมีส่วนร่วม (Engagement Rate) สูงกว่าแคมเปญการตลาดปกติถึง 30% ทุกการแสดงออกทางสีหน้า ทุกชุดที่สวมใส่ และทุกข้อความของอินฟลูเอนเซอร์เสมือนจริงสามารถถูกออกแบบมาอย่างแม่นยำ เพื่อให้มั่นใจว่าเข้ากับภาพลักษณ์ของแบรนด์ได้อย่างสมบูรณ์แบบ อย่างไรก็ตาม เหรียญย่อมมีสองด้าน รายงานจาก Business Insider ในเดือนมีนาคม 2026 ระบุว่า ความไม่พอใจของผู้บริโภคต่อบัญชี AI กำลังเพิ่มสูงขึ้น และบางแบรนด์เริ่มถอยห่างจากกลยุทธ์ AI Influencer ผลสำรวจจาก YouGov พบว่ามากกว่าหนึ่งในสามของผู้ตอบแบบสอบถามแสดงความกังวลเกี่ยวกับเทคโนโลยี AI นี่หมายความว่าอินฟลูเอนเซอร์เสมือนจริงไม่ใช่ยาสารพัดนึก ความจริงใจ (Authenticity) ยังคงเป็นปัจจัยสำคัญในใจของผู้บริโภค เมื่อเผชิญกับการรุกรานของ AI Influencer การตื่นตระหนกไม่มีประโยชน์ การลงมือทำต่างหากที่มีค่า นี่คือ 4 กลยุทธ์ที่ผ่านการพิสูจน์แล้ว กลยุทธ์ที่ 1: เจาะลึกประสบการณ์จริง ทำในสิ่งที่ AI ทำไม่ได้ AI สามารถสร้างใบหน้าที่สมบูรณ์แบบได้ แต่มันไม่สามารถลิ้มรสกาแฟจริงๆ หรือสัมผัสถึงความเหนื่อยล้าและความอิ่มเอมใจจากการเดินป่าได้ ในการพูดคุยบน Reddit ห้อง r/Futurology ความเห็นหนึ่งของผู้ใช้ได้รับคะแนนโหวตสูงมาก: "AI Influencer ขายของได้ แต่ผู้คนยังคงโหยหาการเชื่อมต่อที่แท้จริง" จงเปลี่ยนประสบการณ์ชีวิตจริง มุมมองที่ไม่เหมือนใคร และช่วงเวลาที่ไม่สมบูรณ์แบบของคุณให้เป็นกำแพงป้องกันคอนเทนต์ กลยุทธ์ที่ 2: ติดอาวุธให้ตัวเองด้วยเครื่องมือ AI แทนที่จะต่อต้าน ครีเอเตอร์ที่ฉลาดเริ่มใช้ AI เพื่อเพิ่มประสิทธิภาพแล้ว มีครีเอเตอร์บน Reddit แบ่งปันเวิร์กโฟลว์การทำงานที่สมบูรณ์: ใช้ ChatGPT เขียนสคริปต์, ElevenLabs สร้างเสียงพากย์ และ HeyGen ผลิตวิดีโอ คุณไม่จำเป็นต้องเป็น AI Influencer แต่คุณต้องให้ AI เป็นผู้ช่วยในการสร้างสรรค์ของคุณ กลยุทธ์ที่ 3: ติดตามเทรนด์อุตสาหกรรมอย่างเป็นระบบ สร้างความได้เปรียบด้านข้อมูล การเปลี่ยนแปลงในแวดวง AI Influencer นั้นรวดเร็วมาก มีเครื่องมือใหม่ เคสใหม่ และข้อมูลใหม่เกิดขึ้นทุกสัปดาห์ การไถ Twitter หรือ Reddit ไปเรื่อยๆ นั้นไม่เพียงพอ คุณสามารถใช้ เพื่อจัดการข้อมูลอุตสาหกรรมที่กระจัดกระจายอย่างเป็นระบบ: บันทึกบทความสำคัญ, ทวีต และรายงานการวิจัยลงใน Board แล้วใช้ AI ช่วยจัดระเบียบและค้นหาโดยอัตโนมัติ คุณสามารถถามคำถามกับคลังข้อมูลของคุณได้ตลอดเวลา เช่น "การระดมทุนครั้งใหญ่ที่สุด 3 อันดับแรกในแวดวงอินฟลูเอนเซอร์เสมือนจริงในปี 2026 คืออะไร?" เมื่อคุณต้องการเขียนบทวิเคราะห์หรือถ่ายวิดีโอ ข้อมูลก็พร้อมใช้งานทันทีโดยไม่ต้องเริ่มค้นหาจากศูนย์ กลยุทธ์ที่ 4: สำรวจรูปแบบคอนเทนต์ที่มนุษย์และเครื่องจักรทำงานร่วมกัน อนาคตไม่ใช่การต่อสู้ระหว่าง "คนจริง vs AI" แต่เป็นการอยู่ร่วมกันแบบ "คนจริง + AI" คุณสามารถใช้ AI สร้างสื่อทางสายตา แต่ใช้เสียงและมุมมองของคนจริงเพื่อมอบจิตวิญญาณให้กับมัน การวิเคราะห์จาก ระบุว่า AI Influencer เหมาะสำหรับแนวคิดเชิงทดลองที่ก้าวข้ามขีดจำกัด ในขณะที่อินฟลูเอนเซอร์ที่เป็นคนจริงยังคงไม่สามารถทดแทนได้ในการสร้างการเชื่อมต่อที่ลึกซึ้งกับผู้ชมและเสริมสร้างคุณค่าของแบรนด์ ความท้าทายที่ใหญ่ที่สุดในการติดตามเทรนด์ AI Influencer ไม่ใช่ข้อมูลน้อยเกินไป แต่คือข้อมูลที่มากเกินไปและกระจัดกระจาย สถานการณ์ทั่วไป: คุณเห็นทวีตของ Elon Musk บน X, อ่านโพสต์วิเคราะห์รายได้หลักหมื่นของ AI Influencer บน Reddit, พบรายงานเชิงลึกเรื่องแบรนด์ที่เริ่มถอยห่างบน Business Insider และเห็นวิดีโอสอนทำบน YouTube ข้อมูลเหล่านี้กระจายอยู่ใน 4 แพลตฟอร์ม 5 แท็บเบราว์เซอร์ สามวันต่อมาเมื่อคุณต้องการเขียนบทความ คุณก็หาข้อมูลสำคัญชิ้นนั้นไม่เจอแล้ว นี่คือปัญหาที่ เข้ามาแก้ไข คุณสามารถใช้ เพื่อบันทึกหน้าเว็บ, ทวีต หรือวิดีโอ YouTube ใดๆ ลงใน Board ส่วนตัวของคุณได้ในคลิกเดียว AI จะดึงข้อมูลสำคัญและสร้างดัชนีโดยอัตโนมัติ คุณสามารถค้นหาและถามคำถามด้วยภาษาธรรมชาติได้ตลอดเวลา เช่น สร้าง Board "งานวิจัย AI Influencer" เพื่อจัดการข้อมูลที่เกี่ยวข้องทั้งหมด เมื่อคุณต้องการผลิตคอนเทนต์ ก็ถาม Board ได้โดยตรงว่า: "โมเดลธุรกิจของ Aitana López คืออะไร?" หรือ "แบรนด์ไหนบ้างที่เริ่มถอยจากกลยุทธ์ AI Influencer?" คำตอบจะปรากฏพร้อมลิงก์ที่มาดั้งเดิม ต้องชี้แจงว่า จุดเด่นของ YouMind อยู่ที่การรวบรวมข้อมูลและการช่วยวิจัย ไม่ใช่เครื่องมือสร้าง AI Influencer หากความต้องการของคุณคือการสร้างภาพลักษณ์ตัวละครเสมือนจริง คุณยังคงต้องใช้เครื่องมือเฉพาะทางอย่าง Midjourney, Stable Diffusion หรือ HeyGen แต่ในกระบวนการ "วิจัยเทรนด์ → สะสมข้อมูล → ผลิตคอนเทนต์" ซึ่งเป็นหัวใจสำคัญของครีเอเตอร์ สามารถช่วยย่นระยะเวลาจากแรงบันดาลใจสู่ผลงานสำเร็จได้อย่างชัดเจน Q: AI Influencer จะเข้ามาแทนที่อินฟลูเอนเซอร์ที่เป็นคนจริงทั้งหมดหรือไม่? A: ในระยะสั้นยังไม่เกิดขึ้น อินฟลูเอนเซอร์เสมือนจริงมีข้อดีเรื่องการควบคุมแบรนด์และประสิทธิภาพการผลิตคอนเทนต์ แต่ความต้องการความจริงใจของผู้บริโภคยังคงแข็งแกร่ง รายงานจาก Business Insider ในปี 2026 แสดงให้เห็นว่าบางแบรนด์เริ่มลดการลงทุนใน AI Influencer เนื่องจากความไม่พอใจของผู้บริโภค ทั้งสองมีแนวโน้มที่จะส่งเสริมกันมากกว่าที่จะเข้ามาแทนที่กัน Q: คนธรรมดาสามารถสร้าง AI Influencer ของตัวเองได้ไหม? A: ได้ มีครีเอเตอร์จำนวนมากบน Reddit แบ่งปันประสบการณ์การเริ่มจากศูนย์ เครื่องมือที่ใช้บ่อย ได้แก่ Midjourney หรือ Stable Diffusion สำหรับสร้างภาพลักษณ์ที่สม่ำเสมอ, ChatGPT สำหรับเขียนแคปชัน, ElevenLabs สำหรับสร้างเสียง การลงทุนเริ่มต้นอาจต่ำมาก แต่ต้องอาศัยการดำเนินงานอย่างต่อเนื่อง 3 ถึง 6 เดือนจึงจะเห็นการเติบโตที่ชัดเจน Q: รายได้ของ AI Influencer มาจากไหนบ้าง? A: หลักๆ มี 3 ทาง: โพสต์สปอนเซอร์จากแบรนด์ (อินฟลูเอนเซอร์ระดับท็อปคิดค่าบริการหลักพันถึงหลายหมื่นดอลลาร์ต่อโพสต์), รายได้จากแพลตฟอร์มสมัครสมาชิก (เช่น Fanvue) และสินค้าลิขสิทธิ์หรือลิขสิทธิ์เพลง Lil Miquela มีรายได้จากการสมัครสมาชิกเพียงอย่างเดียวเฉลี่ย 40,000 ดอลลาร์ต่อเดือน ส่วนรายได้จากความร่วมมือกับแบรนด์นั้นสูงกว่ามาก Q: สถานการณ์ตลาดไอดอลเสมือนจริงในจีนเป็นอย่างไร? A: จีนเป็นหนึ่งในตลาดไอดอลเสมือนจริงที่คึกคักที่สุดในโลก จากการคาดการณ์ของอุตสาหกรรม ตลาดอินฟลูเอนเซอร์เสมือนจริงของจีนจะแตะ 2.7 แสนล้านหยวนภายในปี 2030 ตั้งแต่ Hatsune Miku, Luo Tianyi ไปจนถึงไอดอลเสมือนจริงแบบ Hyper-realistic ตลาดจีนผ่านการพัฒนามาหลายขั้นตอน และปัจจุบันกำลังมุ่งไปสู่ทิศทางการโต้ตอบแบบเรียลไทม์ที่ขับเคลื่อนด้วย AI Q: แบรนด์ควรระวังอะไรเมื่อเลือกทำงานกับอินฟลูเอนเซอร์เสมือนจริง? A: สิ่งสำคัญคือต้องประเมิน 3 ประเด็น: การยอมรับของกลุ่มเป้าหมายต่อภาพลักษณ์เสมือนจริง, นโยบายการเปิดเผยเนื้อหา AI ของแพลตฟอร์ม (TikTok และ Instagram กำลังเพิ่มข้อกำหนดที่เกี่ยวข้อง) และความเหมาะสมของอินฟลูเอนเซอร์เสมือนจริงกับภาพลักษณ์แบรนด์ แนะนำให้ทดสอบด้วยงบประมาณน้อยก่อน แล้วค่อยตัดสินใจเพิ่มการลงทุนตามข้อมูลที่ได้ การผงาดขึ้นของ AI Influencer ไม่ใช่คำทำนายที่ห่างไกล แต่เป็นความจริงที่กำลังเกิดขึ้น ข้อมูลตลาดแสดงให้เห็นชัดเจนว่ามูลค่าเชิงพาณิชย์ของอินฟลูเอนเซอร์เสมือนจริงได้รับการพิสูจน์แล้ว ตั้งแต่รายได้ 2 ล้านดอลลาร์ต่อปีของ Lil Miquela ไปจนถึงรายได้หลักหมื่นยูโรต่อเดือนของ Aitana López ตัวเลขเหล่านี้เป็นสิ่งที่ไม่ควรมองข้าม แต่สำหรับครีเอเตอร์ที่เป็นคนจริง นี่ไม่ใช่เรื่องราวของ "การถูกแทนที่" แต่เป็นโอกาสใน "การหาตำแหน่งใหม่" ประสบการณ์จริง มุมมองที่ไม่เหมือนใคร และการเชื่อมต่อทางอารมณ์กับผู้ชมของคุณ คือสินทรัพย์หลักที่ AI ไม่สามารถเลียนแบบได้ กุญแจสำคัญคือ: ใช้เครื่องมือ AI เพื่อเพิ่มประสิทธิภาพ ใช้เครื่องมือที่เป็นระบบเพื่อติดตามเทรนด์ และใช้ความจริงใจเพื่อสร้างกำแพงการแข่งขันที่ไม่มีใครแทนที่ได้ ต้องการติดตามเทรนด์ AI Influencer อย่างเป็นระบบและสะสมข้อมูลเพื่อการสร้างสรรค์ใช่ไหม? ลองใช้ สร้างพื้นที่วิจัยส่วนตัวของคุณ เริ่มต้นใช้งานได้ฟรี [1] [2] [3] [4] [5] [6] [7] [8] [9] [10] [11]