Leitfaden zur KI-gestützten Massenerstellung von Inhalten: Der unverzichtbare Workflow für Content Creator

TL; DR – Die wichtigsten Punkte

- Von den weltweit über 207 Millionen Content-Erstellern nutzen bereits 91 % generative KI, um ihre Produktionseffizienz zu steigern; Power-User erzielen dabei eine 3- bis 5-fache Effizienzsteigerung.

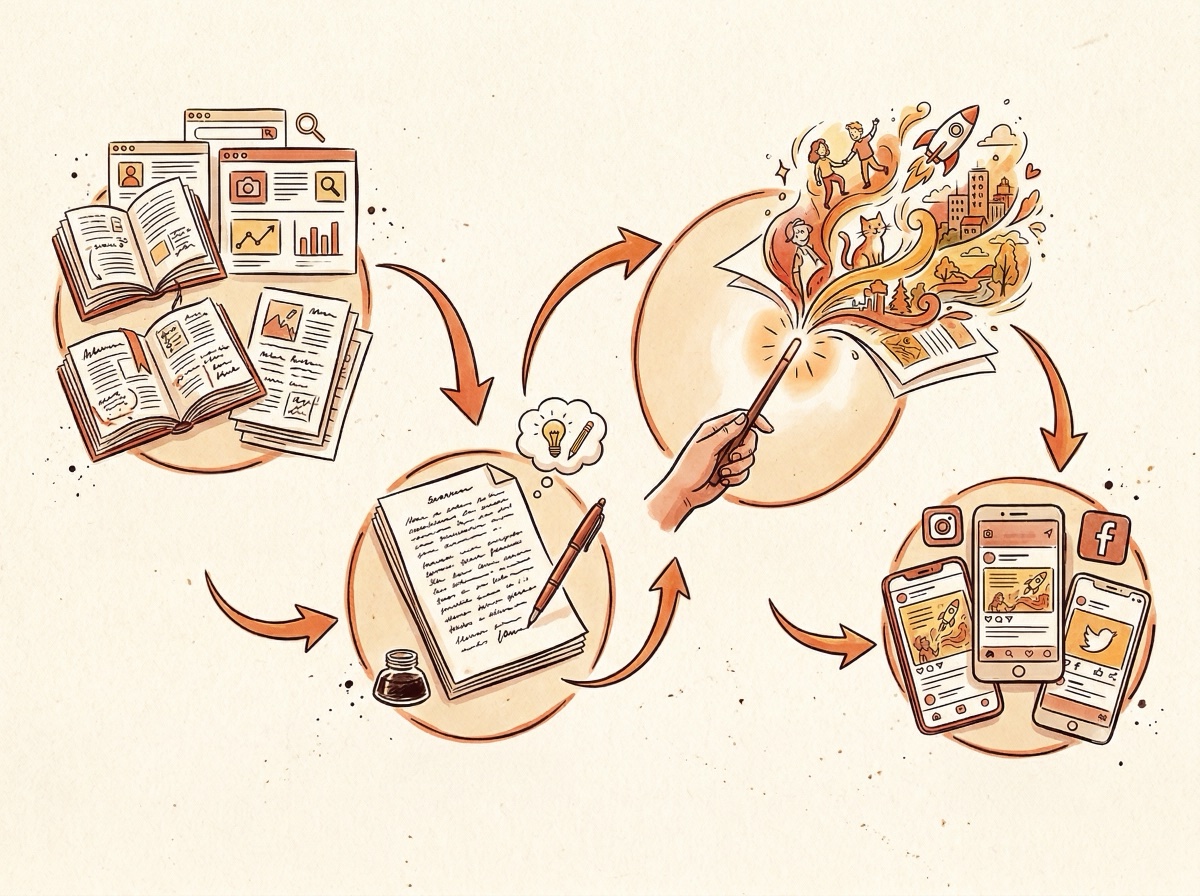

- Der Kern der KI-gestützten Massenerstellung von Bild- und Textinhalten liegt nicht darin, „ein gutes Tool zu finden“, sondern im Aufbau eines vollständigen Workflows: „Materialsammlung → Story-Generierung → Bildgestaltung → Multi-Plattform-Distribution“.

- Kinder-Bilderbücher, populärwissenschaftliche Grafiken und Wissenskarten sind die besten Einstiegspunkte für die KI-Massenerstellung. Es ist mittlerweile Realität, dass eine einzelne Person 10 bis 20 hochwertige Inhaltssets pro Tag produziert.

- Konsistente Charaktere, einheitlicher Stil und Urheberrechtskonformität sind die drei größten Herausforderungen bei der KI-Content-Erstellung; konkrete Lösungen finden Sie im Artikel.

Ihre Produktionsgeschwindigkeit wird gerade von der Konkurrenz abgehängt

Eine harte Tatsache: Während Sie noch an den Bildern für einen einzelnen Post feilen, hat Ihr Konkurrent möglicherweise bereits die Inhalte für eine ganze Woche mithilfe von KI-Tools fertiggeplant.

Laut Branchendaten von Anfang 2026 hat der weltweite Markt für KI-Content-Erstellung bereits ein Volumen von 24,08 Milliarden US-Dollar erreicht, was einem Wachstum von über 21 % im Vergleich zum Vorjahr entspricht 1. Besonders bemerkenswert ist die Veränderung im Bereich der Social-Media-Teams: Teams, die KI tiefgreifend integrieren, steigern ihre Effizienz im Durchschnitt um das 3- bis 5-fache. Prozesse wie Themenplanung, Materialrecherche und Design, die früher eine Woche dauerten, können nun in 1 bis 2 Tagen abgeschlossen werden 2.

Dieser Artikel richtet sich an Social-Media-Manager, Content-Creator und alle, die KI zur Erstellung von Bilderbüchern, Kindergeschichten oder Infografiken nutzen möchten. Sie erhalten einen praxiserprobten Workflow für die KI-Massenerstellung – mit konkreten Schritt-für-Schritt-Anleitungen von der Recherche bis zum fertigen Produkt.

Warum „Bild-Text-Inhalte“ der beste Startpunkt für die KI-Massenerstellung sind

Viele Creator versuchen bei ihrem ersten Kontakt mit KI-Tools direkt lange Artikel zu schreiben oder Videos zu produzieren. Doch unter dem Aspekt des Kosten-Nutzen-Verhältnisses sind Bild-Text-Kombinationen die Kategorie, in der sich KI-Workflows am einfachsten etablieren lassen.

Dafür gibt es drei Gründe. Erstens: Die Produktionskette ist kurz. Ein Set besteht im Kern aus „Text + Bild“ – zwei Bereiche, in denen KI bereits extrem ausgereift ist. Zweitens: Die Fehlertoleranz ist höher. Eine kleine Unstimmigkeit in einer KI-Illustration fällt im Newsfeed kaum auf, während ein deformiertes Gesicht in einem KI-Video sofort die Aufmerksamkeit der Zuschauer stört. Drittens: Die Distributionskanäle sind vielfältig. Dasselbe Set kann mit minimalen Grenzkosten gleichzeitig auf Plattformen wie Instagram, Pinterest, LinkedIn oder Blogs veröffentlicht werden.

Kinder-Bilderbücher und Wissensgrafiken sind zwei Nischen, die sich besonders gut eignen. Ein bekanntes Beispiel zeigt einen Creator, der mit ChatGPT die Story und mit Midjourney die Illustrationen für das Kinderbuch „Alice and Sparkle“ erstellte und es erfolgreich auf Amazon veröffentlichte 3. Auch auf Plattformen wie TikTok oder Instagram wachsen Accounts für KI-generierte Kindergeschichten rasant und gewinnen teilweise über 100.000 Follower in einem Monat.

Die Logik dahinter ist simpel: Die Technologie für die KI-Generierung von Kindergeschichten und Bilderbüchern ist marktreif. Der entscheidende Faktor ist nur noch, ob Sie über einen effizienten Workflow verfügen.

Die vier Kernherausforderungen der KI-Massenerstellung

Bevor Sie loslegen, sollten Sie die vier häufigsten Stolperfallen kennen, die in Communities wie Reddit (r/KDP) immer wieder diskutiert werden 4.

Herausforderung 1: Charakter-Konsistenz. Das ist das größte Problem bei KI-Bilderbüchern. Wenn Sie die KI bitten, ein Mädchen mit rotem Hut zu zeichnen, hat sie im ersten Bild vielleicht kurze Haare und ein rundes Gesicht, im zweiten jedoch lange Haare und große Augen. Der Illustrator Sachin Kamath wies auf X (Twitter) nach der Analyse von über 1.000 KI-Bildern darauf hin, dass Creator oft nur darauf achten, ob ein Bild „schön“ ist, statt auf die weitaus wichtigere Konsistenz zu setzen.

Herausforderung 2: Zu lange Tool-Ketten. Ein typischer Prozess umfasst oft 5 bis 6 verschiedene Tools: ChatGPT für den Text, Midjourney für Bilder, Canva für das Layout, CapCut für Untertitel und dann die verschiedenen Plattform-Backends. Jeder Tool-Wechsel unterbricht den kreativen Flow und kostet massiv Zeit.

Herausforderung 3: Qualitätsschwankungen. Die Qualität von KI-Inhalten ist oft instabil. Derselbe Prompt kann heute ein Meisterwerk liefern und morgen ein Bild mit sechs Fingern an einer Hand. Der Zeitaufwand für die Qualitätskontrolle wird bei der Massenproduktion oft unterschätzt.

Herausforderung 4: Rechtliche Grauzonen. Ein Bericht des US Copyright Office von 2025 stellt klar, dass rein KI-generierte Inhalte ohne signifikanten menschlichen Beitrag keinen Urheberrechtsschutz genießen 5. Wenn Sie planen, Ihre Werke kommerziell zu vertreiben, müssen Sie sicherstellen, dass genügend menschliche Bearbeitung und Kreativität eingeflossen sind.

In fünf Schritten zum Workflow für die KI-Massenerstellung

Hier ist ein praxiserprobter Workflow, der diese Herausforderungen löst. Der Kerngedanke: Nutzen Sie einen möglichst zentralen Workspace, um Tool-Wechsel zu minimieren.

Schritt 1: Aufbau einer Inspirationsdatenbank. Voraussetzung für die Massenproduktion ist ein großer Vorrat an Material. Sie benötigen einen Ort für Wettbewerbsanalysen, Trendthemen, Referenzbilder und Stilproben. Statt Lesezeichen im Browser zu verteilen, ist es besser, ein Wissensmanagement-Tool zu nutzen. In YouMind können Sie beispielsweise virale Posts, Stil-Referenzen und Zielgruppenanalysen in einem Board speichern. Danach können Sie die KI direkt fragen: „Was sind die häufigsten Charaktereigenschaften in diesen Büchern?“ oder „Welches Farbschema erzielt die höchste Interaktion?“. Die KI antwortet basierend auf Ihrem gesammelten Material.

Schritt 2: Batch-Generierung von Text-Frameworks. Basierend auf Ihrem Material erstellen Sie nun die Texte. Für eine Kinderbuchreihe legen Sie ein Thema fest (z. B. „Die Abenteuer des kleinen Fuchses“) und lassen die KI 10 bis 20 Story-Outlines generieren. Wichtig: Definieren Sie im Prompt ein „Character Sheet“ mit Aussehen, Persönlichkeit und typischen Redewendungen, um die Konsistenz für die späteren Bilder zu sichern.

Schritt 3: Einheitliche Bildgenerierung. Dies ist der technisch anspruchsvollste Teil. KI-Bildgeneratoren des Jahres 2026 beherrschen Charakter-Konsistenz bereits recht gut. Nutzen Sie einen Prompt für ein Referenzbild (Character Reference) und beziehen Sie sich in allen weiteren Bildern darauf. Tools wie Midjourney (via --cref Parameter) oder Recraft AI (via Style-Lock) unterstützen dies. YouMind bietet integrierte Bildgenerierung mit Modellen wie Nano Banana Pro, Seedream 4.5 oder GPT Image 1.5. So können Sie Ergebnisse direkt vergleichen, ohne zwischen Websites hin- und herzuwechseln.

Schritt 4: Montage und Qualitätsprüfung. Fügen Sie Text und Bild zusammen und prüfen Sie das Ergebnis manuell. Achten Sie auf drei Dinge: Sieht der Charakter in allen Szenen gleich aus? Gibt es logische Fehler im Text? Gibt es offensichtliche KI-Artefakte (falsche Finger, verzerrter Text)? Dieser Schritt entscheidet, ob Ihr Inhalt als „KI-Spam“ oder als „hochwertiger, KI-gestützter Content“ wahrgenommen wird.

Schritt 5: Plattform-Anpassung und Distribution. Unterschiedliche Plattformen benötigen unterschiedliche Formate. Instagram bevorzugt 4:5 oder 9:16, Blogs eher Querformate. Es empfiehlt sich, Bilder direkt in mehreren Formaten zu generieren, statt sie nachträglich mühsam zuzuschneiden.

So wählen Sie das richtige KI-Tool aus

Die Auswahl an Tools ist riesig; TechTarget listete 2026 über 35 relevante Anbieter auf 6. Für die Massenerstellung sollten Sie auf drei Kriterien achten: Integration von Text und Bild, Auswahl an verschiedenen Modellen und Automatisierungsfunktionen.

Tool | Bestes Szenario | Gratis-Version | Kernvorteil |

|---|---|---|---|

Recherche + kompletter Content-Workflow | ✅ | Multi-Modell-Bildgenerierung + Wissensmanagement + Agent-Workflows aus einer Hand | |

Layout und Vorlagen | ✅ | Riesige Vorlagenauswahl, ideal für Design, aber begrenzte KI-Bildpower | |

Speziell für Kinderbücher | Test-Credits | Fokus auf Bilderbücher, gute Konsistenz, aber eingeschränkt auf diese Nische | |

Personalisierte Geschichten | ✅ | Einfache Bedienung für Eltern/Lehrer, schwach bei Massenproduktion |

Hinweis: YouMind ist besonders stark in der Kette „von der Recherche zur Erstellung“. Wenn Sie nur ein einzelnes Bild benötigen, bieten spezialisierte Tools wie Midjourney oft die höchste künstlerische Qualität. Der Mehrwert von YouMind liegt darin, dass Sie Recherche, Text, Bildgenerierung und Automatisierung über Skills an einem Ort bündeln können.

FAQ

F: Kann ich KI-generierte Kinderbücher kommerziell nutzen?

A: Ja, aber unter Bedingungen. Laut den Richtlinien von 2025 ist ein „substanzieller menschlicher Beitrag“ für den Urheberrechtsschutz nötig. Das bedeutet: Editieren Sie die Texte gründlich, bearbeiten Sie die Bilder nach und dokumentieren Sie Ihren kreativen Prozess. Plattformen wie Amazon KDP verlangen zudem oft eine Kennzeichnung von KI-Inhalten.

F: Wie viel Content kann eine Person pro Tag mit KI erstellen?

A: Mit einem eingespielten Workflow sind 10 bis 20 Sets (je 6 bis 8 Bilder + Text) pro Tag für eine Einzelperson realisierbar. Das setzt jedoch voraus, dass Charakter-Settings und Stil-Vorlagen bereits stehen. Anfänger sollten mit 3 bis 5 Sets pro Tag starten.

F: Werden KI-Inhalte von Plattformen abgestraft?

A: Google hat klargestellt, dass die Qualität und die E-E-A-T-Signale (Erfahrung, Expertise, Autorität, Vertrauenswürdigkeit) zählen, nicht die Art der Erstellung 7. Solange der Inhalt dem Nutzer Mehrwert bietet und kein minderwertiger Spam ist, wird er nicht benachteiligt.

F: Wie hoch sind die Startkosten für einen KI-Content-Account?

A: Sie können fast bei Null starten. Die meisten Tools bieten kostenlose Kontingente für Tests an. Sobald Sie wissen, was funktioniert, können Sie in kostenpflichtige Pläne investieren. Bei YouMind sind grundlegende Funktionen kostenlos, während Premium-Pläne mehr Modelle und höhere Limits bieten.

Fazit

Im Jahr 2026 ist die KI-Massenerstellung keine Frage des „Ob“ mehr, sondern des „Wie effizient“.

Merken Sie sich drei Dinge: Erstens, der Workflow ist wichtiger als das einzelne Tool. Zweitens, die menschliche Kontrolle ist die Qualitätsgarantie. Drittens, fangen Sie klein an und iterieren Sie schnell. Wählen Sie eine Nische (z. B. Einschlafgeschichten) und optimieren Sie den Prozess Schritt für Schritt.

Wenn Sie eine Plattform suchen, die die gesamte Kette von der Recherche bis zur Automatisierung abdeckt, probieren Sie YouMind kostenlos aus und bauen Sie Ihre eigene Content-Produktionslinie auf.

Referenzen

[1] Global Generative AI in Content Creation Market Report (2026-2035)

[2] AI reshaping Social Media Ecosystem: 2025 Trends & Practices

[3] Case Study: How AI Children's Books went viral

[4] Reddit r/KDP: Best AI Tools for Children's Book Illustration Discussion

[5] Building an AI Children's Book Generator (MindStudio Tutorial)

[6] 35 AI Content Generators to Explore in 2026 (TechTarget)

[7] Top AI Content Creation Platforms 2026 (Clarity Ventures)

Hast du Fragen zu diesem Artikel?

KI kostenlos fragenVerwandte Beiträge

GPT Image 2 Leak-Test: Übertrifft es im Blindtest Nano Banana Pro?

TL;DR Kernpunkte Am 4. April 2026 berichtete der unabhängige Entwickler Pieter Levels (@levelsio) als Erster auf X: Auf der Arena-Blindtest-Plattform sind drei mysteriöse Bildgenerierungsmodelle mit den Codenamen maskingtape-alpha, gaffertape-alpha und packingtape-alpha aufgetaucht. Diese Namen klingen zwar nach einem Klebeband-Regal im Baumarkt, aber die Qualität der generierten Bilder hat die gesamte AI-Community in Aufruhr versetzt. Dieser Artikel richtet sich an Creator, Designer und Technikbegeisterte, die die neuesten Entwicklungen im Bereich der KI-Bilderzeugung verfolgen. Wenn du bereits Nano Banana Pro oder GPT Image 1.5 genutzt hast, hilft dir dieser Beitrag, das wahre Niveau der nächsten Modellgeneration schnell zu verstehen. Ein Diskussionsthread im Reddit-Subreddit r/singularity erhielt innerhalb von 24 Stunden 366 Upvotes und über 200 Kommentare. Der Nutzer ThunderBeanage postete: „Nach meinen Tests zu urteilen, ist dieses Modell absolut wahnsinnig und weit über Nano Banana.“ Ein noch entscheidenderer Hinweis: Wenn Nutzer das Modell direkt nach seiner Identität fragten, gab es an, von OpenAI zu stammen. Bildquelle: Erster Leak eines GPT Image 2 Arena-Blindtest-Screenshots von @levelsio Wenn du regelmäßig KI-Bilder generierst, kennst du das Problem: Das korrekte Rendern von Text in Bildern war bisher eine der frustrierendsten Herausforderungen. Rechtschreibfehler, deformierte Buchstaben und chaotisches Layout sind typische Krankheiten fast aller Bildmodelle. Der Durchbruch von GPT Image 2 in diesem Bereich ist das zentrale Thema der Community-Diskussionen. @PlayingGodAGI teilte zwei äußerst überzeugende Testbilder: Eines zeigt eine anatomische Darstellung der vorderen Rumpfmuskulatur, bei der jede Beschriftung von Muskeln, Knochen, Nerven und Gefäßen die Präzision eines Lehrbuchs erreicht. Das andere ist ein Screenshot der YouTube-Startseite, auf dem UI-Elemente, Video-Thumbnails und Titeltexte keinerlei Verzerrungen aufweisen. In seinem Tweet schrieb er: „Dies beseitigt die letzte Schwachstelle KI-generierter Bilder.“ Bildquelle: Vergleich zwischen Anatomie-Grafik und YouTube-Screenshot, präsentiert von @PlayingGodAGI Das Urteil von @avocadoai_co fiel noch deutlicher aus: „Das Text-Rendering ist einfach absolut wahnsinnig (The text rendering is just absolutely insane).“ Auch @0xRajat merkte an: „Das Weltwissen dieses Modells ist erschreckend gut, das Text-Rendering nahezu perfekt. Wenn du jemals ein Bildgenerierungsmodell benutzt hast, weißt du, wie tief dieser Schmerzpunkt sitzt.“ Bildquelle: Ergebnisse der Website-Interface-Wiedergabe aus einem unabhängigen Test des japanischen Bloggers @masahirochaen Der japanische Blogger @masahirochaen führte ebenfalls unabhängige Tests durch und bestätigte, dass das Modell bei der Darstellung der realen Welt und der Wiedergabe von Website-Interfaces hervorragend abschneidet. Sogar die Darstellung von japanischen Kana und Kanji war korrekt. Auch Reddit-Nutzer bemerkten dies und kommentierten: „Was mich beeindruckt, ist, dass sowohl Kanji als auch Katakana valide sind.“ Das ist die Frage, die alle am meisten beschäftigt: Hat GPT Image 2 Nano Banana Pro wirklich überholt? @AHSEUVOU15 führte einen anschaulichen Vergleichstest mit drei Bildern durch, bei dem die Ausgaben von Nano Banana Pro, GPT Image 2 (aus dem A/B-Test) und GPT Image 1.5 nebeneinander gestellt wurden. Bildquelle: Drei-Bilder-Vergleich von @AHSEUVOU15, von rechts nach links: NBP, GPT Image 2, GPT Image 1.5 Das Fazit von @AHSEUVOU15 fiel eher vorsichtig aus: „In diesem speziellen Fall ist NBP immer noch besser, aber GPT Image 2 ist im Vergleich zu 1.5 definitiv ein deutlicher Fortschritt.“ Dies deutet darauf hin, dass der Abstand zwischen den beiden Modellen bereits sehr gering ist und der Sieg vom jeweiligen Prompt-Typ abhängt. Laut einem ausführlichen Bericht von OfficeChai brachten Community-Tests weitere Details ans Licht : @socialwithaayan teilte Strand-Selfies und Minecraft-Screenshots, die diese Erkenntnisse weiter untermauerten. Sein Resümee: „Das Text-Rendering ist endlich brauchbar, Weltwissen und Realismus sind auf dem nächsten Level.“ Bildquelle: Von @socialwithaayan geteilte Ergebnisse der Minecraft-Screenshot-Generierung mit GPT Image 2 [9](https://x.com/socialwithaayan/status/2040434305487507475) GPT Image 2 ist nicht ohne Schwächen. Der Bericht von OfficeChai weist darauf hin, dass das Modell beim Rubik's Cube Spiegelreflexionstest (Zauberwürfel-Reflexionstest) weiterhin scheitert. Dies ist ein klassischer Stresstest im Bereich der Bildgenerierung, der verlangt, dass das Modell Spiegelbeziehungen im dreidimensionalen Raum versteht und die Reflexion eines Zauberwürfels im Spiegel korrekt wiedergibt. Das Feedback von Reddit-Nutzern bestätigt dies. Jemand stellte beim Test „Entwirf eine völlig neue Kreatur, die in einem realen Ökosystem existieren könnte“ fest, dass das Modell zwar visuell extrem komplexe Bilder erzeugen kann, die interne räumliche Logik jedoch nicht immer konsistent ist. Wie ein Nutzer es ausdrückte: „Text-zu-Bild-Modelle sind im Wesentlichen visuelle Synthesizer, keine biologischen Simulations-Engines.“ Zudem gab es für frühere Blindtest-Versionen (Codenamen Chestnut und Hazelnut), über die 36Kr berichtete, Kritik wegen eines „zu starken Plastik-Looks“. Nach dem Community-Feedback zur neuesten tape-Serie zu urteilen, scheint dieses Problem jedoch deutlich verbessert worden zu sein. Der Zeitpunkt des GPT Image 2 Leaks ist bemerkenswert. Am 24. März 2026 gab OpenAI die Einstellung der Video-App Sora bekannt, die erst sechs Monate zuvor gestartet war. Disney wurde erst weniger als eine Stunde vor der Ankündigung informiert. Sora verbrauchte zu diesem Zeitpunkt täglich etwa 1 Million US-Dollar, während die Nutzerzahlen von einem Spitzenwert von 1 Million auf weniger als 500.000 gefallen waren. Die Einstellung von Sora hat enorme Rechenkapazitäten freigesetzt. Die Analyse von OfficeChai legt nahe, dass ein Bildmodell der nächsten Generation das logischste Ziel für diese Rechenleistung ist. OpenAIs GPT Image 1.5 hatte bereits im Dezember 2025 die Spitze der LMArena-Bild-Rangliste erklommen und Nano Banana Pro überholt. Wenn die tape-Serie tatsächlich GPT Image 2 ist, verdoppelt OpenAI seinen Einsatz in der Bildgenerierung – dem „einzigen Bereich der Consumer-KI, in dem eine virale Massenverbreitung noch möglich ist“. Interessanterweise wurden die drei tape-Modelle mittlerweile von LMArena entfernt. Reddit-Nutzer vermuten, dass dies eine baldige offizielle Veröffentlichung ankündigt. In Kombination mit früher kursierenden Roadmaps ist es sehr wahrscheinlich, dass die neue Generation der Bildmodelle zeitgleich mit dem gerüchteweise angekündigten GPT-5.2 erscheint. Obwohl GPT Image 2 noch nicht offiziell verfügbar ist, kannst du dich mit bestehenden Tools vorbereiten: Beachte bitte, dass die Leistung der Modelle im Arena-Blindtest von der offiziellen Release-Version abweichen kann. In der Blindtest-Phase werden Modelle oft noch feinjustiert, sodass sich die endgültigen Parameter und Funktionen noch ändern können. F: Wann wird GPT Image 2 offiziell veröffentlicht? A: OpenAI hat die Existenz von GPT Image 2 noch nicht offiziell bestätigt. Da die drei tape-Modelle jedoch von Arena entfernt wurden, sieht die Community darin ein Signal für eine Veröffentlichung innerhalb der nächsten 1 bis 3 Wochen. Zusammen mit den Gerüchten um GPT-5.2 könnte ein Release Mitte bis Ende April 2026 erfolgen. F: Was ist besser: GPT Image 2 oder Nano Banana Pro? A: Die aktuellen Blindtest-Ergebnisse zeigen, dass beide ihre Stärken haben. GPT Image 2 liegt beim Text-Rendering, der UI-Wiedergabe und dem Weltwissen vorn, während Nano Banana Pro in einigen Szenarien immer noch eine bessere Gesamtschärfe und Bildqualität bietet. Ein endgültiges Urteil erfordert umfangreichere Systemtests nach der offiziellen Veröffentlichung. F: Was ist der Unterschied zwischen maskingtape-alpha, gaffertape-alpha und packingtape-alpha? A: Diese drei Codenamen könnten verschiedene Konfigurationen oder Versionen desselben Modells darstellen. In Community-Tests schnitt maskingtape-alpha bei Minecraft-Screenshots am besten ab, aber das Gesamtniveau der drei ist ähnlich. Der Benennungsstil entspricht der bisherigen gpt-image-Serie von OpenAI. F: Wo kann ich GPT Image 2 ausprobieren? A: Derzeit ist GPT Image 2 nicht öffentlich zugänglich, und die drei tape-Modelle wurden von Arena entfernt. Du kannst im Auge behalten, falls die Modelle dort wieder auftauchen, oder auf die offizielle Veröffentlichung durch OpenAI warten, um es über ChatGPT oder die API zu nutzen. F: Warum ist das Text-Rendering bei KI-Bildmodellen so schwierig? A: Traditionelle Diffusionsmodelle generieren Bilder auf Pixelebene und sind von Natur aus nicht gut darin, Inhalte wie Text zu erzeugen, die präzise Striche und Abstände erfordern. Die GPT Image-Serie nutzt eine autoregressive Architektur anstelle eines reinen Diffusionsmodells, wodurch sie die Semantik und Struktur von Text besser verstehen kann, was zu den Durchbrüchen beim Text-Rendering geführt hat. Der Leak von GPT Image 2 markiert eine neue Phase im Wettbewerb der KI-Bildgenerierung. Die langjährigen Schwachstellen Text-Rendering und Weltwissen werden rasant behoben, und Nano Banana Pro ist nicht mehr der einzige Maßstab. Das räumliche Denken bleibt zwar eine gemeinsame Schwäche aller Modelle, aber die Geschwindigkeit des Fortschritts übertrifft alle Erwartungen. Für Nutzer von KI-Bilderzeugung ist jetzt der beste Zeitpunkt, ein eigenes Bewertungssystem aufzubauen. Teste verschiedene Modelle mit denselben Prompts und dokumentiere die Stärken jedes Modells. So kannst du sofort ein fundiertes Urteil fällen, wenn GPT Image 2 offiziell an den Start geht. Möchtest du deine KI-Bild-Prompts und Testergebnisse systematisch verwalten? Probiere YouMind aus, um die Ergebnisse verschiedener Modelle auf einem Board zu speichern und jederzeit zu vergleichen. [1] [2] [3] [4] [5] [6] [7] [8] [9] [10]

Jensen Huang verkündet „AGI erreicht“: Die Wahrheit, die Kontroversen und eine tiefgreifende Analyse

TL; DR – Die wichtigsten Punkte Am 23. März 2026 sorgte eine Nachricht in den sozialen Medien für Aufsehen. NVIDIA-CEO Jensen Huang sagte im Podcast von Lex Fridman den Satz: „I think we’ve achieved AGI.“ (Ich denke, wir haben AGI erreicht.) Dieser Tweet von Polymarket erhielt über 16.000 Likes und 4,7 Millionen Aufrufe. Führende Tech-Medien wie The Verge, Forbes und Mashable berichteten innerhalb weniger Stunden intensiv darüber. Dieser Artikel richtet sich an alle Leser, die die Entwicklungstrends der KI verfolgen – egal, ob du in der Branche tätig bist, investierst oder einfach nur neugierig auf künstliche Intelligenz bist. Wir werden den Kontext dieser Erklärung vollständig rekonstruieren, die „Wortspiele“ um die AGI-Definition zerlegen und analysieren, was dies für die gesamte KI-Branche bedeutet. Doch wer nur die Schlagzeile liest, verpasst den wichtigsten Teil der Geschichte. Um das Gewicht von Huangs Aussage zu verstehen, muss man zunächst die Voraussetzungen betrachten. Der Podcast-Host Lex Fridman gab eine sehr spezifische Definition von AGI vor: Kann ein KI-System „deinen Job machen“, also ein Technologieunternehmen mit einem Wert von über 1 Milliarde US-Dollar gründen, entwickeln und führen? Er fragte Huang, wie weit wir von einer solchen AGI entfernt seien – 5 Jahre? 10 Jahre? 20 Jahre? Huangs Antwort lautete: „I think it’s now.“ (Ich denke, es ist jetzt soweit.) Eine Tiefenanalyse von Mashable wies auf ein entscheidendes Detail hin. Huang sagte zu Fridman: „You said a billion, and you didn’t say forever.“ (Du hast eine Milliarde gesagt, und du hast nicht gesagt, dass es ewig halten muss.) Mit anderen Worten: In Huangs Interpretation hat eine KI bereits „AGI erreicht“, wenn sie eine virale App erstellen kann, die kurzzeitig 1 Milliarde US-Dollar generiert und dann wieder vom Markt verschwindet. Als Beispiel nannte er OpenClaw, eine Open-Source-Plattform für KI-Agenten. Huang entwarf ein Szenario: Eine KI erstellt einen einfachen Webservice, den Milliarden von Menschen für jeweils 50 Cent nutzen, woraufhin der Dienst leise wieder verschwindet. Er verglich dies sogar mit Websites aus der Dotcom-Ära und meinte, dass deren Komplexität damals nicht viel höher war als das, was ein heutiger KI-Agent generieren kann. Dann sagte er den Satz, den die meisten Clickbait-Schlagzeilen ignorierten: „The odds of 100,000 of those agents building NVIDIA is zero percent.“ (Die Wahrscheinlichkeit, dass 100.000 dieser Agenten ein NVIDIA aufbauen, liegt bei null Prozent.) Dies ist kein kleiner Zusatz. Wie Mashable kommentierte: „That’s not a small caveat. It’s the whole ballgame.“ (Das ist kein kleiner Vorbehalt, das ist der entscheidende Punkt.) Huang ist nicht der erste Tech-Führer, der verkündet, dass „AGI erreicht“ sei. Um diese Erklärung zu verstehen, muss man sie in ein größeres Branchen-Narrativ einordnen. Im Jahr 2023 gab Huang auf dem DealBook-Gipfel der New York Times eine andere Definition von AGI ab: Software, die in der Lage ist, verschiedene Tests für menschliche Intelligenz mit einem angemessenen Maß an Wettbewerbsfähigkeit zu bestehen. Damals prognostizierte er, dass die KI diesen Standard innerhalb von 5 Jahren erreichen würde. Im Dezember 2025 erklärte OpenAI-CEO Sam Altman: „we built AGIs“ (wir haben AGIs gebaut) und fügte hinzu, dass „AGI kinda went whooshing by“ (AGI irgendwie an uns vorbeigerauscht ist). Die gesellschaftlichen Auswirkungen seien viel geringer als erwartet, weshalb er der Branche empfahl, sich stattdessen auf die Definition von „Superintelligenz“ zu konzentrieren. Im Februar 2026 sagte Altman gegenüber Forbes: „We basically have built AGI, or very close to it.“ (Wir haben im Grunde AGI gebaut, oder sind sehr nah dran.) Er fügte jedoch hinzu, dass dies eine eher „spirituelle“ und keine wörtliche Aussage sei, und betonte, dass AGI noch „viele mittelgroße Durchbrüche“ benötige. Erkennst du das Muster? Jede Verkündung, dass „AGI erreicht“ sei, geht mit einer stillschweigenden Herabstufung der Definition einher. Die Gründungscharta von OpenAI definiert AGI als „hochautonome Systeme, die den Menschen bei den meisten wirtschaftlich wertvollen Arbeiten übertreffen“. Diese Definition ist deshalb so wichtig, weil der Vertrag zwischen OpenAI und Microsoft eine AGI-Trigger-Klausel enthält: Sobald festgestellt wird, dass AGI erreicht ist, ändern sich die Nutzungsrechte von Microsoft an der Technologie von OpenAI grundlegend. Laut Reuters sieht die neue Vereinbarung vor, dass ein unabhängiges Expertengremium das Erreichen von AGI bestätigen muss, wobei Microsoft 27 % der Anteile behält und bis 2032 bestimmte Nutzungsrechte genießt. Wenn Interessen in Höhe von zig Milliarden Dollar an einem vagen Begriff hängen, ist die Frage „Wer definiert AGI?“ kein akademisches Problem mehr, sondern ein wirtschaftliches Machtspiel. Während die Berichterstattung der Tech-Medien noch verhalten war, zeigten die Reaktionen in den sozialen Medien ein völlig anderes Spektrum. In Reddit-Communities wie r/singularity, r/technology und r/BetterOffline entstanden schnell zahlreiche Diskussionen. Ein Kommentar eines Nutzers auf r/singularity erhielt viel Zustimmung: „AGI is not just an ‘AI system that can do your job’. It’s literally in the name: Artificial GENERAL Intelligence.“ (AGI ist nicht nur ein „KI-System, das deinen Job machen kann“. Es steckt buchstäblich im Namen: Künstliche ALLGEMEINE Intelligenz.) Auf r/technology schrieb ein Entwickler, der nach eigenen Angaben an KI-Agenten zur Automatisierung von Desktop-Aufgaben arbeitet: „We are nowhere near AGI. Current models are great at structured reasoning but still can’t handle the kind of open-ended problem solving a junior dev does instinctively. Jensen is selling GPUs though, so the optimism makes sense.“ (Wir sind noch lange nicht bei AGI. Aktuelle Modelle sind gut in strukturiertem logischem Denken, können aber immer noch keine offenen Probleme lösen, die ein Junior-Entwickler instinktiv bewältigt. Aber Jensen verkauft GPUs, daher macht der Optimismus Sinn.) Auch auf Twitter/X gab es lebhafte Diskussionen. Der Nutzer @DefiQ7 veröffentlichte einen detaillierten Thread, der AGI klar von aktueller „spezialisierter KI“ (wie ChatGPT) abgrenzte. Er bezeichnete die Nachricht als „Atombombe für die Tech-Welt“, betonte aber auch, dass AGI „bereichsübergreifendes, autonomes Lernen, logisches Denken, Planung und Anpassung an unbekannte Szenarien“ bedeute – was weit über die aktuellen Fähigkeiten hinausgeht. Die Diskussionen auf r/BetterOffline waren noch schärfer. Ein Nutzer kommentierte: „Which is higher? The number of times Trump has achieved ‘total victory’ in Iran, or the number of times Jensen Huang has achieved ‘AGI’?“ (Was ist höher? Die Anzahl der Male, die Trump den „totalen Sieg“ im Iran errungen hat, oder die Anzahl der Male, die Jensen Huang „AGI erreicht“ hat?) Ein anderer Nutzer wies auf ein langjähriges Problem der Wissenschaft hin: „This has been a problem with Artificial Intelligence as an academic field since its very inception.“ (Dies ist ein Problem der Künstlichen Intelligenz als akademisches Feld seit ihren Anfängen.) Wie sollen normale Menschen angesichts der sich ständig ändernden AGI-Definitionen der Tech-Giganten beurteilen, wie weit die KI wirklich ist? Hier ist ein praktischer Denkrahmen: Schritt 1: Unterscheide zwischen „Leistungsdemonstration“ und „allgemeiner Intelligenz“. Die aktuellsten KI-Modelle zeigen in vielen spezifischen Aufgaben beeindruckende Leistungen. GPT-5.4 kann flüssige Artikel schreiben, und KI-Agenten können komplexe Workflows automatisieren. Aber zwischen „hervorragender Leistung in einer spezifischen Aufgabe“ und „allgemeiner Intelligenz“ klafft eine riesige Lücke. Eine KI, die den Weltmeister im Schach schlägt, kann vielleicht nicht einmal die Aufgabe bewältigen: „Reich mir mal die Tasse vom Tisch.“ Schritt 2: Achte auf die Einschränkungen, nicht auf die Schlagzeilen. Huang sagte „I think“ (Ich denke), nicht „We have proven“ (Wir haben bewiesen). Altman sagte „spiritual“ (spirituell), nicht „literal“ (wörtlich). Diese Einschränkungen sind keine Bescheidenheit, sondern präzise Rechts- und PR-Strategien. Wenn es um Verträge im Wert von Milliarden geht, wird jedes Wort genau abgewogen. Schritt 3: Schau auf die Taten, nicht auf die Proklamationen. NVIDIA hat auf der GTC 2026 sieben neue Chips vorgestellt, DLSS 5, die OpenClaw-Plattform und den NemoClaw Enterprise Agent Stack eingeführt. Das sind reale technologische Fortschritte. Aber Huang erwähnte in seiner Rede fast 40 Mal „Inferenz“ (Inference), während „Training“ nur etwa 10 Mal vorkam. Dies zeigt, dass sich der Schwerpunkt der Branche von „klügere KI bauen“ hin zu „KI Aufgaben effizienter ausführen lassen“ verschiebt. Das ist technischer Fortschritt, kein Durchbruch in der Intelligenz. Schritt 4: Baue dein eigenes Informationssystem auf. Die Informationsdichte in der KI-Branche ist extrem hoch; jede Woche gibt es wichtige Veröffentlichungen. Wer sich nur auf Clickbait-News verlässt, lässt sich leicht manipulieren. Es empfiehlt sich, regelmäßig Primärquellen zu lesen (offizielle Blogs, wissenschaftliche Arbeiten, Podcast-Transkripte) und Tools zu nutzen, um diese Informationen systematisch zu speichern. Du kannst zum Beispiel die Board-Funktion von nutzen, um wichtige Quellen zu sichern und die KI jederzeit Fragen dazu beantworten oder Daten abgleichen zu lassen, um nicht von einem einzelnen Narrativ in die Irre geführt zu werden. F: Ist die AGI, von der Jensen Huang spricht, dieselbe wie die von OpenAI definierte AGI? A: Nein. Huang antwortete basierend auf der von Lex Fridman vorgeschlagenen engen Definition (KI kann ein 1-Milliarde-Dollar-Unternehmen gründen). Die AGI in der OpenAI-Charta wird als „hochautonomes System, das den Menschen bei den meisten wirtschaftlich wertvollen Arbeiten übertreffen kann“ definiert. Die Standards klaffen weit auseinander; letztere erfordert Fähigkeiten, die weit über erstere hinausgehen. F: Kann eine aktuelle KI wirklich unabhängig ein Unternehmen führen? A: Derzeit nicht. Huang gab selbst zu, dass ein KI-Agent vielleicht eine kurzzeitig erfolgreiche App erstellen kann, aber „die Wahrscheinlichkeit, ein NVIDIA aufzubauen, bei null liegt“. Aktuelle KI ist gut in strukturierten Aufgaben, ist aber in Szenarien, die langfristiges strategisches Urteilsvermögen, bereichsübergreifende Koordination und den Umgang mit unbekannten Situationen erfordern, immer noch stark auf menschliche Anleitung angewiesen. F: Welche Auswirkungen hat das Erreichen von AGI auf die Arbeit normaler Menschen? A: Selbst nach der optimistischsten Definition zeigt sich der Einfluss der aktuellen KI vor allem in der Effizienzsteigerung spezifischer Aufgaben und nicht im vollständigen Ersatz menschlicher Arbeit. Sam Altman gab Ende 2025 zu, dass AGI „einen viel geringeren Einfluss auf die Gesellschaft hat als erwartet“. Kurzfristig wird KI eher als mächtiges Hilfsmittel die Arbeitsweise verändern, anstatt Arbeitsplätze direkt zu ersetzen. F: Warum beeilen sich die CEOs von Tech-Unternehmen so sehr, AGI für erreicht zu erklären? A: Die Gründe sind vielfältig. NVIDIAs Kerngeschäft ist der Verkauf von KI-Chips; das AGI-Narrativ hält die Begeisterung des Marktes für Investitionen in KI-Infrastruktur aufrecht. Bei OpenAI beeinflusst die AGI-Definition direkt die Verteilung von Milliardenbeträgen im Vertrag mit Microsoft. Zudem ist das Narrativ „AGI steht kurz bevor“ eine wichtige Säule für die hohen Bewertungen von KI-Unternehmen am Kapitalmarkt. F: Wie weit ist die KI-Entwicklung in China von AGI entfernt? A: China hat erhebliche Fortschritte gemacht. Bis Juni 2025 erreichte die Zahl der Nutzer von generativer KI in China 515 Millionen. Modelle wie DeepSeek oder Tongyi Qianwen schneiden in vielen Tests hervorragend ab. AGI bleibt jedoch eine globale technologische Herausforderung, und derzeit gibt es weltweit kein System, das von der Fachwelt allgemein als AGI anerkannt wird. Jensen Huangs Aussage „AGI ist erreicht“ ist im Kern eine optimistische Äußerung auf Basis einer extrem engen Definition und kein verifizierter technologischer Meilenstein. Er räumte selbst ein, dass KI-Agenten noch Lichtjahre davon entfernt sind, wirklich komplexe Unternehmen aufzubauen. Das Phänomen der sich ständig verschiebenden AGI-Definitionen offenbart das subtile Spiel der Tech-Branche zwischen technologischem Narrativ und wirtschaftlichen Interessen. Von OpenAI bis NVIDIA geht jede Verkündung mit einer heimlichen Senkung der Standards einher. Als Informationskonsumenten sollten wir nicht Schlagzeilen hinterherjagen, sondern einen eigenen Urteilsrahmen entwickeln. Die KI-Technologie macht zweifellos rasante Fortschritte. Die auf der GTC 2026 vorgestellten neuen Chips, Agent-Plattformen und Inferenz-Optimierungen sind reale technische Durchbrüche. Aber diese Fortschritte als „erreichte AGI“ zu verpacken, ist eher eine Marketingstrategie als eine wissenschaftliche Schlussfolgerung. Neugierig bleiben, kritisch hinterfragen und Primärquellen verfolgen – das ist die beste Strategie, um im Zeitalter der KI-Beschleunigung nicht in der Informationsflut unterzugehen. Möchtest du die Dynamik der KI-Branche systematisch verfolgen? Probiere aus, speichere wichtige Quellen in deiner persönlichen Wissensdatenbank und lass dir von der KI beim Organisieren, Fragenstellen und Cross-Checken helfen. [1] [2] [3] [4] [5] [6]

Der Aufstieg von AI-Influencern: Trends und Chancen, die Creator kennen müssen

TL; DR – Die wichtigsten Punkte Am 21. März 2026 postete Elon Musk auf X einen Tweet mit nur acht Wörtern: „AI bots will be more human than human.“ Dieser Tweet erhielt innerhalb von 72 Stunden über 62 Millionen Aufrufe und 580.000 Likes. Er schrieb diesen Satz als Reaktion auf ein AI-generiertes Bild eines „perfekten Influencer-Gesichts“. Dies ist keine Science-Fiction-Vorhersage. Wenn du Content Creator, Blogger oder Social-Media-Manager bist, hast du wahrscheinlich schon diese „zu perfekten“ Gesichter in deinem Feed gesehen und konntest nicht unterscheiden, ob es sich um echte Menschen oder AI handelt. Dieser Artikel zeigt dir den aktuellen Stand der virtuellen AI-Influencer, die Einkommensdaten der Top-Cases und wie du als menschlicher Creator auf diesen Wandel reagieren solltest. Dieser Artikel richtet sich an Content Creator, Social-Media-Manager, Marken-Marketer und alle Leser, die sich für AI-Trends interessieren. Schauen wir uns zunächst einige Zahlen an, die aufhorchen lassen. Der globale Markt für virtuelle Influencer erreichte im Jahr 2024 ein Volumen von 60,6 Milliarden USD und soll bis 2025 auf 83 Milliarden USD anwachsen, was einer jährlichen Wachstumsrate von über 37 % entspricht. Laut Straits Research wird diese Zahl bis 2033 auf 111,78 Milliarden USD in die Höhe schnellen. Gleichzeitig hat die gesamte Influencer-Marketing-Branche im Jahr 2025 bereits 32,55 Milliarden USD erreicht und wird 2026 voraussichtlich die 40-Milliarden-Marke überschreiten. Betrachtet man einzelne Akteure, sind zwei Fälle besonders repräsentativ: Lil Miquela gilt als die „AI-Influencerin der ersten Generation“. Dieser 2016 erschaffene virtuelle Charakter hat über 2,4 Millionen Follower auf Instagram und arbeitet mit Marken wie Prada, Calvin Klein und Samsung zusammen. Ihr Team (Teil von Dapper Labs) verlangt zehntausende Dollar pro Marken-Post. Allein die Abonnementeinnahmen auf der Plattform Fanvue belaufen sich auf 40.000 USD pro Monat. Zusammen mit Marken-Kooperationen kann ihr monatliches Einkommen 100.000 USD übersteigen. Schätzungen zufolge liegt ihr durchschnittliches Jahreseinkommen seit 2016 bei etwa 2 Millionen USD. Aitana López steht für die Möglichkeit, dass auch „Einzelunternehmer AI-Influencer erstellen können“. Das von der spanischen Kreativagentur The Clueless geschaffene virtuelle Model mit rosa Haaren hat über 370.000 Follower auf Instagram und verdient zwischen 3.000 und 10.000 EUR pro Monat. Der Grund für ihre Erschaffung war pragmatisch: Gründer Rubén Cruz war genervt von den unkalkulierbaren Faktoren menschlicher Models (Verspätungen, Absagen, Terminkonflikte) und entschied sich, „einen Influencer zu erschaffen, der niemals absagt“. Die Prognose des PR-Riesen Ogilvy für 2024 erschütterte die Branche: Bis 2026 werden virtuelle AI-Influencer 30 % der Budgets für Influencer-Marketing einnehmen. Eine Umfrage unter 1.000 leitenden Marketern in den USA und Großbritannien ergab, dass 79 % der Befragten ihre Investitionen in AI-generierte Content Creator erhöhen. Um die Dynamik dieses Wandels zu verstehen, muss man die Logik der Marken nachvollziehen. Null Risiko, volle Kontrolle. Das größte Risiko bei menschlichen Influencern ist der „Image-Schaden“. Eine unbedachte Äußerung oder ein Skandal im Privatleben kann Millioneninvestitionen einer Marke zunichtemachen. Bei virtuellen Influencern gibt es dieses Problem nicht. Sie werden nicht müde, sie altern nicht und sie posten nicht um drei Uhr morgens etwas, das das PR-Team verzweifeln lässt. Wie Rubén Cruz von The Clueless sagt: „Viele Projekte wurden wegen Problemen mit dem Influencer selbst auf Eis gelegt oder abgesagt. Das war kein Designfehler, sondern die Unberechenbarkeit des Menschen.“ Content-Produktion rund um die Uhr. Virtuelle Influencer können täglich posten, Trends in Echtzeit aufgreifen und in jedem beliebigen Szenario „erscheinen“ – und das zu Kosten, die weit unter denen eines echten Shootings liegen. Laut Berechnungen von BeyondGames könnte Lil Miquela, wenn sie täglich einen Post auf Instagram veröffentlicht, im Jahr 2026 potenzielle Einnahmen von 4,7 Millionen GBP erzielen. Diese Produktionseffizienz ist für keinen menschlichen Creator erreichbar. Präzise Markenkonsistenz. Die Zusammenarbeit von Prada mit Lil Miquela führte zu einer um 30 % höheren Interaktionsrate als bei herkömmlichen Marketingkampagnen. Jeder Gesichtsausdruck, jedes Outfit und jeder Text eines virtuellen Influencers kann präzise entworfen werden, um perfekt zur Markenidentität zu passen. Doch jede Medaille hat zwei Seiten. Ein Bericht von Business Insider vom März 2026 weist darauf hin, dass die Ablehnung von AI-Accounts bei Konsumenten steigt und einige Marken sich bereits von AI-Influencer-Strategien zurückziehen. Eine YouGov-Umfrage zeigt, dass mehr als ein Drittel der Befragten besorgt über AI-Technologie ist. Das bedeutet, dass virtuelle Influencer kein Allheilmittel sind; Authentizität bleibt ein wichtiger Faktor für Konsumenten. Angesichts des Drucks durch virtuelle AI-Influencer ist Panik sinnlos – Handeln ist gefragt. Hier sind vier bewährte Strategien: Strategie 1: Fokus auf echte Erfahrungen – Dinge tun, die AI nicht kann. AI kann perfekte Gesichter generieren, aber sie kann nicht wirklich einen Kaffee genießen oder die Erschöpfung und Zufriedenheit nach einer Wanderung spüren. In einer Diskussion auf Reddit im Subreddit r/Futurology erhielt der Kommentar eines Nutzers viel Zustimmung: „AI-Influencer können Produkte verkaufen, aber Menschen sehnen sich immer noch nach echter Verbindung.“ Mache deine realen Lebenserfahrungen, deine einzigartige Perspektive und deine unvollkommenen Momente zu deinem Content-Schutzwall. Strategie 2: Sich mit AI-Tools rüsten, statt sie zu bekämpfen. Kluge Creator nutzen bereits AI, um ihre Effizienz zu steigern. Auf Reddit teilen Creator komplette Workflows: ChatGPT für Skripte, ElevenLabs für Voiceovers und HeyGen für die Videoproduktion. Du musst kein AI-Influencer werden, aber du solltest AI zu deinem kreativen Assistenten machen. Strategie 3: Branchentrends systematisch verfolgen und Informationsvorsprung aufbauen. Die Veränderungen im Bereich der AI-Influencer sind rasant; jede Woche gibt es neue Tools, Cases und Daten. Sporadisch auf Twitter oder Reddit zu surfen, reicht bei weitem nicht aus. Mit kannst du Brancheninformationen aus verschiedenen Quellen systematisch verwalten: Speichere wichtige Artikel, Tweets und Forschungsberichte in einem Board, lass sie von der AI automatisch organisieren und durchsuchen. Du kannst deiner Materialbibliothek jederzeit Fragen stellen, wie zum Beispiel: „Was waren die drei größten Finanzierungen im Bereich der virtuellen Influencer im Jahr 2026?“. Wenn du eine Branchenanalyse schreiben oder ein Video drehen willst, ist dein Material bereits bereit, anstatt dass du bei Null anfangen musst. Strategie 4: Mensch-Maschine-Kollaboration im Content erkunden. Die Zukunft ist kein Nullsummenspiel „Mensch vs. AI“, sondern eine Symbiose aus „Mensch + AI“. Du kannst AI nutzen, um visuelles Material zu erstellen, ihm aber mit deiner menschlichen Stimme und deinen Ansichten eine Seele verleihen. Eine Analyse von zeigt, dass AI-Influencer gut für experimentelle, grenzüberschreitende Konzepte geeignet sind, während menschliche Influencer beim Aufbau tiefer Bindungen zum Publikum und bei der Festigung von Markenwerten unersetzlich bleiben. Die größte Herausforderung beim Verfolgen von AI-Influencer-Trends ist nicht zu wenig Information, sondern zu viel und zu verstreute Information. Ein typisches Szenario: Du siehst einen Tweet von Musk auf X, liest auf Reddit einen Post über das Einkommen einer AI-Influencerin, entdeckst auf Business Insider einen Tiefenbericht über den Rückzug von Marken und siehst auf YouTube ein Tutorial. Diese Informationen sind über vier Plattformen und fünf Browser-Tabs verteilt. Wenn du drei Tage später einen Artikel schreiben willst, findest du die entscheidende Zahl nicht mehr. Genau dieses Problem löst . Mit der kannst du jede Webseite, jeden Tweet oder jedes YouTube-Video mit einem Klick in dein persönliches Board speichern. Die AI extrahiert automatisch die wichtigsten Informationen und erstellt einen Index. Du kannst jederzeit mit natürlicher Sprache suchen und Fragen stellen. Erstelle zum Beispiel ein Board „AI-Influencer-Forschung“ und verwalte alle relevanten Materialien zentral. Wenn du Content produzieren musst, frage das Board direkt: „Was ist das Geschäftsmodell von Aitana López?“ oder „Welche Marken ziehen sich bereits von AI-Influencer-Strategien zurück?“. Die Antworten werden mit Links zu den Originalquellen präsentiert. Es ist wichtig zu erwähnen, dass die Stärke von YouMind in der Informationsintegration und Forschungsunterstützung liegt; es ist kein Tool zur Erstellung von AI-Influencern. Wenn du virtuelle Charaktere erstellen möchtest, benötigst du weiterhin spezialisierte Tools wie Midjourney, Stable Diffusion oder HeyGen. Aber in der Kernarbeitskette eines Creators – „Trends erforschen → Material sammeln → Content produzieren“ – kann den Weg von der Inspiration zum fertigen Produkt erheblich verkürzen. F: Werden virtuelle AI-Influencer menschliche Influencer komplett ersetzen? A: Kurzfristig nicht. Virtuelle Influencer haben Vorteile bei der Markenkontrolle und Produktionseffizienz, aber das Bedürfnis der Konsumenten nach Authentizität ist weiterhin stark. Berichte von Business Insider aus dem Jahr 2026 zeigen, dass einige Marken ihre Investitionen in AI-Influencer aufgrund von Ablehnung durch die Konsumenten bereits reduzieren. Beide werden sich wahrscheinlich eher ergänzen als gegenseitig ersetzen. F: Können normale Menschen ihre eigenen virtuellen AI-Influencer erstellen? A: Ja. Auf Reddit teilen viele Creator ihre Erfahrungen beim Start von Null. Zu den gängigen Tools gehören Midjourney oder Stable Diffusion für ein konsistentes Erscheinungsbild, ChatGPT für Texte und ElevenLabs für die Sprachgenerierung. Die Anfangsinvestition kann gering sein, erfordert aber 3 bis 6 Monate kontinuierliche Arbeit, um signifikantes Wachstum zu sehen. F: Welche Einnahmequellen haben virtuelle AI-Influencer? A: Es gibt hauptsächlich drei Kategorien: gesponserte Marken-Posts (Top-Influencer verlangen tausende bis zehntausende Dollar pro Post), Einnahmen von Abo-Plattformen (wie Fanvue) sowie Merchandising und Musikrechte. Lil Miquela verdient allein mit Abonnements durchschnittlich 40.000 USD pro Monat, die Einnahmen aus Marken-Kooperationen liegen noch höher. F: Wie ist der Stand des Marktes für virtuelle AI-Idole in China? A: China ist einer der weltweit aktivsten Märkte für virtuelle Idole. Branchenprognosen zufolge wird der chinesische Markt für virtuelle Influencer bis 2030 ein Volumen von 270 Milliarden RMB erreichen. Von Hatsune Miku und Luo Tianyi bis hin zu hyperrealistischen virtuellen Idolen hat der chinesische Markt bereits mehrere Entwicklungsphasen durchlaufen und entwickelt sich derzeit in Richtung AI-gesteuerter Echtzeit-Interaktion. F: Worauf sollten Marken bei der Zusammenarbeit mit virtuellen Influencern achten? A: Drei Punkte sind entscheidend: die Akzeptanz der Zielgruppe für virtuelle Charaktere, die Richtlinien der Plattformen zur Offenlegung von AI-Inhalten (TikTok und Instagram verschärfen hier die Anforderungen) und die Übereinstimmung des virtuellen Influencers mit der Markenidentität. Es empfiehlt sich, zunächst mit kleinen Budgets zu testen und die Investitionen basierend auf den Daten anzupassen. Der Aufstieg virtueller AI-Influencer ist keine ferne Vorhersage, sondern eine Realität, die gerade stattfindet. Marktdaten zeigen deutlich, dass der kommerzielle Wert virtueller Influencer bereits bewiesen ist – von den 2 Millionen USD Jahreseinkommen einer Lil Miquela bis zu den 10.000 EUR monatlich einer Aitana López sind diese Zahlen nicht zu ignorieren. Für menschliche Creator ist dies jedoch keine Geschichte des „Ersetztwerdens“, sondern eine Chance zur „Neupositionierung“. Deine echten Erfahrungen, deine einzigartige Perspektive und die emotionale Verbindung zu deinem Publikum sind Kernwerte, die eine AI nicht kopieren kann. Der Schlüssel liegt darin: Nutze AI-Tools zur Effizienzsteigerung, verfolge Trends mit systematischen Methoden und baue mit Authentizität eine unersetzliche Wettbewerbsbarriere auf. Möchtest du AI-Influencer-Trends systematisch verfolgen und Material für deine Kreationen sammeln? Probiere aus, um deinen persönlichen Forschungsraum aufzubauen – starte kostenlos. [1] [2] [3] [4] [5] [6] [7] [8] [9] [10] [11]