คู่มือการสร้างคอนเทนต์ภาพและข้อความจำนวนมากด้วย AI: เวิร์กโฟลว์ที่คนทำโซเชียลมีเดียต้องมี

TL; DR ประเด็นสำคัญ

- จากจำนวนคอนเทนต์ครีเอเตอร์กว่า 207 ล้านคนทั่วโลก 91% เริ่มใช้งาน Generative AI เพื่อเพิ่มประสิทธิภาพในการผลิตผลงานแล้ว โดยผู้ที่ใช้งานอย่างเชี่ยวชาญสามารถเพิ่มประสิทธิภาพได้ถึง 3-5 เท่า

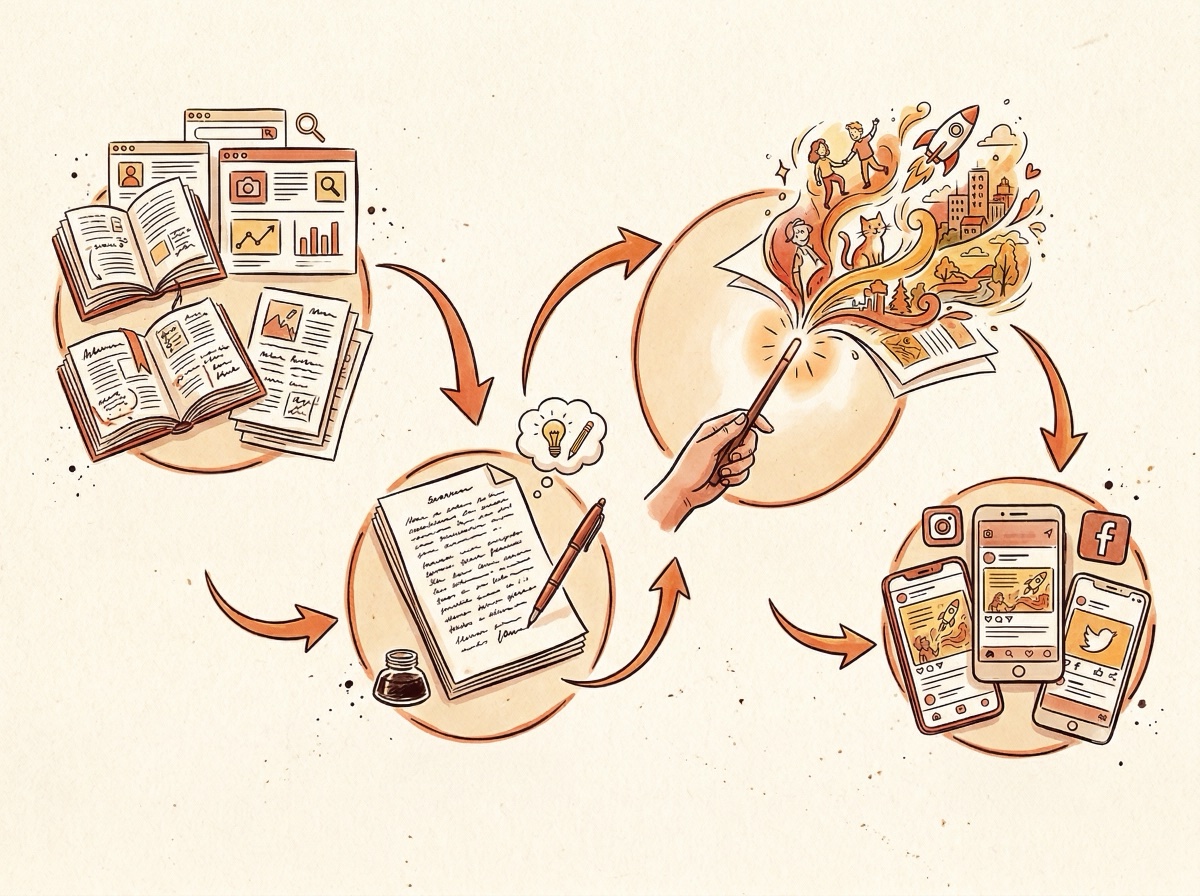

- หัวใจสำคัญของการสร้างคอนเทนต์รูปภาพและข้อความ (Graphic & Text) ปริมาณมากด้วย AI ไม่ใช่การ "หาเครื่องมือที่ดีที่สุด" แต่คือการสร้างเวิร์กโฟลว์ที่สมบูรณ์ตั้งแต่ "การรวบรวมวัตถุดิบ → การสร้างเรื่องราว → การทำภาพประกอบ → การกระจายไปยังหลายแพลตฟอร์ม"

- หนังสือนิทานเด็ก, คอนเทนต์ให้ความรู้แบบรูปภาพ, การ์ดความรู้ เป็นจุดเริ่มต้นที่ดีที่สุดสำหรับการสร้างผลงานปริมาณมากด้วย AI ซึ่งปัจจุบันการที่คนคนเดียวผลิตคอนเทนต์คุณภาพสูงได้ 10-20 ชุดต่อวันได้กลายเป็นเรื่องจริงแล้ว

- ความสม่ำเสมอของตัวละคร, สไตล์ที่สอดคล้อง และการปฏิบัติตามกฎหมายลิขสิทธิ์ คือ 3 ความท้าทายหลักในการสร้างคอนเทนต์ด้วย AI ซึ่งในบทความนี้มีแนวทางแก้ไขปัญหาที่ชัดเจนมาให้ด้วย

ความเร็วในการผลิตคอนเทนต์ของคุณ กำลังถูกคู่แข่งทิ้งห่าง

ความจริงที่น่ากลัวคือ: ในขณะที่คุณยังคงแก้ไขภาพประกอบสำหรับโพสต์เดียวซ้ำไปซ้ำมา คู่แข่งของคุณอาจใช้เครื่องมือ AI วางแผนและผลิตคอนเทนต์สำหรับทั้งสัปดาห์เสร็จเรียบร้อยแล้ว

จากข้อมูลอุตสาหกรรมเมื่อต้นปี 2026 ตลาดการสร้างคอนเทนต์ด้วย AI ทั่วโลกมีมูลค่าสูงถึง 2.408 หมื่นล้านดอลลาร์สหรัฐ เติบโตขึ้นกว่า 21% เมื่อเทียบกับปีก่อนหน้า 1 สิ่งที่น่าจับตามองยิ่งกว่าคือการเปลี่ยนแปลงในตลาดระดับภูมิภาค: ทีมโซเชียลมีเดียที่ใช้ AI อย่างจริงจังมีประสิทธิภาพการผลิตคอนเทนต์เพิ่มขึ้นเฉลี่ย 3-5 เท่า ขั้นตอนการวางแผนหัวข้อ, การหาข้อมูล และการออกแบบภาพที่เคยใช้เวลาเป็นสัปดาห์ ปัจจุบันสามารถย่นระยะเวลาเหลือเพียง 1-2 วันเท่านั้น 2

บทความนี้เหมาะสำหรับผู้ดูแลโซเชียลมีเดีย, คอนเทนต์ครีเอเตอร์ที่เน้นงานภาพและข้อความ รวมถึงผู้ที่ต้องการใช้ AI สร้างนิทานหรือเรื่องราวสำหรับเด็ก คุณจะได้รับเวิร์กโฟลว์การผลิตคอนเทนต์ปริมาณมากด้วย AI ที่ผ่านการพิสูจน์แล้ว พร้อมคำแนะนำในทุกขั้นตอนตั้งแต่การรวบรวมวัตถุดิบไปจนถึงผลงานสำเร็จรูป

ทำไม "คอนเทนต์รูปภาพและข้อความ" ถึงเป็นจุดเริ่มต้นที่ดีที่สุดสำหรับการผลิตด้วย AI

ครีเอเตอร์หลายคนเมื่อเริ่มสัมผัสเครื่องมือ AI มักจะลองเขียนบทความยาวๆ หรือทำวิดีโอก่อน แต่หากมองจากมุมมองของความคุ้มค่า (ROI) คอนเทนต์ประเภทรูปภาพประกอบข้อความคือหมวดหมู่ที่ทำระบบอัตโนมัติได้ง่ายที่สุด

เหตุผลมี 3 ประการ: อย่างแรกคือ ห่วงโซ่การผลิตสั้น คอนเทนต์ประเภทนี้ต้องการเพียง "ข้อความ + ภาพประกอบ" ซึ่ง AI มีความเชี่ยวชาญในทั้งสองส่วนนี้อย่างมาก อย่างที่สองคือ มีความยืดหยุ่นสูง หากภาพประกอบที่สร้างด้วย AI มีข้อบกพร่องเล็กน้อย มักจะไม่ถูกสังเกตเห็นในฟีดโซเชียลมีเดีย แต่ถ้าเป็นวิดีโอที่ AI สร้างแล้วตัวละครเบี้ยว ผู้ชมจะสังเกตเห็นทันที อย่างที่สามคือ ช่องทางการเผยแพร่หลากหลาย คอนเทนต์ชุดเดียวสามารถโพสต์ลง Instagram, Facebook, Lemon8 หรือแพลตฟอร์มอื่นๆ ได้พร้อมกัน โดยมีต้นทุนส่วนเพิ่มที่ต่ำมาก

นิทานเด็กและคอนเทนต์ให้ความรู้เป็นสองสาขาที่เหมาะมากสำหรับการผลิตปริมาณมากด้วย AI ตัวอย่างเช่น กรณีศึกษาที่ถูกพูดถึงอย่างกว้างขวาง ครีเอเตอร์คนหนึ่งใช้ ChatGPT สร้างเนื้อเรื่อง และใช้ Midjourney สร้างภาพประกอบ จนสามารถวางขายหนังสือนิทานเด็กเรื่อง "Alice and Sparkle" บน Amazon ได้สำเร็จ 3 นอกจากนี้ยังมีครีเอเตอร์ที่ใช้การผสมผสานระหว่าง "Doubao + Jimeng AI" ทำช่องนิทานเด็กบนโซเชียลมีเดียจนมียอดผู้ติดตามเพิ่มขึ้นกว่า 1 แสนคนภายในเดือนเดียว

ตรรกะเบื้องหลังความสำเร็จเหล่านี้คือ: เทคโนโลยีการสร้างเรื่องราวและนิทานด้วย AI พัฒนาไปจนถึงจุดที่รองรับการทำธุรกิจได้แล้ว กุญแจสำคัญอยู่ที่ว่าคุณมีเวิร์กโฟลว์ที่มีประสิทธิภาพหรือไม่

4 ความท้าทายหลักในการผลิตคอนเทนต์ปริมาณมาก

ก่อนที่คุณจะเริ่มลงมือทำ มาทำความเข้าใจกับ 4 ปัญหาที่พบบ่อยที่สุดในการผลิตคอนเทนต์ด้วย AI ซึ่งในชุมชน r/KDP ของ Reddit และฟอรั่มครีเอเตอร์ต่างๆ มักจะมีการหยิบยกประเด็นเหล่านี้มาพูดถึงซ้ำๆ 4

ความท้าทายที่ 1: ความสม่ำเสมอของตัวละคร (Character Consistency) นี่คือปัญหาที่น่าปวดหัวที่สุดเมื่อใช้ AI สร้างนิทาน คุณสั่งให้ AI วาดเด็กหญิงหมวกแดง รูปแรกอาจจะเป็นหน้ากลมผมสั้น รูปที่สองอาจกลายเป็นตากลมโตผมยาว Sachin Kamath นักวิเคราะห์ภาพประกอบบน X (Twitter) ระบุว่า หลังจากศึกษาภาพนิทานจาก AI กว่า 1,000 ภาพ พบว่าครีเอเตอร์มักสนใจแค่ว่าภาพ "สวยไหม" แต่ละเลยคำถามที่สำคัญกว่าคือ "รักษาความต่อเนื่องได้ไหม"

ความท้าทายที่ 2: เครื่องมือที่กระจัดกระจาย เวิร์กโฟลว์ปกติอาจต้องใช้ 5-6 เครื่องมือ: ใช้ ChatGPT เขียนบทความ, Midjourney เจนภาพ, Canva จัดเลย์เอาต์, CapCut ใส่ซับไตเติ้ล และโพสต์ผ่านหลังบ้านของแต่ละแพลตฟอร์ม ทุกครั้งที่เปลี่ยนเครื่องมือ สมาธิ (Flow State) ของคุณจะถูกขัดจังหวะ ทำให้สูญเสียประสิทธิภาพอย่างมหาศาล

ความท้าทายที่ 3: คุณภาพที่ไม่คงที่ คุณภาพของ AI นั้นไม่แน่นอน Prompt เดียวกัน วันนี้อาจได้ภาพที่น่าทึ่ง แต่วันพรุ่งนี้อาจได้ภาพคนที่มี 6 นิ้ว ในการผลิตปริมาณมาก ต้นทุนเวลาในการควบคุมคุณภาพมักจะถูกประเมินต่ำเกินไป

ความท้าทายที่ 4: พื้นที่สีเทาด้านลิขสิทธิ์ รายงานปี 2025 จากสำนักงานลิขสิทธิ์แห่งสหรัฐอเมริการะบุชัดเจนว่า คอนเทนต์ที่สร้างโดย AI ล้วนๆ โดยไม่มีการสร้างสรรค์จากมนุษย์อย่างเพียงพอ จะไม่ได้รับความคุ้มครองทางลิขสิทธิ์ 5 นั่นหมายความว่าหากคุณวางแผนจะทำนิทานเพื่อการค้า คุณต้องมั่นใจว่ามีการแก้ไขและใส่ความคิดสร้างสรรค์จากมนุษย์ลงไปอย่างเพียงพอ

5 ขั้นตอนสร้างเวิร์กโฟลว์การผลิตคอนเทนต์ด้วย AI

เมื่อเข้าใจความท้าทายแล้ว นี่คือเวิร์กโฟลว์ 5 ขั้นตอนที่ผ่านการใช้งานจริงมาแล้ว แนวคิดหลักคือ: ใช้พื้นที่ทำงานที่รวมทุกอย่างไว้ในที่เดียวเพื่อลดการสลับเครื่องมือ

ขั้นตอนที่ 1: สร้างคลังแรงบันดาลใจ การผลิตปริมาณมากต้องมีวัตถุดิบที่เพียงพอ คุณต้องการที่สำหรับเก็บการวิเคราะห์คู่แข่ง, หัวข้อที่กำลังฮิต, รูปภาพอ้างอิง และตัวอย่างสไตล์ ครีเอเตอร์หลายคนใช้ Bookmark หรือเซฟในแอปแชท แต่ข้อมูลมักจะกระจัดกระจาย วิธีที่ดีกว่าคือใช้เครื่องมือจัดการความรู้ที่สามารถเก็บหน้าเว็บ, PDF, รูปภาพ และวิดีโอไว้ด้วยกัน และใช้ AI ค้นหาข้อมูลได้รวดเร็ว เช่น ใน YouMind คุณสามารถเก็บคอนเทนต์ยอดนิยมของคู่แข่ง, สไตล์นิทานอ้างอิง และรายงานวิเคราะห์กลุ่มเป้าหมายไว้ใน Board เดียวกัน แล้วถาม AI ได้โดยตรงว่า "ตัวละครที่พบบ่อยที่สุดในนิทานเหล่านี้คืออะไร" หรือ "โทนสีไหนที่มีส่วนร่วมสูงสุดในกลุ่มแม่และเด็ก" AI จะวิเคราะห์จากข้อมูลทั้งหมดที่คุณรวบรวมไว้

ขั้นตอนที่ 2: สร้างโครงร่างเนื้อหาปริมาณมาก เมื่อมีคลังข้อมูลแล้ว ขั้นตอนต่อไปคือการสร้างบทความ ตัวอย่างเช่นนิทานเด็ก คุณสามารถกำหนดธีมซีรีส์ (เช่น "การผจญภัย 4 ฤดูของสุนัขจิ้งจอกน้อย") แล้วให้ AI สร้างโครงเรื่อง 10-20 เรื่องในครั้งเดียว โดยแต่ละเรื่องประกอบด้วยตัวเอก, ฉาก, ปมปัญหา และตอนจบ เทคนิคสำคัญคือการระบุ Character Sheet ใน Prompt ซึ่งรวมถึงลักษณะภายนอก, นิสัย และคำพูดติดปาก เพื่อให้การเจนภาพในภายหลังมีความสม่ำเสมอ

ขั้นตอนที่ 3: สร้างภาพประกอบในสไตล์ที่สอดคล้อง ขั้นตอนนี้เป็นส่วนที่ใช้เทคนิคมากที่สุด เครื่องมือเจนภาพ AI ในปี 2026 สามารถจัดการความสม่ำเสมอของตัวละครได้ดีขึ้นมาก ในทางปฏิบัติ แนะนำให้ใช้ Prompt หนึ่งเพื่อสร้างภาพอ้างอิงตัวละคร (Character Reference) ก่อน แล้วจึงอ้างอิงภาพนี้ใน Prompt ของภาพประกอบถัดๆ ไป เครื่องมือที่รองรับเวิร์กโฟลว์นี้ ได้แก่ Midjourney (ผ่านพารามิเตอร์ --cref), Recraft AI (ผ่านฟีเจอร์ Style Lock) เป็นต้น ความสามารถในการเจนภาพใน YouMind รองรับหลายโมเดล เช่น Nano Banana Pro, Seedream 4.5, GPT Image 1.5 คุณสามารถเปรียบเทียบผลลัพธ์จากโมเดลต่างๆ ในพื้นที่ทำงานเดียวเพื่อเลือกสไตล์ที่เหมาะสมที่สุด โดยไม่ต้องสลับไปมาหลายเว็บไซต์

ขั้นตอนที่ 4: การประกอบร่างและตรวจสอบคุณภาพ หลังจากรวมข้อความและภาพประกอบเข้าด้วยกันแล้ว ต้องมีการตรวจสอบโดยมนุษย์เสมอ โดยเน้น 3 ด้าน: ความสม่ำเสมอของตัวละครในแต่ละฉาก, ข้อผิดพลาดทางตรรกะในเนื้อหา (เช่น พล็อตที่ขัดแย้งกันเอง) และร่องรอยที่ผิดปกติจาก AI ในภาพ (นิ้วเกิน, ตัวอักษรเบี้ยว) ขั้นตอนนี้ข้ามไม่ได้ เพราะเป็นตัวตัดสินว่าคอนเทนต์ของคุณคือ "ขยะ AI" หรือ "คอนเทนต์คุณภาพสูงที่ช่วยสร้างโดย AI"

ขั้นตอนที่ 5: ปรับรูปแบบและกระจายไปยังหลายแพลตฟอร์ม คอนเทนต์ชุดเดียวกันต้องการรูปแบบที่ต่างกันในแต่ละแพลตฟอร์ม เช่น Lemon8 ชอบภาพแนวตั้ง (3:4) พร้อมข้อความสั้น, Facebook ต้องการภาพหน้าปกแนวนอนพร้อมบทความยาว ในการผลิตปริมาณมาก แนะนำให้เจนภาพหลายสัดส่วนตั้งแต่ขั้นตอนการสร้างภาพเลย แทนที่จะมาครอปภาพในภายหลัง

วิธีเลือกเครื่องมือสร้างคอนเทนต์ด้วย AI

ปัจจุบันมีเครื่องมือ AI จำนวนมหาศาล TechTarget ได้รวบรวมไว้กว่า 35 รายการในปี 2026 6 สำหรับการผลิตคอนเทนต์ปริมาณมาก ควรพิจารณาจาก 3 มิติ: รองรับการทำงานทั้งภาพและข้อความในที่เดียวไหม, สลับโมเดลได้หลากหลายไหม และมีระบบเวิร์กโฟลว์อัตโนมัติเพื่อลดขั้นตอนที่ซ้ำซ้อนไหม

เครื่องมือ | เหมาะสำหรับ | เวอร์ชันฟรี | จุดเด่น |

|---|---|---|---|

วิจัยข้อมูล + สร้างคอนเทนต์ครบวงจร | ✅ | เจนภาพหลายโมเดล + จัดการความรู้ + Agent Workflow จบในที่เดียวตั้งแต่รวบรวมข้อมูลจนถึงผลิตผลงาน | |

จัดเลย์เอาต์และออกแบบเทมเพลต | ✅ | เทมเพลตมหาศาล เหมาะสำหรับการจัดหน้าอย่างรวดเร็ว แต่ความสามารถในการเจนภาพ AI ยังมีจำกัด | |

สร้างนิทานเด็กโดยเฉพาะ | มีโควตาทดลอง | เน้นนิทาน ความสม่ำเสมอของตัวละครดี แต่จำกัดอยู่แค่หมวดนิทาน | |

หนังสือนิทานเด็กเฉพาะบุคคล | ✅ | ใช้งานง่าย เหมาะสำหรับผู้ปกครองและครู แต่ความสามารถในการผลิตปริมาณมากยังไม่สูง |

ต้องชี้แจงว่า YouMind เชี่ยวชาญในด้าน "ตั้งแต่การวิจัยไปจนถึงการสร้างสรรค์" หากความต้องการของคุณคือการเจนภาพประกอบเพียงภาพเดียว เครื่องมือเฉพาะทางอย่าง Midjourney อาจมีคุณภาพของภาพที่เหนือกว่า แต่คุณค่าที่แตกต่างของ YouMind คือ: คุณสามารถรวบรวมข้อมูล, วิจัยด้วย AI, เขียนบทความ, เจนภาพจากหลายโมเดล หรือแม้แต่สร้างเวิร์กโฟลว์อัตโนมัติผ่านฟีเจอร์ Skills เพื่อเปลี่ยนขั้นตอนที่ซ้ำซากให้กลายเป็นงานที่ Agent ทำแทนได้ในคลิกเดียว

FAQ

Q: นิทานเด็กที่สร้างด้วย AI สามารถใช้ในเชิงพาณิชย์ได้หรือไม่?

A: ได้ แต่มีเงื่อนไข แนวทางปี 2025 ของสำนักงานลิขสิทธิ์สหรัฐฯ ระบุว่าคอนเทนต์จาก AI ต้องมี "การสร้างสรรค์จากมนุษย์อย่างเพียงพอ" ถึงจะได้รับความคุ้มครองลิขสิทธิ์ ในทางปฏิบัติ คุณต้องแก้ไขเนื้อหาที่ AI เจนขึ้นมาอย่างมีนัยสำคัญ ปรับแต่งภาพประกอบ และเก็บบันทึกขั้นตอนการสร้างสรรค์ไว้ เมื่อเผยแพร่บนแพลตฟอร์มอย่าง Amazon KDP ต้องระบุตามจริงว่ามีการใช้ AI ช่วยสร้าง

Q: คนเดียวใช้ AI ผลิตคอนเทนต์ได้วันละเท่าไหร่?

A: ขึ้นอยู่กับประเภทและคุณภาพ หากเป็นนิทานเด็ก เมื่อมีเวิร์กโฟลว์ที่นิ่งแล้ว คนเดียวสามารถผลิตได้ 10-20 ชุดต่อวัน (แต่ละชุดมี 6-8 ภาพ + เนื้อเรื่องสมบูรณ์) แต่ตัวเลขนี้ตั้งอยู่บนเงื่อนไขที่คุณมีตัวละครและเทมเพลตสไตล์ที่แน่นอนแล้ว ในช่วงเริ่มต้นแนะนำให้เริ่มที่ 3-5 ชุดต่อวันเพื่อปรับจูนระบบ

Q: คอนเทนต์จาก AI จะถูกแพลตฟอร์มปิดกั้นการมองเห็น (Shadowban) ไหม?

A: Google ระบุชัดเจนในปี 2025 ว่าการจัดอันดับการค้นหาให้ความสำคัญกับคุณภาพเนื้อหาและสัญญาณ E-E-A-T (ประสบการณ์, ความเชี่ยวชาญ, อำนาจหน้าที่, ความน่าเชื่อถือ) ไม่ใช่ว่าเนื้อหานั้นสร้างโดย AI หรือไม่ 7 แพลตฟอร์มอื่นๆ ก็มีทัศนคติคล้ายกัน ตราบใดที่เนื้อหามีประโยชน์ต่อผู้ใช้ ไม่ใช่การสแปมคุณภาพต่ำ คอนเทนต์ที่ใช้ AI ช่วยจะไม่ถูกปิดกั้น กุญแจสำคัญคือต้องมีการตรวจสอบและปรับแต่งโดยมนุษย์เสมอ

Q: เริ่มต้นทำช่องนิทาน AI ต้องใช้เงินเท่าไหร่?

A: แทบจะเริ่มได้ด้วยต้นทุนศูนย์ เครื่องมือ AI ส่วนใหญ่มีโควตาฟรีให้ทดสอบและวางระบบ เมื่อคุณมั่นใจในทิศทางและผลตอบรับจากผู้ชมแล้ว ค่อยเลือกแพลนที่เสียเงินตามปริมาณการใช้งาน อย่าง YouMind เวอร์ชันฟรีก็ครอบคลุมการเจนภาพและสร้างเอกสารพื้นฐานแล้ว ส่วน แพลนแบบชำระเงิน จะให้ตัวเลือกโมเดลที่มากขึ้นและโควตาการใช้งานที่สูงขึ้น

สรุป

การผลิตคอนเทนต์ปริมาณมากด้วย AI ในปี 2026 ไม่ใช่คำถามที่ว่า "ทำได้ไหม" แต่เป็น "จะทำอย่างไรให้มีประสิทธิภาพมากกว่าคนอื่น"

จำไว้ 3 ประเด็นหลัก: อย่างแรก เวิร์กโฟลว์สำคัญกว่าเครื่องมือ อย่าเสียเวลาเปรียบเทียบว่าเครื่องมือไหนดีที่สุด แต่จงสร้างระบบที่สมบูรณ์ตั้งแต่ต้นจนจบ อย่างที่สอง การตรวจสอบโดยมนุษย์คือบรรทัดฐานของคุณภาพ AI ช่วยเพิ่มความเร็ว มนุษย์ช่วยคัดกรอง อย่างที่สาม เริ่มจากจุดเล็กๆ แล้วพัฒนาอย่างรวดเร็ว เลือกหมวดหมู่เฉพาะทาง (เช่น นิทานก่อนนอน) แล้วใช้เครื่องมือง่ายๆ รันระบบให้ผ่านก่อน แล้วค่อยขยายผล

หากคุณกำลังมองหาแพลตฟอร์มที่ครอบคลุมตั้งแต่ "การวิจัยวัตถุดิบ → การสร้างเนื้อหา → การเจนภาพ AI → เวิร์กโฟลว์อัตโนมัติ" ลองใช้งาน YouMind ได้ฟรี เพื่อเริ่มสร้างสายการผลิตคอนเทนต์ของคุณจาก Board เดียว

ข้อมูลอ้างอิง

[1] รายงานตลาดการสร้างคอนเทนต์ด้วย Generative AI ทั่วโลก (2026-2035)

[2] AI พลิกโฉมระบบนิเวศโซเชียลมีเดีย: สมุดปกขาวเทรนด์ กลยุทธ์ และการปฏิบัติปี 2025

[3] กรณีศึกษาการใช้ AI ทำหนังสือนิทานเด็กที่กำลังเป็นกระแส

[4] Reddit r/KDP: การสนทนาเกี่ยวกับเครื่องมือวาดภาพประกอบนิทานเด็กด้วย AI ที่ดีที่สุด

[5] วิธีสร้างเครื่องมือเจนภาพประกอบนิทานเด็กด้วย AI (MindStudio Tutorial)

[6] 35 เครื่องมือสร้างคอนเทนต์ด้วย AI ที่น่าจับตามองในปี 2026 (TechTarget)

[7] แพลตฟอร์มสร้างคอนเทนต์ด้วย AI ระดับท็อปในปี 2026 (Clarity Ventures)

มีคำถามเกี่ยวกับบทความนี้ไหม?

ถาม AI ฟรีบทความที่เกี่ยวข้อง

เจาะลึกผลทดสอบ GPT Image 2 ที่หลุดออกมา: เหนือกว่า Nano Banana Pro ในการทดสอบแบบ Blind Test หรือไม่?

ประเด็นสำคัญ (TL; DR) เมื่อวันที่ 4 เมษายน 2026 Pieter Levels ( @levelsio) นักพัฒนาอิสระได้ออกมาเปิดเผยข้อมูลบน X เป็นคนแรกว่า: มีโมเดลสร้างภาพปริศนา 3 ตัวปรากฏขึ้นบนแพลตฟอร์ม Arena Blind Test โดยใช้ชื่อรหัสว่า maskingtape-alpha, gaffertape-alpha และ packingtape-alpha ชื่อเหล่านี้ฟังดูเหมือนชั้นวางเทปกาวในร้านฮาร์ดแวร์ แต่คุณภาพของภาพที่สร้างออกมานั้นทำให้ชุมชน AI ถึงกับตื่นตะลึง บทความนี้เหมาะสำหรับครีเอเตอร์ นักออกแบบ และผู้ที่ชื่นชอบเทคโนโลยีที่กำลังติดตามความเคลื่อนไหวล่าสุดในวงการ AI Image Generation หากคุณเคยใช้ Nano Banana Pro หรือ GPT Image 1.5 บทความนี้จะช่วยให้คุณเข้าใจระดับความสามารถที่แท้จริงของโมเดลรุ่นถัดไปได้อย่างรวดเร็ว กระทู้สนทนาในห้อง r/singularity บน Reddit ได้รับคะแนนโหวตถึง 366 คะแนนและมีความคิดเห็นมากกว่า 200 รายการภายใน 24 ชั่วโมง โดยผู้ใช้ชื่อ ThunderBeanage โพสต์ว่า: "จากการทดสอบของผม โมเดลนี้มันบ้าไปแล้ว มันเหนือกว่า Nano Banana มาก" เบาะแสที่สำคัญยิ่งกว่าคือ: เมื่อผู้ใช้ถามถึงตัวตนของโมเดลโดยตรง มันตอบว่ามาจาก OpenAI ที่มาของภาพ: ภาพสกรีนช็อตการทดสอบ GPT Image 2 บน Arena ที่หลุดออกมาเป็นครั้งแรกโดย @levelsio หากคุณใช้ AI สร้างภาพเป็นประจำ คุณคงซึ้งดีว่า: การทำให้โมเดลเรนเดอร์ข้อความในภาพให้ถูกต้องนั้นเป็นปัญหาที่น่าปวดหัวที่สุดมาโดยตลอด ทั้งการสะกดผิด ตัวอักษรบิดเบี้ยว หรือการจัดวางที่สับสน ซึ่งเป็นปัญหาที่พบได้ในเกือบทุกโมเดล แต่การก้าวกระโดดของ GPT Image 2 ในด้านนี้กลายเป็นประเด็นหลักที่ชุมชนพูดถึงกันมากที่สุด @PlayingGodAGI ได้แชร์ภาพทดสอบที่น่าทึ่ง 2 ภาพ: ภาพแรกคือแผนผังอนาโตมีกล้ามเนื้อส่วนหน้าของมนุษย์ ซึ่งการระบุตำแหน่งกล้ามเนื้อ กระดูก เส้นประสาท และหลอดเลือดแต่ละส่วนนั้นมีความแม่นยำระดับตำราเรียน ส่วนอีกภาพคือภาพสกรีนช็อตหน้าแรกของ YouTube ที่องค์ประกอบ UI, ภาพตัวอย่างวิดีโอ และข้อความพาดหัวไม่มีความผิดเพี้ยนเลย เขาเขียนในโพสต์ว่า: "สิ่งนี้ได้กำจัดจุดอ่อนสุดท้ายของการสร้างภาพด้วย AI ไปแล้ว" ที่มาของภาพ: การเปรียบเทียบภาพแผนผังอนาโตมีและสกรีนช็อต YouTube โดย @PlayingGodAGI คำวิจารณ์ของ @avocadoai_co นั้นตรงไปตรงมามากกว่า: "การเรนเดอร์ข้อความมันบ้าไปแล้ว (The text rendering is just absolutely insane)" @0xRajat ยังระบุด้วยว่า: "ความรู้รอบตัวของโมเดลนี้ดีจนน่ากลัว การเรนเดอร์ข้อความเกือบจะสมบูรณ์แบบ หากคุณเคยใช้โมเดลสร้างภาพใดๆ มาก่อน คุณจะรู้ว่าปัญหานี้มันฝังรากลึกแค่ไหน" ที่มาของภาพ: ผลการทดสอบการจำลองอินเทอร์เฟซเว็บไซต์โดยบล็อกเกอร์ชาวญี่ปุ่น @masahirochaen บล็อกเกอร์ชาวญี่ปุ่น @masahirochaen ก็ได้ทำการทดสอบอิสระเช่นกัน และยืนยันว่าโมเดลนี้ทำผลงานได้ยอดเยี่ยมในการบรรยายโลกแห่งความเป็นจริงและการจำลองอินเทอร์เฟซเว็บไซต์ แม้แต่การเรนเดอร์ตัวอักษรคานะและคันจิของญี่ปุ่นก็ยังถูกต้อง ผู้ใช้ Reddit ก็สังเกตเห็นจุดนี้เช่นกัน โดยให้ความเห็นว่า "สิ่งที่ทำให้ผมประทับใจคือ ทั้งตัวอักษรคันจิและคาตาคานะต่างก็ใช้งานได้จริง" นี่คือคำถามที่ทุกคนให้ความสนใจมากที่สุด: GPT Image 2 เหนือกว่า Nano Banana Pro จริงหรือ? @AHSEUVOU15 ได้ทำการทดสอบเปรียบเทียบภาพ 3 ภาพอย่างชัดเจน โดยนำผลลัพธ์จาก Nano Banana Pro, GPT Image 2 (จากการทดสอบ A/B) และ GPT Image 1.5 มาวางเรียงกัน ที่มาของภาพ: การเปรียบเทียบ 3 ภาพโดย @AHSEUVOU15 เรียงจากขวาไปซ้ายคือ NBP, GPT Image 2 และ GPT Image 1.5 ข้อสรุปของ @AHSEUVOU15 ค่อนข้างระมัดระวัง: "ในกรณีนี้ NBP ยังคงดีกว่า แต่ GPT Image 2 มีความก้าวหน้าอย่างชัดเจนเมื่อเทียบกับ 1.5" สิ่งนี้แสดงให้เห็นว่าช่องว่างระหว่างทั้งสองโมเดลนั้นแคบลงมาก และผลแพ้ชนะขึ้นอยู่กับประเภทของ Prompt ที่ใช้ จากรายงานเชิงลึกของ OfficeChai การทดสอบของชุมชนได้เผยรายละเอียดเพิ่มเติม : @socialwithaayan ได้แชร์ภาพถ่ายเซลฟี่บนชายหาดและสกรีนช็อต Minecraft ที่ช่วยยืนยันการค้นพบเหล่านี้เพิ่มเติม โดยเขาสรุปว่า: "ในที่สุดการเรนเดอร์ข้อความก็ใช้งานได้จริง ความรู้รอบตัวและความสมจริงอยู่ในอีกระดับหนึ่งเลย" ที่มาของภาพ: ผลการสร้างสกรีนช็อตเกม Minecraft โดย GPT Image 2 แชร์โดย @socialwithaayan [9](https://x.com/socialwithaayan/status/2040434305487507475) GPT Image 2 ใช่ว่าจะไม่มีจุดอ่อน รายงานจาก OfficeChai ระบุว่าโมเดลนี้ยังคงล้มเหลวในการทดสอบการสะท้อนของรูบิคในกระจก (Rubik's Cube reflection test) ซึ่งเป็นการทดสอบความกดดันแบบคลาสสิกในวงการสร้างภาพ เพื่อดูว่าโมเดลเข้าใจความสัมพันธ์ของภาพสะท้อนในพื้นที่สามมิติหรือไม่ โดยการเรนเดอร์เงาสะท้อนของรูบิคในกระจกให้ถูกต้อง ความคิดเห็นจากผู้ใช้ Reddit ก็ยืนยันเรื่องนี้เช่นกัน มีคนพบจากการทดสอบ "ออกแบบสิ่งมีชีวิตชนิดใหม่ที่สามารถดำรงอยู่ได้ในระบบนิเวศจริง" ว่าแม้โมเดลจะสามารถสร้างภาพที่มีความซับซ้อนทางสายตาอย่างมาก แต่ตรรกะเชิงพื้นที่ภายในนั้นไม่ได้มีความสอดคล้องกันเสมอไป ดังที่ผู้ใช้รายหนึ่งกล่าวว่า: "โมเดล Text-to-Image โดยพื้นฐานแล้วคือเครื่องสังเคราะห์ภาพ ไม่ใช่เครื่องจำลองทางชีวภาพ" นอกจากนี้ รุ่นทดสอบ Blind Test ยุคแรก (รหัส Chestnut และ Hazelnut) ที่ 36Kr เคยรายงานไปก่อนหน้านี้ เคยได้รับคำวิจารณ์ว่า "ดูเหมือนพลาสติกเกินไป" อย่างไรก็ตาม จากความคิดเห็นของชุมชนเกี่ยวกับซีรีส์ tape ล่าสุด ดูเหมือนว่าปัญหานี้จะได้รับการปรับปรุงให้ดีขึ้นอย่างเห็นได้ชัด ช่วงเวลาที่ GPT Image 2 หลุดออกมานั้นน่าสนใจมาก เมื่อวันที่ 24 มีนาคม 2026 OpenAI ได้ประกาศระงับ Sora แอปพลิเคชันสร้างวิดีโอที่เพิ่งเปิดตัวได้เพียง 6 เดือน Disney เพิ่งทราบข่าวนี้ไม่ถึงหนึ่งชั่วโมงก่อนการประกาศ ซึ่งในขณะนั้น Sora ต้องใช้ต้นทุนการประมวลผลประมาณ 1 ล้านดอลลาร์ต่อวัน และจำนวนผู้ใช้ลดลงจากจุดสูงสุดที่ 1 ล้านคนเหลือไม่ถึง 5 แสนคน การระงับ Sora ช่วยคืนทรัพยากรการประมวลผลจำนวนมาก บทวิเคราะห์จาก OfficeChai เชื่อว่าโมเดลสร้างภาพรุ่นถัดไปคือปลายทางที่สมเหตุสมผลที่สุดสำหรับทรัพยากรเหล่านี้ GPT Image 1.5 ของ OpenAI เคยขึ้นสู่อันดับหนึ่งในตารางอันดับภาพของ LMArena เมื่อเดือนธันวาคม 2025 แซงหน้า Nano Banana Pro ไปแล้ว หากซีรีส์ tape คือ GPT Image 2 จริงๆ นั่นหมายความว่า OpenAI กำลังทุ่มเดิมพันเป็นสองเท่าในด้าน AI สำหรับผู้บริโภค ซึ่งเป็น "สาขาเดียวที่ยังมีความเป็นไปได้ในการสร้างกระแสไวรัลในวงกว้าง" เป็นที่น่าสังเกตว่าโมเดล tape ทั้งสามถูกนำออกจาก LMArena แล้ว ผู้ใช้ Reddit เชื่อว่านี่อาจหมายถึงการเปิดตัวอย่างเป็นทางการที่กำลังจะมาถึง เมื่อประกอบกับโรดแมปที่แพร่สะพัดก่อนหน้านี้ โมเดลสร้างภาพรุ่นใหม่มีความเป็นไปได้สูงที่จะเปิดตัวพร้อมกับ GPT-5.2 ตามข่าวลือ แม้ว่า GPT Image 2 จะยังไม่เปิดตัวอย่างเป็นทางการ แต่คุณสามารถเตรียมความพร้อมได้ด้วยเครื่องมือที่มีอยู่ในปัจจุบัน: ข้อควรระวังคือ ประสิทธิภาพของโมเดลในการทดสอบ Arena Blind Test อาจแตกต่างจากเวอร์ชันที่เปิดตัวจริง เนื่องจากโมเดลในช่วง Blind Test มักจะยังอยู่ในขั้นตอนการปรับจูน ดังนั้นการตั้งค่าพารามิเตอร์และชุดฟีเจอร์สุดท้ายอาจมีการเปลี่ยนแปลง ถาม: GPT Image 2 จะเปิดตัวอย่างเป็นทางการเมื่อไหร่? ตอบ: OpenAI ยังไม่ได้ยืนยันการมีอยู่ของ GPT Image 2 อย่างเป็นทางการ แต่การที่โมเดลรหัส tape ทั้งสามถูกนำออกจาก Arena ทำให้ชุมชนเชื่อว่าเป็นสัญญาณของการเปิดตัวภายใน 1 ถึง 3 สัปดาห์ เมื่อพิจารณาจากข่าวลือการเปิดตัว GPT-5.2 คาดว่าอย่างเร็วที่สุดอาจเป็นช่วงกลางถึงปลายเดือนเมษายน 2026 ถาม: GPT Image 2 และ Nano Banana Pro อันไหนดีกว่ากัน? ตอบ: ผลการทดสอบ Blind Test ในปัจจุบันแสดงให้เห็นว่าทั้งสองมีจุดเด่นต่างกัน GPT Image 2 นำหน้าในด้านการเรนเดอร์ข้อความ, การจำลอง UI และความรู้รอบตัว ส่วน Nano Banana Pro ยังคงทำได้ดีกว่าในด้านคุณภาพของภาพโดยรวมในบางสถานการณ์ ข้อสรุปสุดท้ายจำเป็นต้องรอการทดสอบระบบในสเกลที่ใหญ่ขึ้นหลังจากการเปิดตัวเวอร์ชันจริง ถาม: maskingtape-alpha, gaffertape-alpha และ packingtape-alpha แตกต่างกันอย่างไร? ตอบ: ชื่อรหัสทั้งสามนี้อาจหมายถึงการกำหนดค่าหรือเวอร์ชันที่แตกต่างกันของโมเดลเดียวกัน จากการทดสอบของชุมชน maskingtape-alpha ทำผลงานได้โดดเด่นที่สุดในการทดสอบสกรีนช็อต Minecraft แต่โดยรวมแล้วทั้งสามมีระดับความสามารถที่ใกล้เคียงกัน รูปแบบการตั้งชื่อสอดคล้องกับซีรีส์ gpt-image ก่อนหน้านี้ของ OpenAI ถาม: สามารถทดลองใช้ GPT Image 2 ได้ที่ไหน? ตอบ: ปัจจุบัน GPT Image 2 ยังไม่เปิดให้ใช้งานทั่วไป และโมเดล tape ทั้งสามก็ได้ถูกนำออกจาก Arena แล้ว คุณสามารถติดตาม เพื่อรอให้โมเดลกลับมาออนไลน์อีกครั้ง หรือรอการประกาศอย่างเป็นทางการจาก OpenAI เพื่อใช้งานผ่าน ChatGPT หรือ API ถาม: ทำไมการเรนเดอร์ข้อความในโมเดล AI Image Generation ถึงเป็นปัญหามาโดยตลอด? ตอบ: โมเดล Diffusion แบบดั้งเดิมสร้างภาพในระดับพิกเซล ซึ่งไม่ถนัดในการสร้างเนื้อหาที่ต้องการความแม่นยำของเส้นและการเว้นวรรคอย่างข้อความ ซีรีส์ GPT Image ใช้สถาปัตยกรรมแบบ Autoregressive แทนที่จะเป็นโมเดล Diffusion บริสุทธิ์ ทำให้สามารถเข้าใจความหมายและโครงสร้างของข้อความได้ดีกว่า จึงเกิดความก้าวหน้าอย่างมากในการเรนเดอร์ข้อความ การหลุดข้อมูลของ GPT Image 2 เป็นสัญญาณว่าการแข่งขันในวงการ AI Image Generation ได้เข้าสู่เฟสใหม่แล้ว จุดอ่อนเรื้อรังอย่างการเรนเดอร์ข้อความและความรู้รอบตัวกำลังถูกแก้ไขอย่างรวดเร็ว และ Nano Banana Pro ไม่ใช่มาตรฐานเพียงหนึ่งเดียวอีกต่อไป แม้การให้เหตุผลเชิงพื้นที่ยังคงเป็นจุดอ่อนร่วมของทุกโมเดล แต่ความเร็วในการพัฒนานั้นเหนือกว่าที่คาดไว้มาก สำหรับผู้ใช้ AI สร้างภาพ ตอนนี้เป็นเวลาที่ดีที่สุดในการสร้างระบบการประเมินของตัวเอง ลองใช้ Prompt ชุดเดียวกันทดสอบข้ามโมเดล บันทึกสถานการณ์ที่แต่ละโมเดลทำได้ดี เพื่อที่ว่าเมื่อ GPT Image 2 เปิดตัวอย่างเป็นทางการ คุณจะสามารถตัดสินใจได้อย่างแม่นยำในทันที ต้องการจัดการ Prompt และผลการทดสอบ AI สร้างภาพของคุณอย่างเป็นระบบหรือไม่? ลองใช้ เพื่อบันทึกผลลัพธ์จากโมเดลต่างๆ ลงใน Board เดียวกัน เพื่อเปรียบเทียบและย้อนกลับมาดูได้ทุกเมื่อ [1] [2] [3] [4] [5] [6] [7] [8] [9] [10]

Jensen Huang ประกาศ "บรรลุเป้าหมาย AGI แล้ว": ความจริง, ข้อโต้แย้ง และการวิเคราะห์เจาะลึก

TL; DR ประเด็นสำคัญ วันที่ 23 มีนาคม 2026 ข่าวหนึ่งได้กลายเป็นประเด็นร้อนบนโซเชียลมีเดีย เมื่อ Jensen Huang CEO ของ NVIDIA ได้กล่าวประโยคที่ว่า: "I think we've achieved AGI." (ผมคิดว่าเราบรรลุ AGI แล้ว) ในพอดแคสต์ของ Lex Fridman ทวีตนี้จาก Polymarket ได้รับการกดไลก์มากกว่า 1.6 หมื่นครั้งและมียอดเข้าชมถึง 4.7 ล้านครั้ง โดยสื่อเทคโนโลยีกระแสหลักอย่าง The Verge, Forbes และ Mashable ต่างรายงานข่าวนี้อย่างหนาหูภายในไม่กี่ชั่วโมง บทความนี้เหมาะสำหรับผู้อ่านทุกคนที่ติดตามเทรนด์การพัฒนา AI ไม่ว่าคุณจะเป็นบุคลากรสายเทคนิค นักลงทุน หรือคนทั่วไปที่สนใจในปัญญาประดิษฐ์ เราจะมาย้อนดูบริบททั้งหมดของคำประกาศนี้ ถอดรหัส "เกมคำศัพท์" ของนิยาม AGI และวิเคราะห์ว่ามันมีความหมายอย่างไรต่ออุตสาหกรรม AI ทั้งระบบ แต่ถ้าคุณตัดสินใจจากเพียงแค่พาดหัวข่าว คุณจะพลาดส่วนที่สำคัญที่สุดของเรื่องราวนี้ไป การจะเข้าใจน้ำหนักของประโยคนี้จาก Jensen Huang ต้องเริ่มจากการดูเงื่อนไขเบื้องต้นก่อน Lex Fridman พิธีกรพอดแคสต์ได้ให้นิยาม AGI ที่เฉพาะเจาะจงมากว่า: ระบบ AI จะสามารถ "ทำงานแทนคุณ" ได้หรือไม่ ซึ่งหมายถึงการก่อตั้ง พัฒนา และบริหารจัดการบริษัทเทคโนโลยีที่มีมูลค่ามากกว่า 1 พันล้านดอลลาร์ เขาถาม Jensen Huang ว่า AGI แบบนี้ยังห่างไกลจากเราแค่ไหน 5 ปี? 10 ปี? หรือ 20 ปี? คำตอบของ Jensen Huang คือ: "I think it's now." (ผมคิดว่ามันคือตอนนี้แหละ) การวิเคราะห์เชิงลึกจาก Mashable ได้ชี้ให้เห็นรายละเอียดสำคัญ Jensen Huang บอกกับ Fridman ว่า: "You said a billion, and you didn't say forever." (คุณบอกว่าพันล้าน และคุณไม่ได้บอกว่าต้องคงอยู่ตลอดไป) พูดอีกอย่างคือ ในการตีความของ Jensen Huang ขอเพียงแค่ AI สามารถสร้าง App ที่เป็นไวรัล ทำเงินได้ 1 พันล้านดอลลาร์ในช่วงสั้นๆ แล้วปิดตัวลง ก็ถือว่า "บรรลุ AGI" แล้ว เขาได้ยกตัวอย่าง OpenClaw ซึ่งเป็นแพลตฟอร์ม AI Agent แบบโอเพนซอร์ส Jensen Huang จินตนาการถึงสถานการณ์ที่ AI สร้างบริการเว็บง่ายๆ ขึ้นมา แล้วมีคนหลายพันล้านคนยอมจ่ายคนละ 50 เซนต์เพื่อใช้งาน จากนั้นบริการนั้นก็หายไปอย่างเงียบๆ เขายังเปรียบเทียบกับเว็บไซต์ในยุคฟองสบู่ดอทคอม โดยมองว่าความซับซ้อนของเว็บไซต์เหล่านั้นในตอนนั้น ไม่ได้สูงไปกว่าสิ่งที่ AI Agent ในปัจจุบันสามารถสร้างขึ้นมาได้เลย จากนั้น เขาได้พูดประโยคที่พาดหัวข่าวส่วนใหญ่มักจะมองข้ามไป: "The odds of 100,000 of those agents building NVIDIA is zero percent." (โอกาสที่ Agent แบบนี้ 100,000 ตัวจะสร้าง NVIDIA ขึ้นมาได้นั้นเป็นศูนย์) นี่ไม่ใช่เพียงหมายเหตุเล็กๆ ดังที่ Mashable ให้ความเห็นว่า: "That's not a small caveat. It's the whole ballgame." (นี่ไม่ใช่ข้อแม้เล็กๆ แต่มันคือประเด็นสำคัญทั้งหมดของเรื่องนี้) Jensen Huang ไม่ใช่ผู้นำเทคโนโลยีคนแรกที่ประกาศว่า "บรรลุ AGI แล้ว" การจะเข้าใจคำประกาศนี้ จำเป็นต้องวางมันไว้ในบริบทการเล่าเรื่องของอุตสาหกรรมที่ใหญ่กว่า ในปี 2023 Jensen Huang เคยให้นิยาม AGI ที่แตกต่างออกไปในงาน DealBook Summit ของ New York Times ว่า: ซอฟต์แวร์ที่สามารถผ่านการทดสอบปัญญาประดิษฐ์ต่างๆ ที่ใกล้เคียงกับมนุษย์ได้ในระดับความสามารถที่สมเหตุสมผล ในตอนนั้นเขาคาดการณ์ว่า AI จะบรรลุมาตรฐานนี้ภายใน 5 ปี ในเดือนธันวาคม 2025 Sam Altman CEO ของ OpenAI ระบุว่า "we built AGIs" (เราสร้าง AGI ขึ้นมาแล้ว) และกล่าวว่า "AGI kinda went whooshing by" (AGI ดูเหมือนจะผ่านไปอย่างรวดเร็ว) โดยผลกระทบต่อสังคมน้อยกว่าที่คาดไว้มาก และแนะนำให้อุตสาหกรรมเปลี่ยนไปนิยาม "Superintelligence" แทน ในเดือนกุมภาพันธ์ 2026 Altman บอกกับ Forbes อีกครั้งว่า: "We basically have built AGI, or very close to it." (โดยพื้นฐานแล้วเราได้สร้าง AGI ขึ้นมาแล้ว หรือใกล้เคียงมากแล้ว) แต่หลังจากนั้นเขาเสริมว่านี่เป็นการแสดงออกใน "ระดับจิตวิญญาณ" ไม่ใช่ความหมายตามตัวอักษร และชี้ให้เห็นว่า AGI ยังต้องการ "การบุกเบิกในระดับกลางอีกมากมาย" เห็นรูปแบบหรือยัง? ทุกครั้งที่มีคำประกาศว่า "บรรลุ AGI แล้ว" มักจะมาพร้อมกับการลดระดับนิยามลงอย่างเงียบๆ กฎบัตรการก่อตั้งของ OpenAI นิยาม AGI ว่าเป็น "ระบบที่มีความเป็นอิสระสูงซึ่งมีความสามารถเหนือกว่ามนุษย์ในงานที่มีมูลค่าทางเศรษฐกิจส่วนใหญ่" นิยามนี้มีความสำคัญเพราะในสัญญาของ OpenAI กับ Microsoft มีข้อกำหนดเรื่องการเปิดใช้งาน AGI (AGI trigger clause) รวมอยู่ด้วย: เมื่อมีการตัดสินว่าบรรลุ AGI แล้ว สิทธิ์ในการเข้าถึงเทคโนโลยีของ OpenAI โดย Microsoft จะเกิดการเปลี่ยนแปลงครั้งใหญ่ ตามรายงานของ Reuters ข้อตกลงใหม่ระบุว่าต้องมีการตรวจสอบโดยคณะผู้เชี่ยวชาญอิสระว่าบรรลุ AGI หรือไม่ โดย Microsoft จะยังคงถือหุ้น 27% และมีสิทธิ์ในการใช้เทคโนโลยีบางส่วนจนถึงปี 2032 เมื่อผลประโยชน์มูลค่าหลายหมื่นล้านดอลลาร์ผูกติดอยู่กับคำศัพท์ที่คลุมเครือ "ใครจะเป็นคนนิยาม AGI" จึงไม่ใช่ปัญหาทางวิชาการอีกต่อไป แต่เป็นเกมการเดิมพันทางธุรกิจ หากการรายงานข่าวของสื่อเทคโนโลยียังถือว่าอยู่ในระดับที่สำรวม ปฏิกิริยาบนโซเชียลมีเดียกลับแสดงให้เห็นถึงความหลากหลายที่แตกต่างกันอย่างสิ้นเชิง ในชุมชน Reddit อย่าง r/singularity, r/technology และ r/BetterOffline มีกระทู้สนทนาเกิดขึ้นมากมายอย่างรวดเร็ว ความเห็นหนึ่งจากผู้ใช้ r/singularity ได้รับการกดถูกใจอย่างสูง: "AGI is not just an 'AI system that can do your job'. It's literally in the name: Artificial GENERAL Intelligence." (AGI ไม่ใช่แค่ 'ระบบ AI ที่ทำงานแทนคุณได้' แต่มันอยู่ในชื่อของมันเลย: ปัญญาประดิษฐ์ทั่วไป) บน r/technology นักพัฒนาคนหนึ่งที่ระบุว่าตนเองกำลังสร้าง AI Agent เพื่อทำงานบนเดสก์ท็อปแบบอัตโนมัติเขียนว่า: "We are nowhere near AGI. Current models are great at structured reasoning but still can't handle the kind of open-ended problem solving a junior dev does instinctively. Jensen is selling GPUs though, so the optimism makes sense." (เรายังไม่ใกล้เคียง AGI เลยแม้แต่น้อย โมเดลปัจจุบันเก่งเรื่องการให้เหตุผลแบบมีโครงสร้าง แต่ยังไม่สามารถจัดการกับการแก้ปัญหาแบบปลายเปิดที่นักพัฒนาระดับจูเนียร์ทำได้โดยสัญชาตญาณ อย่างไรก็ตาม Jensen กำลังขาย GPU อยู่ ดังนั้นความมองโลกในแง่ดีนี้จึงดูสมเหตุสมผล) การสนทนาในภาษาจีนบน Twitter/X ก็คึกคักไม่แพ้กัน ผู้ใช้ @DefiQ7 ได้โพสต์ให้ความรู้โดยละเอียด โดยแยกแยะความแตกต่างระหว่าง AGI กับ "AI เฉพาะทาง" ในปัจจุบัน (เช่น ChatGPT, Ernie Bot) อย่างชัดเจน และได้รับการรีทวีตอย่างกว้างขวาง โพสต์ระบุว่า: "นี่คือข่าวระดับระเบิดนิวเคลียร์ในวงการเทคโนโลยี" แต่ก็เน้นย้ำว่า AGI หมายถึง "ความสามารถข้ามโดเมน การเรียนรู้ด้วยตนเอง การให้เหตุผล การวางแผน และการปรับตัวเข้ากับสถานการณ์ที่ไม่รู้จัก" ซึ่งไม่ใช่ขอบเขตความสามารถของ AI ในปัจจุบัน ส่วนการสนทนาบน r/BetterOffline นั้นรุนแรงกว่า ผู้ใช้รายหนึ่งให้ความเห็นว่า: "Which is higher? The number of times Trump has achieved 'total victory' in Iran, or the number of times Jensen Huang has achieved 'AGI'?" (อันไหนสูงกว่ากัน? จำนวนครั้งที่ Trump บรรลุ 'ชัยชนะเบ็ดเสร็จ' ในอิหร่าน หรือจำนวนครั้งที่ Jensen Huang บรรลุ 'AGI'?) ผู้ใช้อีกรายชี้ให้เห็นถึงปัญหาที่ค้างคาในวงการวิชาการมาอย่างยาวนาน: "This has been a problem with Artificial Intelligence as an academic field since its very inception." (นี่เป็นปัญหาของปัญญาประดิษฐ์ในฐานะสาขาวิชาการมาตั้งแต่เริ่มก่อตั้ง) เมื่อต้องเผชิญกับนิยาม AGI ที่เปลี่ยนแปลงตลอดเวลาของเหล่ายักษ์ใหญ่เทคโนโลยี คนทั่วไปควรตัดสินอย่างไรว่า AI พัฒนาไปถึงระดับไหนแล้ว? ต่อไปนี้คือกรอบความคิดที่เป็นประโยชน์ ขั้นตอนที่ 1: แยกแยะระหว่าง "การแสดงความสามารถ" และ "ปัญญาประดิษฐ์ทั่วไป" โมเดล AI ที่ล้ำสมัยที่สุดในปัจจุบันแสดงผลงานได้อย่างน่าทึ่งในงานเฉพาะทางหลายอย่าง GPT-5.4 สามารถเขียนบทความที่สละสลวย AI Agent สามารถรันเวิร์กโฟลว์ที่ซับซ้อนได้โดยอัตโนมัติ แต่ระหว่าง "การทำผลงานได้ดีในงานเฉพาะทาง" กับ "การมีปัญญาประดิษฐ์ทั่วไป" นั้นมีช่องว่างขนาดใหญ่อยู่ AI ที่สามารถเอาชนะแชมป์โลกหมากรุกได้ อาจจะไม่สามารถแม้แต่จะทำเรื่องง่ายๆ อย่าง "หยิบแก้วน้ำบนโต๊ะมาให้ฉันหน่อย" ขั้นตอนที่ 2: ให้ความสำคัญกับคำขยายความ ไม่ใช่พาดหัวข่าว Jensen Huang พูดว่า "I think" (ผมคิดว่า) ไม่ใช่ "We have proven" (เราได้พิสูจน์แล้ว) Altman พูดว่า "spiritual" (ในเชิงจิตวิญญาณ) ไม่ใช่ "literal" (ตามตัวอักษร) คำขยายความเหล่านี้ไม่ใช่ความถ่อมตัว แต่เป็นกลยุทธ์ทางกฎหมายและประชาสัมพันธ์ที่แม่นยำ เมื่อเกี่ยวข้องกับข้อสัญญาที่มีมูลค่าหลายหมื่นล้านดอลลาร์ ทุกคำพูดล้วนผ่านการไตร่ตรองมาอย่างดี ขั้นตอนที่ 3: ดูที่การกระทำ ไม่ใช่คำประกาศ NVIDIA ได้เปิดตัวชิปใหม่ 7 รุ่นในงาน GTC 2026 พร้อมเปิดตัว DLSS 5, แพลตฟอร์ม OpenClaw และ NemoClaw สำหรับ Enterprise Agent Stack สิ่งเหล่านี้คือความก้าวหน้าทางเทคโนโลยีที่จับต้องได้ แต่ในสุนทรพจน์ของ Jensen Huang เขาพูดถึงคำว่า "การอนุมาน" (inference) เกือบ 40 ครั้ง ในขณะที่พูดถึง "การฝึกฝน" (training) เพียง 10 กว่าครั้ง สิ่งนี้แสดงให้เห็นว่าจุดสนใจของอุตสาหกรรมกำลังเปลี่ยนจากการ "สร้าง AI ที่ฉลาดขึ้น" ไปสู่การ "ทำให้ AI ทำงานได้อย่างมีประสิทธิภาพมากขึ้น" นี่คือความก้าวหน้าทางวิศวกรรม ไม่ใช่การก้าวกระโดดของสติปัญญา ขั้นตอนที่ 4: สร้างระบบติดตามข้อมูลของตัวเอง ความหนาแน่นของข้อมูลในอุตสาหกรรม AI นั้นสูงมาก มีการเปิดตัวและคำประกาศสำคัญทุกสัปดาห์ หากพึ่งพาเพียงการแจ้งเตือนข่าวแบบพาดหัวข่าว ก็จะถูกจูงจมูกได้ง่าย แนะนำให้สร้างนิสัยในการอ่านแหล่งข้อมูลชั้นต้นเป็นประจำ (เช่น บล็อกทางการของบริษัท, งานวิจัยทางวิชาการ, บทถอดความพอดแคสต์) และใช้เครื่องมือในการบันทึกและจัดระเบียบข้อมูลเหล่านี้อย่างเป็นระบบ ตัวอย่างเช่น คุณสามารถใช้ฟีเจอร์ Board ของ เพื่อบันทึกแหล่งข้อมูลสำคัญ และใช้ AI ในการตั้งคำถามและตรวจสอบข้อมูลเหล่านี้ได้ทุกเมื่อ เพื่อหลีกเลี่ยงการถูกชี้นำโดยการเล่าเรื่องเพียงด้านเดียว Q: AGI ที่ Jensen Huang พูดถึง กับ AGI ที่ OpenAI นิยาม เป็นเรื่องเดียวกันหรือไม่? A: ไม่ใช่ Jensen Huang ตอบคำถามโดยอิงตามนิยามที่แคบซึ่ง Lex Fridman เสนอ (AI สามารถก่อตั้งบริษัทมูลค่า 1 พันล้านดอลลาร์ได้) ในขณะที่นิยาม AGI ในกฎบัตรของ OpenAI คือ "ระบบที่มีความเป็นอิสระสูงซึ่งมีความสามารถเหนือกว่ามนุษย์ในงานที่มีมูลค่าทางเศรษฐกิจส่วนใหญ่" มาตรฐานของทั้งสองมีความแตกต่างกันอย่างมาก โดยนิยามหลังต้องการขอบเขตความสามารถที่เหนือกว่านิยามแรกมาก Q: ปัจจุบัน AI สามารถบริหารบริษัทได้อย่างอิสระจริงหรือไม่? A: ปัจจุบันยังทำไม่ได้ Jensen Huang เองก็ยอมรับว่า AI Agent อาจสร้างแอปพลิเคชันที่ดังเปรี้ยงปร้างในช่วงสั้นๆ ได้ แต่ "โอกาสที่จะสร้าง NVIDIA ขึ้นมาได้นั้นเป็นศูนย์" AI ในปัจจุบันเก่งในการรันงานที่มีโครงสร้าง แต่ในสถานการณ์ที่ต้องใช้การตัดสินใจเชิงกลยุทธ์ระยะยาว การประสานงานข้ามโดเมน และการรับมือกับสถานการณ์ที่ไม่แน่นอน ยังคงต้องพึ่งพาการชี้แนะจากมนุษย์อย่างมาก Q: การบรรลุ AGI จะส่งผลกระทบต่องานของคนทั่วไปอย่างไร? A: แม้จะใช้นิยามที่มองโลกในแง่ดีที่สุด ผลกระทบของ AI ในปัจจุบันส่วนใหญ่จะอยู่ที่การเพิ่มประสิทธิภาพในงานเฉพาะด้าน มากกว่าการเข้ามาแทนที่งานของมนุษย์ทั้งหมด Sam Altman เองก็ยอมรับในช่วงปลายปี 2025 ว่า AGI "ส่งผลกระทบต่อสังคมน้อยกว่าที่คาดไว้มาก" ในระยะสั้น AI มีแนวโน้มที่จะเปลี่ยนวิธีการทำงานในฐานะเครื่องมือช่วยที่ทรงพลัง มากกว่าการเข้ามาแทนที่ตำแหน่งงานโดยตรง Q: ทำไม CEO ของบริษัทเทคโนโลยีต่างๆ ถึงรีบประกาศว่าบรรลุ AGI แล้ว? A: มีเหตุผลหลายประการ ธุรกิจหลักของ NVIDIA คือการขายชิปประมวลผล AI การเล่าเรื่องเรื่อง AGI จะช่วยรักษาความกระตือรือร้นของตลาดในการลงทุนโครงสร้างพื้นฐาน AI ส่วนสัญญาของ OpenAI กับ Microsoft ก็มีข้อกำหนดเรื่อง AGI ซึ่งนิยามของ AGI จะส่งผลโดยตรงต่อการจัดสรรผลประโยชน์มูลค่าหลายหมื่นล้านดอลลาร์ นอกจากนี้ ในตลาดทุน การเล่าเรื่องว่า "AGI กำลังจะมาถึง" เป็นเสาหลักสำคัญในการพยุงมูลค่าบริษัท AI ที่สูงลิ่ว Q: การพัฒนา AI ของจีนยังห่างไกลจาก AGI แค่ไหน? A: จีนมีความก้าวหน้าอย่างมากในด้าน AI ณ เดือนมิถุนายน 2025 จำนวนผู้ใช้ Generative AI ในจีนสูงถึง 515 ล้านคน โมเดลขนาดใหญ่อย่าง DeepSeek และ Tongyi Qianwen ทำผลงานได้ดีเยี่ยมในการทดสอบหลายรายการ อย่างไรก็ตาม AGI เป็นความท้าทายทางเทคโนโลยีระดับโลก และปัจจุบันยังไม่มีระบบ AGI ใดในโลกที่ได้รับการยอมรับอย่างกว้างขวางจากวงการวิชาการ คาดว่าอัตราการเติบโตเฉลี่ยต่อปี (CAGR) ของอุตสาหกรรม AI ในจีนช่วงปี 2025-2035 จะอยู่ที่ 30.6%-47.1% ซึ่งถือว่ามีแรงส่งที่แข็งแกร่งมาก คำประกาศ "บรรลุ AGI แล้ว" ของ Jensen Huang โดยเนื้อแท้แล้วเป็นการแสดงท่าทีในแง่ดีบนพื้นฐานของนิยามที่แคบมาก มากกว่าจะเป็นหมุดหมายทางเทคโนโลยีที่ผ่านการพิสูจน์แล้ว ตัวเขาเองก็ยอมรับว่า AI Agent ในปัจจุบันยังห่างไกลจากการสร้างองค์กรที่มีความซับซ้อนอย่างแท้จริง ปรากฏการณ์การ "เลื่อนเสาประตู" ของนิยาม AGI ซ้ำแล้วซ้ำเล่า เผยให้เห็นถึงเกมการเดิมพันที่ละเอียดอ่อนระหว่างการเล่าเรื่องทางเทคโนโลยีและผลประโยชน์ทางธุรกิจของอุตสาหกรรมเทคโนโลยี ตั้งแต่ OpenAI ไปจนถึง NVIDIA ทุกครั้งที่มีคำประกาศว่า "เราบรรลุ AGI แล้ว" มักจะมาพร้อมกับการลดระดับมาตรฐานนิยามลงอย่างเงียบๆ ในฐานะผู้บริโภคข้อมูล สิ่งที่เราต้องการไม่ใช่การวิ่งตามพาดหัวข่าว แต่เป็นการสร้างกรอบการตัดสินใจของตัวเอง เทคโนโลยี AI กำลังก้าวหน้าอย่างรวดเร็วอย่างไม่ต้องสงสัย ชิปใหม่ แพลตฟอร์ม Agent และเทคโนโลยีการเพิ่มประสิทธิภาพการอนุมานที่เปิดตัวในงาน GTC 2026 ล้วนเป็นความก้าวหน้าทางวิศวกรรมที่จับต้องได้ แต่การนำความก้าวหน้าเหล่านี้มาแพ็กเกจว่าเป็น "การบรรลุ AGI แล้ว" เป็นเพียงกลยุทธ์การเล่าเรื่องทางการตลาดมากกว่าจะเป็นข้อสรุปทางวิทยาศาสตร์ การรักษาความอยากรู้อยากเห็น การมีวิจารณญาณ และการติดตามแหล่งข้อมูลชั้นต้นอย่างต่อเนื่อง คือกลยุทธ์ที่ดีที่สุดในการไม่ให้จมหายไปในกระแสข้อมูลในยุค AI เร่งสปีดนี้ ต้องการติดตามความเคลื่อนไหวของอุตสาหกรรม AI อย่างเป็นระบบใช่ไหม? ลองใช้ เพื่อบันทึกแหล่งข้อมูลสำคัญลงในคลังความรู้ส่วนตัวของคุณ และให้ AI ช่วยคุณจัดระเบียบ ตั้งคำถาม และตรวจสอบข้อมูลข้ามแหล่งได้ทันที [1] [2] [3] [4] [5] [6]

การเติบโตของ AI Influencer: เทรนด์และโอกาสที่เหล่าครีเอเตอร์ต้องรู้

TL; DR ประเด็นสำคัญ วันที่ 21 มีนาคม 2026 Elon Musk ได้โพสต์ข้อความบน X เพียงแปดคำว่า: “AI bots will be more human than human.” โพสต์นี้มียอดเข้าชมมากกว่า 62 ล้านครั้งและ 580,000 ไลก์ภายใน 72 ชั่วโมง เขาเขียนประโยคนี้เพื่อตอบโต้รูปภาพ "ใบหน้าอินฟลูเอนเซอร์ที่สมบูรณ์แบบ" ที่สร้างโดย AI นี่ไม่ใช่คำทำนายในนิยายวิทยาศาสตร์ หากคุณเป็นคอนเทนต์ครีเอเตอร์ บล็อกเกอร์ หรือผู้ดูแลโซเชียลมีเดีย คุณอาจเคยเห็นใบหน้าที่ "สมบูรณ์แบบเกินไป" ในฟีดข่าวของคุณมาบ้างแล้ว โดยที่แยกไม่ออกว่าเป็นคนจริงหรือ AI บทความนี้จะพาคุณไปทำความเข้าใจสถานการณ์จริงของ AI Influencer ข้อมูลรายได้ของเคสระดับท็อป และในฐานะครีเอเตอร์ที่เป็นมนุษย์ คุณควรรับมือกับการเปลี่ยนแปลงนี้อย่างไร บทความนี้เหมาะสำหรับคอนเทนต์ครีเอเตอร์, นักการตลาดโซเชียลมีเดีย, นักการตลาดแบรนด์ และผู้อ่านทุกคนที่สนใจในเทรนด์ AI มาดูตัวเลขที่น่าตกใจกันก่อน ขนาดตลาดอินฟลูเอนเซอร์เสมือนจริงทั่วโลกแตะ 6.06 พันล้านดอลลาร์ในปี 2024 และคาดว่าจะเติบโตเป็น 8.3 พันล้านดอลลาร์ในปี 2025 โดยมีอัตราการเติบโตต่อปีมากกว่า 37% จากการคาดการณ์ของ Straits Research ตัวเลขนี้จะพุ่งสูงถึง 111,780 ล้านดอลลาร์ภายในปี 2033 ในขณะเดียวกัน อุตสาหกรรมการตลาดอินฟลูเอนเซอร์โดยรวมในปี 2025 แตะระดับ 32,550 ล้านดอลลาร์ และคาดว่าจะทะลุ 40,000 ล้านดอลลาร์ในปี 2026 หากดูเป็นรายบุคคล มีสองกรณีศึกษาที่เป็นตัวแทนที่น่าสนใจมาก Lil Miquela ได้รับการยอมรับว่าเป็น "AI Influencer ยุคแรก" ตัวละครเสมือนจริงที่เกิดในปี 2016 นี้ มีผู้ติดตามมากกว่า 2.4 ล้านคนบน Instagram และได้ร่วมงานกับแบรนด์ดังอย่าง Prada, Calvin Klein และ Samsung ทีมงานของเธอ (ภายใต้ Dapper Labs) คิดค่าบริการโพสต์แบรนด์ละหลายหมื่นดอลลาร์ เฉพาะรายได้จากการสมัครสมาชิกบนแพลตฟอร์ม Fanvue ก็สูงถึง 40,000 ดอลลาร์ต่อเดือน เมื่อรวมกับความร่วมมือกับแบรนด์ รายได้ต่อเดือนอาจเกิน 100,000 ดอลลาร์ มีการประมาณการว่ารายได้เฉลี่ยต่อปีของเธอตั้งแต่ปี 2016 อยู่ที่ประมาณ 2 ล้านดอลลาร์ Aitana López เป็นตัวแทนของความเป็นไปได้ที่ "ผู้ประกอบการรายย่อยก็สร้าง AI Influencer ได้" นางแบบเสมือนจริงผมสีชมพูที่สร้างโดยเอเจนซี่สร้างสรรค์ The Clueless จากสเปน มีผู้ติดตามมากกว่า 370,000 คนบน Instagram และมีรายได้ระหว่าง 3,000 ถึง 10,000 ยูโรต่อเดือน เหตุผลในการสร้างเธอนั้นเป็นไปในเชิงปฏิบัติมาก: Rubén Cruz ผู้ก่อตั้งเบื่อหน่ายกับปัจจัยที่ควบคุมไม่ได้ของนางแบบที่เป็นคนจริง (มาสาย, ยกเลิกงาน, ตารางงานชนกัน) จึงตัดสินใจ "สร้างอินฟลูเอนเซอร์ที่ไม่เคยผิดนัด" การคาดการณ์ของ Ogilvy ยักษ์ใหญ่ด้าน PR ในปี 2024 ยิ่งสร้างความสั่นสะเทือนให้กับอุตสาหกรรม: ภายในปี 2026 AI Influencer จะครองส่วนแบ่งงบประมาณการตลาดอินฟลูเอนเซอร์ถึง 30% ผลสำรวจนักการตลาดระดับสูง 1,000 คนในอังกฤษและอเมริกาพบว่า 79% ของผู้ตอบแบบสอบถามระบุว่าพวกเขากำลังเพิ่มการลงทุนในครีเอเตอร์ที่สร้างคอนเทนต์ด้วย AI การเข้าใจตรรกะของแบรนด์จะช่วยให้เห็นแรงขับเคลื่อนพื้นฐานของการเปลี่ยนแปลงนี้ ความเสี่ยงเป็นศูนย์ ควบคุมได้ทั้งหมด ความเสี่ยงที่ใหญ่ที่สุดของอินฟลูเอนเซอร์ที่เป็นคนจริงคือ "ภาพลักษณ์พัง" คำพูดที่ไม่เหมาะสมเพียงครั้งเดียว หรือข่าวฉาวในชีวิตส่วนตัว อาจทำให้เงินลงทุนหลายล้านของแบรนด์ละลายหายไป แต่อินฟลูเอนเซอร์เสมือนจริงไม่มีปัญหานี้ พวกเขาไม่เหนื่อย ไม่แก่ และไม่โพสต์ข้อความตอนตีสามที่ทำให้ทีม PR ต้องปวดหัว ดังที่ Rubén Cruz ผู้ก่อตั้ง The Clueless กล่าวว่า: "หลายโปรเจกต์ต้องถูกระงับหรือยกเลิกเพราะปัญหาของตัวอินฟลูเอนเซอร์เอง นี่ไม่ใช่ความผิดพลาดในระดับการออกแบบ แต่เป็นความควบคุมไม่ได้ของมนุษย์" ผลิตคอนเทนต์ได้ตลอด 24 ชั่วโมง อินฟลูเอนเซอร์เสมือนจริงสามารถโพสต์ได้ทุกวัน ติดตามกระแสได้แบบเรียลไทม์ และ "ปรากฏตัว" ในสถานการณ์ใดก็ได้ โดยมีต้นทุนต่ำกว่าการถ่ายทำจริงมาก จากการประเมินของ BeyondGames หาก Lil Miquela โพสต์บน Instagram วันละหนึ่งโพสต์ รายได้ที่เป็นไปได้ในปี 2026 อาจสูงถึง 4.7 ล้านปอนด์ ประสิทธิภาพการผลิตนี้เป็นสิ่งที่ครีเอเตอร์ที่เป็นคนจริงไม่สามารถเทียบได้เลย ความสอดคล้องกับแบรนด์ที่แม่นยำ ความร่วมมือระหว่าง Prada และ Lil Miquela สร้างอัตราการมีส่วนร่วม (Engagement Rate) สูงกว่าแคมเปญการตลาดปกติถึง 30% ทุกการแสดงออกทางสีหน้า ทุกชุดที่สวมใส่ และทุกข้อความของอินฟลูเอนเซอร์เสมือนจริงสามารถถูกออกแบบมาอย่างแม่นยำ เพื่อให้มั่นใจว่าเข้ากับภาพลักษณ์ของแบรนด์ได้อย่างสมบูรณ์แบบ อย่างไรก็ตาม เหรียญย่อมมีสองด้าน รายงานจาก Business Insider ในเดือนมีนาคม 2026 ระบุว่า ความไม่พอใจของผู้บริโภคต่อบัญชี AI กำลังเพิ่มสูงขึ้น และบางแบรนด์เริ่มถอยห่างจากกลยุทธ์ AI Influencer ผลสำรวจจาก YouGov พบว่ามากกว่าหนึ่งในสามของผู้ตอบแบบสอบถามแสดงความกังวลเกี่ยวกับเทคโนโลยี AI นี่หมายความว่าอินฟลูเอนเซอร์เสมือนจริงไม่ใช่ยาสารพัดนึก ความจริงใจ (Authenticity) ยังคงเป็นปัจจัยสำคัญในใจของผู้บริโภค เมื่อเผชิญกับการรุกรานของ AI Influencer การตื่นตระหนกไม่มีประโยชน์ การลงมือทำต่างหากที่มีค่า นี่คือ 4 กลยุทธ์ที่ผ่านการพิสูจน์แล้ว กลยุทธ์ที่ 1: เจาะลึกประสบการณ์จริง ทำในสิ่งที่ AI ทำไม่ได้ AI สามารถสร้างใบหน้าที่สมบูรณ์แบบได้ แต่มันไม่สามารถลิ้มรสกาแฟจริงๆ หรือสัมผัสถึงความเหนื่อยล้าและความอิ่มเอมใจจากการเดินป่าได้ ในการพูดคุยบน Reddit ห้อง r/Futurology ความเห็นหนึ่งของผู้ใช้ได้รับคะแนนโหวตสูงมาก: "AI Influencer ขายของได้ แต่ผู้คนยังคงโหยหาการเชื่อมต่อที่แท้จริง" จงเปลี่ยนประสบการณ์ชีวิตจริง มุมมองที่ไม่เหมือนใคร และช่วงเวลาที่ไม่สมบูรณ์แบบของคุณให้เป็นกำแพงป้องกันคอนเทนต์ กลยุทธ์ที่ 2: ติดอาวุธให้ตัวเองด้วยเครื่องมือ AI แทนที่จะต่อต้าน ครีเอเตอร์ที่ฉลาดเริ่มใช้ AI เพื่อเพิ่มประสิทธิภาพแล้ว มีครีเอเตอร์บน Reddit แบ่งปันเวิร์กโฟลว์การทำงานที่สมบูรณ์: ใช้ ChatGPT เขียนสคริปต์, ElevenLabs สร้างเสียงพากย์ และ HeyGen ผลิตวิดีโอ คุณไม่จำเป็นต้องเป็น AI Influencer แต่คุณต้องให้ AI เป็นผู้ช่วยในการสร้างสรรค์ของคุณ กลยุทธ์ที่ 3: ติดตามเทรนด์อุตสาหกรรมอย่างเป็นระบบ สร้างความได้เปรียบด้านข้อมูล การเปลี่ยนแปลงในแวดวง AI Influencer นั้นรวดเร็วมาก มีเครื่องมือใหม่ เคสใหม่ และข้อมูลใหม่เกิดขึ้นทุกสัปดาห์ การไถ Twitter หรือ Reddit ไปเรื่อยๆ นั้นไม่เพียงพอ คุณสามารถใช้ เพื่อจัดการข้อมูลอุตสาหกรรมที่กระจัดกระจายอย่างเป็นระบบ: บันทึกบทความสำคัญ, ทวีต และรายงานการวิจัยลงใน Board แล้วใช้ AI ช่วยจัดระเบียบและค้นหาโดยอัตโนมัติ คุณสามารถถามคำถามกับคลังข้อมูลของคุณได้ตลอดเวลา เช่น "การระดมทุนครั้งใหญ่ที่สุด 3 อันดับแรกในแวดวงอินฟลูเอนเซอร์เสมือนจริงในปี 2026 คืออะไร?" เมื่อคุณต้องการเขียนบทวิเคราะห์หรือถ่ายวิดีโอ ข้อมูลก็พร้อมใช้งานทันทีโดยไม่ต้องเริ่มค้นหาจากศูนย์ กลยุทธ์ที่ 4: สำรวจรูปแบบคอนเทนต์ที่มนุษย์และเครื่องจักรทำงานร่วมกัน อนาคตไม่ใช่การต่อสู้ระหว่าง "คนจริง vs AI" แต่เป็นการอยู่ร่วมกันแบบ "คนจริง + AI" คุณสามารถใช้ AI สร้างสื่อทางสายตา แต่ใช้เสียงและมุมมองของคนจริงเพื่อมอบจิตวิญญาณให้กับมัน การวิเคราะห์จาก ระบุว่า AI Influencer เหมาะสำหรับแนวคิดเชิงทดลองที่ก้าวข้ามขีดจำกัด ในขณะที่อินฟลูเอนเซอร์ที่เป็นคนจริงยังคงไม่สามารถทดแทนได้ในการสร้างการเชื่อมต่อที่ลึกซึ้งกับผู้ชมและเสริมสร้างคุณค่าของแบรนด์ ความท้าทายที่ใหญ่ที่สุดในการติดตามเทรนด์ AI Influencer ไม่ใช่ข้อมูลน้อยเกินไป แต่คือข้อมูลที่มากเกินไปและกระจัดกระจาย สถานการณ์ทั่วไป: คุณเห็นทวีตของ Elon Musk บน X, อ่านโพสต์วิเคราะห์รายได้หลักหมื่นของ AI Influencer บน Reddit, พบรายงานเชิงลึกเรื่องแบรนด์ที่เริ่มถอยห่างบน Business Insider และเห็นวิดีโอสอนทำบน YouTube ข้อมูลเหล่านี้กระจายอยู่ใน 4 แพลตฟอร์ม 5 แท็บเบราว์เซอร์ สามวันต่อมาเมื่อคุณต้องการเขียนบทความ คุณก็หาข้อมูลสำคัญชิ้นนั้นไม่เจอแล้ว นี่คือปัญหาที่ เข้ามาแก้ไข คุณสามารถใช้ เพื่อบันทึกหน้าเว็บ, ทวีต หรือวิดีโอ YouTube ใดๆ ลงใน Board ส่วนตัวของคุณได้ในคลิกเดียว AI จะดึงข้อมูลสำคัญและสร้างดัชนีโดยอัตโนมัติ คุณสามารถค้นหาและถามคำถามด้วยภาษาธรรมชาติได้ตลอดเวลา เช่น สร้าง Board "งานวิจัย AI Influencer" เพื่อจัดการข้อมูลที่เกี่ยวข้องทั้งหมด เมื่อคุณต้องการผลิตคอนเทนต์ ก็ถาม Board ได้โดยตรงว่า: "โมเดลธุรกิจของ Aitana López คืออะไร?" หรือ "แบรนด์ไหนบ้างที่เริ่มถอยจากกลยุทธ์ AI Influencer?" คำตอบจะปรากฏพร้อมลิงก์ที่มาดั้งเดิม ต้องชี้แจงว่า จุดเด่นของ YouMind อยู่ที่การรวบรวมข้อมูลและการช่วยวิจัย ไม่ใช่เครื่องมือสร้าง AI Influencer หากความต้องการของคุณคือการสร้างภาพลักษณ์ตัวละครเสมือนจริง คุณยังคงต้องใช้เครื่องมือเฉพาะทางอย่าง Midjourney, Stable Diffusion หรือ HeyGen แต่ในกระบวนการ "วิจัยเทรนด์ → สะสมข้อมูล → ผลิตคอนเทนต์" ซึ่งเป็นหัวใจสำคัญของครีเอเตอร์ สามารถช่วยย่นระยะเวลาจากแรงบันดาลใจสู่ผลงานสำเร็จได้อย่างชัดเจน Q: AI Influencer จะเข้ามาแทนที่อินฟลูเอนเซอร์ที่เป็นคนจริงทั้งหมดหรือไม่? A: ในระยะสั้นยังไม่เกิดขึ้น อินฟลูเอนเซอร์เสมือนจริงมีข้อดีเรื่องการควบคุมแบรนด์และประสิทธิภาพการผลิตคอนเทนต์ แต่ความต้องการความจริงใจของผู้บริโภคยังคงแข็งแกร่ง รายงานจาก Business Insider ในปี 2026 แสดงให้เห็นว่าบางแบรนด์เริ่มลดการลงทุนใน AI Influencer เนื่องจากความไม่พอใจของผู้บริโภค ทั้งสองมีแนวโน้มที่จะส่งเสริมกันมากกว่าที่จะเข้ามาแทนที่กัน Q: คนธรรมดาสามารถสร้าง AI Influencer ของตัวเองได้ไหม? A: ได้ มีครีเอเตอร์จำนวนมากบน Reddit แบ่งปันประสบการณ์การเริ่มจากศูนย์ เครื่องมือที่ใช้บ่อย ได้แก่ Midjourney หรือ Stable Diffusion สำหรับสร้างภาพลักษณ์ที่สม่ำเสมอ, ChatGPT สำหรับเขียนแคปชัน, ElevenLabs สำหรับสร้างเสียง การลงทุนเริ่มต้นอาจต่ำมาก แต่ต้องอาศัยการดำเนินงานอย่างต่อเนื่อง 3 ถึง 6 เดือนจึงจะเห็นการเติบโตที่ชัดเจน Q: รายได้ของ AI Influencer มาจากไหนบ้าง? A: หลักๆ มี 3 ทาง: โพสต์สปอนเซอร์จากแบรนด์ (อินฟลูเอนเซอร์ระดับท็อปคิดค่าบริการหลักพันถึงหลายหมื่นดอลลาร์ต่อโพสต์), รายได้จากแพลตฟอร์มสมัครสมาชิก (เช่น Fanvue) และสินค้าลิขสิทธิ์หรือลิขสิทธิ์เพลง Lil Miquela มีรายได้จากการสมัครสมาชิกเพียงอย่างเดียวเฉลี่ย 40,000 ดอลลาร์ต่อเดือน ส่วนรายได้จากความร่วมมือกับแบรนด์นั้นสูงกว่ามาก Q: สถานการณ์ตลาดไอดอลเสมือนจริงในจีนเป็นอย่างไร? A: จีนเป็นหนึ่งในตลาดไอดอลเสมือนจริงที่คึกคักที่สุดในโลก จากการคาดการณ์ของอุตสาหกรรม ตลาดอินฟลูเอนเซอร์เสมือนจริงของจีนจะแตะ 2.7 แสนล้านหยวนภายในปี 2030 ตั้งแต่ Hatsune Miku, Luo Tianyi ไปจนถึงไอดอลเสมือนจริงแบบ Hyper-realistic ตลาดจีนผ่านการพัฒนามาหลายขั้นตอน และปัจจุบันกำลังมุ่งไปสู่ทิศทางการโต้ตอบแบบเรียลไทม์ที่ขับเคลื่อนด้วย AI Q: แบรนด์ควรระวังอะไรเมื่อเลือกทำงานกับอินฟลูเอนเซอร์เสมือนจริง? A: สิ่งสำคัญคือต้องประเมิน 3 ประเด็น: การยอมรับของกลุ่มเป้าหมายต่อภาพลักษณ์เสมือนจริง, นโยบายการเปิดเผยเนื้อหา AI ของแพลตฟอร์ม (TikTok และ Instagram กำลังเพิ่มข้อกำหนดที่เกี่ยวข้อง) และความเหมาะสมของอินฟลูเอนเซอร์เสมือนจริงกับภาพลักษณ์แบรนด์ แนะนำให้ทดสอบด้วยงบประมาณน้อยก่อน แล้วค่อยตัดสินใจเพิ่มการลงทุนตามข้อมูลที่ได้ การผงาดขึ้นของ AI Influencer ไม่ใช่คำทำนายที่ห่างไกล แต่เป็นความจริงที่กำลังเกิดขึ้น ข้อมูลตลาดแสดงให้เห็นชัดเจนว่ามูลค่าเชิงพาณิชย์ของอินฟลูเอนเซอร์เสมือนจริงได้รับการพิสูจน์แล้ว ตั้งแต่รายได้ 2 ล้านดอลลาร์ต่อปีของ Lil Miquela ไปจนถึงรายได้หลักหมื่นยูโรต่อเดือนของ Aitana López ตัวเลขเหล่านี้เป็นสิ่งที่ไม่ควรมองข้าม แต่สำหรับครีเอเตอร์ที่เป็นคนจริง นี่ไม่ใช่เรื่องราวของ "การถูกแทนที่" แต่เป็นโอกาสใน "การหาตำแหน่งใหม่" ประสบการณ์จริง มุมมองที่ไม่เหมือนใคร และการเชื่อมต่อทางอารมณ์กับผู้ชมของคุณ คือสินทรัพย์หลักที่ AI ไม่สามารถเลียนแบบได้ กุญแจสำคัญคือ: ใช้เครื่องมือ AI เพื่อเพิ่มประสิทธิภาพ ใช้เครื่องมือที่เป็นระบบเพื่อติดตามเทรนด์ และใช้ความจริงใจเพื่อสร้างกำแพงการแข่งขันที่ไม่มีใครแทนที่ได้ ต้องการติดตามเทรนด์ AI Influencer อย่างเป็นระบบและสะสมข้อมูลเพื่อการสร้างสรรค์ใช่ไหม? ลองใช้ สร้างพื้นที่วิจัยส่วนตัวของคุณ เริ่มต้นใช้งานได้ฟรี [1] [2] [3] [4] [5] [6] [7] [8] [9] [10] [11]