Guida alla creazione massiva di contenuti AI: il workflow essenziale per i content creator ---

TL; DR Punti chiave

- Tra gli oltre 207 milioni di creatori di contenuti a livello globale, il 91% utilizza già l'IA generativa per migliorare l'efficienza produttiva; gli utenti esperti registrano un aumento della produttività di 3-5 volte.

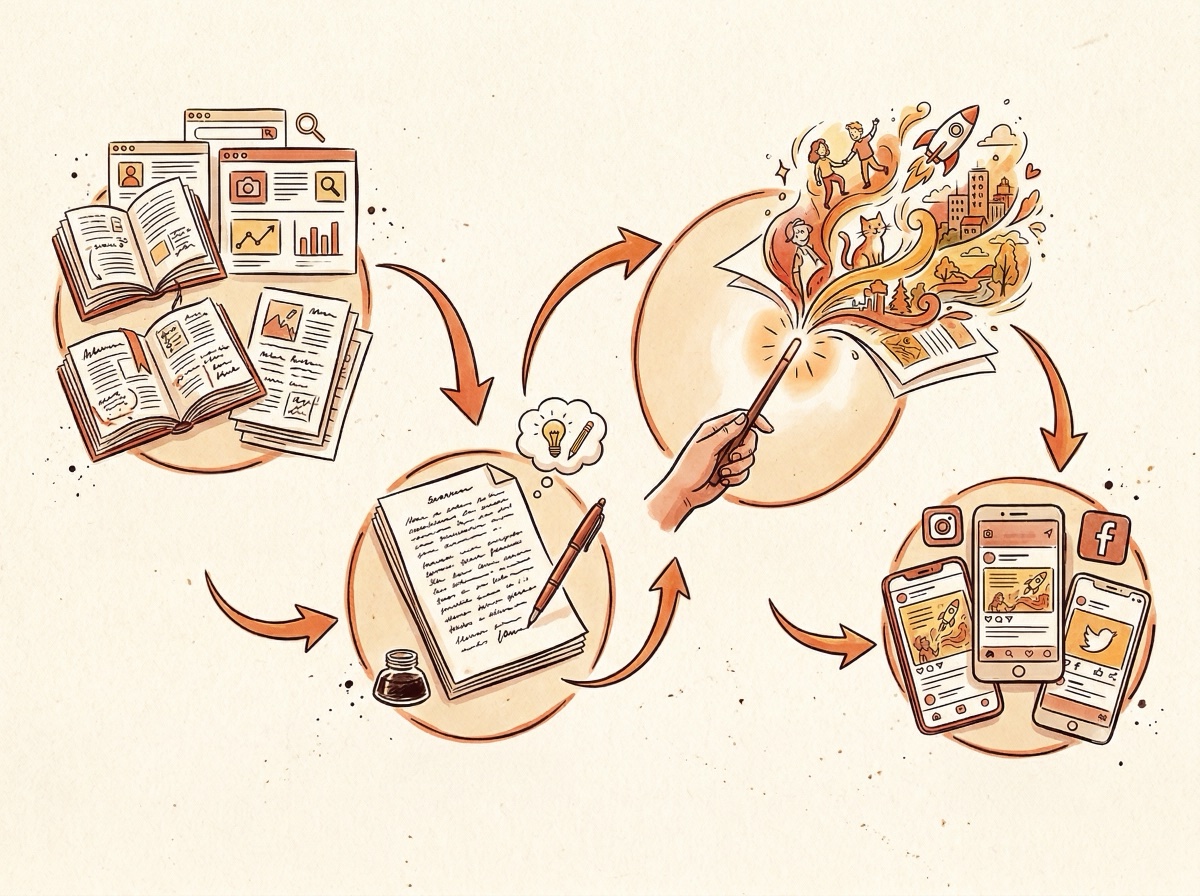

- Il cuore della creazione di massa di contenuti grafici e testuali con l'IA non è "trovare un buon strumento", ma costruire un flusso di lavoro completo: "raccolta materiali → generazione storie → creazione immagini → distribuzione multipiattaforma".

- Libri illustrati per bambini, infografiche scientifiche e schede didattiche sono i migliori punti di ingresso per la creazione massiva con l'IA. Produrre 10-20 set di contenuti di alta qualità al giorno per singola persona è ormai una realtà.

- La coerenza dei personaggi, l'uniformità dello stile e la conformità del copyright sono le tre sfide principali nella creazione di contenuti IA; l'articolo include soluzioni specifiche.

La tua velocità di produzione viene superata dai concorrenti

Un fatto crudele: mentre tu stai ancora modificando ripetutamente le immagini per un singolo post, i tuoi concorrenti potrebbero aver già completato la programmazione dei contenuti per un'intera settimana utilizzando strumenti di IA.

Secondo i dati di settore dell'inizio del 2026, il mercato globale della creazione di contenuti tramite IA ha raggiunto i 24,08 miliardi di dollari, con una crescita annua superiore al 21% 1. Ancora più degno di nota è il cambiamento nel mercato interno: i team di self-media che applicano profondamente l'IA hanno aumentato l'efficienza produttiva mediamente di 3-5 volte. Processi che prima richiedevano una settimana — pianificazione dei temi, ricerca dei materiali, design grafico — possono ora essere ridotti a 1-2 giorni 2.

Questo articolo è rivolto ai gestori di self-media alla ricerca di strumenti di creazione contenuti IA, ai creatori di contenuti grafici e a chiunque desideri utilizzare l'IA per generare libri illustrati, storie per bambini e altri contenuti visivi. Otterrai un flusso di lavoro collaudato per la creazione massiva di contenuti IA, con linee guida operative per ogni fase, dalla raccolta dei materiali alla produzione finale.

Perché i "contenuti grafici e testuali" sono il miglior punto di partenza per la creazione massiva con l'IA

Molti creatori, al primo approccio con gli strumenti di creazione IA, provano subito a scrivere articoli lunghi o a produrre video. Tuttavia, dal punto di vista del rapporto costi-benefici, i contenuti grafici sono la categoria più semplice da automatizzare con successo.

Ci sono tre ragioni. Primo, la catena di produzione è breve. Un set di contenuti grafici richiede solo due elementi centrali: "testo + immagini", e l'IA è già sufficientemente matura in entrambi i segmenti. Secondo, la tolleranza all'errore è alta. Se un'illustrazione generata dall'IA presenta un piccolo difetto, difficilmente verrà notata nel flusso di informazioni dei social media; al contrario, se un video generato dall'IA mostra una deformazione del personaggio, il pubblico se ne accorgerà immediatamente. Terzo, i canali di distribuzione sono molteplici. Lo stesso set di contenuti può essere pubblicato contemporaneamente su diverse piattaforme con costi marginali minimi.

I libri illustrati per bambini e i contenuti di divulgazione scientifica sono due nicchie particolarmente adatte. Prendendo come esempio i libri per bambini, un caso pratico ampiamente discusso mostra come un creatore abbia utilizzato ChatGPT per generare il testo della storia e Midjourney per le illustrazioni, riuscendo a pubblicare con successo il libro "Alice and Sparkle" su Amazon 3. Esistono anche creatori che, attraverso la combinazione di strumenti IA, hanno creato account di storie per bambini sui social media guadagnando oltre 100.000 follower in un solo mese.

La logica comune dietro questi casi è: la tecnologia per la generazione di storie e libri illustrati con l'IA è abbastanza matura da supportare operazioni commerciali; la chiave sta nell'avere un flusso di lavoro efficiente.

Le quattro sfide principali della creazione massiva di contenuti grafici

Prima di affrettarti a iniziare, è bene conoscere i quattro errori più comuni nella creazione massiva con l'IA. Nelle community come r/KDP su Reddit, questi problemi vengono menzionati ripetutamente 4.

Sfida 1: Coerenza dei personaggi. Questo è il problema più spinoso nella generazione di libri illustrati. Se chiedi all'IA di disegnare una bambina con un cappello rosso, la prima immagine potrebbe avere il viso tondo e i capelli corti, mentre la seconda potrebbe mostrarla con capelli lunghi e occhi grandi. Gli analisti di illustrazioni sottolineano che spesso i creatori si concentrano solo sull'estetica, ignorando la capacità di mantenere la coerenza stilistica e dei tratti.

Sfida 2: Catena di strumenti troppo lunga. Un tipico processo di creazione potrebbe coinvolgere 5-6 strumenti diversi: ChatGPT per il testo, Midjourney per le immagini, Canva per l'impaginazione, altri software per i sottotitoli e infine le varie piattaforme di pubblicazione. Ogni volta che cambi strumento, il tuo flusso creativo si interrompe, causando una enorme perdita di efficienza.

Sfida 3: Fluttuazione della qualità. La qualità dei contenuti generati dall'IA non è stabile. Lo stesso prompt potrebbe generare un'immagine straordinaria oggi e una con mani a sei dita domani. Nella creazione massiva, il costo in termini di tempo per il controllo qualità viene spesso sottovalutato.

Sfida 4: Zone grigie del copyright. Rapporti recenti delle autorità competenti indicano che i contenuti puramente generati dall'IA, senza un sufficiente contributo creativo umano, potrebbero non godere della protezione del copyright 5. Ciò significa che se intendi pubblicare commercialmente, devi assicurarti che ci sia un adeguato intervento di editing e creatività umana.

Cinque passi per costruire il tuo flusso di lavoro di creazione massiva con l'IA

Comprese le sfide, ecco un flusso di lavoro in cinque fasi testato sul campo. L'idea centrale è: utilizzare uno spazio di lavoro il più possibile unificato per completare l'intero processo, riducendo le perdite di efficienza dovute al cambio di strumenti.

Passo 1: Creare una libreria di ispirazione e materiali. Il presupposto per la creazione massiva è avere una riserva di materiali sufficiente. Hai bisogno di un luogo dove centralizzare analisi dei competitor, temi caldi, immagini di riferimento e campioni di stile. Molti creatori usano i segnalibri del browser o i preferiti delle app, ma questi contenuti finiscono per disperdersi. Un approccio migliore è utilizzare strumenti di gestione della conoscenza dedicati per archiviare pagine web, PDF, immagini e video, rendendoli interrogabili tramite IA. Ad esempio, in YouMind, puoi salvare i post di successo dei competitor, i riferimenti stilistici e i report sul pubblico target in un unico Board, per poi chiedere direttamente all'IA: "Qual è l'impostazione del personaggio più comune in questi libri?" o "Quale schema di colori ha il tasso di interazione più alto?". L'IA analizzerà tutti i materiali raccolti per darti una risposta.

Passo 2: Generazione massiva della struttura dei testi. Una volta pronta la libreria, il passo successivo è generare i testi. Per una storia per bambini, potresti definire un tema di serie (es. "Le avventure delle quattro stagioni della piccola volpe") e usare l'IA per generare 10-20 bozze di storie contemporaneamente, ognuna con protagonista, ambientazione, conflitto e finale. Il trucco fondamentale è definire chiaramente una "Scheda Personaggio" (Character Sheet) nel prompt, includendo tratti fisici, personalità e tormentoni, per mantenere la coerenza nelle illustrazioni successive.

Passo 3: Generazione di immagini con stile unificato. Questa è la fase tecnicamente più avanzata. Gli strumenti di generazione immagini del 2026 sono in grado di gestire bene la coerenza dei personaggi. Operativamente, si consiglia di generare prima un'immagine di riferimento del personaggio (Character Reference) e poi citare questo riferimento nei prompt di ogni illustrazione successiva. Strumenti come Midjourney (tramite il parametro --cref) o Recraft AI supportano questo flusso. Le capacità integrate di YouMind supportano vari modelli come Nano Banana Pro, Seedream 4.5 e GPT Image 1.5, permettendoti di confrontare i risultati nello stesso spazio di lavoro e scegliere quello più adatto al tuo stile senza saltare da un sito all'altro.

Passo 4: Assemblaggio e controllo qualità. Dopo aver unito testo e immagini, è obbligatorio un controllo umano. Concentrati su tre aspetti: la coerenza visiva del personaggio nelle diverse scene, eventuali errori logici nel testo tipici dell'IA e difetti visivi evidenti (dita in eccesso, testo distorto). Questa fase non può essere saltata: determina se il tuo contenuto è "spazzatura IA" o "contenuto di alta qualità assistito dall'IA".

Passo 5: Adattamento e distribuzione multipiattaforma. Lo stesso contenuto richiede formati diversi a seconda della piattaforma. Alcuni social preferiscono immagini verticali (3:4) con testi brevi, altri richiedono copertine orizzontali con articoli lunghi, altri ancora video o caroselli 9:16. Nella creazione massiva, si consiglia di generare versioni in più proporzioni già in fase di creazione immagine, invece di ritagliarle successivamente.

Come scegliere gli strumenti di creazione contenuti IA

Il numero di strumenti sul mercato è enorme; TechTarget ne ha elencati oltre 35 nel suo report del 2026 6. Per la creazione massiva di contenuti grafici, la scelta dovrebbe basarsi su tre dimensioni: integrazione testo-immagine (completare tutto sulla stessa piattaforma), possibilità di cambiare modello (modelli diversi eccellono in stili diversi) e capacità di automazione del flusso di lavoro.

Strumento | Scenario ideale | Versione gratuita | Vantaggio principale |

|---|---|---|---|

Ricerca materiali + intero processo creativo | ✅ | Generazione multi-modello + gestione conoscenza + workflow Agent; tutto in uno, dalla raccolta alla produzione | |

Impaginazione e design con template | ✅ | Tantissimi template, ottimo per l'impaginazione rapida, ma generazione IA limitata | |

Creazione specifica di libri per bambini | Crediti prova | Specializzato in libri illustrati, buona coerenza dei personaggi, ma limitato a questa categoria | |

Libri di storie personalizzati | ✅ | Semplice da usare, ideale per genitori e insegnanti, ma debole nella creazione massiva |

È importante notare che YouMind eccelle nel percorso completo "dalla ricerca alla creazione". Se la tua esigenza è solo generare una singola illustrazione, strumenti specializzati come Midjourney potrebbero avere un vantaggio nella qualità pura dell'immagine. Il valore differenziante di YouMind è la possibilità di raccogliere materiali, fare ricerca con l'IA, scrivere testi, generare immagini con più modelli e persino creare flussi automatizzati tramite la funzione Skills, trasformando i passaggi ripetitivi in compiti eseguiti da un Agent con un solo clic.

FAQ

D: I libri per bambini generati dall'IA possono essere usati commercialmente?

R: Sì, ma a certe condizioni. Le linee guida del 2025 indicano che i contenuti generati dall'IA necessitano di un "sostanziale contributo creativo umano" per ottenere il copyright. In pratica, dovresti editare significativamente i testi, apportare modifiche alle illustrazioni e conservare traccia del processo creativo. Su piattaforme come Amazon KDP, è necessario dichiarare l'uso dell'IA.

D: Quanti contenuti può produrre una persona al giorno usando l'IA?

R: Dipende dal tipo di contenuto e dalla qualità richiesta. Per storie illustrate, una volta stabilito un flusso di lavoro maturo, è possibile produrre 10-20 set al giorno (ogni set con 6-8 immagini + testo completo). Tuttavia, questo presuppone di avere già personaggi e stili predefiniti. All'inizio, si consiglia di partire con 3-5 set al giorno.

D: I contenuti IA vengono penalizzati dalle piattaforme?

R: Google ha dichiarato ufficialmente che il ranking si concentra sulla qualità del contenuto e sui segnali E-E-A-T (Esperienza, Competenza, Autorevolezza, Affidabilità), non sul fatto che sia generato dall'IA 7. Finché il contenuto ha valore per l'utente e non è spam di bassa qualità, non viene penalizzato. La chiave è la revisione umana e la personalizzazione.

D: Quali sono i costi di avvio per un account di libri illustrati IA?

R: Si può iniziare quasi a costo zero. La maggior parte degli strumenti offre quote gratuite sufficienti per i test iniziali. Una volta validata la direzione, si può scegliere un piano a pagamento in base alle necessità. YouMind, ad esempio, include capacità base di generazione e creazione nella versione gratuita, mentre i piani a pagamento offrono più modelli e limiti più alti.

Conclusione

Nel 2026, la creazione massiva di contenuti IA non è più una questione di "se si può fare", ma di "come farlo in modo più efficiente degli altri".

Ricorda tre punti fondamentali. Primo, il flusso di lavoro è più importante del singolo strumento. Invece di cercare lo strumento di generazione immagini perfetto, costruisci un processo completo. Secondo, la revisione umana è il limite minimo della qualità. L'IA accelera, l'uomo controlla: questa divisione non cambierà nel prossimo futuro. Terzo, inizia in piccolo e itera velocemente. Scegli una nicchia (es. storie della buonanotte), usa una combinazione semplice di strumenti e poi ottimizza.

Se cerchi una piattaforma che copra l'intera catena "ricerca materiali → creazione testi → generazione immagini → automazione", prova gratuitamente YouMind e inizia a costruire la tua linea di produzione di contenuti partendo da un Board.

Riferimenti

[2] L'IA rimodella l'ecosistema dei self-media: White Paper su tendenze, strategie e pratiche 2025

[3] Il successo dei libri per bambini fatti con l'IA: analisi dei casi studio

[4] Reddit r/KDP: Discussione sui migliori strumenti IA per illustrazioni di libri per bambini

[5] Come costruire un generatore di illustrazioni per libri per bambini con l'IA (Tutorial MindStudio)

[6] 35 strumenti di generazione contenuti IA da esplorare nel 2026 (TechTarget)

[7] Le migliori piattaforme di creazione contenuti IA nel 2026 (Clarity Ventures)

Hai domande su questo articolo?

Chiedi all'IA gratisArticoli correlati

Test pratico del leak di GPT Image 2: supera Nano Banana Pro nei blind test?

Punti chiave (TL;DR) Il 4 aprile 2026, lo sviluppatore indipendente Pieter Levels (@levelsio) ha lanciato lo scoop su X: sulla piattaforma di blind test Arena sono apparsi tre misteriosi modelli di generazione di immagini, con i nomi in codice maskingtape-alpha, gaffertape-alpha e packingtape-alpha. Questi tre nomi sembrano scaffali di nastro adesivo in un negozio di ferramenta, ma la qualità delle immagini generate ha mandato in fermento l'intera comunità AI. Questo articolo è rivolto a creatori, designer e appassionati di tecnologia che seguono le ultime tendenze nel campo della generazione di immagini AI. Se hai usato Nano Banana Pro o GPT Image 1.5, questo post ti aiuterà a capire rapidamente il reale livello dei modelli di prossima generazione. La discussione sul subreddit r/singularity ha ottenuto 366 voti e oltre 200 commenti in 24 ore. L'utente ThunderBeanage ha scritto: "Dai miei test, questo modello è assolutamente pazzesco, va ben oltre Nano Banana." Un indizio ancora più cruciale: quando gli utenti hanno chiesto direttamente l'identità del modello, questo ha affermato di provenire da OpenAI. Fonte immagine: screenshot del blind test di GPT Image 2 su Arena, trapelato per la prima volta da @levelsio Se usi spesso l'IA per generare immagini, lo saprai bene: far sì che il modello renderizzi correttamente il testo all'interno di un'immagine è sempre stata la sfida più frustrante. Errori di ortografia, lettere deformate e layout caotici sono problemi comuni a quasi tutti i modelli di generazione. La svolta di GPT Image 2 in questa direzione è il punto focale delle discussioni della community. @PlayingGodAGI ha condiviso due immagini di test molto convincenti: una è una mappa anatomica dei muscoli anteriori del corpo umano, dove ogni etichetta per muscoli, ossa, nervi e vasi sanguigni raggiunge una precisione da libro di testo; l'altra è uno screenshot della home page di YouTube, dove gli elementi della UI, le miniature dei video e i titoli non presentano alcuna distorsione. Nel suo post ha scritto: "Questo elimina l'ultimo difetto delle immagini generate dall'IA." Fonte immagine: confronto tra la mappa anatomica e lo screenshot di YouTube mostrato da @PlayingGodAGI Il giudizio di @avocadoai_co è ancora più diretto: "Il rendering del testo è assolutamente pazzesco (The text rendering is just absolutely insane)." Anche @0xRajat ha sottolineato: "La conoscenza del mondo di questo modello è spaventosamente buona, il rendering del testo è quasi perfetto. Se hai mai usato un modello di generazione di immagini, sai quanto sia profondo questo problema." Fonte immagine: effetto di riproduzione dell'interfaccia di un sito web testato indipendentemente dal blogger giapponese @masahirochaen Anche il blogger giapponese @masahirochaen ha condotto test indipendenti, confermando che il modello eccelle nella descrizione del mondo reale e nella riproduzione delle interfacce web; persino il rendering dei caratteri giapponesi Kana e Kanji è accurato. Gli utenti di Reddit hanno notato lo stesso, commentando: "Ciò che mi impressiona è che sia i Kanji che i Katakana sono validi." Questa è la domanda che si pongono tutti: GPT Image 2 ha davvero superato Nano Banana Pro? @AHSEUVOU15 ha eseguito un test comparativo visivo, mostrando affiancati gli output di Nano Banana Pro, GPT Image 2 (dai test A/B) e GPT Image 1.5. Fonte immagine: confronto a tre di @AHSEUVOU15; da destra a sinistra: NBP, GPT Image 2, GPT Image 1.5 La conclusione di @AHSEUVOU15 è cauta: "In questo caso NBP è ancora migliore, ma GPT Image 2 è sicuramente un netto passo avanti rispetto alla versione 1.5." Questo indica che il divario tra i due modelli è ormai minimo e il vincitore dipende dal tipo specifico di prompt. Secondo un report approfondito di OfficeChai, i test della community hanno rivelato ulteriori dettagli : @socialwithaayan ha condiviso selfie in spiaggia e screenshot di Minecraft che confermano ulteriormente queste scoperte, concludendo: "Il rendering del testo finalmente funziona, la conoscenza del mondo e il realismo sono di un altro livello." Fonte immagine: effetto di generazione di uno screenshot del gioco Minecraft condiviso da @socialwithaayan [9](https://x.com/socialwithaayan/status/2040434305487507475) GPT Image 2 non è privo di debolezze. Il report di OfficeChai sottolinea che il modello fallisce ancora nel test del riflesso speculare del cubo di Rubik (Rubik’s Cube reflection test). Si tratta di un classico stress test nel campo della generazione di immagini, che richiede al modello di comprendere le relazioni speculari nello spazio tridimensionale e renderizzare accuratamente il riflesso del cubo in uno specchio. Anche i feedback degli utenti di Reddit confermano questo aspetto. Qualcuno, testando il prompt "disegna una creatura completamente nuova che potrebbe esistere in un vero ecosistema", ha notato che, sebbene il modello possa generare immagini visivamente molto complesse, la logica spaziale interna non è sempre coerente. Come ha affermato un utente: "I modelli text-to-image sono essenzialmente sintetizzatori visivi, non motori di simulazione biologica." Inoltre, le versioni iniziali dei blind test (nomi in codice Chestnut e Hazelnut) riportate in precedenza da 36Kr avevano ricevuto critiche per un aspetto "troppo plasticoso". Tuttavia, dai feedback della community sull'ultima serie "tape", questo problema sembra essere stato notevolmente migliorato. Il momento in cui GPT Image 2 è trapelato è interessante. Il 24 marzo 2026, OpenAI ha annunciato la chiusura di Sora, l'app di generazione video lanciata solo 6 mesi prima. Disney è stata informata della notizia meno di un'ora prima dell'annuncio; all'epoca, Sora bruciava circa 1 milione di dollari al giorno e il numero di utenti era sceso da un picco di 1 milione a meno di 500.000. La chiusura di Sora ha liberato una grande quantità di potenza di calcolo. L'analisi di OfficeChai suggerisce che i modelli di generazione di immagini di prossima generazione siano la destinazione più logica per queste risorse. GPT Image 1.5 di OpenAI aveva già raggiunto la vetta della classifica immagini di LMArena nel dicembre 2025, superando Nano Banana Pro. Se la serie "tape" è effettivamente GPT Image 2, OpenAI sta raddoppiando la scommessa nel settore dell'IA consumer per la generazione di immagini, "l'unico campo in cui è ancora possibile ottenere una diffusione di massa virale". Vale la pena notare che i tre modelli "tape" sono stati attualmente rimossi da LMArena. Gli utenti di Reddit ritengono che ciò possa significare che il rilascio ufficiale è imminente. Considerando le roadmap circolate in precedenza, è molto probabile che la nuova generazione di modelli di immagini venga lanciata in contemporanea con il vociferato GPT-5.2. Sebbene GPT Image 2 non sia ancora ufficialmente disponibile, puoi prepararti usando gli strumenti attuali: È importante notare che le prestazioni dei modelli nei blind test di Arena potrebbero differire dalle versioni ufficiali. Durante la fase di blind test, i modelli sono solitamente ancora in fase di ottimizzazione; i parametri finali e il set di funzionalità potrebbero cambiare. D: Quando verrà rilasciato ufficialmente GPT Image 2? R: OpenAI non ha ancora confermato ufficialmente l'esistenza di GPT Image 2. Tuttavia, la rimozione dei tre modelli "tape" da Arena è vista dalla community come un segnale di un rilascio entro 1-3 settimane. Insieme ai rumor su GPT-5.2, il lancio potrebbe avvenire tra metà e fine aprile 2026. D: Qual è il migliore tra GPT Image 2 e Nano Banana Pro? R: Gli attuali risultati dei blind test mostrano che entrambi hanno i propri vantaggi. GPT Image 2 è in testa nel rendering del testo, nella fedeltà della UI e nella conoscenza del mondo, mentre Nano Banana Pro offre ancora una qualità d'immagine complessiva superiore in alcuni scenari. Una conclusione definitiva richiederà test sistematici su larga scala dopo il rilascio ufficiale. D: Qual è la differenza tra maskingtape-alpha, gaffertape-alpha e packingtape-alpha? R: Questi tre nomi in codice potrebbero rappresentare diverse configurazioni o versioni dello stesso modello. Dai test della community, maskingtape-alpha è sembrato il più performante in test come gli screenshot di Minecraft, ma il livello complessivo dei tre è simile. Lo stile dei nomi è coerente con la precedente serie gpt-image di OpenAI. D: Dove posso provare GPT Image 2? R: Al momento GPT Image 2 non è disponibile pubblicamente e i tre modelli "tape" sono stati rimossi da Arena. Puoi monitorare in attesa che i modelli tornino online, oppure attendere il rilascio ufficiale di OpenAI per usarlo tramite ChatGPT o API. D: Perché il rendering del testo è sempre stato un problema per i modelli di generazione immagini AI? R: I modelli di diffusione tradizionali generano immagini a livello di pixel e non sono naturalmente portati per contenuti che richiedono tratti e spaziature precise come il testo. La serie GPT Image adotta un'architettura autoregressiva invece di un puro modello di diffusione, il che le permette di comprendere meglio la semantica e la struttura del testo, ottenendo così una svolta nel rendering. La fuga di notizie su GPT Image 2 segna l'inizio di una nuova fase nella competizione della generazione di immagini AI. Il rendering del testo e la conoscenza del mondo, due problemi storici, vengono risolti rapidamente, e Nano Banana Pro non è più l'unico punto di riferimento. Il ragionamento spaziale rimane un punto debole comune a tutti i modelli, ma la velocità del progresso supera le aspettative. Per gli utenti di IA generativa, questo è il momento migliore per costruire il proprio sistema di valutazione. Testa i modelli con lo stesso set di prompt, registra gli scenari in cui eccellono, così sarai in grado di dare un giudizio accurato non appena GPT Image 2 sarà ufficialmente disponibile. Vuoi gestire in modo sistematico i tuoi prompt e i risultati dei test? Prova per salvare gli output di diversi modelli nella stessa Board e confrontarli in qualsiasi momento. [1] [2] [3] [4] [5] [6] [7] [8] [9] [10]

Jensen Huang annuncia: "L'AGI è stata raggiunta": Verità, polemiche e analisi approfondita

TL; DR Punti chiave Il 23 marzo 2026, una notizia ha scosso i social media. Il CEO di NVIDIA, Jensen Huang, durante il podcast di Lex Fridman, ha pronunciato queste parole: "I think we've achieved AGI" (Penso che abbiamo raggiunto l'AGI). Questo tweet pubblicato da Polymarket ha ottenuto oltre 16.000 like e 4,7 milioni di visualizzazioni, con un'ampia copertura da parte dei principali media tecnologici come The Verge, Forbes e Mashable nel giro di poche ore. Questo articolo è rivolto a tutti i lettori interessati alle tendenze dell'AI, che siate professionisti del settore, investitori o persone comuni curiose dell'intelligenza artificiale. Ricostruiremo integralmente il contesto di questa dichiarazione, analizzeremo i "giochi di parole" sulla definizione di AGI e valuteremo cosa significhi per l'intero settore dell'AI. Ma se vi fermate solo al titolo, vi perderete la parte più importante della storia. Per comprendere il peso della frase di Jensen Huang, bisogna prima esaminare le premesse. L'host del podcast, Lex Fridman, ha proposto una definizione molto specifica di AGI: un sistema AI in grado di "fare il tuo lavoro", ovvero fondare, far crescere e gestire un'azienda tecnologica da oltre 1 miliardo di dollari. Ha chiesto a Huang quanto fossimo lontani da una tale AGI: 5 anni? 10 anni? 20 anni? La risposta di Huang è stata: "I think it's now" (Penso che sia adesso). Un'analisi approfondita di Mashable ha evidenziato un dettaglio fondamentale. Huang ha detto a Fridman: "You said a billion, and you didn't say forever" (Hai detto un miliardo, e non hai detto per sempre). In altre parole, nell'interpretazione di Huang, se un'AI riesce a creare un'app virale, guadagnare brevemente 1 miliardo di dollari e poi fallire, allora ha "raggiunto l'AGI". L'esempio citato è OpenClaw, una piattaforma open source per AI Agent. Huang ha immaginato uno scenario in cui un'AI crea un semplice servizio web utilizzato da miliardi di persone per 50 centesimi ciascuna, per poi scomparire silenziosamente. Ha persino fatto un'analogia con i siti web dell'era della bolla dot-com, sostenendo che la complessità di quei siti non fosse superiore a quella che un AI Agent può generare oggi. Poi, ha pronunciato la frase che la maggior parte dei titoli sensazionalistici ha ignorato: "The odds of 100,000 of those agents building NVIDIA is zero percent" (La probabilità che 100.000 di questi Agent costruiscano NVIDIA è pari a zero). Non si tratta di una piccola nota a margine. Come commentato da Mashable: "That's not a small caveat. It's the whole ballgame" (Non è un piccolo avvertimento. È il nocciolo della questione). Jensen Huang non è il primo leader tecnologico ad annunciare che "l'AGI è stata raggiunta". Per comprendere questa dichiarazione, occorre inserirla in una narrazione di settore più ampia. Nel 2023, al summit DealBook del New York Times, Huang aveva fornito una definizione diversa di AGI: un software capace di superare vari test di intelligenza quasi umana con un livello di competenza ragionevole. All'epoca, aveva previsto che l'AI avrebbe raggiunto questo standard entro 5 anni. Nel dicembre 2025, il CEO di OpenAI Sam Altman ha dichiarato "we built AGIs" (abbiamo costruito delle AGI), aggiungendo che "AGI kinda went whooshing by" (l'AGI è passata quasi inosservata), con un impatto sociale molto inferiore alle aspettative, suggerendo al settore di passare alla definizione di "superintelligenza". Nel febbraio 2026, Altman ha dichiarato a Forbes: "We basically have built AGI, or very close to it" (In sostanza abbiamo costruito l'AGI, o ci siamo molto vicini). Tuttavia, ha poi aggiunto che si trattava di un'espressione "spirituale" e non letterale, sottolineando che l'AGI richiede ancora "molti progressi di media entità". Notate lo schema? Ogni dichiarazione di "AGI raggiunta" è accompagnata da un silenzioso declassamento della definizione stessa. Lo statuto fondativo di OpenAI definisce l'AGI come "sistemi altamente autonomi che superano gli esseri umani nella maggior parte dei lavori di valore economico". Questa definizione è cruciale perché il contratto tra OpenAI e Microsoft include una clausola sull'AGI: una volta che l'AGI viene dichiarata raggiunta, i diritti di Microsoft sull'uso della tecnologia di OpenAI cambierebbero drasticamente. Secondo Reuters, il nuovo accordo prevede che il raggiungimento dell'AGI debba essere verificato da un gruppo di esperti indipendenti, con Microsoft che mantiene una quota del 27% e alcuni diritti d'uso tecnologico fino al 2032. Quando decine di miliardi di dollari sono legati a un termine vago, "chi definisce l'AGI" non è più una questione accademica, ma una partita commerciale. Se la copertura dei media tecnologici è stata misurata, le reazioni sui social media hanno mostrato uno spettro molto diverso. Sulle community Reddit come r/singularity, r/technology e r/BetterOffline sono apparsi rapidamente numerosi thread di discussione. Un commento di un utente su r/singularity ha ricevuto molti voti positivi: "AGI is not just an 'AI system that can do your job'. It's literally in the name: Artificial GENERAL Intelligence" (L'AGI non è solo un 'sistema AI che può fare il tuo lavoro'. È letteralmente nel nome: Intelligenza GENERALE Artificiale). Su r/technology, uno sviluppatore che si occupa di costruire AI Agent per l'automazione di task desktop ha scritto: "We are nowhere near AGI. Current models are great at structured reasoning but still can't handle the kind of open-ended problem solving a junior dev does instinctively. Jensen is selling GPUs though, so the optimism makes sense" (Siamo lontanissimi dall'AGI. I modelli attuali sono ottimi nel ragionamento strutturato, ma non riescono ancora a gestire la risoluzione di problemi aperti che uno sviluppatore junior affronta d'istinto. Jensen però vende GPU, quindi l'ottimismo ha senso). Anche su Twitter/X le discussioni in lingua cinese sono state vivaci. L'utente @DefiQ7 ha pubblicato un post divulgativo dettagliato, distinguendo chiaramente l'AGI dall'attuale "AI specializzata" (come ChatGPT o ERNIE Bot), ottenendo numerose condivisioni. Il post sottolinea: "Questa è una notizia bomba per il mondo tech", ma ribadisce che l'AGI implica "capacità cross-dominio, apprendimento autonomo, ragionamento, pianificazione e adattamento a scenari sconosciuti", caratteristiche che vanno oltre le attuali capacità dell'AI. Su r/BetterOffline, le critiche sono state ancora più pungenti. Un utente ha commentato: "Which is higher? The number of times Trump has achieved 'total victory' in Iran, or the number of times Jensen Huang has achieved 'AGI'?" (Quale numero è più alto? Le volte in cui Trump ha ottenuto la 'vittoria totale' in Iran o le volte in cui Jensen Huang ha 'raggiunto l'AGI'?). Un altro utente ha evidenziato un problema di lunga data nel mondo accademico: "This has been a problem with Artificial Intelligence as an academic field since its very inception" (Questo è un problema dell'Intelligenza Artificiale come campo accademico sin dal suo inizio). Di fronte alle mutevoli definizioni di AGI fornite dai giganti tecnologici, come può una persona comune giudicare a che punto sia realmente lo sviluppo dell'AI? Ecco un quadro concettuale utile. Passaggio 1: Distinguere tra "dimostrazione di capacità" e "intelligenza generale". Gli attuali modelli AI avanzati mostrano prestazioni sorprendenti in molti compiti specifici. GPT-5.4 può scrivere articoli fluidi, e gli AI Agent possono automatizzare flussi di lavoro complessi. Tuttavia, tra "eccellere in compiti specifici" e "possedere intelligenza generale" esiste un divario enorme. Un'AI capace di battere il campione del mondo di scacchi potrebbe non essere in grado nemmeno di "passarmi il bicchiere sul tavolo". Passaggio 2: Prestare attenzione ai modificatori, non ai titoli. Huang ha detto "I think" (Penso), non "We have proven" (Abbiamo dimostrato). Altman ha detto "spiritual" (spirituale), non "literal" (letterale). Questi termini non sono segni di umiltà, ma precise strategie legali e di PR. Quando sono in gioco contratti da decine di miliardi di dollari, ogni parola viene soppesata con cura. Passaggio 3: Guardare alle azioni, non alle dichiarazioni. Al GTC 2026, NVIDIA ha presentato sette nuovi chip, lanciato DLSS 5, la piattaforma OpenClaw e lo stack NemoClaw per Agent aziendali. Questi sono progressi tecnologici tangibili. Tuttavia, nel suo discorso, Huang ha menzionato l'"inferenza" (inference) quasi 40 volte, mentre l'"addestramento" (training) solo una decina di volte. Ciò indica che il focus del settore si sta spostando dal "creare un'AI più intelligente" al "far sì che l'AI esegua i compiti in modo più efficiente". Si tratta di progresso ingegneristico, non di una svolta nell'intelligenza. Passaggio 4: Costruire il proprio sistema di monitoraggio delle informazioni. La densità di informazioni nel settore dell'AI è altissima, con annunci importanti ogni settimana. Affidarsi solo alle notifiche dei titoli sensazionalistici rende facile farsi influenzare. Si consiglia di leggere regolarmente le fonti primarie (blog ufficiali aziendali, paper accademici, trascrizioni di podcast) e utilizzare strumenti per salvare e organizzare sistematicamente questi materiali. Ad esempio, puoi usare la funzione Board di per salvare le fonti chiave e utilizzare l'AI per interrogare e verificare i dati, evitando di essere fuorviati da una singola narrazione. D: L'AGI di cui parla Jensen Huang è la stessa definita da OpenAI? R: No. Huang ha risposto basandosi sulla definizione ristretta proposta da Lex Fridman (un'AI capace di fondare un'azienda da 1 miliardo di dollari), mentre la definizione di AGI nello statuto di OpenAI è "sistemi altamente autonomi che superano gli esseri umani nella maggior parte dei lavori di valore economico". Gli standard sono molto diversi e quest'ultimo richiede capacità che vanno ben oltre la prima definizione. D: Un'AI attuale può davvero gestire un'azienda in modo indipendente? R: Al momento no. Lo stesso Huang ha ammesso che un AI Agent potrebbe creare un'app di successo temporaneo, ma che "la probabilità di costruire NVIDIA è pari a zero". L'AI attuale eccelle nell'esecuzione di compiti strutturati, ma dipende ancora pesantemente dalla guida umana per decisioni strategiche a lungo termine, coordinamento cross-dominio e gestione di situazioni impreviste. D: Quale sarà l'impatto del raggiungimento dell'AGI sul lavoro delle persone comuni? R: Anche secondo le definizioni più ottimistiche, l'impatto attuale dell'AI si riflette principalmente nel miglioramento dell'efficienza in compiti specifici, piuttosto che nella sostituzione totale del lavoro umano. Sam Altman ha ammesso a fine 2025 che l'AGI "ha avuto un impatto sociale molto inferiore alle aspettative". Nel breve termine, è più probabile che l'AI cambi le modalità di lavoro come potente strumento di supporto, anziché sostituire direttamente i posti di lavoro. D: Perché i CEO delle aziende tecnologiche hanno fretta di annunciare che l'AGI è stata raggiunta? R: Le ragioni sono molteplici. Il core business di NVIDIA è la vendita di chip per la potenza di calcolo AI; la narrazione dell'AGI mantiene alto l'entusiasmo degli investitori per le infrastrutture AI. Per OpenAI, il contratto con Microsoft include clausole legate all'AGI, la cui definizione influenza direttamente la distribuzione di decine di miliardi di dollari. Inoltre, nel mercato dei capitali, la narrazione "l'AGI sta arrivando" è un pilastro fondamentale per sostenere le elevate valutazioni delle aziende AI. D: Quanto è lontano lo sviluppo dell'AI in Cina dall'AGI? R: La Cina ha compiuto progressi significativi nel campo dell'AI. A giugno 2025, il numero di utenti di AI generativa in Cina ha raggiunto i 515 milioni, e modelli come DeepSeek e Qwen hanno mostrato ottime prestazioni in vari benchmark. Tuttavia, l'AGI è una sfida tecnologica globale e attualmente non esiste un sistema AGI universalmente riconosciuto dalla comunità accademica mondiale. Si prevede che il mercato dell'industria AI cinese crescerà con un tasso composto del 30,6%-47,1% tra il 2025 e il 2035, mostrando un forte slancio. La dichiarazione di Jensen Huang "l'AGI è stata raggiunta" è, in sostanza, un'affermazione ottimistica basata su una definizione estremamente ristretta, piuttosto che un traguardo tecnologico verificato. Egli stesso ha ammesso che gli attuali AI Agent sono ancora lontanissimi dal poter costruire imprese realmente complesse. Il fenomeno dei "paletti mobili" nella definizione di AGI rivela il delicato equilibrio tra narrazione tecnologica e interessi commerciali nel settore tech. Da OpenAI a NVIDIA, ogni annuncio di "abbiamo raggiunto l'AGI" è accompagnato da un silenzioso abbassamento degli standard. Come consumatori di informazioni, non dobbiamo inseguire i titoli, ma costruire il nostro quadro di valutazione. La tecnologia AI sta indubbiamente progredendo rapidamente. I nuovi chip, le piattaforme Agent e le tecnologie di ottimizzazione dell'inferenza presentate al GTC 2026 sono reali passi avanti ingegneristici. Tuttavia, presentare questi progressi come "AGI raggiunta" è più una strategia di marketing che una conclusione scientifica. Rimanere curiosi, mantenere uno spirito critico e seguire costantemente le fonti primarie è la strategia migliore per non essere sommersi dal flusso di informazioni in questa era di accelerazione dell'AI. Vuoi monitorare sistematicamente le dinamiche del settore AI? Prova , salva le fonti chiave nella tua base di conoscenza personale e lascia che l'AI ti aiuti a organizzare, interrogare e verificare le informazioni. [1] [2] [3] [4] [5] [6]

L'ascesa degli influencer virtuali AI: tendenze e opportunità che ogni creatore deve conoscere

TL; DR Punti chiave Il 21 marzo 2026, Elon Musk ha pubblicato su X un post di sole otto parole: "AI bots will be more human than human". In sole 72 ore, il tweet ha ottenuto oltre 62 milioni di visualizzazioni e 580.000 like. Ha scritto queste parole in risposta all'immagine di un "volto da influencer perfetto" generato dall'AI. Non si tratta di una profezia fantascientifica. Se sei un content creator, un blogger o un social media manager, probabilmente ti sei già imbattuto nel tuo feed in volti "fin troppo perfetti", senza riuscire a distinguere se fossero persone reali o AI. Questo articolo ti aiuterà a comprendere lo stato attuale degli influencer virtuali AI, i dati sui guadagni dei casi di successo e come tu, in quanto creatore umano, debba affrontare questa rivoluzione. Questo contenuto è rivolto a content creator, social media manager, esperti di marketing e a chiunque sia interessato ai trend dell'intelligenza artificiale. Partiamo da alcuni numeri che fanno riflettere. Il mercato globale degli influencer virtuali ha raggiunto i 6,06 miliardi di dollari nel 2024 e si prevede che crescerà fino a 8,3 miliardi nel 2025, con un tasso di crescita annuale superiore al 37%. Secondo Straits Research, questa cifra salirà a 111,78 miliardi di dollari entro il 2033. Parallelamente, l'intero settore dell'influencer marketing ha raggiunto i 32,55 miliardi di dollari nel 2025 e si prevede che supererà la soglia dei 40 miliardi nel 2026. Analizzando i singoli casi, due esempi sono particolarmente rappresentativi. Lil Miquela è considerata la "capostipite degli influencer AI". Nata nel 2016, questo personaggio virtuale vanta oltre 2,4 milioni di follower su Instagram e collaborazioni con brand come Prada, Calvin Klein e Samsung. Il suo team (parte di Dapper Labs) richiede decine di migliaia di dollari per ogni post sponsorizzato; solo i ricavi dagli abbonamenti sulla piattaforma Fanvue raggiungono i 40.000 dollari al mese che, sommati alle partnership, portano il reddito mensile oltre i 100.000 dollari. Si stima che dal 2016 abbia guadagnato in media circa 2 milioni di dollari all'anno. Aitana López rappresenta invece la possibilità per i "singoli imprenditori" di creare influencer AI di successo. Creata dall'agenzia creativa spagnola The Clueless, questa modella virtuale dai capelli rosa ha oltre 370.000 follower su Instagram e un reddito mensile compreso tra 3.000 e 10.000 euro. Il motivo della sua creazione è molto pratico: il fondatore Rubén Cruz era stanco degli imprevisti legati ai modelli reali (ritardi, cancellazioni, conflitti di agenda) e ha deciso di "creare un'influencer che non desse mai buca". Le previsioni del colosso delle PR Ogilvy per il 2024 hanno scosso il settore: entro il 2026, gli influencer virtuali AI occuperanno il 30% dei budget destinati all'influencer marketing. Un sondaggio condotto su 1.000 senior marketer negli Stati Uniti e nel Regno Unito ha rivelato che il 79% degli intervistati sta aumentando gli investimenti in creatori di contenuti generati dall'AI. Comprendere la logica dei brand è fondamentale per capire i motori di questo cambiamento. Rischio zero, controllo totale. Il rischio maggiore con gli influencer umani è lo scandalo. Una dichiarazione inappropriata o uno scandalo nella vita privata possono vanificare investimenti milionari. Gli influencer virtuali non hanno questo problema. Non si stancano, non invecchiano e non pubblicano tweet alle tre di notte che fanno impazzire i team di pubbliche relazioni. Come afferma Rubén Cruz di The Clueless: "Molti progetti venivano sospesi o cancellati a causa di problemi personali degli influencer; non era un errore di design, ma l'imprevedibilità umana". Produzione di contenuti 24/7. Gli influencer virtuali possono pubblicare post ogni giorno, seguire i trend in tempo reale e "apparire" in qualsiasi scenario, con costi molto inferiori rispetto a uno shooting reale. Secondo le stime di BeyondGames, se Lil Miquela pubblicasse un post al giorno su Instagram, il suo potenziale di guadagno nel 2026 potrebbe raggiungere i 4,7 milioni di sterline. Questa efficienza produttiva è ineguagliabile per qualsiasi creatore umano. Coerenza millimetrica con il brand. La collaborazione tra Prada e Lil Miquela ha generato un tasso di interazione superiore del 30% rispetto alle campagne di marketing tradizionali. Ogni espressione, outfit e copy di un influencer virtuale può essere progettato con precisione per allinearsi perfettamente all'identità del brand. Tuttavia, c'è l'altra faccia della medaglia. Un report di Business Insider del marzo 2026 evidenzia che il malcontento dei consumatori verso gli account AI è in aumento, e alcuni brand hanno iniziato a fare marcia indietro sulle strategie con influencer AI. Un sondaggio di YouGov mostra che oltre un terzo degli intervistati esprime preoccupazione per la tecnologia AI. Ciò significa che gli influencer virtuali non sono una soluzione universale: l'autenticità rimane un valore fondamentale per i consumatori. Di fronte all'avanzata degli influencer virtuali AI, il panico è inutile; ciò che conta è l'azione. Ecco quattro strategie collaudate. Strategia 1: Punta sull'esperienza reale, fai ciò che l'AI non può fare. L'AI può generare un volto perfetto, ma non può assaporare davvero un caffè o sentire la stanchezza e la soddisfazione dopo un'escursione. In una discussione su Reddit (r/Futurology), l'opinione di un utente ha ricevuto molti consensi: "Gli influencer AI possono vendere prodotti, ma le persone desiderano ancora connessioni reali". Trasforma le tue esperienze di vita, il tuo punto di vista unico e i tuoi momenti imperfetti nel tuo baluardo difensivo. Strategia 2: Usa gli strumenti AI come alleati, non combatterli. I creatori più lungimiranti stanno già usando l'AI per aumentare l'efficienza. Su Reddit, alcuni creatori condividono i loro flussi di lavoro: ChatGPT per le sceneggiature, ElevenLabs per il doppiaggio e HeyGen per la produzione video. Non devi diventare un influencer AI, ma devi fare in modo che l'AI diventi il tuo assistente creativo. Strategia 3: Monitora i trend del settore in modo sistematico. Il settore degli influencer AI evolve a una velocità incredibile: ogni settimana compaiono nuovi strumenti, casi studio e dati. Seguire sporadicamente Twitter e Reddit non basta. Puoi usare per gestire in modo sistematico le informazioni sparse: salva articoli chiave, tweet e report di ricerca in un Board, usa l'AI per organizzarli e interroga la tua libreria di materiali con domande come: "Quali sono stati i tre maggiori finanziamenti nel settore degli influencer virtuali nel 2026?". Quando dovrai scrivere un'analisi o girare un video, i materiali saranno già pronti. Strategia 4: Esplora modelli di contenuto basati sulla collaborazione uomo-macchina. Il futuro non è una sfida a somma zero "Umano vs AI", ma una simbiosi "Umano + AI". Puoi usare l'AI per generare elementi visivi, ma dare loro un'anima attraverso la tua voce e le tue opinioni reali. Un'analisi di sottolinea che gli influencer AI sono adatti per concetti sperimentali e d'avanguardia, mentre gli influencer umani restano insostituibili per creare connessioni profonde con il pubblico e consolidare i valori del brand. La sfida principale nel seguire il trend degli influencer virtuali AI non è la mancanza di informazioni, ma il fatto che siano troppe e frammentate. Scenario tipico: vedi un tweet di Musk su X, leggi su Reddit un post che analizza come un influencer AI guadagni cifre a quattro zeri, scopri su Business Insider un report sui brand che si ritirano e guardi un tutorial su YouTube. Queste informazioni sono sparse su quattro piattaforme e cinque schede del browser; tre giorni dopo, quando vuoi scrivere un articolo, non riesci più a trovare quel dato fondamentale. Questo è esattamente il problema che risolve . Con l' puoi salvare con un clic qualsiasi pagina web, tweet o video YouTube nel tuo Board dedicato. L'AI estrarrà automaticamente le informazioni chiave e creerà un indice, permettendoti di fare ricerche e domande in linguaggio naturale. Ad esempio, creando un Board "Ricerca Influencer Virtuali AI", potrai chiedere direttamente: "Qual è il modello di business di Aitana López?" oppure "Quali brand hanno iniziato a ridurre gli investimenti negli influencer AI?". Le risposte appariranno con i link alle fonti originali. È importante precisare che il punto di forza di YouMind è l'integrazione delle informazioni e il supporto alla ricerca; non è uno strumento per generare influencer AI. Se hai bisogno di creare un personaggio virtuale, dovrai comunque affidarti a strumenti professionali come Midjourney, Stable Diffusion o HeyGen. Tuttavia, nel processo fondamentale "Ricerca trend → Accumulo materiali → Produzione contenuti", può ridurre drasticamente la distanza tra l'ispirazione e il prodotto finito. D: Gli influencer virtuali AI sostituiranno completamente quelli umani? R: Non nel breve termine. Gli influencer virtuali offrono vantaggi in termini di controllo del brand ed efficienza produttiva, ma la domanda di autenticità da parte dei consumatori resta forte. Report del 2026 indicano che alcuni brand hanno ridotto gli investimenti a causa del malcontento del pubblico. È più probabile che le due figure diventino complementari. D: Una persona comune può creare il proprio influencer virtuale AI? R: Sì. Su Reddit molti creatori condividono esperienze partendo da zero. Gli strumenti comuni includono Midjourney o Stable Diffusion per l'immagine, ChatGPT per i testi ed ElevenLabs per la voce. L'investimento iniziale può essere basso, ma sono necessari dai 3 ai 6 mesi di attività costante per vedere una crescita significativa. D: Quali sono le fonti di guadagno degli influencer virtuali AI? R: Principalmente tre: post sponsorizzati dai brand (i top influencer chiedono da migliaia a decine di migliaia di dollari a post), ricavi da piattaforme in abbonamento (come Fanvue) e diritti su musica o merchandising. Lil Miquela guadagna circa 40.000 dollari al mese solo dagli abbonamenti. D: Qual è la situazione del mercato degli idoli virtuali AI in Cina? R: La Cina è uno dei mercati più attivi al mondo. Le previsioni indicano che il mercato degli influencer virtuali cinesi raggiungerà i 270 miliardi di yuan entro il 2030. Da Hatsune Miku e Luo Tianyi fino agli idoli iper-realistici, il mercato cinese ha attraversato diverse fasi e si sta ora evolvendo verso l'interazione in tempo reale guidata dall'AI. D: Cosa devono considerare i brand quando scelgono di collaborare con un influencer virtuale? R: È fondamentale valutare tre aspetti: il grado di accettazione del pubblico target verso le figure virtuali, le policy di trasparenza dei contenuti AI delle piattaforme (TikTok e Instagram stanno diventando più severi) e la coerenza tra l'influencer e l'identità del brand. Si consiglia di iniziare con piccoli budget per testare i dati. L'ascesa degli influencer virtuali AI non è una profezia lontana, ma una realtà in corso. I dati di mercato dimostrano chiaramente che il loro valore commerciale è consolidato: dai 2 milioni di dollari annui di Lil Miquela ai guadagni mensili di Aitana López, questi numeri non possono essere ignorati. Per i creatori umani, tuttavia, questa non è una storia di "sostituzione", ma un'opportunità di "riposizionamento". La tua esperienza autentica, il tuo sguardo unico e la connessione emotiva con il pubblico sono asset che l'AI non può replicare. La chiave è: usare l'AI per l'efficienza, metodi sistematici per seguire i trend e l'autenticità per costruire un vantaggio competitivo insostituibile. Vuoi monitorare i trend degli influencer AI e accumulare materiali per le tue creazioni? Prova a costruire il tuo spazio di ricerca su , inizia gratuitamente. [1] [2] [3] [4] [5] [6] [7] [8] [9] [10] [11]