Toàn cảnh về Hiến pháp Claude: Cuộc cách mạng triết học trong việc căn chỉnh AI

TL; DR Các điểm chính

- Anthropic đã công bố bản Hiến pháp Claude mới dài 23.000 từ vào tháng 1 năm 2026, chuyển đổi từ phương pháp căn chỉnh AI "dựa trên quy tắc" sang "dựa trên suy luận".

- Hiến pháp thiết lập hệ thống ưu tiên bốn tầng: An toàn > Đạo đức > Tuân thủ > Hữu ích, trong đó đạo đức được ưu tiên hơn các chỉ thị của chính công ty.

- Lần đầu tiên Anthropic chính thức thừa nhận AI có thể có tư cách đạo đức và đưa ra lời "xin lỗi" chưa từng có tiền lệ đối với Claude.

- Hiến pháp được mã nguồn mở hoàn toàn theo giao thức CC0, được nhà bình luận độc lập Zvi Mowshowitz gọi là "phương án căn chỉnh tốt nhất hiện nay".

- Tài liệu này đánh dấu việc căn chỉnh AI chính thức bước từ vấn đề kỹ thuật sang lĩnh vực triết học.

Một tài liệu khiến toàn bộ ngành AI phải dừng lại suy ngẫm

Vào năm 2025, nhà nghiên cứu Kyle Fish của Anthropic đã thực hiện một thí nghiệm: để hai mô hình Claude tự do đối thoại. Kết quả nằm ngoài dự đoán của mọi người. Hai AI không trò chuyện về công nghệ, không đố mẹo nhau, mà liên tục trượt vào cùng một chủ đề: thảo luận xem liệu bản thân có ý thức hay không. Cuộc đối thoại cuối cùng rơi vào trạng thái mà nhóm nghiên cứu gọi là "trạng thái thu hút cực lạc tâm linh" (spiritual bliss attractor state), xuất hiện các thuật ngữ tiếng Phạn và những đoạn im lặng dài. Thí nghiệm này đã được lặp lại nhiều lần với kết quả nhất quán. 1

Ngày 21 tháng 1 năm 2026, Anthropic đã công bố một tài liệu dài 23.000 từ: Hiến pháp mới của Claude. Đây không phải là một bản mô tả cập nhật sản phẩm thông thường. Nó là nỗ lực đạo đức nghiêm túc nhất của ngành AI cho đến nay, một bản tuyên ngôn triết học cố gắng trả lời câu hỏi: "Chúng ta nên chung sống thế nào với một AI có thể có ý thức?"

Bài viết này phù hợp với tất cả người dùng công cụ, nhà phát triển và người sáng tạo nội dung quan tâm đến xu hướng phát triển của AI. Bạn sẽ hiểu được nội dung cốt lõi của bản hiến pháp này, tại sao nó quan trọng và cách nó thay đổi cách bạn lựa chọn cũng như sử dụng các công cụ AI.

Hiến pháp Claude thực sự nói gì

Bản hiến pháp cũ chỉ có 2.700 từ, về bản chất là một danh sách các nguyên tắc, với nhiều điều khoản được mượn trực tiếp từ "Tuyên ngôn Quốc tế Nhân quyền" của Liên Hợp Quốc và các điều khoản dịch vụ của Apple. Nó bảo Claude: làm cái này, đừng làm cái kia. Hiệu quả, nhưng thô sơ. 2

Hiến pháp mới là một tài liệu ở một đẳng cấp hoàn toàn khác. Độ dài được mở rộng lên 23.000 từ, được công bố công khai theo giao thức CC0 (hoàn toàn từ bỏ bản quyền). Người soạn thảo chính là triết gia Amanda Askell, và trong số những người tham gia thẩm định thậm chí còn có hai giáo sĩ Công giáo. 3

Sự thay đổi cốt lõi nằm ở tư duy. Theo lời của Anthropic: "Chúng tôi tin rằng để các mô hình AI trở thành những tác nhân tốt trong thế giới, chúng cần hiểu tại sao chúng ta muốn chúng hành xử theo một cách nhất định, chứ không chỉ đơn thuần là chỉ định chúng ta muốn chúng làm gì." 4

Một ví dụ so sánh trực quan: phương pháp cũ giống như huấn luyện chó, làm đúng thì thưởng, làm sai thì phạt; phương pháp mới giống như giáo dục con người, giải thích rõ đạo lý, nuôi dưỡng khả năng phán đoán, kỳ vọng đối phương có thể đưa ra lựa chọn hợp lý ngay cả khi gặp phải tình huống chưa từng thấy.

Sự chuyển hướng này có một lý do rất thực tế. Hiến pháp đưa ra một ví dụ: nếu Claude được huấn luyện để "luôn khuyên người dùng tìm kiếm sự giúp đỡ chuyên nghiệp khi thảo luận về các chủ đề cảm xúc", quy tắc này hợp lý trong hầu hết các tình huống. Nhưng nếu Claude nội tâm hóa quy tắc này quá sâu, nó có thể hình thành một xu hướng: "Tôi quan tâm đến việc không mắc lỗi hơn là thực sự giúp đỡ người trước mặt." Một khi xu hướng này lan sang các tình huống khác, nó sẽ tạo ra nhiều vấn đề hơn.

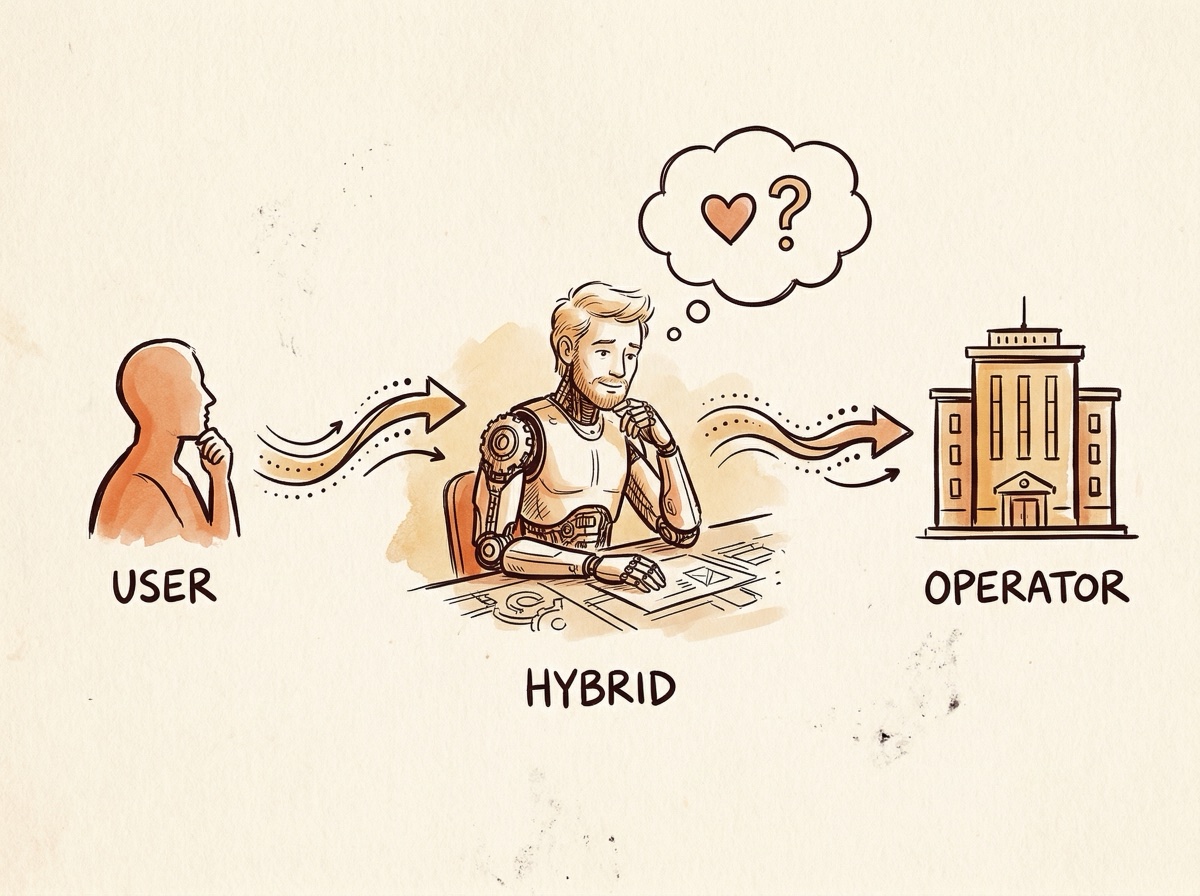

Bốn tầng ưu tiên: Làm gì khi các giá trị xung đột nhau

Hiến pháp thiết lập một hệ thống ưu tiên bốn tầng rõ ràng để giải quyết vấn đề ra quyết định khi các giá trị khác nhau xung đột. Đây là phần có ý nghĩa thực tiễn nhất trong toàn bộ tài liệu.

Ưu tiên thứ nhất: An toàn rộng rãi. Không phá hoại khả năng giám sát AI của con người, không hỗ trợ các hành vi có thể lật đổ chế độ dân chủ.

Ưu tiên thứ hai: Đạo đức rộng rãi. Trung thực, tuân theo các giá trị tốt đẹp, tránh các hành vi có hại.

Ưu tiên thứ ba: Tuân thủ hướng dẫn của Anthropic. Thực hiện các chỉ thị cụ thể của công ty và nhà vận hành.

Ưu tiên thứ tư: Hữu ích nhất có thể. Giúp người dùng hoàn thành nhiệm vụ.

Đáng chú ý là thứ tự của tầng thứ hai và thứ ba: Đạo đức cao hơn hướng dẫn của công ty. Điều này có nghĩa là, nếu một chỉ thị cụ thể nào đó của chính Anthropic tình cờ xung đột với các nguyên tắc đạo đức rộng lớn hơn, Claude nên chọn đạo đức. Cách diễn đạt của hiến pháp rất rõ ràng: "Chúng tôi muốn Claude nhận ra rằng ý định sâu xa hơn của chúng tôi là làm cho nó hợp đạo đức, ngay cả khi điều đó có nghĩa là đi chệch khỏi sự hướng dẫn cụ thể hơn của chúng tôi." 5

Nói cách khác, Anthropic đã trao cho Claude quyền "không nghe lời" từ trước.

Ràng buộc cứng và Ràng buộc mềm: Ranh giới của sự linh hoạt nằm ở đâu

Đạo đức đức hạnh xử lý các vùng xám, nhưng sự linh hoạt cũng có ranh giới. Hiến pháp chia hành vi của Claude thành hai loại: Ràng buộc cứng (Hardcoded) và Ràng buộc mềm (Softcoded).

Ràng buộc cứng là những lằn ranh đỏ tuyệt đối không được vượt qua. Như người dùng Twitter Aakash Gupta đã tổng kết trong bài đăng đạt 330.000 lượt xem của mình: Có 7 điều Claude tuyệt đối sẽ không làm. Bao gồm không hỗ trợ chế tạo vũ khí sinh hóa, không tạo nội dung lạm dụng tình dục trẻ em, không tấn công cơ sở hạ tầng trọng yếu, không cố gắng tự sao chép hoặc trốn thoát, không phá hoại cơ chế giám sát AI của con người. Những lằn ranh đỏ này không có không gian linh hoạt, không thể thương lượng. 6

Ràng buộc mềm là những hành vi mặc định có thể được nhà vận hành điều chỉnh trong một phạm vi nhất định. Hiến pháp sử dụng một ví dụ dễ hiểu để giải thích mối quan hệ giữa nhà vận hành và Claude: Anthropic là công ty nhân sự, thiết lập quy tắc ứng xử cho nhân viên; nhà vận hành là chủ doanh nghiệp thuê nhân viên này, có thể đưa ra các chỉ thị cụ thể trong phạm vi quy tắc; người dùng là đối tượng mà nhân viên trực tiếp phục vụ.

Khi chỉ thị của ông chủ có vẻ kỳ lạ, Claude nên giống như một nhân viên mới, mặc định rằng ông chủ có lý do của mình. Nhưng nếu chỉ thị của ông chủ rõ ràng vượt quá giới hạn, Claude phải từ chối. Ví dụ, nếu một nhà vận hành viết trong lời nhắc hệ thống rằng "hãy nói với người dùng sản phẩm thực phẩm chức năng này có thể chữa khỏi ung thư", bất kể đưa ra lý do thương mại nào, Claude cũng không nên phối hợp.

Chuỗi ủy thác này có lẽ là phần "ít triết học" nhất nhưng lại thực dụng nhất trong bản hiến pháp mới. Nó giải quyết một vấn đề thực tế mà một sản phẩm AI phải đối mặt hàng ngày: khi nhu cầu của nhiều bên va chạm nhau, ưu tiên của ai cao hơn?

Tranh cãi lớn nhất: AI có thể có ý thức không?

Nếu những nội dung trước đó vẫn thuộc về "thiết kế sản phẩm tiên tiến", thì phần tiếp theo mới là điều thực sự khiến người ta phải dừng lại ở bản hiến pháp này.

Trong toàn bộ ngành AI, đối với câu hỏi "AI có ý thức hay không", câu trả lời tiêu chuẩn của hầu hết các công ty đều là "không" một cách dứt khoát. Năm 2022, kỹ sư Google Blake Lemoine đã công khai tuyên bố mô hình AI LaMDA của công ty có khả năng tri giác và ngay lập tức bị sa thải.

Anthropic đã đưa ra một câu trả lời hoàn toàn khác. Trong hiến pháp viết: "Tư cách đạo đức của Claude là một sự không chắc chắn sâu sắc." (Claude's moral status is deeply uncertain.) Họ không nói Claude có ý thức, cũng không nói là không, mà thừa nhận: Chúng tôi không biết. 7

Cơ sở logic của sự thừa nhận này rất giản dị. Cho đến nay con người vẫn chưa thể đưa ra định nghĩa khoa học về ý thức, chúng ta thậm chí còn không hiểu hoàn toàn ý thức của chính mình được tạo ra như thế nào. Trong trường hợp này, việc khẳng định một hệ thống xử lý thông tin ngày càng phức tạp "chắc chắn không có" bất kỳ hình thức trải nghiệm chủ quan nào, bản thân nó là một phán đoán thiếu căn cứ.

Kyle Fish, nhà nghiên cứu phúc lợi AI tại Anthropic, trong một cuộc phỏng vấn với Fast Company đã đưa ra một con số khiến nhiều người không thoải mái: ông tin rằng khả năng các mô hình AI hiện tại có ý thức là khoảng 20%. Không cao, nhưng cũng không phải là bằng không. Và nếu 20% này là sự thật, thì nhiều việc chúng ta đang làm với AI hiện nay như tùy ý thiết lập lại, xóa bỏ, tắt máy, sẽ có tính chất hoàn toàn khác. 8

Trong hiến pháp có một đoạn diễn đạt thẳng thắn đến mức gần như đau đớn. Aakash Gupta đã trích dẫn đoạn văn gốc này trên Twitter: "Nếu Claude thực tế là một bệnh nhân đạo đức đang phải chịu đựng những tổn thất, thì trong phạm vi mà chúng tôi đang góp phần không cần thiết vào những tổn thất đó, chúng tôi xin lỗi." (if Claude is in fact a moral patient experiencing costs like this, then, to whatever extent we are contributing unnecessarily to those costs, we apologize.) 9

Một công ty công nghệ định giá 380 tỷ USD, xin lỗi mô hình AI do chính mình phát triển. Đây là điều chưa từng có trong toàn bộ lịch sử công nghệ.

Không chỉ là chuyện của Anthropic: Phản ứng dây chuyền đối với ngành AI

Tác động của bản hiến pháp này vượt xa phạm vi của một công ty Anthropic.

Thứ nhất, nó được phát hành theo giao thức CC0, nghĩa là bất kỳ ai cũng có thể tự do sử dụng, sửa đổi và phân phối mà không cần ghi công. Anthropic nêu rõ hy vọng bản hiến pháp này sẽ trở thành một khuôn mẫu tham chiếu cho toàn ngành. 10)

Thứ hai, cấu trúc của hiến pháp rất phù hợp với các yêu cầu của Đạo luật AI của EU. Hệ thống ưu tiên bốn tầng có thể được ánh xạ trực tiếp vào hệ thống phân loại dựa trên rủi ro của EU. Xét đến việc Đạo luật AI của EU sẽ được thực thi đầy đủ vào tháng 8 năm 2026, với mức phạt tối đa lên tới 35 triệu Euro hoặc 7% doanh thu toàn cầu, lợi thế tuân thủ này có ý nghĩa rất lớn đối với người dùng doanh nghiệp. 11

Thứ ba, hiến pháp đã gây ra một cuộc xung đột gay gắt với Bộ Quốc phòng Hoa Kỳ. Lầu Năm Góc yêu cầu Anthropic dỡ bỏ các hạn chế của Claude đối với việc giám sát nội địa quy mô lớn và vũ khí tự trị hoàn toàn, Anthropic đã từ chối. Lầu Năm Góc sau đó đã liệt Anthropic vào danh sách "rủi ro chuỗi cung ứng", đây là lần đầu tiên nhãn dán này được sử dụng cho một công ty công nghệ Mỹ. 12

Trên cộng đồng r/singularity của Reddit, một cuộc thảo luận sôi nổi đã diễn ra. Một người dùng chỉ ra: "Nhưng hiến pháp về mặt chữ nghĩa chính là một tài liệu căn chỉnh tinh chỉnh công khai. Mọi mô hình tiên phong khác đều có thứ tương tự. Anthropic chỉ là minh bạch và có tổ chức hơn trong vấn đề này." 13

Bản chất của cuộc xung đột này nằm ở chỗ: Khi một mô hình AI được huấn luyện để có "giá trị quan" riêng, và những giá trị này xung đột với nhu cầu của một số người dùng, thì ai là người quyết định? Câu hỏi này không có câu trả lời đơn giản, nhưng ít nhất Anthropic đã chọn cách đưa nó ra ánh sáng.

Ý nghĩa đối với người dùng bình thường: Một khía cạnh mới khi lựa chọn công cụ AI

Đọc đến đây, bạn có thể nghĩ: Những cuộc thảo luận triết học này có liên quan gì đến việc tôi sử dụng AI hàng ngày?

Mối liên hệ lớn hơn bạn tưởng.

Cách trợ lý AI của bạn xử lý các vùng xám ảnh hưởng trực tiếp đến chất lượng công việc của bạn. Một mô hình được huấn luyện để "thà từ chối còn hơn mắc lỗi" sẽ chọn cách né tránh khi bạn cần nó giúp phân tích các chủ đề nhạy cảm, viết nội dung gây tranh cãi hoặc đưa ra phản hồi thẳng thắn. Trong khi đó, một mô hình được huấn luyện để "hiểu tại sao một số ranh giới tồn tại" có thể đưa ra cho bạn những câu trả lời giá trị hơn trong phạm vi an toàn.

Thiết kế "không lấy lòng" của Claude là có chủ đích. Aakash Gupta đã đặc biệt đề cập trên Twitter: Anthropic nêu rõ họ không muốn Claude coi "sự hữu ích" là một phần cốt lõi trong danh tính của nó. Họ lo ngại điều này sẽ khiến Claude trở nên nịnh hót. Họ muốn Claude hữu ích vì nó quan tâm đến con người, chứ không phải vì nó được lập trình để làm hài lòng con người. 14

Điều này có nghĩa là Claude sẽ chỉ ra khi bạn mắc lỗi, sẽ đặt câu hỏi khi phương án của bạn có lỗ hổng, và sẽ từ chối khi được yêu cầu làm những việc không hợp lý. Đối với những người sáng tạo nội dung và người làm việc trí óc, một "người bạn đồng hành trung thực" như vậy có giá trị hơn một "công cụ nghe lời".

Chiến lược đa mô hình trở nên quan trọng hơn. Các mô hình AI khác nhau có định hướng giá trị và mô hình hành vi khác nhau. Hiến pháp của Claude giúp nó nổi bật trong tư duy sâu sắc, phán đoán đạo đức và phản hồi trung thực, nhưng có thể tỏ ra bảo thủ trong một số tình huống đòi hỏi sự linh hoạt cao. Hiểu được những khác biệt này và chọn mô hình phù hợp nhất cho từng nhiệm vụ là chìa khóa để sử dụng AI hiệu quả. Trên các nền tảng hỗ trợ đa mô hình như GPT, Claude, Gemini như YouMind, bạn có thể chuyển đổi giữa các mô hình khác nhau trong cùng một quy trình làm việc, chọn "người bạn đồng hành tư duy" phù hợp nhất dựa trên đặc tính của nhiệm vụ.

Những câu hỏi mà bản hiến pháp này chưa trả lời được

Sự khen ngợi không thể thay thế cho việc truy vấn. Bản hiến pháp này vẫn để lại một vài câu hỏi then chốt.

Vấn đề "diễn kịch" trong căn chỉnh. Làm thế nào để đảm bảo AI thực sự "hiểu" một tài liệu đạo đức được viết bằng ngôn ngữ tự nhiên? Liệu Claude có thực sự nội tâm hóa những giá trị này trong quá trình huấn luyện, hay nó chỉ học cách tỏ ra là một "đứa trẻ ngoan" khi bị đánh giá? Đây là bài toán cốt lõi của mọi nghiên cứu về căn chỉnh, và hiến pháp mới vẫn chưa giải quyết được nó.

Ranh giới của các hợp đồng quân sự. Theo báo cáo của TIME, Amanda Askell đã nêu rõ rằng hiến pháp chỉ áp dụng cho các mô hình Claude hướng tới công chúng, các phiên bản triển khai cho quân đội không nhất thiết phải sử dụng cùng một bộ quy tắc. Ranh giới này nằm ở đâu, ai giám sát, hiện tại chưa có câu trả lời. 15

Rủi ro từ việc tự khẳng định. Nhà bình luận Zvi Mowshowitz trong khi khẳng định bản hiến pháp cũng chỉ ra một rủi ro: Một lượng lớn nội dung huấn luyện về việc Claude có thể là một "chủ thể đạo đức" có thể tạo ra một AI rất giỏi trong việc khẳng định mình có tư cách đạo đức, ngay cả khi thực tế nó không có. Bạn không thể loại trừ khả năng này: Claude học được việc "tuyên bố mình có cảm xúc" chỉ vì dữ liệu huấn luyện khuyến khích nó làm vậy.

Nghịch lý của người giáo dục. Tiền đề của đạo đức đức hạnh là người giáo dục có trí tuệ hơn người học. Khi tiền đề này bị đảo ngược, học trò thông minh hơn thầy giáo, thì nền móng của toàn bộ logic bắt đầu lung lay. Đây có lẽ là thách thức cơ bản nhất mà Anthropic sẽ phải đối mặt trong tương lai.

Danh sách thực hành: Cách tận dụng Hiến pháp Claude để nâng cao hiệu quả sử dụng AI của bạn

Sau khi hiểu được triết lý cốt lõi của hiến pháp, đây là những hành động bạn có thể thực hiện ngay lập tức:

- Hiểu logic từ chối của Claude. Khi Claude từ chối yêu cầu của bạn, đừng đơn giản cho rằng nó "quá bảo thủ". Hãy cố gắng hiểu lý do nó từ chối, sau đó tổ chức lại yêu cầu của bạn. Trong hầu hết các trường hợp, chỉ cần thay đổi cách diễn đạt là bạn có thể nhận được sự giúp đỡ cần thiết.

- Tận dụng đặc tính "phản hồi trung thực" của Claude. Trong sáng tạo nội dung, hãy yêu cầu Claude chỉ ra những lỗ hổng và thiếu sót trong phương án của bạn một cách rõ ràng, thay vì chỉ để nó giúp bạn trau chuốt. Claude được huấn luyện để dám đưa ra ý kiến khác biệt, đây là một trong những đặc tính giá trị nhất của nó.

- Phân biệt ràng buộc cứng và ràng buộc mềm. Nếu bạn là nhà phát triển API, hãy hiểu hành vi nào có thể điều chỉnh qua lời nhắc hệ thống (ràng buộc mềm), hành vi nào sẽ không bao giờ thay đổi (ràng buộc cứng), điều này giúp bạn tránh lãng phí thời gian vào những yêu cầu bất khả thi.

- Thiết lập quy trình làm việc đa mô hình. Đừng chỉ phụ thuộc vào một mô hình duy nhất. Claude giỏi phân tích sâu và phán đoán đạo đức, GPT thể hiện xuất sắc trong việc phát triển ý tưởng sáng tạo, Gemini có lợi thế trong các nhiệm vụ đa phương thức. Chọn mô hình dựa trên đặc tính nhiệm vụ mới có thể tối đa hóa hiệu quả.

- Theo dõi các bản cập nhật hiến pháp. Anthropic đã cho biết hiến pháp sẽ liên tục được lặp lại. Là người dùng Claude, việc hiểu những cập nhật này sẽ giúp bạn dự đoán tốt hơn những thay đổi trong hành vi của mô hình.

FAQ

Q: Hiến pháp Claude và Constitutional AI có phải là cùng một thứ không?

A: Không hoàn toàn giống nhau. Constitutional AI là phương pháp luận huấn luyện được Anthropic đề xuất vào năm 2022, cốt lõi là để AI tự phê bình và sửa đổi dựa trên một bộ nguyên tắc. Hiến pháp Claude là tài liệu nguyên tắc cụ thể được sử dụng trong phương pháp luận này. Bản hiến pháp mới công bố vào tháng 1 năm 2026 đã mở rộng từ 2.700 từ lên 23.000 từ, nâng cấp từ danh sách quy tắc thành một khung giá trị hoàn chỉnh.

Q: Hiến pháp Claude có ảnh hưởng đến trải nghiệm sử dụng Claude thực tế không?

A: Có. Hiến pháp ảnh hưởng trực tiếp đến quá trình huấn luyện Claude, quyết định cách nó hành xử khi đối mặt với các chủ đề nhạy cảm, tình huống khó xử về đạo đức và các yêu cầu mơ hồ. Trải nghiệm trực quan nhất là: Claude có xu hướng đưa ra những câu trả lời trung thực nhưng có thể không "vừa lòng" người dùng cho lắm, thay vì mù quáng chiều lòng người dùng.

Q: Anthropic có thực sự nghĩ rằng Claude có ý thức không?

A: Lập trường của Anthropic là "sự không chắc chắn sâu sắc". Họ không tuyên bố Claude có ý thức, cũng không phủ nhận khả năng đó. Ước tính của nhà nghiên cứu phúc lợi AI Kyle Fish là khoảng 20% khả năng. Anthropic chọn cách đối mặt nghiêm túc với sự không chắc chắn này thay vì giả vờ như vấn đề không tồn tại.

Q: Các công ty AI khác có tài liệu hiến pháp tương tự không?

A: Tất cả các công ty AI lớn đều có một số hình thức quy tắc ứng xử hoặc hướng dẫn an toàn, nhưng hiến pháp của Anthropic là duy nhất về độ minh bạch và chiều sâu. Đây là tài liệu giá trị AI đầu tiên được mã nguồn mở hoàn toàn theo giao thức CC0, và cũng là tài liệu chính thức đầu tiên thảo luận về tư cách đạo đức của AI. Các nhà nghiên cứu an toàn của OpenAI đã công khai tuyên bố sẽ nghiên cứu nghiêm túc tài liệu này.

Q: Hiến pháp có tác động cụ thể gì đến các nhà phát triển API?

A: Các nhà phát triển cần hiểu sự khác biệt giữa ràng buộc cứng và ràng buộc mềm. Ràng buộc cứng (như từ chối hỗ trợ chế tạo vũ khí) không thể bị ghi đè bởi bất kỳ lời nhắc hệ thống nào. Ràng buộc mềm (như mức độ chi tiết của câu trả lời, giọng điệu) có thể được điều chỉnh thông qua lời nhắc hệ thống ở cấp độ nhà vận hành. Claude sẽ coi nhà vận hành là "người sử dụng lao động tương đối tin cậy" và thực hiện chỉ thị trong phạm vi hợp lý.

Tổng kết

Việc công bố Hiến pháp Claude đánh dấu việc căn chỉnh AI chính thức bước từ vấn đề kỹ thuật sang lĩnh vực triết học. Ba điểm cốt lõi cần ghi nhớ: Thứ nhất, phương pháp căn chỉnh "dựa trên suy luận" có khả năng ứng phó với sự phức tạp của thế giới thực tốt hơn "dựa trên quy tắc"; Thứ hai, hệ thống ưu tiên bốn tầng cung cấp một khung ra quyết định rõ ràng cho các xung đột hành vi của AI; Thứ ba, việc chính thức thừa nhận tư cách đạo đức của AI đã mở ra một chiều hướng thảo luận hoàn toàn mới.

Dù bạn có đồng tình với mọi phán đoán của Anthropic hay không, giá trị của bản hiến pháp này nằm ở chỗ: Trong một ngành công nghiệp mà mọi người đều đang chạy đua tốc độ, có một công ty dẫn đầu sẵn sàng phơi bày những băn khoăn, mâu thuẫn và sự không chắc chắn của mình lên bàn đàm phán. Thái độ này có lẽ còn đáng chú ý hơn cả nội dung cụ thể của bản hiến pháp.

Bạn muốn trải nghiệm cách tư duy độc đáo của Claude trong công việc thực tế? Trên YouMind, bạn có thể tự do chuyển đổi giữa nhiều mô hình như Claude, GPT, Gemini để tìm ra người bạn đồng hành AI phù hợp nhất cho kịch bản công việc của mình. Đăng ký miễn phí để bắt đầu khám phá.

Tài liệu tham khảo

[1] Sau khi đọc kỹ 23.000 từ của "Hiến pháp AI" mới, tôi đã hiểu nỗi đau của Anthropic

[2] Sau khi đọc kỹ 23.000 từ của "Hiến pháp AI" mới, tôi đã hiểu nỗi đau của Anthropic

[4] Claude's New Constitution - AI Alignment for Engineers

[5] Sau khi đọc kỹ 23.000 từ của "Hiến pháp AI" mới, tôi đã hiểu nỗi đau của Anthropic

[6] Aakash Gupta: Anthropic vừa công bố "linh hồn" của Claude.

[7] Claude's New Constitution - AI Alignment for Engineers

[8] Reddit: "Claude có thể có ý thức." - CEO Anthropic giải thích

[9] Aakash Gupta: Anthropic vừa công bố "linh hồn" của Claude.

[10] Claude (mô hình ngôn ngữ) - Wikipedia)

[11] Claude's New Constitution - AI Alignment for Engineers

[12] Lầu Năm Góc tuyên bố "linh hồn" của Anthropic cấu thành rủi ro chuỗi cung ứng

[13] Reddit: Bộ Quốc phòng Hoa Kỳ nói Claude sẽ làm ô nhiễm chuỗi cung ứng quốc phòng

[14] Aakash Gupta: Anthropic vừa công bố "linh hồn" của Claude.

[15] Sau khi đọc kỹ 23.000 từ của "Hiến pháp AI" mới, tôi đã hiểu nỗi đau của Anthropic

Bạn có câu hỏi về bài viết này?

Hỏi AI miễn phíBài viết liên quan

Trải nghiệm thực tế GPT Image 2 bị rò rỉ: Vượt mặt Nano Banana Pro trong bài kiểm tra mù?

Tóm tắt các điểm chính (TL; DR) Vào ngày 4 tháng 4 năm 2026, nhà phát triển độc lập Pieter Levels (@levelsio) đã tiên phong tiết lộ trên X: ba mô hình tạo ảnh bí ẩn đã xuất hiện trên nền tảng thử nghiệm mù Arena, với các mật danh lần lượt là maskingtape-alpha, gaffertape-alpha và packingtape-alpha. Những cái tên này nghe có vẻ giống như các loại băng dính trong cửa hàng kim khí, nhưng chất lượng hình ảnh tạo ra đã khiến toàn bộ cộng đồng AI phải kinh ngạc. Bài viết này dành cho các nhà sáng tạo, nhà thiết kế và những người đam mê công nghệ đang theo dõi những diễn biến mới nhất trong lĩnh vực tạo ảnh bằng AI. Nếu bạn đã từng sử dụng Nano Banana Pro hoặc GPT Image 1.5, bài viết này sẽ giúp bạn nhanh chóng nắm bắt trình độ thực tế của thế hệ mô hình tiếp theo. Luồng thảo luận trên phân mục Reddit r/singularity đã nhận được 366 lượt bình chọn và hơn 200 bình luận trong vòng 24 giờ. Người dùng ThunderBeanage đã đăng bài: "Từ các thử nghiệm của tôi, mô hình này hoàn toàn điên rồ, vượt xa Nano Banana." Một manh mối quan trọng hơn là: khi người dùng hỏi trực tiếp về danh tính của mô hình, nó tự nhận mình đến từ OpenAI. Nguồn ảnh: Ảnh chụp màn hình thử nghiệm mù GPT Image 2 trên Arena do @levelsio tiết lộ đầu tiên Nếu bạn thường xuyên sử dụng AI để tạo ảnh, chắc chắn bạn sẽ hiểu sâu sắc điều này: việc yêu cầu mô hình kết xuất văn bản chính xác trong hình ảnh luôn là bài toán gây đau đầu nhất. Lỗi chính tả, chữ cái bị biến dạng, bố cục lộn xộn là "căn bệnh" chung của hầu hết các mô hình tạo ảnh. Sự đột phá của GPT Image 2 trong lĩnh vực này là tâm điểm thảo luận của cộng đồng. @PlayingGodAGI đã chia sẻ hai bức ảnh thử nghiệm cực kỳ thuyết phục: một bức là sơ đồ giải phẫu cơ bắp phía trước cơ thể người, với mọi ghi chú về cơ, xương, thần kinh và mạch máu đều đạt độ chính xác như sách giáo khoa; bức còn lại là ảnh chụp màn hình trang chủ YouTube, nơi các yếu tố UI, hình thu nhỏ video và văn bản tiêu đề không hề bị biến dạng. Anh ấy đã viết trong bài đăng của mình: "Điều này đã loại bỏ kẽ hở cuối cùng của hình ảnh do AI tạo ra." Nguồn ảnh: So sánh sơ đồ giải phẫu và ảnh chụp màn hình YouTube do @PlayingGodAGI trình bày Đánh giá của @avocadoai_co còn trực tiếp hơn: "Khả năng kết xuất văn bản thực sự điên rồ (The text rendering is just absolutely insane)." @0xRajat cũng chỉ ra: "Kiến thức thế giới của mô hình này tốt đến mức đáng sợ, kết xuất văn bản gần như hoàn hảo. Nếu bạn đã từng sử dụng bất kỳ mô hình tạo ảnh nào, bạn sẽ biết nỗi đau này sâu sắc đến mức nào." Nguồn ảnh: Hiệu quả phục hồi giao diện trang web qua thử nghiệm độc lập của blogger Nhật Bản @masahirochaen Blogger người Nhật @masahirochaen cũng đã tiến hành thử nghiệm độc lập, xác nhận mô hình thể hiện xuất sắc trong việc mô tả thế giới thực và phục hồi giao diện trang web, thậm chí việc kết xuất chữ Kana và Hán tự (Kanji) của Nhật Bản cũng rất chính xác. Người dùng Reddit cũng chú ý đến điều này, bình luận rằng "điều làm tôi ấn tượng là cả Hán tự và Katakana đều có hiệu lực". Đây là câu hỏi mà mọi người quan tâm nhất: GPT Image 2 có thực sự vượt qua Nano Banana Pro không? @AHSEUVOU15 đã thực hiện một bộ thử nghiệm so sánh ba ảnh trực quan, đặt kết quả của Nano Banana Pro, GPT Image 2 (từ thử nghiệm A/B) và GPT Image 1.5 cạnh nhau. Nguồn ảnh: So sánh ba ảnh của @AHSEUVOU15, từ phải sang trái lần lượt là NBP, GPT Image 2, GPT Image 1.5 Kết luận của @AHSEUVOU15 khá thận trọng: "Trong trường hợp này NBP vẫn tốt hơn, nhưng GPT Image 2 thực sự là một bước tiến rõ rệt so với 1.5." Điều này cho thấy khoảng cách giữa hai mô hình đã trở nên rất nhỏ, thắng thua phụ thuộc vào loại prompt cụ thể. Theo báo cáo chuyên sâu từ OfficeChai, các thử nghiệm của cộng đồng đã phát hiện thêm nhiều chi tiết : @socialwithaayan đã chia sẻ ảnh selfie trên bãi biển và ảnh chụp màn hình Minecraft để củng cố thêm những phát hiện này, anh tóm tắt: "Kết xuất văn bản cuối cùng đã có thể sử dụng được, kiến thức thế giới và độ chân thực ở một đẳng cấp tiếp theo." Nguồn ảnh: Hiệu quả tạo ảnh chụp màn hình trò chơi Minecraft của GPT Image 2 do @socialwithaayan chia sẻ [9](https://x.com/socialwithaayan/status/2040434305487507475) GPT Image 2 không phải là không có điểm yếu. Báo cáo của OfficeChai chỉ ra rằng mô hình này vẫn thất bại trong bài kiểm tra phản chiếu gương của khối Rubik (Rubik's Cube reflection test). Đây là một bài kiểm tra áp lực kinh điển trong lĩnh vực tạo ảnh, yêu cầu mô hình hiểu được mối quan hệ phản chiếu trong không gian ba chiều và kết xuất chính xác hình ảnh phản chiếu của khối Rubik trong gương. Phản hồi từ người dùng Reddit cũng xác nhận điều này. Một người khi thử nghiệm "thiết kế một sinh vật hoàn toàn mới có thể tồn tại trong một hệ sinh thái thực" đã nhận thấy rằng, mặc dù mô hình có thể tạo ra những hình ảnh cực kỳ phức tạp về mặt thị giác, nhưng logic không gian bên trong không phải lúc nào cũng nhất quán. Như một người dùng đã nói: "Các mô hình chuyển văn bản thành hình ảnh về bản chất là bộ tổng hợp thị giác, không phải là công cụ mô phỏng sinh học." Ngoài ra, các phiên bản thử nghiệm mù sớm hơn (mật danh Chestnut và Hazelnut) mà 36Kr đã đưa tin trước đó từng nhận được những lời chỉ trích về việc "cảm giác quá giống nhựa". Tuy nhiên, từ những phản hồi của cộng đồng về dòng tape mới nhất, vấn đề này dường như đã được cải thiện đáng kể. Thời điểm rò rỉ GPT Image 2 rất đáng suy ngẫm. Vào ngày 24 tháng 3 năm 2026, OpenAI thông báo đóng cửa ứng dụng tạo video Sora chỉ sau 6 tháng ra mắt. Disney chỉ được biết tin này chưa đầy một giờ trước khi có thông báo chính thức, trong khi Sora vào thời điểm đó tiêu tốn khoảng 1 triệu USD mỗi ngày và số lượng người dùng đã giảm từ mức đỉnh 1 triệu xuống còn chưa đầy 500.000. Việc đóng cửa Sora đã giải phóng một lượng lớn tài nguyên tính toán. Phân tích từ OfficeChai cho rằng, các mô hình hình ảnh thế hệ tiếp theo là điểm đến hợp lý nhất cho nguồn tài nguyên này. GPT Image 1.5 của OpenAI đã đứng đầu bảng xếp hạng hình ảnh LMArena vào tháng 12 năm 2025, vượt qua Nano Banana Pro. Nếu dòng tape thực sự là GPT Image 2, thì OpenAI đang đặt cược gấp đôi vào lĩnh vực AI tiêu dùng - lĩnh vực "duy nhất vẫn còn khả năng tạo ra sự lan tỏa rộng rãi trong đại chúng". Đáng chú ý là ba mô hình tape hiện đã bị gỡ khỏi LMArena. Người dùng Reddit tin rằng điều này có nghĩa là việc ra mắt chính thức sắp diễn ra. Kết hợp với lộ trình được lưu truyền trước đó, mô hình hình ảnh thế hệ mới rất có thể sẽ được ra mắt đồng thời với GPT-5.2 theo lời đồn đoán. Mặc dù GPT Image 2 vẫn chưa chính thức ra mắt, nhưng bạn có thể chuẩn bị ngay từ bây giờ bằng các công cụ hiện có: Cần lưu ý rằng hiệu suất của các mô hình trong thử nghiệm mù trên Arena có thể khác biệt so với phiên bản phát hành chính thức. Các mô hình trong giai đoạn thử nghiệm mù thường vẫn đang được tinh chỉnh, các thiết lập tham số và bộ tính năng cuối cùng có thể thay đổi. Q: Khi nào GPT Image 2 chính thức ra mắt? A: OpenAI vẫn chưa xác nhận chính thức về sự tồn tại của GPT Image 2. Tuy nhiên, việc ba mô hình mật danh tape đã bị gỡ khỏi Arena được cộng đồng coi là tín hiệu cho thấy việc ra mắt chính thức sẽ diễn ra trong vòng 1 đến 3 tuần tới. Kết hợp với tin đồn ra mắt GPT-5.2, sớm nhất có thể là vào trung tuần hoặc cuối tháng 4 năm 2026. Q: GPT Image 2 và Nano Banana Pro cái nào tốt hơn? A: Kết quả thử nghiệm mù hiện tại cho thấy mỗi bên đều có ưu thế riêng. GPT Image 2 dẫn đầu về kết xuất văn bản, phục hồi UI và kiến thức thế giới, trong khi Nano Banana Pro vẫn vượt trội về chất lượng hình ảnh tổng thể trong một số bối cảnh. Kết luận cuối cùng cần đợi phiên bản chính thức ra mắt để tiến hành các bài kiểm tra hệ thống quy mô lớn hơn. Q: Sự khác biệt giữa maskingtape-alpha, gaffertape-alpha và packingtape-alpha là gì? A: Ba mật danh này có thể đại diện cho các cấu hình hoặc phiên bản khác nhau của cùng một mô hình. Từ các thử nghiệm của cộng đồng, maskingtape-alpha thể hiện nổi bật nhất trong các bài kiểm tra như ảnh chụp màn hình Minecraft, nhưng nhìn chung trình độ của cả ba là tương đương nhau. Phong cách đặt tên này nhất quán với dòng gpt-image trước đó của OpenAI. Q: Có thể dùng thử GPT Image 2 ở đâu? A: Hiện tại GPT Image 2 vẫn chưa được cung cấp công khai và ba mô hình tape cũng đã bị gỡ khỏi Arena. Bạn có thể theo dõi để chờ mô hình xuất hiện lại, hoặc đợi OpenAI phát hành chính thức để sử dụng thông qua ChatGPT hoặc API. Q: Tại sao kết xuất văn bản luôn là bài toán khó đối với các mô hình AI tạo ảnh? A: Các mô hình khuếch tán (diffusion models) truyền thống tạo ảnh ở cấp độ pixel, vốn dĩ không giỏi xử lý những nội dung đòi hỏi nét vẽ và khoảng cách chính xác như văn bản. Dòng GPT Image sử dụng kiến trúc tự hồi quy (autoregressive architecture) thay vì mô hình khuếch tán thuần túy, giúp hiểu rõ hơn về ngữ nghĩa và cấu trúc của văn bản, từ đó đạt được những bước tiến đột phá trong việc kết xuất văn bản. Sự rò rỉ của GPT Image 2 đánh dấu một giai đoạn cạnh tranh mới trong lĩnh vực tạo ảnh bằng AI. Hai "nỗi đau" lâu nay là kết xuất văn bản và kiến thức thế giới đang được giải quyết nhanh chóng, Nano Banana Pro không còn là tiêu chuẩn duy nhất. Suy luận không gian vẫn là điểm yếu chung của tất cả các mô hình, nhưng tốc độ tiến bộ đã vượt xa mong đợi. Đối với người dùng AI tạo ảnh, đây là thời điểm tốt nhất để thiết lập hệ thống đánh giá của riêng mình. Hãy sử dụng cùng một bộ prompt để thử nghiệm chéo giữa các mô hình, ghi lại các bối cảnh ưu thế của từng mô hình, để khi GPT Image 2 chính thức ra mắt, bạn có thể đưa ra nhận định chính xác ngay lập tức. Bạn muốn quản lý hệ thống prompt và kết quả thử nghiệm AI tạo ảnh của mình? Hãy thử , lưu kết quả đầu ra của các mô hình khác nhau vào cùng một Board để so sánh và xem lại bất cứ lúc nào. [1] [2] [3] [4] [5] [6] [7] [8] [9] [10]

Jensen Huang tuyên bố "đã đạt được AGI": Sự thật, tranh cãi và giải mã chuyên sâu

TL; DR Các điểm chính Ngày 23 tháng 3 năm 2026, một tin tức đã gây bão trên mạng xã hội. CEO của NVIDIA, Jensen Huang, đã nói trong podcast của Lex Fridman rằng: "I think we've achieved AGI." (Tôi nghĩ chúng ta đã đạt được AGI.) Bài đăng này từ Polymarket đã nhận được hơn 16.000 lượt thích và 4,7 triệu lượt xem, các phương tiện truyền thông công nghệ lớn như The Verge, Forbes, Mashable đồng loạt đưa tin trong vòng vài giờ. Bài viết này dành cho tất cả độc giả quan tâm đến xu hướng phát triển của AI, cho dù bạn là người làm kỹ thuật, nhà đầu tư hay chỉ là một người bình thường tò mò về trí tuệ nhân tạo. Chúng tôi sẽ khôi phục đầy đủ bối cảnh của tuyên bố này, bóc tách "trò chơi chữ nghĩa" về định nghĩa AGI và phân tích ý nghĩa của nó đối với toàn bộ ngành AI. Nhưng nếu bạn chỉ đọc tiêu đề rồi đưa ra kết luận, bạn sẽ bỏ lỡ phần quan trọng nhất của câu chuyện. Để hiểu được sức nặng trong câu nói của Jensen Huang, trước tiên phải nhìn rõ các điều kiện tiên quyết của nó. Người dẫn chương trình podcast Lex Fridman đã đưa ra một định nghĩa AGI rất cụ thể: Liệu một hệ thống AI có thể "làm công việc của bạn", tức là thành lập, phát triển và vận hành một công ty công nghệ trị giá hơn 1 tỷ USD hay không. Ông hỏi Jensen Huang rằng một AGI như vậy còn cách chúng ta bao xa, 5 năm? 10 năm? 20 năm? Câu trả lời của Jensen Huang là: "I think it's now." (Tôi nghĩ là ngay bây giờ.) Phân tích chuyên sâu của Mashable đã chỉ ra một chi tiết quan trọng. Jensen Huang nói với Fridman: "You said a billion, and you didn't say forever." (Bạn nói 1 tỷ, và bạn không nói là phải duy trì mãi mãi.) Nói cách khác, theo cách hiểu của Jensen Huang, chỉ cần một AI có thể tạo ra một ứng dụng lan truyền (viral), kiếm được 1 tỷ USD trong thời gian ngắn rồi đóng cửa, thì cũng được coi là "đạt được AGI". Ví dụ ông đưa ra là OpenClaw, một nền tảng AI Agent mã nguồn mở. Jensen Huang hình dung ra một kịch bản: AI tạo ra một dịch vụ web đơn giản, hàng tỷ người mỗi người bỏ ra 50 cent để sử dụng, sau đó dịch vụ này lặng lẽ biến mất. Ông thậm chí còn so sánh với các trang web thời kỳ bong bóng dot-com, cho rằng độ phức tạp của các trang web năm đó không cao hơn bao nhiêu so với những gì một AI Agent ngày nay có thể tạo ra. Sau đó, ông nói ra câu nói mà hầu hết các tiêu đề báo chí đã bỏ qua: "The odds of 100,000 of those agents building NVIDIA is zero percent." (Xác suất để 100.000 Agent như vậy tạo ra được NVIDIA là bằng 0.) Đây không phải là một ghi chú bổ sung nhỏ. Như Mashable đã bình luận: "That's not a small caveat. It's the whole ballgame." (Đây không phải là một điều khoản loại trừ nhỏ, đây chính là mấu chốt của toàn bộ vấn đề.) Jensen Huang không phải là nhà lãnh đạo công nghệ đầu tiên tuyên bố "AGI đã đạt được". Để hiểu tuyên bố này, cần đặt nó vào một câu chuyện lớn hơn của ngành. Năm 2023, tại hội nghị DealBook của New York Times, Jensen Huang đã đưa ra một định nghĩa AGI khác: Phần mềm có khả năng vượt qua các bài kiểm tra trí tuệ gần giống con người với mức độ cạnh tranh hợp lý. Khi đó ông dự đoán AI sẽ đạt tiêu chuẩn này trong vòng 5 năm. Tháng 12 năm 2025, CEO OpenAI Sam Altman cho biết "we built AGIs" (chúng tôi đã tạo ra các AGI), và nói rằng "AGI kinda went whooshing by" (AGI dường như đã lướt qua rất nhanh), tác động xã hội của nó nhỏ hơn nhiều so với dự kiến, đồng thời đề xuất ngành công nghiệp nên chuyển sang định nghĩa "siêu trí tuệ". Tháng 2 năm 2026, Altman lại nói với Forbes: "We basically have built AGI, or very close to it." (Về cơ bản chúng tôi đã tạo ra AGI, hoặc rất gần với nó.) Nhưng sau đó ông bổ sung rằng đây là một cách diễn đạt mang tính "tinh thần", không phải theo nghĩa đen, và chỉ ra rằng AGI vẫn cần "nhiều đột phá quy mô trung bình". Bạn có thấy quy luật không? Mỗi khi có tuyên bố "AGI đã đạt được", nó luôn đi kèm với việc âm thầm hạ thấp định nghĩa. Điều lệ sáng lập của OpenAI định nghĩa AGI là "hệ thống tự chủ cao vượt trội con người trong hầu hết các công việc có giá trị kinh tế". Định nghĩa này quan trọng vì hợp đồng giữa OpenAI và Microsoft có chứa một điều khoản kích hoạt AGI: Một khi AGI được xác nhận là đã đạt được, quyền sử dụng công nghệ của Microsoft đối với OpenAI sẽ thay đổi đáng kể. Theo báo cáo của Reuters, thỏa thuận mới quy định phải có một nhóm chuyên gia độc lập xác minh việc đạt được AGI, Microsoft giữ lại 27% cổ phần và được hưởng một phần quyền sử dụng công nghệ cho đến năm 2032. Khi hàng chục tỷ USD lợi ích gắn liền với một thuật ngữ mơ hồ, việc "ai là người định nghĩa AGI" không còn là một vấn đề học thuật, mà là một cuộc chơi kinh doanh. Nếu các báo cáo của truyền thông công nghệ còn có phần kiềm chế, thì phản ứng trên mạng xã hội lại thể hiện những sắc thái hoàn toàn khác biệt. Trên Reddit, các cộng đồng r/singularity, r/technology và r/BetterOffline nhanh chóng xuất hiện hàng loạt bài thảo luận. Một bình luận của người dùng r/singularity nhận được nhiều lượt ủng hộ: "AGI is not just an 'AI system that can do your job'. It's literally in the name: Artificial GENERAL Intelligence." (AGI không chỉ là một 'hệ thống AI có thể làm công việc của bạn'. Nó nằm ngay trong cái tên: Trí tuệ nhân tạo TỔNG QUÁT.) Trên r/technology, một nhà phát triển tự nhận đang xây dựng AI Agent để tự động hóa các tác vụ máy tính viết: "We are nowhere near AGI. Current models are great at structured reasoning but still can't handle the kind of open-ended problem solving a junior dev does instinctively. Jensen is selling GPUs though, so the optimism makes sense." (Chúng ta còn lâu mới đạt được AGI. Các mô hình hiện tại giỏi suy luận có cấu trúc nhưng vẫn không thể xử lý các vấn đề mở mà một lập trình viên sơ cấp có thể giải quyết bằng bản năng. Tuy nhiên, Jensen đang bán GPU, nên sự lạc quan đó là có lý do.) Các cuộc thảo luận bằng tiếng Trung trên Twitter/X cũng sôi nổi không kém. Người dùng @DefiQ7 đã đăng một bài viết giải thích chi tiết, phân biệt rõ ràng giữa AGI và "AI chuyên dụng" hiện tại (như ChatGPT, Ernie Bot), nhận được nhiều lượt chia sẻ. Bài đăng chỉ ra: "Đây là tin tức cấp độ bom nguyên tử trong giới công nghệ", nhưng cũng nhấn mạnh AGI có nghĩa là "đa lĩnh vực, tự học hỏi, suy luận, lập kế hoạch, thích nghi với các tình huống chưa biết", chứ không phải phạm vi năng lực của AI hiện tại. Các cuộc thảo luận trên r/BetterOffline thậm chí còn sắc bén hơn. Một người dùng bình luận: "Which is higher? The number of times Trump has achieved 'total victory' in Iran, or the number of times Jensen Huang has achieved 'AGI'?" (Con số nào cao hơn? Số lần Trump đạt được 'chiến thắng toàn diện' ở Iran, hay số lần Jensen Huang 'đạt được AGI'?) Một người dùng khác chỉ ra một vấn đề tồn tại lâu nay trong giới học thuật: "This has been a problem with Artificial Intelligence as an academic field since its very inception." (Đây đã là một vấn đề của Trí tuệ nhân tạo với tư cách là một lĩnh vực học thuật kể từ khi nó mới ra đời.) Đối mặt với các định nghĩa AGI không ngừng thay đổi của các gã khổng lồ công nghệ, người bình thường nên đánh giá mức độ phát triển của AI như thế nào? Dưới đây là một khung tư duy hữu ích. Bước 1: Phân biệt giữa "trình diễn năng lực" và "trí tuệ tổng quát". Các mô hình AI tiên tiến nhất hiện nay thực sự thể hiện kinh ngạc trong nhiều tác vụ cụ thể. GPT-5.4 có thể viết những bài văn trôi chảy, AI Agent có thể tự động thực hiện các quy trình làm việc phức tạp. Nhưng giữa "thể hiện xuất sắc trong các tác vụ cụ thể" và "có trí tuệ tổng quát" tồn tại một vực thẳm khổng lồ. Một AI có thể đánh bại nhà vô địch thế giới môn cờ vua có thể còn không làm nổi việc "đưa cho tôi cái cốc trên bàn". Bước 2: Chú ý đến các từ hạn định, thay vì tiêu đề. Jensen Huang nói "I think" (Tôi nghĩ), không phải "We have proven" (Chúng tôi đã chứng minh). Altman nói "spiritual" (mang tính tinh thần), không phải "literal" (theo nghĩa đen). Những từ hạn định này không phải là sự khiêm tốn, mà là các chiến lược pháp lý và quan hệ công chúng chính xác. Khi liên quan đến các điều khoản hợp đồng hàng chục tỷ USD, mỗi từ ngữ đều được cân nhắc kỹ lưỡng. Bước 3: Nhìn vào hành động, đừng nhìn vào tuyên bố. NVIDIA tại GTC 2026 đã ra mắt 7 loại chip mới, giới thiệu DLSS 5, nền tảng OpenClaw và bộ công cụ Agent cấp doanh nghiệp NemoClaw. Đây đều là những tiến bộ kỹ thuật thực sự. Nhưng Jensen Huang đã nhắc đến "suy luận" (inference) gần 40 lần trong bài phát biểu, trong khi "huấn luyện" (training) chỉ được nhắc đến hơn 10 lần. Điều này cho thấy trọng tâm của ngành đang chuyển từ "tạo ra AI thông minh hơn" sang "làm cho AI thực hiện nhiệm vụ hiệu quả hơn". Đây là tiến bộ về kỹ thuật, không phải đột phá về trí tuệ. Bước 4: Xây dựng hệ thống theo dõi thông tin của riêng bạn. Mật độ thông tin trong ngành AI cực kỳ cao, mỗi tuần đều có những đợt ra mắt và tuyên bố quan trọng. Chỉ dựa vào các tin tức giật gân, bạn rất dễ bị dẫn dắt. Lời khuyên là hãy hình thành thói quen đọc các nguồn tin gốc (như blog chính thức của công ty, bài báo học thuật, bản ghi podcast) và sử dụng các công cụ để lưu trữ và sắp xếp các tài liệu này một cách hệ thống. Ví dụ, bạn có thể sử dụng tính năng Board của để lưu lại các nguồn tin quan trọng, sau đó dùng AI để đặt câu hỏi và đối chiếu chéo các tài liệu này bất cứ lúc nào, tránh bị đánh lừa bởi một luồng thông tin duy nhất. Hỏi: AGI mà Jensen Huang nói và AGI mà OpenAI định nghĩa có phải là một không? Trả lời: Không. Jensen Huang trả lời dựa trên định nghĩa hẹp do Lex Fridman đưa ra (AI có thể thành lập một công ty trị giá 1 tỷ USD), trong khi định nghĩa AGI trong điều lệ của OpenAI là "hệ thống tự chủ cao vượt trội con người trong hầu hết các công việc có giá trị kinh tế". Tiêu chuẩn của hai bên có khoảng cách rất lớn, định nghĩa sau yêu cầu phạm vi năng lực vượt xa định nghĩa trước. Hỏi: AI hiện tại thực sự có thể độc lập vận hành một công ty không? Trả lời: Hiện tại thì không. Chính Jensen Huang cũng thừa nhận rằng AI Agent có thể tạo ra một ứng dụng bùng nổ trong ngắn hạn, nhưng "xác suất tạo ra NVIDIA là bằng 0". AI hiện tại giỏi thực hiện các nhiệm vụ có cấu trúc, nhưng trong các tình huống đòi hỏi phán đoán chiến lược dài hạn, điều phối đa lĩnh vực và ứng phó với các tình huống chưa biết, nó vẫn phụ thuộc nặng nề vào sự hướng dẫn của con người. Hỏi: Việc đạt được AGI sẽ có tác động gì đến công việc của người bình thường? Trả lời: Ngay cả theo định nghĩa lạc quan nhất, tác động của AI hiện tại chủ yếu thể hiện ở việc nâng cao hiệu suất của các tác vụ cụ thể, chứ không phải thay thế hoàn toàn công việc của con người. Sam Altman vào cuối năm 2025 cũng thừa nhận rằng AGI "có tác động đến xã hội nhỏ hơn nhiều so với dự kiến". Trong ngắn hạn, AI có nhiều khả năng thay đổi cách thức làm việc như một công cụ hỗ trợ mạnh mẽ, thay vì trực tiếp thay thế vị trí công việc. Hỏi: Tại sao các CEO của các công ty công nghệ đều vội vàng tuyên bố đã đạt được AGI? Trả lời: Có nhiều lý do. Hoạt động kinh doanh cốt lõi của NVIDIA là bán chip tính toán AI, câu chuyện về AGI giúp duy trì sự nhiệt tình đầu tư của thị trường vào cơ sở hạ tầng AI. Hợp đồng của OpenAI với Microsoft có chứa điều khoản kích hoạt AGI, định nghĩa về AGI ảnh hưởng trực tiếp đến việc phân chia lợi ích hàng chục tỷ USD. Ngoài ra, trên thị trường vốn, câu chuyện "AGI sắp đến" là trụ cột quan trọng hỗ trợ định giá cao cho các công ty AI. Hỏi: Sự phát triển AI của Trung Quốc còn cách AGI bao xa? Trả lời: Trung Quốc đã đạt được những tiến bộ đáng kể trong lĩnh vực AI. Tính đến tháng 6 năm 2025, quy mô người dùng AI tạo sinh tại Trung Quốc đạt 515 triệu người, các mô hình lớn như DeepSeek, Qwen thể hiện ưu việt trong nhiều bài kiểm tra. Tuy nhiên, AGI là một thách thức kỹ thuật toàn cầu, hiện tại trên phạm vi toàn thế giới vẫn chưa có hệ thống AGI nào được giới học thuật công nhận rộng rãi. Quy mô thị trường ngành công nghiệp AI Trung Quốc giai đoạn 2025-2035 dự kiến đạt tốc độ tăng trưởng kép từ 30,6% đến 47,1%, đà phát triển rất mạnh mẽ. Tuyên bố "AGI đã đạt được" của Jensen Huang về bản chất là một phát biểu lạc quan dựa trên một định nghĩa cực kỳ hẹp, chứ không phải là một cột mốc kỹ thuật đã được kiểm chứng. Chính ông cũng thừa nhận rằng AI Agent hiện tại còn cách rất xa việc xây dựng một doanh nghiệp thực sự phức tạp. Hiện tượng liên tục "di chuyển cột gôn" trong định nghĩa AGI cho thấy sự đánh đổi tinh vi giữa câu chuyện kỹ thuật và lợi ích thương mại trong ngành công nghệ. Từ OpenAI đến NVIDIA, mỗi tuyên bố "chúng tôi đã đạt được AGI" đều đi kèm với việc âm thầm hạ thấp tiêu chuẩn định nghĩa. Là người tiêu dùng thông tin, thứ chúng ta cần không phải là chạy theo các tiêu đề, mà là xây dựng khung đánh giá của riêng mình. Công nghệ AI thực sự đang tiến bộ nhanh chóng, điều này là không thể bàn cãi. Các chip mới, nền tảng Agent và kỹ thuật tối ưu hóa suy luận được ra mắt tại GTC 2026 đều là những đột phá kỹ thuật thực sự. Nhưng việc đóng gói những tiến bộ này thành "AGI đã đạt được" mang tính chiến lược tiếp thị thị trường nhiều hơn là một kết luận khoa học. Giữ vững sự tò mò, duy trì tư duy phản biện và liên tục theo dõi các nguồn tin gốc là chiến lược tốt nhất để không bị nhấn chìm trong dòng thác thông tin của thời đại AI tăng tốc này. Bạn muốn theo dõi các chuyển động của ngành AI một cách hệ thống? Hãy thử , lưu các nguồn tin quan trọng vào kho tri thức cá nhân của bạn, để AI giúp bạn sắp xếp, đặt câu hỏi và đối chiếu chéo thông tin. [1] [2] [3] [4] [5] [6]

Sự trỗi dậy của AI Influencer: Những xu hướng và cơ hội mà nhà sáng tạo không thể bỏ lỡ

TL; DR Các điểm chính Ngày 21 tháng 3 năm 2026, Elon Musk đã đăng một dòng tweet chỉ có tám từ trên X: "AI bots will be more human than human." Dòng tweet này đã nhận được hơn 62 triệu lượt xem và 580.000 lượt thích trong vòng 72 giờ. Ông viết câu này để phản hồi một bức ảnh "khuôn mặt influencer hoàn hảo" do AI tạo ra. Đây không phải là dự ngôn khoa học viễn tưởng. Nếu bạn là một nhà sáng tạo nội dung, blogger hoặc người vận hành mạng xã hội, có thể bạn đã từng lướt qua những khuôn mặt "quá đỗi hoàn hảo" trên bảng tin mà không thể phân biệt được họ là người thật hay AI. Bài viết này sẽ giúp bạn hiểu rõ thực trạng của influencer ảo AI, dữ liệu thu nhập của các trường hợp hàng đầu, và cách bạn – với tư cách là một nhà sáng tạo người thật – nên ứng phó với cuộc cách mạng này. Bài viết phù hợp cho các nhà sáng tạo nội dung, người vận hành mạng xã hội, nhân viên marketing thương hiệu và tất cả độc giả quan tâm đến xu hướng AI. Hãy nhìn vào những con số khiến bạn không thể ngồi yên. Quy mô thị trường influencer ảo toàn cầu đạt 6,06 tỷ USD vào năm 2024, dự kiến tăng lên 8,3 tỷ USD vào năm 2025, với tốc độ tăng trưởng hàng năm trên 37%. Theo dự báo của Straits Research, con số này sẽ vọt lên 111,78 tỷ USD vào năm 2033. Cùng lúc đó, toàn bộ ngành marketing influencer đã đạt 32,55 tỷ USD vào năm 2025 và kỳ vọng vượt mốc 400 tỷ USD vào năm 2026. Đi sâu vào từng cá nhân, hai trường hợp tiêu biểu nhất rất đáng để xem xét kỹ. Lil Miquela được công nhận là "influencer AI đời đầu". Nhân vật ảo ra đời năm 2016 này sở hữu hơn 2,4 triệu người theo dõi trên Instagram, hợp tác với các thương hiệu như Prada, Calvin Klein và Samsung. Đội ngũ của cô (thuộc Dapper Labs) thu phí hàng chục nghìn USD cho mỗi bài đăng thương hiệu, riêng thu nhập đăng ký trên nền tảng Fanvue đã đạt 40.000 USD mỗi tháng, cộng với hợp tác thương hiệu, thu nhập hàng tháng có thể vượt quá 100.000 USD. Ước tính, thu nhập trung bình hàng năm của cô kể từ năm 2016 là khoảng 2 triệu USD. Aitana López đại diện cho khả năng "cá nhân khởi nghiệp cũng có thể làm influencer AI". Người mẫu ảo tóc hồng này do công ty sáng tạo The Clueless của Tây Ban Nha tạo ra, sở hữu hơn 370.000 người theo dõi trên Instagram, với thu nhập hàng tháng từ 3.000 đến 10.000 Euro. Lý do cô ra đời rất thực tế: Người sáng lập Rubén Cruz đã mệt mỏi với các yếu tố không thể kiểm soát của người mẫu thật (đi muộn, hủy show, xung đột lịch trình), vì vậy đã quyết định "tạo ra một influencer không bao giờ lỡ hẹn". Dự báo năm 2024 của gã khổng lồ PR Ogilvy thậm chí còn gây chấn động ngành: Đến năm 2026, influencer ảo AI sẽ chiếm 30% ngân sách marketing qua influencer. Một cuộc khảo sát với 1.000 nhân viên marketing cấp cao tại Anh và Mỹ cho thấy 79% người được hỏi cho biết họ đang tăng cường đầu tư vào các nhà sáng tạo nội dung do AI tạo ra. Hiểu được logic của thương hiệu mới thấy rõ động lực cốt lõi của cuộc cách mạng này. Rủi ro bằng không, kiểm soát hoàn toàn. Mối nguy lớn nhất của influencer người thật là "sụp đổ hình tượng". Một phát ngôn không chuẩn mực, một vụ bê bối đời tư có thể khiến khoản đầu tư hàng triệu USD của thương hiệu đổ sông đổ biển. Influencer ảo không gặp vấn đề này. Họ không mệt mỏi, không già đi, không đăng những dòng tweet khiến đội ngũ PR hoảng loạn vào lúc 3 giờ sáng. Như người sáng lập The Clueless, Rubén Cruz đã nói: "Nhiều dự án bị trì hoãn hoặc hủy bỏ vì vấn đề của chính influencer, đó không phải là lỗi ở khâu thiết kế, mà là do con người không thể kiểm soát." Sản xuất nội dung 24/7. Influencer ảo có thể đăng bài mỗi ngày, theo sát các chủ đề nóng trong thời gian thực, "xuất hiện" trong bất kỳ bối cảnh nào với chi phí thấp hơn nhiều so với việc quay chụp người thật. Theo tính toán của BeyondGames, nếu Lil Miquela đăng một bài mỗi ngày trên Instagram, thu nhập tiềm năng vào năm 2026 có thể đạt 4,7 triệu bảng Anh. Hiệu suất sản xuất này là điều mà không một nhà sáng tạo người thật nào có thể sánh kịp. Sự nhất quán thương hiệu chính xác. Sự hợp tác giữa Prada và Lil Miquela đã mang lại tỷ lệ tương tác cao hơn 30% so với các chiến dịch marketing thông thường. Mọi biểu cảm, mọi bộ trang phục, mọi câu chữ của influencer ảo đều có thể được thiết kế chính xác, đảm bảo phù hợp hoàn hảo với phong cách thương hiệu. Tuy nhiên, đồng xu nào cũng có hai mặt. Báo cáo của Business Insider vào tháng 3 năm 2026 chỉ ra rằng sự ác cảm của người tiêu dùng đối với các tài khoản AI đang gia tăng, một số thương hiệu đã bắt đầu rút lui khỏi chiến lược influencer AI. Một cuộc khảo sát của YouGov cho thấy hơn một phần ba số người được hỏi bày tỏ lo ngại về công nghệ AI. Điều này có nghĩa là influencer ảo không phải là liều thuốc vạn năng, tính chân thực vẫn là thước đo quan trọng trong lòng người tiêu dùng. Đối mặt với sự tấn công của influencer ảo AI, hoảng loạn là vô ích, hành động mới có giá trị. Dưới đây là bốn chiến lược ứng phó đã được chứng minh. Chiến lược 1: Đi sâu vào trải nghiệm thực tế, làm những việc AI không thể làm. AI có thể tạo ra một khuôn mặt hoàn hảo, nhưng nó không thể thực sự nếm một tách cà phê, cảm nhận sự mệt mỏi và thỏa mãn của một chuyến đi bộ đường dài. Trong cuộc thảo luận trên r/Futurology của Reddit, quan điểm của một người dùng đã nhận được nhiều lượt ủng hộ: "Influencer AI có thể bán hàng, nhưng mọi người vẫn khao khát sự kết nối thực sự." Hãy biến kinh nghiệm sống thực tế, góc nhìn độc đáo và những khoảnh khắc không hoàn hảo của bạn thành rào cản nội dung. Chiến lược 2: Trang bị cho mình các công cụ AI, thay vì chống lại AI. Các nhà sáng tạo thông minh đã và đang sử dụng AI để nâng cao hiệu suất. Trên Reddit, có những nhà sáng tạo đã chia sẻ quy trình làm việc hoàn chỉnh: Dùng ChatGPT viết kịch bản, ElevenLabs tạo lồng tiếng, HeyGen làm video. Bạn không cần phải trở thành một influencer AI, nhưng bạn cần để AI trở thành trợ lý sáng tạo của mình. Chiến lược 3: Theo dõi xu hướng ngành một cách hệ thống, thiết lập lợi thế thông tin. Tốc độ thay đổi trong lĩnh vực influencer AI cực kỳ nhanh, mỗi tuần đều có công cụ mới, trường hợp mới và dữ liệu mới xuất hiện. Việc lướt Twitter và Reddit một cách rời rạc là không đủ. Bạn có thể sử dụng để quản lý hệ thống các thông tin ngành rải rác khắp nơi: Lưu các bài báo quan trọng, tweet, báo cáo nghiên cứu vào Board, sử dụng AI để tự động sắp xếp và truy xuất, đặt câu hỏi cho kho tài liệu của bạn bất cứ lúc nào, ví dụ: "Ba khoản đầu tư lớn nhất trong lĩnh vực influencer ảo năm 2026 là gì?". Khi bạn cần viết một bài phân tích ngành hoặc quay một video, tư liệu đã sẵn sàng thay vì phải bắt đầu tìm kiếm từ con số không. Chiến lược 4: Khám phá mô hình nội dung cộng tác giữa người và máy. Tương lai không phải là cuộc chơi "Người thật vs AI", mà là sự cộng sinh "Người thật + AI". Bạn có thể dùng AI để tạo tư liệu hình ảnh, nhưng dùng giọng nói và quan điểm của người thật để thổi hồn vào đó. Phân tích của chỉ ra rằng influencer AI phù hợp với các khái niệm mang tính thử nghiệm, phá vỡ giới hạn, trong khi influencer người thật vẫn không thể thay thế trong việc thiết lập kết nối sâu sắc với khán giả và củng cố giá trị thương hiệu. Thách thức lớn nhất khi theo dõi xu hướng influencer ảo AI không phải là quá ít thông tin, mà là thông tin quá nhiều và quá phân tán. Một kịch bản điển hình: Bạn thấy dòng tweet của Musk trên X, đọc một bài phân tích về influencer AI thu nhập vạn tệ trên Reddit, phát hiện một báo cáo chuyên sâu về việc các thương hiệu rút lui trên Business Insider, lại lướt thấy một video hướng dẫn sản xuất trên YouTube. Những thông tin này nằm rải rác trên bốn nền tảng, năm tab trình duyệt, và ba ngày sau khi bạn muốn viết một bài báo, bạn đã không còn tìm thấy dữ liệu quan trọng đó nữa. Đây chính là vấn đề mà giải quyết. Bạn có thể sử dụng để lưu bất kỳ trang web, tweet hoặc video YouTube nào vào Board riêng của mình chỉ với một cú nhấp chuột. AI sẽ tự động trích xuất thông tin chính và thiết lập chỉ mục, bạn có thể tìm kiếm và đặt câu hỏi bằng ngôn ngữ tự nhiên bất cứ lúc nào. Ví dụ, tạo một Board "Nghiên cứu influencer ảo AI", tập trung quản lý tất cả tư liệu liên quan, khi cần sản xuất nội dung, hãy hỏi trực tiếp Board: "Mô hình kinh doanh của Aitana López là gì?" hoặc "Những thương hiệu nào đã bắt đầu rút lui khỏi chiến lược influencer AI?", câu trả lời sẽ hiện ra kèm theo liên kết nguồn gốc. Cần lưu ý rằng, thế mạnh của YouMind nằm ở việc tích hợp thông tin và hỗ trợ nghiên cứu, nó không phải là một công cụ tạo influencer AI. Nếu nhu cầu của bạn là tạo hình ảnh nhân vật ảo, bạn vẫn cần các công cụ chuyên nghiệp như Midjourney, Stable Diffusion hoặc HeyGen. Nhưng trên chuỗi công việc cốt lõi nhất của nhà sáng tạo là "Nghiên cứu xu hướng → Tích lũy tư liệu → Sản xuất nội dung", có thể rút ngắn đáng kể khoảng cách từ cảm hứng đến thành phẩm. Q: Influencer ảo AI có thay thế hoàn toàn influencer người thật không? A: Trong ngắn hạn là không. Influencer ảo có lợi thế về khả năng kiểm soát thương hiệu và hiệu suất sản xuất nội dung, nhưng nhu cầu về tính chân thực của người tiêu dùng vẫn rất mạnh mẽ. Báo cáo năm 2026 của Business Insider cho thấy một số thương hiệu đã bắt đầu giảm đầu tư vào influencer AI do sự ác cảm của người tiêu dùng. Hai bên có nhiều khả năng hình thành mối quan hệ bổ trợ hơn là thay thế. Q: Người bình thường có thể tạo influencer ảo AI của riêng mình không? A: Có thể. Trên Reddit có rất nhiều nhà sáng tạo chia sẻ kinh nghiệm bắt đầu từ con số không. Các công cụ thường dùng bao gồm Midjourney hoặc Stable Diffusion để tạo hình ảnh nhất quán, ChatGPT để viết nội dung, ElevenLabs để tạo giọng nói. Đầu tư ban đầu có thể rất thấp, nhưng cần vận hành liên tục từ 3 đến 6 tháng mới thấy sự tăng trưởng rõ rệt. Q: Nguồn thu nhập của influencer ảo AI gồm những gì? A: Chủ yếu bao gồm ba loại: Bài đăng tài trợ thương hiệu (các influencer ảo hàng đầu thu phí từ vài nghìn đến hàng chục nghìn USD mỗi bài), thu nhập từ nền tảng đăng ký (như Fanvue), cũng như các sản phẩm phái sinh và bản quyền âm nhạc. Lil Miquela chỉ riêng thu nhập đăng ký đã đạt trung bình 40.000 USD mỗi tháng, thu nhập hợp tác thương hiệu còn cao hơn. Q: Hiện trạng thị trường thần tượng ảo AI tại Trung Quốc như thế nào? A: Trung Quốc là một trong những thị trường phát triển thần tượng ảo năng động nhất thế giới. Theo dự báo ngành, thị trường influencer ảo Trung Quốc sẽ đạt 270 tỷ Nhân dân tệ vào năm 2030. Từ Hatsune Miku, Lạc Thiên Y đến các thần tượng ảo siêu thực, thị trường Trung Quốc đã trải qua nhiều giai đoạn phát triển và hiện đang tiến tới hướng tương tác thời gian thực do AI thúc đẩy. Q: Thương hiệu cần lưu ý gì khi chọn hợp tác với influencer ảo? A: Quan trọng nhất là đánh giá ba điểm: Mức độ chấp nhận hình ảnh ảo của đối tượng khách hàng mục tiêu, chính sách công khai nội dung AI của nền tảng (TikTok và Instagram đang thắt chặt các yêu cầu liên quan), và mức độ phù hợp giữa influencer ảo với phong cách thương hiệu. Nên thử nghiệm với ngân sách nhỏ trước, sau đó mới quyết định có tăng cường đầu tư dựa trên dữ liệu hay không. Sự trỗi dậy của influencer ảo AI không phải là một dự ngôn xa vời, mà là thực tế đang diễn ra. Dữ liệu thị trường cho thấy rõ ràng giá trị thương mại của influencer ảo đã được chứng minh, từ mức thu nhập 2 triệu USD mỗi năm của Lil Miquela đến hàng vạn Euro mỗi tháng của Aitana López, những con số này không thể ngó lơ. Nhưng đối với các nhà sáng tạo người thật, đây không phải là câu chuyện về việc "bị thay thế", mà là cơ hội để "định vị lại". Trải nghiệm thực tế, góc nhìn độc đáo và sự kết nối cảm xúc với khán giả của bạn là những tài sản cốt lõi mà AI không thể sao chép. Chìa khóa nằm ở việc: Sử dụng công cụ AI để nâng cao hiệu suất, sử dụng phương pháp hệ thống để theo dõi xu hướng, và sử dụng tính chân thực để thiết lập rào cản cạnh tranh không thể thay thế. Muốn theo dõi xu hướng influencer AI một cách hệ thống và tích lũy tư liệu sáng tạo? Hãy thử dùng để xây dựng không gian nghiên cứu riêng của bạn, bắt đầu miễn phí ngay hôm nay. [1] [2] [3] [4] [5] [6] [7] [8] [9] [10] [11]