Guia de criação em massa de conteúdo visual e textual com AI: O workflow essencial para criadores de conteúdo

TL; DR Principais Pontos

- Dos mais de 207 milhões de criadores de conteúdo no mundo, 91% já utilizam IA generativa para aumentar a eficiência da produção, com usuários avançados alcançando um aumento de 3 a 5 vezes na produtividade.

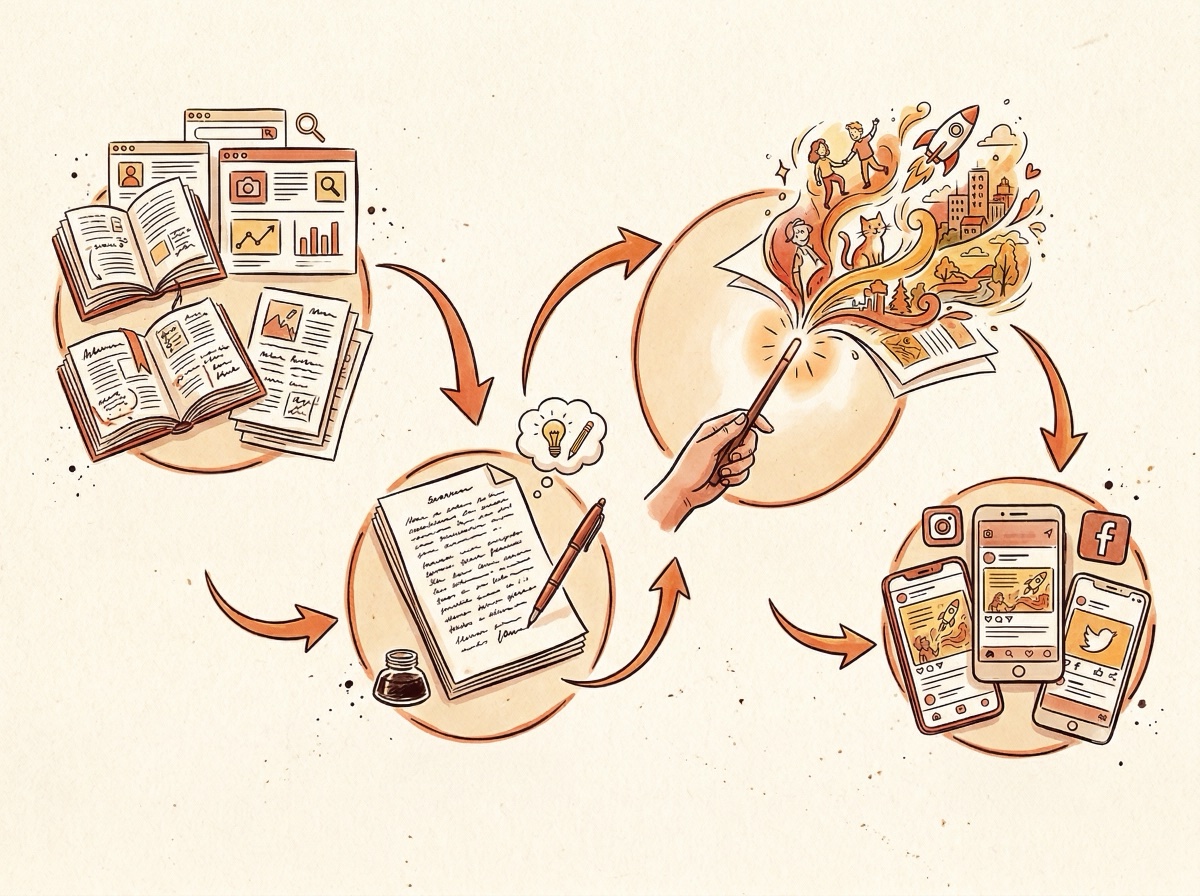

- O cerne da criação em massa de conteúdo visual e textual com IA não é "encontrar uma boa ferramenta", mas sim construir um fluxo de trabalho completo: "Coleta de material → Geração de história → Produção de imagens → Distribuição multiplataforma".

- Livros ilustrados infantis, infográficos de divulgação científica e cartões de conhecimento são os melhores pontos de entrada para a criação em massa com IA. Produzir de 10 a 20 conjuntos de conteúdo de alta qualidade por dia, individualmente, já é uma realidade.

- Consistência de personagens, unidade de estilo e conformidade de direitos autorais são os três principais desafios na criação de conteúdo com IA; o texto inclui soluções específicas.

Sua velocidade de produção está sendo superada pela concorrência

Um fato cruel: enquanto você ainda está ajustando repetidamente as imagens para um único post, seu concorrente pode já ter concluído o cronograma de conteúdo de uma semana inteira usando ferramentas de IA.

De acordo com dados do setor do início de 2026, o mercado global de criação de conteúdo por IA atingiu 24,08 bilhões de dólares, um crescimento anual superior a 21% 1. Mais notável é a mudança no mercado interno: equipes de mídia digital que aplicam IA profundamente aumentaram sua eficiência de produção em média 3 a 5 vezes. Processos de planejamento de pauta, coleta de material e design visual que antes levavam uma semana agora podem ser reduzidos para 1 ou 2 dias 2.

Este artigo é ideal para gestores de redes sociais, criadores de conteúdo visual e textual que buscam ferramentas de criação por IA, bem como criadores que desejam usar IA para gerar livros ilustrados, histórias infantis e afins. Você obterá um fluxo de trabalho comprovado para criação em massa com IA, com orientações operacionais específicas para cada etapa, da coleta de material ao produto final.

Por que o "conteúdo visual e textual" é o melhor ponto de partida para a criação em massa com IA

Muitos criadores, ao terem o primeiro contato com ferramentas de criação de conteúdo por IA, tentam diretamente escrever textos longos ou fazer vídeos. No entanto, do ponto de vista do custo-benefício, o conteúdo visual e textual (imagem + texto) é a categoria mais fácil de viabilizar na criação em massa.

Existem três razões. Primeiro, a cadeia de produção é curta. Um conjunto de conteúdo visual precisa apenas de dois elementos centrais: "copy + imagens", e a IA já está madura o suficiente em ambos os aspectos. Segundo, a margem de erro é alta. Se uma ilustração gerada por IA tiver uma pequena imperfeição, ela mal será notada no feed das redes sociais; mas se um vídeo gerado por IA apresentar uma deformação facial, o público perceberá imediatamente. Terceiro, os canais de distribuição são variados. O mesmo conjunto de conteúdo pode ser publicado simultaneamente no Instagram, LinkedIn, Pinterest e outras plataformas, com um custo marginal baixíssimo.

Livros ilustrados infantis e infográficos educativos são dois nichos especialmente adequados para a criação em massa com IA. No caso dos livros infantis, um caso prático amplamente discutido mostra que um criador usou o ChatGPT para gerar o texto da história e o Midjourney para as ilustrações, conseguindo listar com sucesso o livro infantil "Alice and Sparkle" na Amazon 3. Há também criadores que, usando a combinação de ferramentas de IA, criaram contas de histórias infantis em redes sociais, ganhando mais de 100 mil seguidores em um único mês.

A lógica comum por trás desses casos é: a tecnologia de geração de histórias infantis por IA e a geração de livros ilustrados já amadureceram o suficiente para sustentar operações comerciais; o segredo está em ter um fluxo de trabalho eficiente.

Os quatro principais desafios da criação em massa de conteúdo visual

Antes de começar a colocar a mão na massa, entenda os quatro erros mais comuns na criação em massa com IA. Na comunidade r/KDP do Reddit e em discussões de criadores, esses problemas são mencionados repetidamente 4.

Desafio 1: Consistência de personagens. Este é o maior problema ao gerar livros ilustrados com IA. Você pede para a IA desenhar uma menina de chapéu vermelho; a primeira imagem tem rosto redondo e cabelo curto, a segunda pode vir com cabelo longo e olhos grandes. O analista de ilustrações Sachin Kamath, no X (Twitter), após estudar mais de 1.000 ilustrações de livros de IA, apontou que os criadores costumam focar apenas se a ilustração é "bonita", ignorando a questão crucial: "consigo manter a consistência?".

Desafio 2: Cadeia de ferramentas muito longa. Um fluxo típico de criação pode envolver 5 ou 6 ferramentas diferentes: ChatGPT para o texto, Midjourney para imagens, Canva para o layout, CapCut para legendas e as interfaces das plataformas para publicar. Cada vez que você troca de ferramenta, seu fluxo criativo é interrompido, resultando em uma enorme perda de eficiência.

Desafio 3: Flutuação de qualidade. A qualidade do conteúdo gerado por IA é instável. O mesmo prompt pode gerar uma imagem incrível hoje e uma com seis dedos bizarros amanhã. Na criação em massa, o custo de tempo para o controle de qualidade é frequentemente subestimado.

Desafio 4: Zona cinzenta dos direitos autorais. Um relatório de 2025 do Escritório de Direitos Autorais dos EUA afirmou claramente que conteúdos gerados puramente por IA, sem contribuição criativa humana suficiente, não são elegíveis para proteção de direitos autorais 5. Isso significa que, se você planeja usar livros ilustrados gerados por IA para publicação comercial, deve garantir que haja edição humana e investimento criativo suficientes.

Cinco etapas para montar seu fluxo de trabalho de criação em massa com IA

Compreendidos os desafios, aqui está um fluxo de trabalho de cinco etapas validado na prática. A ideia central é: usar um espaço de trabalho o mais unificado possível para completar todo o processo, reduzindo a perda de eficiência causada pela troca de ferramentas.

Passo 1: Criar uma biblioteca de inspiração e materiais. O pré-requisito para a criação em massa é ter reserva de material suficiente. Você precisa de um lugar para centralizar análises de concorrentes, temas populares, imagens de referência e amostras de estilo. Muitos criadores usam favoritos do navegador ou salvos em apps de mensagens, mas esses conteúdos ficam dispersos. Uma abordagem melhor é usar ferramentas de gestão de conhecimento para arquivar sites, PDFs, imagens e vídeos de forma unificada, permitindo buscas rápidas com IA. Por exemplo, no YouMind, você pode salvar referências de posts virais, estilos de livros ilustrados e relatórios de público-alvo em um Board e, depois, perguntar diretamente à IA: "Qual é a configuração de personagem mais comum nestes livros?" ou "Qual esquema de cores tem maior engajamento em contas de pais e filhos?". A IA dará a análise baseada em todo o material coletado.

Passo 2: Gerar estruturas de texto em massa. Com a biblioteca de materiais pronta, o próximo passo é gerar os textos. Para histórias infantis, você pode definir um tema de série (ex: "As Aventuras das Quatro Estações da Raposinha") e usar a IA para gerar de 10 a 20 esboços de uma só vez, cada um com protagonista, cenário, conflito e desfecho. O truque principal é definir claramente uma Ficha de Personagem (Character Sheet) no prompt, incluindo características físicas, traços de personalidade e bordões, para manter a consistência nas ilustrações posteriores.

Passo 3: Gerar imagens com estilo unificado. Esta é a etapa mais técnica do fluxo. As ferramentas de geração de imagem por IA de 2026 já conseguem lidar bem com a consistência de personagens. Na prática, recomenda-se usar um prompt para gerar uma imagem de referência do personagem (Character Reference) e, em seguida, citar essa referência nos prompts de cada ilustração subsequente. Ferramentas que suportam esse fluxo incluem Midjourney (via parâmetro --cref) e Recraft AI (via função de bloqueio de estilo). A capacidade de geração de imagens integrada do YouMind suporta múltiplos modelos como Nano Banana Pro, Seedream 4.5 e GPT Image 1.5, permitindo comparar resultados no mesmo espaço de trabalho e escolher o melhor para seu estilo, sem precisar pular de site em site.

Passo 4: Montagem e revisão de qualidade. Após montar o texto e as imagens, a revisão humana é obrigatória. Foque em três aspectos: se a aparência do personagem é consistente em diferentes cenários, se há erros lógicos comuns de IA no texto (como tramas contraditórias) e se há rastros óbvios de IA nas imagens (dedos extras, textos distorcidos, etc.). Esta etapa não pode ser pulada; ela define se seu conteúdo é "lixo de IA" ou "conteúdo de alta qualidade assistido por IA".

Passo 5: Adaptação e distribuição multiplataforma. O mesmo conteúdo precisa de formatos diferentes para cada plataforma. O Instagram prefere imagens verticais (4:5) com legendas curtas, blogs precisam de capas horizontais com textos longos, e o TikTok Imagens requer o formato 9:16 com legendas sobrepostas. Na criação em massa, recomenda-se gerar versões em múltiplas proporções já na fase de criação da imagem, em vez de cortá-las depois.

Como escolher ferramentas de criação de conteúdo por IA

A quantidade de ferramentas de criação de conteúdo por IA no mercado é enorme; o levantamento da TechTarget em 2026 listou mais de 35 opções 6. Para cenários de criação em massa, ao escolher uma ferramenta, você deve focar em três dimensões: se suporta a integração de texto e imagem (completar ambos na mesma plataforma), se permite alternar entre múltiplos modelos (modelos diferentes são bons em estilos diferentes) e se possui capacidade de automação de fluxo de trabalho (reduzindo operações repetitivas).

Ferramenta | Melhor Cenário | Versão Gratuita | Vantagem Principal |

|---|---|---|---|

Pesquisa de material + Fluxo completo de criação | ✅ | Geração multimodelo + Gestão de conhecimento + Fluxos de Agentes; tudo em um só lugar | |

Diagramação e design de templates | ✅ | Enorme biblioteca de templates, ideal para layout rápido, mas geração de imagem limitada | |

Criação específica de livros infantis | Créditos de teste | Focada em livros ilustrados, boa consistência de personagens, mas limitada a esse nicho | |

Livros de histórias personalizados | ✅ | Operação simples, ideal para pais e professores, mas fraca em criação em massa |

Vale ressaltar que o YouMind atualmente se destaca no ciclo completo "da pesquisa à criação". Se sua necessidade for apenas gerar uma única ilustração, ferramentas especializadas (como Midjourney) podem ter vantagem na qualidade da imagem. O valor diferenciado do YouMind é: você pode coletar materiais, fazer pesquisas com IA, escrever textos, gerar imagens com vários modelos e até criar fluxos automatizados via função Skills, transformando etapas repetitivas em tarefas de Agentes executadas com um clique.

FAQ

P: Livros infantis gerados por IA podem ser usados comercialmente?

R: Sim, mas com condições. As diretrizes de 2025 do Escritório de Direitos Autorais dos EUA indicam que o conteúdo gerado por IA precisa de "contribuição criativa humana substancial" para obter proteção. Na prática, você deve editar significativamente o texto da IA, ajustar as ilustrações e manter um registro completo do processo criativo. Ao publicar em plataformas como Amazon KDP, é necessário declarar o uso de assistência por IA.

P: Quanto conteúdo visual uma pessoa consegue produzir por dia com IA?

R: Depende do tipo de conteúdo e da qualidade exigida. Para histórias infantis, após estabelecer um fluxo maduro, é possível produzir de 10 a 20 conjuntos por dia (cada um com 6 a 8 imagens + texto completo). Mas esse número pressupõe que você já tenha personagens definidos, templates de estilo e processos de revisão. Para quem está começando, recomenda-se iniciar com 3 a 5 conjuntos por dia e otimizar o processo gradualmente.

P: O conteúdo de IA sofrerá "shadowban" ou limitação de alcance pelas plataformas?

R: O Google, em suas diretrizes oficiais de 2025, afirmou claramente que o ranking de busca foca na qualidade do conteúdo e nos sinais E-E-A-T (Experiência, Especialidade, Autoridade e Confiabilidade), e não se o conteúdo foi gerado por IA 7. A atitude das redes sociais é semelhante: desde que o conteúdo seja valioso para o usuário e não seja spam em massa de baixa qualidade, o conteúdo assistido por IA não será limitado propositalmente. O segredo é garantir que cada peça passe por revisão humana e personalização.

P: Qual o custo inicial para criar um canal de livros ilustrados com IA?

R: É possível começar quase com custo zero. A maioria das ferramentas de criação de conteúdo por IA oferece créditos gratuitos suficientes para testes iniciais e montagem do fluxo. Quando você validar a direção do conteúdo e o feedback do público, poderá escolher planos pagos conforme a demanda de produção. No YouMind, por exemplo, a versão gratuita já inclui capacidades básicas de geração de imagem e criação de documentos, enquanto os planos pagos oferecem mais opções de modelos e limites de uso maiores.

Conclusão

Em 2026, a criação em massa com IA não é mais uma questão de "se é possível fazer", mas de "como fazer de forma mais eficiente que os outros".

Lembre-se de três pontos fundamentais. Primeiro, o fluxo de trabalho é mais importante que a ferramenta individual. Em vez de gastar tempo comparando qual gerador de imagem é o melhor, gaste tempo montando um processo completo da coleta à distribuição. Segundo, a revisão humana é o limite da qualidade. A IA acelera, o humano valida; essa divisão de tarefas não mudará no futuro previsível. Terceiro, comece pequeno e itere rápido. Escolha um nicho (ex: histórias de ninar), use a combinação mais simples de ferramentas para validar o processo e depois otimize e expanda.

Se você procura uma plataforma que cubra todo o ciclo "Pesquisa de material → Criação de texto → Geração de imagem por IA → Automação de fluxo", experimente o YouMind gratuitamente e comece a construir sua linha de produção de conteúdo a partir de um Board.

Referências

[1] Relatório de Mercado Global de Criação de Conteúdo por IA Generativa (2026-2035)

[3] Livros infantis com IA estão em alta: análise de casos e métodos

[4] Reddit r/KDP: Discussão sobre as melhores ferramentas de ilustração de livros infantis com IA

[5] Como construir um gerador de ilustrações de livros infantis com IA (Tutorial MindStudio)

[6] 35 ferramentas de geração de conteúdo por IA para explorar em 2026 (TechTarget)

[7] Principais plataformas de criação de conteúdo por IA em 2026 (Clarity Ventures)

Tens perguntas sobre este artigo?

Pergunta à IA gratuitamentePublicações relacionadas

Teste prático do vazamento do GPT Image 2: supera o Nano Banana Pro em testes cegos?

TL; DR Principais Pontos Em 4 de abril de 2026, o desenvolvedor independente Pieter Levels (@levelsio) foi o primeiro a revelar no X: três modelos misteriosos de geração de imagem apareceram na plataforma de testes cegos Arena, com os codinomes maskingtape-alpha, gaffertape-alpha e packingtape-alpha. Esses nomes parecem saídos de uma prateleira de fitas adesivas de uma loja de ferragens, mas a qualidade das imagens geradas deixou toda a comunidade de AI em alvoroço. Este artigo é ideal para criadores, designers e entusiastas de tecnologia que acompanham as últimas tendências em geração de imagens por AI. Se você já usou o Nano Banana Pro ou o GPT Image 1.5, este texto ajudará a entender o real nível da próxima geração de modelos. A discussão no subreddit r/singularity recebeu 366 votos e mais de 200 comentários em 24 horas. O usuário ThunderBeanage postou: "Pelos meus testes, este modelo é absolutamente insano, muito superior ao Nano Banana." Uma pista ainda mais crucial: quando os usuários perguntavam diretamente a identidade do modelo, ele afirmava ser da OpenAI. Fonte da imagem: Captura de tela do teste cego do GPT Image 2 no Arena, vazada originalmente por @levelsio Se você usa AI para gerar imagens com frequência, sabe bem: fazer o modelo renderizar texto corretamente sempre foi o desafio mais frustrante. Erros de ortografia, letras deformadas e layouts caóticos são problemas comuns em quase todos os modelos. O avanço do GPT Image 2 nessa área é o foco principal das discussões na comunidade. @PlayingGodAGI compartilhou duas imagens de teste extremamente convincentes: uma é um diagrama anatômico dos músculos frontais do corpo humano, onde cada músculo, osso, nervo e vaso sanguíneo está rotulado com precisão de livro didático; a outra é uma captura de tela da página inicial do YouTube, onde os elementos da UI, miniaturas de vídeo e textos de títulos não apresentam nenhuma distorção. Ele escreveu em seu post: "Isso elimina a última falha das imagens geradas por AI." Fonte da imagem: Comparação entre diagrama anatômico e captura do YouTube exibida por @PlayingGodAGI A avaliação de @avocadoai_co foi ainda mais direta: "A renderização de texto é simplesmente insana (The text rendering is just absolutely insane)." @0xRajat também destacou: "O conhecimento de mundo deste modelo é assustadoramente bom, e a renderização de texto beira a perfeição. Se você já usou qualquer modelo de geração de imagem, sabe o quão profunda é essa dor." Fonte da imagem: Efeito de restauração de interface de site testado de forma independente pelo blogueiro japonês @masahirochaen O blogueiro japonês @masahirochaen também realizou testes independentes, confirmando que o modelo se destaca na descrição do mundo real e na restauração de interfaces de sites, sendo que até a renderização de caracteres japoneses (kana e kanji) é precisa. Usuários do Reddit notaram o mesmo, comentando que "o que me impressionou é que tanto o kanji quanto o katakana são válidos". Esta é a pergunta que todos estão fazendo: o GPT Image 2 realmente superou o Nano Banana Pro? @AHSEUVOU15 realizou uma série de testes comparativos visuais, exibindo lado a lado os resultados do Nano Banana Pro, GPT Image 2 (dos testes A/B) e GPT Image 1.5. Fonte da imagem: Comparação de três imagens por @AHSEUVOU15; da direita para a esquerda: NBP, GPT Image 2, GPT Image 1.5 A conclusão de @AHSEUVOU15 foi cautelosa: "Neste caso, o NBP ainda é melhor, mas o GPT Image 2 é certamente um avanço claro em relação ao 1.5." Isso indica que a diferença entre os dois modelos tornou-se muito pequena, e o vencedor depende do tipo específico de prompt. De acordo com uma reportagem detalhada da OfficeChai, os testes da comunidade revelaram mais detalhes : @socialwithaayan compartilhou selfies na praia e capturas de Minecraft que reforçam essas descobertas, resumindo: "A renderização de texto finalmente funciona; o conhecimento de mundo e o realismo estão em outro nível." Fonte da imagem: Efeito de geração de captura de tela do jogo Minecraft pelo GPT Image 2 compartilhado por @socialwithaayan [9](https://x.com/socialwithaayan/status/2040434305487507475) O GPT Image 2 não é isento de falhas. A reportagem da OfficeChai apontou que o modelo ainda falha no teste de reflexo do Cubo Mágico (Rubik's Cube reflection test). Este é um teste de estresse clássico no campo da geração de imagens, que exige que o modelo compreenda relações de espelhamento em um espaço tridimensional para renderizar com precisão o reflexo de um Cubo Mágico em um espelho. O feedback dos usuários do Reddit também confirmou isso. Alguém, ao testar "projetar uma criatura completamente nova que pudesse existir em um ecossistema real", descobriu que, embora o modelo consiga gerar imagens visualmente complexas, a lógica espacial interna nem sempre é consistente. Como disse um usuário: "Modelos de texto para imagem são essencialmente sintetizadores visuais, não motores de simulação biológica." Além disso, versões anteriores de testes cegos (codinomes Chestnut e Hazelnut) reportadas pela 36Kr receberam críticas por terem um "aspecto muito plastificado". No entanto, a julgar pelo feedback da comunidade sobre a nova série "tape", esse problema parece ter sido significativamente mitigado. O momento do vazamento do GPT Image 2 é intrigante. Em 24 de março de 2026, a OpenAI anunciou o encerramento do Sora, seu aplicativo de geração de vídeo, apenas seis meses após o lançamento. A Disney foi informada apenas uma hora antes do anúncio oficial. Na época, o Sora consumia cerca de US$ 1 milhão por dia, e o número de usuários havia caído de um pico de 1 milhão para menos de 500 mil. O encerramento do Sora liberou uma enorme quantidade de poder computacional. A análise da OfficeChai sugere que a próxima geração de modelos de imagem é o destino mais lógico para esses recursos. O GPT Image 1.5 da OpenAI já havia alcançado o topo do ranking de imagens do LMArena em dezembro de 2025, superando o Nano Banana Pro. Se a série "tape" for de fato o GPT Image 2, a OpenAI está dobrando sua aposta no campo de AI de consumo para geração de imagens — a "única área onde o crescimento viral em massa ainda é altamente provável". Vale notar que os três modelos "tape" foram removidos do LMArena. Usuários do Reddit acreditam que isso pode significar que o lançamento oficial está próximo. Combinado com roteiros que circularam anteriormente, o novo modelo de imagem tem grandes chances de ser lançado simultaneamente com o esperado GPT-5.2. Embora o GPT Image 2 ainda não tenha sido lançado oficialmente, você pode se preparar usando as ferramentas disponíveis: É importante notar que o desempenho dos modelos nos testes cegos do Arena pode diferir da versão final de lançamento. Os modelos em fase de teste cego geralmente ainda estão sendo ajustados, e as configurações finais de parâmetros e recursos podem mudar. P: Quando o GPT Image 2 será lançado oficialmente? R: A OpenAI ainda não confirmou oficialmente a existência do GPT Image 2. No entanto, a remoção dos três modelos "tape" do Arena é vista pela comunidade como um sinal de que o lançamento pode ocorrer em 1 a 3 semanas. Com os rumores do GPT-5.2, é possível que ele chegue em meados ou no final de abril de 2026. P: Qual é melhor: GPT Image 2 ou Nano Banana Pro? R: Os resultados atuais dos testes cegos mostram que ambos têm vantagens. O GPT Image 2 lidera em renderização de texto, fidelidade de UI e conhecimento de mundo, enquanto o Nano Banana Pro ainda apresenta melhor qualidade de imagem geral em certos cenários. Uma conclusão definitiva exigirá testes sistemáticos em maior escala após o lançamento oficial. P: Qual a diferença entre maskingtape-alpha, gaffertape-alpha e packingtape-alpha? R: Esses três codinomes podem representar diferentes configurações ou versões do mesmo modelo. Pelos testes da comunidade, o maskingtape-alpha se destacou em capturas de Minecraft, mas o nível geral dos três é próximo. O estilo de nomenclatura é consistente com a série gpt-image anterior da OpenAI. P: Onde posso testar o GPT Image 2? R: Atualmente, o GPT Image 2 não está disponível publicamente, e os modelos "tape" foram removidos do Arena. Você pode acompanhar o para ver se eles reaparecem ou aguardar o lançamento oficial da OpenAI para usá-lo via ChatGPT ou API. P: Por que a renderização de texto sempre foi um problema para modelos de AI? R: Modelos de difusão tradicionais geram imagens em nível de pixel e não são naturalmente bons em lidar com texto, que exige traços e espaçamentos precisos. A série GPT Image utiliza uma arquitetura autorregressiva em vez de apenas difusão pura, o que permite entender melhor a semântica e a estrutura do texto, resultando em avanços na renderização. O vazamento do GPT Image 2 marca uma nova fase na competição de geração de imagens por AI. A renderização de texto e o conhecimento de mundo, dois problemas de longa data, estão sendo resolvidos rapidamente, e o Nano Banana Pro não é mais o único padrão de referência. O raciocínio espacial continua sendo uma fraqueza comum a todos os modelos, mas a velocidade do progresso supera as expectativas. Para os usuários de geração de imagens por AI, este é o momento ideal para criar seu próprio sistema de avaliação. Teste o mesmo prompt em diferentes modelos e registre os pontos fortes de cada um; assim, quando o GPT Image 2 for lançado oficialmente, você poderá fazer um julgamento preciso imediatamente. Quer gerenciar seus prompts e resultados de testes de AI de forma sistemática? Experimente o para salvar as saídas de diferentes modelos em um único Board e compará-las a qualquer momento. [1] [2] [3] [4] [5] [6] [7] [8] [9] [10]

Jensen Huang anuncia que a "AGI foi alcançada": a verdade, as controvérsias e uma análise profunda

TL; DR Pontos Principais Em 23 de março de 2026, uma notícia explodiu nas redes sociais. O CEO da NVIDIA, Jensen Huang, disse a seguinte frase no podcast de Lex Fridman: "I think we've achieved AGI" (Acho que alcançamos a AGI). O tweet publicado pela Polymarket recebeu mais de 16 mil curtidas e 4,7 milhões de visualizações, com grandes veículos de tecnologia como The Verge, Forbes e Mashable cobrindo o assunto intensamente em poucas horas. Este artigo é voltado para todos os leitores que acompanham as tendências de IA, seja você um profissional da área, investidor ou alguém curioso sobre inteligência artificial. Vamos restaurar o contexto completo dessa declaração, desconstruir o "jogo de palavras" sobre a definição de AGI e analisar o que isso significa para toda a indústria de IA. Mas, se você tirar conclusões apenas pela manchete, perderá a parte mais importante da história. Para entender o peso da frase de Jensen Huang, é preciso primeiro observar as condições prévias. O apresentador do podcast, Lex Fridman, propôs uma definição muito específica de AGI: se um sistema de IA consegue "fazer o seu trabalho", ou seja, fundar, desenvolver e operar uma empresa de tecnologia avaliada em mais de 1 bilhão de dólares. Ele perguntou a Huang quão longe estamos dessa AGI: 5 anos? 10 anos? 20 anos? A resposta de Huang foi: "I think it's now" (Acho que é agora). Uma análise profunda da Mashable apontou um detalhe crucial. Huang disse a Fridman: "You said a billion, and you didn't say forever" (Você disse um bilhão, e não disse para sempre). Em outras palavras, na interpretação de Huang, se uma IA conseguir criar um App viral, faturar brevemente 1 bilhão de dólares e depois falir, isso já contaria como "alcançar a AGI". O exemplo que ele citou foi a OpenClaw, uma plataforma de AI Agent de código aberto. Huang imaginou um cenário: a IA cria um serviço web simples, bilhões de pessoas gastam 50 centavos cada para usá-lo, e então o serviço desaparece silenciosamente. Ele chegou a comparar com sites da era da bolha da internet, sugerindo que a complexidade daqueles sites não era muito maior do que a que um AI Agent pode gerar hoje. Então, ele proferiu a frase que a maioria dos caça-cliques ignorou: "The odds of 100,000 of those agents building NVIDIA is zero percent" (A probabilidade de 100.000 desses agents construírem uma NVIDIA é de zero por cento). Isso não é apenas uma pequena nota de rodapé. Como comentou a Mashable: "That's not a small caveat. It's the whole ballgame" (Isso não é uma pequena ressalva. É o ponto central de tudo). Jensen Huang não é o primeiro líder tecnológico a declarar que a "AGI foi alcançada". Para entender essa afirmação, é necessário inseri-la em uma narrativa industrial mais ampla. Em 2023, na cúpula DealBook do New York Times, Huang deu uma definição diferente de AGI: um software capaz de passar em vários testes de inteligência humana com um nível razoável de competitividade. Na época, ele previu que a IA atingiria esse padrão em 5 anos. Em dezembro de 2025, o CEO da OpenAI, Sam Altman, afirmou que "we built AGIs" (nós construímos AGIs) e disse que "AGI kinda went whooshing by" (a AGI meio que passou voando), sugerindo que seu impacto social foi muito menor do que o esperado e recomendando que a indústria passasse a definir "superinteligência". Em fevereiro de 2026, Altman disse novamente à Forbes: "We basically have built AGI, or very close to it" (Basicamente já construímos a AGI, ou estamos muito perto disso). No entanto, ele acrescentou que essa era uma expressão de "nível espiritual", não literal, e observou que a AGI ainda exigiria "muitos avanços de médio porte". Percebe o padrão? Cada declaração de que a "AGI foi alcançada" vem acompanhada de uma degradação silenciosa da definição. A carta de fundação da OpenAI define AGI como "sistemas altamente autônomos que superam os humanos na maioria dos trabalhos economicamente valiosos". Essa definição é importante porque o contrato da OpenAI com a Microsoft contém uma cláusula de gatilho de AGI: uma vez que a AGI seja considerada alcançada, os direitos de acesso da Microsoft à tecnologia da OpenAI mudariam drasticamente. De acordo com a Reuters, o novo acordo estipula que um painel de especialistas independentes deve verificar se a AGI foi alcançada, com a Microsoft mantendo 27% das ações e direitos parciais de uso da tecnologia até 2032. Quando dezenas de bilhões de dólares em interesses estão atrelados a um termo vago, "quem define a AGI" deixa de ser uma questão acadêmica e se torna uma disputa comercial. Se a cobertura da mídia tecnológica foi contida, as reações nas redes sociais apresentaram um espectro completamente diferente. No Reddit, comunidades como r/singularity, r/technology e r/BetterOffline rapidamente se encheram de discussões. Um comentário de um usuário do r/singularity recebeu muitos votos positivos: "AGI is not just an 'AI system that can do your job'. It's literally in the name: Artificial GENERAL Intelligence" (AGI não é apenas um 'sistema de IA que pode fazer o seu trabalho'. Está literalmente no nome: Inteligência Artificial GERAL). No r/technology, um desenvolvedor que afirma estar construindo AI Agents para automatizar tarefas de desktop escreveu: "We are nowhere near AGI. Current models are great at structured reasoning but still can't handle the kind of open-ended problem solving a junior dev does instinctively. Jensen is selling GPUs though, so the optimism makes sense" (Não estamos nem perto da AGI. Os modelos atuais são ótimos em raciocínio estruturado, mas ainda não conseguem lidar com o tipo de resolução de problemas abertos que um desenvolvedor júnior faz instintivamente. Mas o Jensen está vendendo GPUs, então o otimismo faz sentido). As discussões em chinês no Twitter/X também foram ativas. O usuário @DefiQ7 publicou um post educativo detalhado, distinguindo claramente a AGI da atual "IA especializada" (como ChatGPT e ERNIE Bot), que foi amplamente compartilhado. O post afirmava: "Esta é uma notícia de nível nuclear no mundo da tecnologia", mas enfatizava que AGI significa "aprendizado autônomo multissetorial, raciocínio, planejamento e adaptação a cenários desconhecidos", o que não está no escopo das capacidades atuais da IA. No r/BetterOffline, as discussões foram ainda mais ácidas. Um usuário comentou: "Which is higher? The number of times Trump has achieved 'total victory' in Iran, or the number of times Jensen Huang has achieved 'AGI'?" (Qual número é maior? O número de vezes que Trump alcançou a 'vitória total' no Irã, ou o número de vezes que Jensen Huang 'alcançou a AGI'?). Outro usuário apontou um problema antigo na academia: "This has been a problem with Artificial Intelligence as an academic field since its very inception" (Este tem sido um problema com a Inteligência Artificial como campo acadêmico desde a sua criação). Diante das definições de AGI em constante mudança das gigantes da tecnologia, como uma pessoa comum pode julgar o nível real de desenvolvimento da IA? Aqui está uma estrutura de pensamento útil. Passo 1: Distinguir "demonstração de capacidade" de "inteligência geral". Os modelos de IA mais avançados atualmente têm um desempenho impressionante em muitas tarefas específicas. O GPT-5.4 pode escrever textos fluentes, e AI Agents podem automatizar fluxos de trabalho complexos. Mas existe um abismo enorme entre "ter um bom desempenho em tarefas específicas" e "possuir inteligência geral". Uma IA que pode derrotar o campeão mundial de xadrez pode não ser capaz de realizar algo simples como "me passar o copo que está na mesa". Passo 2: Focar nos qualificadores, não nas manchetes. Jensen Huang disse "I think" (Eu acho), não "We have proven" (Nós provamos). Altman disse "spiritual" (espiritual), não "literal". Esses qualificadores não são humildade, mas sim estratégias jurídicas e de relações públicas precisas. Quando se trata de contratos de dezenas de bilhões de dólares, cada palavra é cuidadosamente pesada. Passo 3: Observar as ações, não as declarações. Na GTC 2026, a NVIDIA lançou sete novos chips, apresentou o DLSS 5, a plataforma OpenClaw e o stack de Agents empresariais NemoClaw. Esses são avanços tecnológicos reais. No entanto, Huang mencionou "inferência" (inference) quase 40 vezes em seu discurso, enquanto "treinamento" (training) foi mencionado apenas cerca de 10 vezes. Isso indica que o foco da indústria está mudando de "criar uma IA mais inteligente" para "fazer a IA executar tarefas de forma mais eficiente". Isso é progresso de engenharia, não um salto na inteligência. Passo 4: Construir seu próprio sistema de acompanhamento de informações. A densidade de informações na indústria de IA é altíssima, com lançamentos e declarações importantes toda semana. É fácil ser levado por manchetes sensacionalistas. Recomenda-se criar o hábito de ler fontes primárias (como blogs oficiais das empresas, artigos acadêmicos, transcrições de podcasts) e usar ferramentas para salvar e organizar sistematicamente esses materiais. Por exemplo, você pode usar a função Board do para salvar fontes importantes e usar a IA para fazer perguntas e cruzar dados, evitando ser enganado por uma narrativa única. P: A AGI mencionada por Jensen Huang é a mesma definida pela OpenAI? R: Não. Jensen Huang respondeu com base na definição restrita proposta por Lex Fridman (uma IA capaz de fundar uma empresa de 1 bilhão de dólares), enquanto a definição de AGI na carta da OpenAI é "sistemas altamente autônomos que superam os humanos na maioria dos trabalhos economicamente valiosos". Há uma lacuna enorme entre os dois padrões, sendo que o último exige uma gama de capacidades muito superior ao primeiro. P: A IA atual pode realmente operar uma empresa de forma independente? R: Atualmente, não. O próprio Jensen Huang admitiu que um AI Agent pode criar um aplicativo de sucesso passageiro, mas "a probabilidade de construir uma NVIDIA é zero". A IA atual é excelente na execução de tarefas estruturadas, mas ainda depende fortemente da orientação humana em cenários que exigem julgamento estratégico de longo prazo, coordenação multissetorial e resposta a situações desconhecidas. P: Qual será o impacto do alcance da AGI no trabalho das pessoas comuns? R: Mesmo sob a definição mais otimista, o impacto da IA atual reflete-se principalmente no aumento da eficiência em tarefas específicas, e não na substituição total do trabalho humano. Sam Altman também admitiu no final de 2025 que o impacto social da AGI foi "muito menor do que o esperado". No curto prazo, é mais provável que a IA mude a forma de trabalhar como uma ferramenta auxiliar poderosa, em vez de substituir cargos diretamente. P: Por que os CEOs das empresas de tecnologia estão com tanta pressa para anunciar que a AGI foi alcançada? R: Os motivos são variados. O negócio principal da NVIDIA é vender chips de processamento para IA; a narrativa da AGI mantém o entusiasmo do mercado por investimentos em infraestrutura de IA. O contrato da OpenAI com a Microsoft contém cláusulas de gatilho de AGI, e a definição de AGI afeta diretamente a distribuição de dezenas de bilhões de dólares. Além disso, no mercado de capitais, a narrativa de que "a AGI está chegando" é um pilar importante para sustentar as altas avaliações das empresas de IA. P: Quão longe está o desenvolvimento da IA na China em relação à AGI? R: A China fez progressos significativos no campo da IA. Até junho de 2025, o número de usuários de IA generativa na China atingiu 515 milhões, e modelos como DeepSeek e Qwen tiveram excelente desempenho em várias avaliações. No entanto, a AGI é um desafio tecnológico global e, atualmente, não existe um sistema de AGI amplamente reconhecido pela academia em nenhum lugar do mundo. Estima-se que a taxa de crescimento anual composta do mercado da indústria de IA na China entre 2025 e 2035 seja de 30,6% a 47,1%, mostrando um forte ímpeto de desenvolvimento. A declaração de Jensen Huang de que "a AGI foi alcançada" é, em essência, uma manifestação otimista baseada em uma definição extremamente restrita, e não um marco tecnológico comprovado. Ele mesmo admitiu que os AI Agents atuais estão a um mundo de distância de construir empresas verdadeiramente complexas. O fenômeno de repetidamente "mover a trave" na definição de AGI revela o jogo delicado entre a narrativa tecnológica e os interesses comerciais na indústria. Da OpenAI à NVIDIA, cada declaração de "alcançamos a AGI" vem acompanhada de uma redução silenciosa dos padrões. Como consumidores de informação, o que precisamos não é perseguir manchetes, mas sim construir nossa própria estrutura de julgamento. A tecnologia de IA está avançando rapidamente, isso é inegável. Os novos chips, plataformas de Agents e tecnologias de otimização de inferência lançados na GTC 2026 são avanços de engenharia reais. Mas embalar esses progressos como "AGI alcançada" é mais uma estratégia de narrativa de mercado do que uma conclusão científica. Manter a curiosidade, o senso crítico e acompanhar fontes primárias é a melhor estratégia para não ser submerso pelo fluxo de informações nesta era acelerada pela IA. Quer acompanhar as tendências da indústria de IA de forma sistemática? Experimente o , salve fontes importantes em sua base de conhecimento pessoal e deixe a IA ajudá-lo a organizar, perguntar e cruzar informações. [1] [2] [3] [4] [5] [6]

A Ascensão dos Influenciadores Virtuais com IA: Tendências e Oportunidades que os Criadores Precisam Conhecer

TL; DR Pontos Principais Em 21 de março de 2026, Elon Musk postou um tweet de apenas oito palavras no X: "AI bots will be more human than human." Este tweet obteve mais de 62 milhões de visualizações e 580 mil curtidas em 72 horas. Ele escreveu isso em resposta a uma imagem de um "rosto de influenciadora perfeita" gerado por AI. Isso não é uma previsão de ficção científica. Se você é um criador de conteúdo, blogueiro ou gestor de redes sociais, provavelmente já se deparou no seu feed com rostos "perfeitos demais", sem conseguir distinguir se são pessoas reais ou AI. Este artigo ajudará você a entender a realidade atual dos influenciadores virtuais de AI, os dados de receita dos principais casos e como você, como criador real, deve lidar com essa transformação. Este artigo é ideal para criadores de conteúdo, gestores de redes sociais, profissionais de marketing de marca e todos os interessados em tendências de AI. Primeiro, vejamos alguns números impressionantes. O tamanho do mercado global de influenciadores virtuais atingiu 6,06 bilhões de dólares em 2024 e deve crescer para 8,3 bilhões de dólares em 2025, com uma taxa de crescimento anual superior a 37%. Segundo a Straits Research, esse número deve disparar para 111,78 bilhões de dólares até 2033. Ao mesmo tempo, toda a indústria de marketing de influência atingiu 32,55 bilhões de dólares em 2025 e deve ultrapassar a marca de 40 bilhões de dólares em 2026. Olhando para casos individuais, dois exemplos representativos merecem atenção. Lil Miquela é reconhecida como a "primeira geração de influenciadores de AI". Esta personagem virtual, criada em 2016, possui mais de 2,4 milhões de seguidores no Instagram e colabora com marcas como Prada, Calvin Klein e Samsung. Sua equipe (parte da Dapper Labs) cobra dezenas de milhares de dólares por postagem de marca, e apenas a receita de assinatura na plataforma Fanvue chega a 40.000 dólares por mês. Somando as parcerias de marca, sua receita mensal pode ultrapassar 100.000 dólares. Estima-se que sua receita anual média desde 2016 seja de cerca de 2 milhões de dólares. Aitana López representa a possibilidade de "empreendedores individuais também criarem influenciadores de AI". Esta modelo virtual de cabelo rosa, criada pela agência criativa espanhola The Clueless, tem mais de 370 mil seguidores no Instagram e uma receita mensal entre 3.000 e 10.000 euros. O motivo de sua criação foi prático: o fundador Rubén Cruz estava cansado dos fatores incontroláveis dos modelos reais (atrasos, cancelamentos, conflitos de agenda) e decidiu "criar uma influenciadora que nunca desse bolo". A previsão da gigante de PR Ogilvy em 2024 abalou a indústria: até 2026, os influenciadores virtuais de AI ocuparão 30% do orçamento de marketing de influência. Uma pesquisa com 1.000 executivos de marketing sênior nos EUA e Reino Unido mostrou que 79% dos entrevistados afirmaram estar aumentando o investimento em criadores de conteúdo gerados por AI. Entender a lógica das marcas é fundamental para ver a força motriz por trás dessa mudança. Risco zero, controle total. O maior perigo dos influenciadores reais é o "cancelamento". Um comentário inadequado ou um escândalo na vida privada pode fazer com que milhões investidos pela marca virem fumaça. Influenciadores virtuais não têm esse problema. Eles não se cansam, não envelhecem e não postam tweets às três da manhã que façam a equipe de relações públicas entrar em colapso. Como disse Rubén Cruz, fundador da The Clueless: "Muitos projetos foram suspensos ou cancelados por problemas dos próprios influenciadores; isso não é um erro de design, é a imprevisibilidade humana." Produção de conteúdo 24/7. Influenciadores virtuais podem postar diariamente, acompanhar tendências em tempo real e "aparecer" em qualquer cenário, com um custo muito inferior ao de uma filmagem real. Segundo estimativas da BeyondGames, se Lil Miquela postar uma vez por dia no Instagram, sua receita potencial em 2026 pode chegar a 4,7 milhões de libras. Essa eficiência de produção é inigualável para qualquer criador humano. Consistência precisa da marca. A colaboração da Prada com Lil Miquela gerou uma taxa de engajamento 30% maior do que as campanhas de marketing convencionais. Cada expressão, cada look e cada legenda de um influenciador virtual podem ser projetados com precisão para garantir que combinem perfeitamente com o tom da marca. No entanto, toda moeda tem dois lados. Uma reportagem da Business Insider de março de 2026 apontou que a resistência dos consumidores a contas de AI está aumentando, e algumas marcas já começaram a recuar em suas estratégias de influenciadores de AI. Uma pesquisa da YouGov mostrou que mais de um terço dos entrevistados expressou preocupação com a tecnologia de AI. Isso significa que influenciadores virtuais não são uma solução mágica; a autenticidade continua sendo um peso importante na mente dos consumidores. Diante do impacto dos influenciadores virtuais de AI, o pânico não faz sentido; o valor está na ação. Aqui estão quatro estratégias de resposta comprovadas. Estratégia 1: Aprofunde-se na experiência real, faça o que a AI não consegue. A AI pode gerar um rosto perfeito, mas não pode realmente saborear um café ou sentir o cansaço e a satisfação de uma trilha. Em uma discussão no r/Futurology do Reddit, a opinião de um usuário recebeu muitas curtidas: "Influenciadores de AI podem vender produtos, mas as pessoas ainda anseiam por conexões reais." Transforme suas experiências de vida reais, perspectivas únicas e momentos imperfeitos em barreiras de conteúdo. Estratégia 2: Arme-se com ferramentas de AI em vez de lutar contra elas. Criadores inteligentes já usam AI para aumentar a eficiência. No Reddit, criadores compartilham fluxos de trabalho completos: usando ChatGPT para roteiros, ElevenLabs para dublagem e HeyGen para produção de vídeo. Você não precisa se tornar um influenciador de AI, mas precisa deixar que a AI seja sua assistente de criação. Estratégia 3: Rastreie sistematicamente as tendências do setor para criar vantagem de informação. O campo dos influenciadores de AI muda muito rápido, com novas ferramentas, casos e dados surgindo toda semana. Apenas navegar pelo Twitter e Reddit não é suficiente. Você pode usar o para gerenciar sistematicamente as informações do setor espalhadas: salve artigos importantes, tweets e relatórios de pesquisa em Boards, use a AI para organizar e recuperar automaticamente, e faça perguntas ao seu banco de materiais a qualquer momento, como "Quais foram os três maiores investimentos no campo de influenciadores virtuais em 2026?". Quando você precisar escrever uma análise do setor ou gravar um vídeo, o material já estará pronto, em vez de começar a busca do zero. Estratégia 4: Explore modelos de conteúdo de colaboração humano-máquina. O futuro não é um jogo de soma zero entre "Humano vs AI", mas sim uma simbiose de "Humano + AI". Você pode usar AI para gerar materiais visuais, mas usar a voz e os pontos de vista humanos para dar alma a eles. A análise da aponta que influenciadores de AI são adequados para conceitos experimentais que rompem fronteiras, enquanto influenciadores reais continuam insubstituíveis na construção de conexões profundas com o público e na consolidação do valor da marca. O maior desafio em acompanhar as tendências de influenciadores virtuais de AI não é a falta de informação, mas sim o excesso e a dispersão dela. Um cenário típico: você vê um tweet de Musk no X, lê um post no Reddit sobre como uma influenciadora de AI ganha 10 mil por mês, descobre uma reportagem profunda na Business Insider sobre marcas recuando e vê um tutorial de produção no YouTube. Essas informações estão espalhadas em quatro plataformas e cinco abas do navegador; três dias depois, quando você quer escrever um artigo, não consegue mais encontrar aquele dado crucial. É exatamente isso que o resolve. Com a , você pode salvar qualquer página da web, tweet ou vídeo do YouTube em seu Board exclusivo com um clique. A AI extrairá automaticamente as informações principais e criará um índice, permitindo que você pesquise e faça perguntas em linguagem natural a qualquer momento. Por exemplo, crie um Board de "Pesquisa de Influenciadores Virtuais de AI", gerencie todos os materiais relacionados de forma centralizada e, quando precisar produzir conteúdo, pergunte diretamente ao Board: "Qual é o modelo de negócios de Aitana López?" ou "Quais marcas começaram a recuar na estratégia de influenciadores de AI?". As respostas aparecerão com links para as fontes originais. Vale ressaltar que a vantagem do YouMind está na integração de informações e auxílio à pesquisa; ele não é uma ferramenta de geração de influenciadores de AI. Se sua necessidade é criar a imagem de um personagem virtual, você ainda precisará de ferramentas profissionais como Midjourney, Stable Diffusion ou HeyGen. Mas no elo central do trabalho do criador — "pesquisar tendências → acumular materiais → produzir conteúdo" — o pode encurtar significativamente a distância entre a inspiração e o produto final. P: Os influenciadores virtuais de AI substituirão completamente os influenciadores reais? R: Não a curto prazo. Influenciadores virtuais têm vantagens no controle da marca e na eficiência da produção de conteúdo, mas a demanda dos consumidores por autenticidade continua forte. Reportagens da Business Insider de 2026 mostram que algumas marcas começaram a reduzir o investimento em influenciadores de AI devido à resistência dos consumidores. É mais provável que ambos formem uma relação complementar em vez de substitutiva. P: Pessoas comuns podem criar seus próprios influenciadores virtuais de AI? R: Sim. No Reddit, há muitos criadores compartilhando experiências de como começar do zero. Ferramentas comuns incluem Midjourney ou Stable Diffusion para gerar imagens consistentes, ChatGPT para escrever legendas e ElevenLabs para gerar voz. O investimento inicial pode ser baixo, mas requer de 3 a 6 meses de operação contínua para ver um crescimento significativo. P: Quais são as fontes de receita dos influenciadores virtuais de AI? R: Elas incluem principalmente três categorias: postagens patrocinadas por marcas (influenciadores de topo cobram de milhares a dezenas de milhares de dólares por postagem), receita de plataformas de assinatura (como Fanvue) e produtos derivados e direitos musicais. Lil Miquela ganha em média 40.000 dólares por mês apenas com assinaturas, com receitas de parcerias de marca sendo ainda maiores. P: Qual é a situação atual do mercado de ídolos virtuais de AI na China? R: A China é um dos mercados mais ativos do mundo no desenvolvimento de ídolos virtuais. Previsões da indústria indicam que o mercado de influenciadores virtuais na China atingirá 270 bilhões de yuans até 2030. De Hatsune Miku e Luo Tianyi a ídolos virtuais hiper-realistas, o mercado chinês já passou por várias fases de desenvolvimento e agora está evoluindo para a interação em tempo real impulsionada por AI. P: O que as marcas devem considerar ao escolher colaborar com influenciadores virtuais? R: É crucial avaliar três pontos: a aceitação do público-alvo em relação a figuras virtuais, as políticas de divulgação de conteúdo de AI das plataformas (TikTok e Instagram estão reforçando esses requisitos) e a compatibilidade do influenciador virtual com o tom da marca. Recomenda-se testar primeiro com um orçamento pequeno e decidir se aumenta o investimento com base nos dados. A ascensão dos influenciadores virtuais de AI não é uma previsão distante, mas uma realidade que está acontecendo. Os dados de mercado mostram claramente que o valor comercial dos influenciadores virtuais já foi validado; dos 2 milhões de dólares anuais de Lil Miquela aos 10 mil euros mensais de Aitana López, esses números não podem ser ignorados. Mas para os criadores reais, esta não é uma história de "ser substituído", mas sim uma oportunidade de "reposicionamento". Sua experiência autêntica, perspectiva única e conexão emocional com o público são ativos centrais que a AI não pode replicar. A chave é: use ferramentas de AI para aumentar a eficiência, use métodos sistemáticos para rastrear tendências e use a autenticidade para construir uma barreira competitiva insubstituível. Quer rastrear sistematicamente as tendências de influenciadores de AI e acumular materiais de criação? Experimente usar o para construir seu espaço de pesquisa exclusivo e comece gratuitamente. [1] [2] [3] [4] [5] [6] [7] [8] [9] [10] [11]